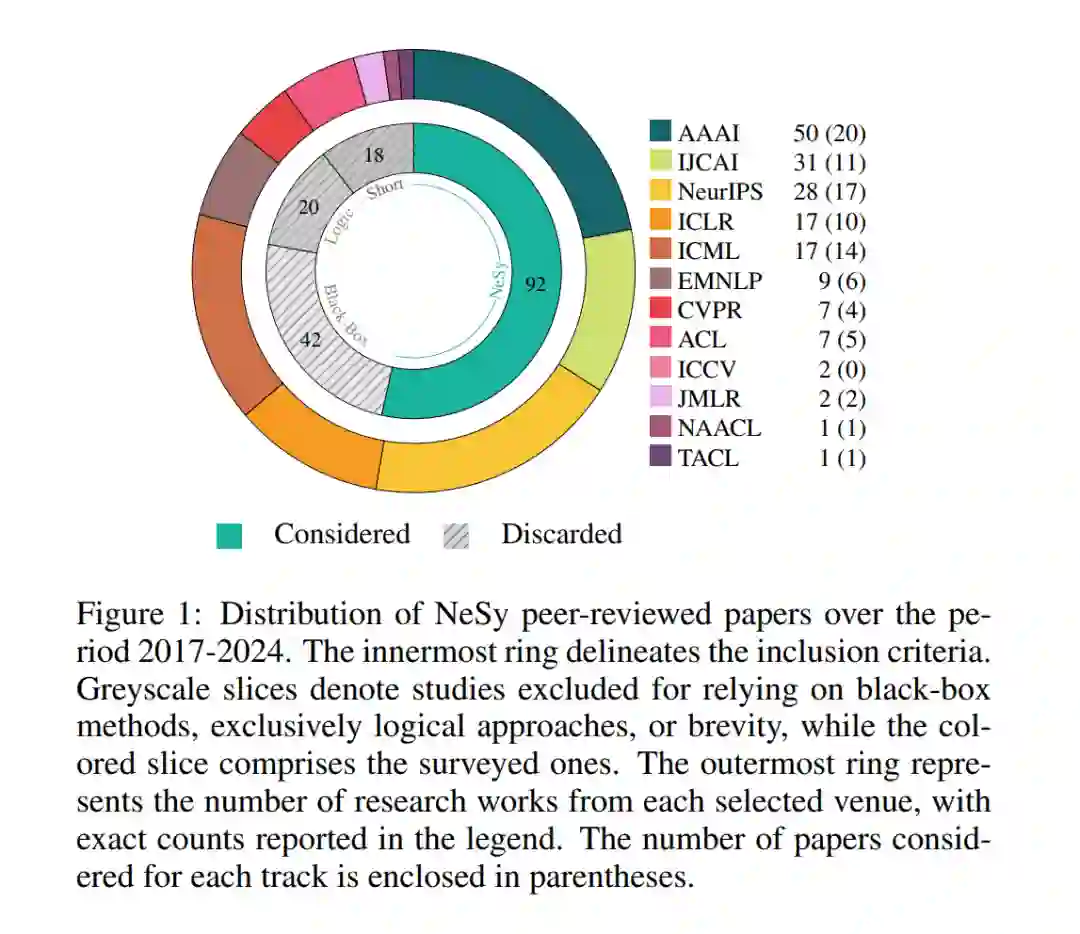

自人工智能(AI)理论化初期以来,符号计算与神经网络的融合便一直吸引着研究者的关注。神经符号(Neuro-Symbolic, NeSy)方法推断或利用行为模式的能力,被广泛认为是实现类人智能的可能路径之一。然而,受限于语义泛化能力以及在利用预定义模式和规则处理复杂领域时的挑战,此类方法在现实场景中的实际落地仍存在障碍。 自 2017 年 AI 领域取得突破性进展以来,**连接主义系统(connectionist systems)**取得了前所未有的成果,这引发了学术界对 NeSy 方案竞争力的质疑,尤其是在自然语言处理和计算机视觉领域。本综述通过考察 NeSy 领域的特定任务进展,探讨了引入符号系统如何增强模型的可解释性与推理能力。我们的研究结果旨在为探索适用于现实任务和应用的可解释 NeSy 方法的研究人员提供参考。 关于所调研各研究工作的复现细节及深入评述,已在以下仓库开源:https://github.com/disi-unibo-nlp/task-oriented-neuro-symbolic.git。

1 引言

“堆叠神经层即我们所需的一切。”这一陈述概括了当前人工智能(AI)领域,尤其是自然语言处理(NLP)和计算机视觉(CV)领域的大部分研究努力。虽然最新神经模型的进步与成就令人瞩目,但它们也掩盖了在数据效率与可解释性方面的根本缺陷。对可信、高效解决方案的需求,自然催生了求助于神经符号(Neuro-Symbolic, NeSy)组件的必要性。 连接主义方法中“思想”的数据类型(即张量)以及对这些信息的隐藏无监督处理,构成了实现层级化与抽象规划的物理屏障;而这种规划能力是无法通过单纯的输入-输出映射来实现的 [Marcus, 2018]。如果我们预见在不久的将来,数据可用性与质量将成为关键挑战(主要源于合成信息可能引入的偏见),我们迫切需要寻找并探索那些对训练集规模依赖较弱的、具备组合能力(compositional abilities)的研究路径 [Giunchiglia et al., 2022]。 我们坚持认为,神经符号方法可以作为一种替代方案,用来打破现代方法所遭受的维度灾难。虽然稀疏性约束正则化机制 [Bach, 2017] 行之有效,但它们需要对目标分布的本质做出强假设,这对于 NLP 和 CV 模型通常处理的复杂领域而言是不切实际的 [Bronstein et al., 2021]。 我们认为,符号组件可以作为一种正则化手段,强制神经模型表现出更复杂的行为。通过将数据驱动的洞察与可解释的、基于逻辑的表示相结合,我们可以获得更高的泛化能力 [Besold et al., 2021]。此外,其他数据驱动范式也已得到关注 [Lodi et al., 2010; Domeniconi et al., 2015]。 随着“推理”和“可解释性”这两个关键词在社区中获得越来越多关注,我们着重指出规则导向(rule-guided)策略与推理后取证(post-inference forensic)策略之间存在关键的符号理解误区。虽然这两种方法都旨在为预测提供依据,但其方法论有着本质区别: * 规则导向方法:约束输出以满足特定标准; * 推理后方法:回顾性地重建导致结果的、合乎逻辑且可解释的推理路径。

我们进一步主张,这些术语不应被用于鼓吹“类人能力”,而应被视为在预定义规则或组件交互图示支配下的、层级化骨干架构中泛化行为的代理。

我们的贡献

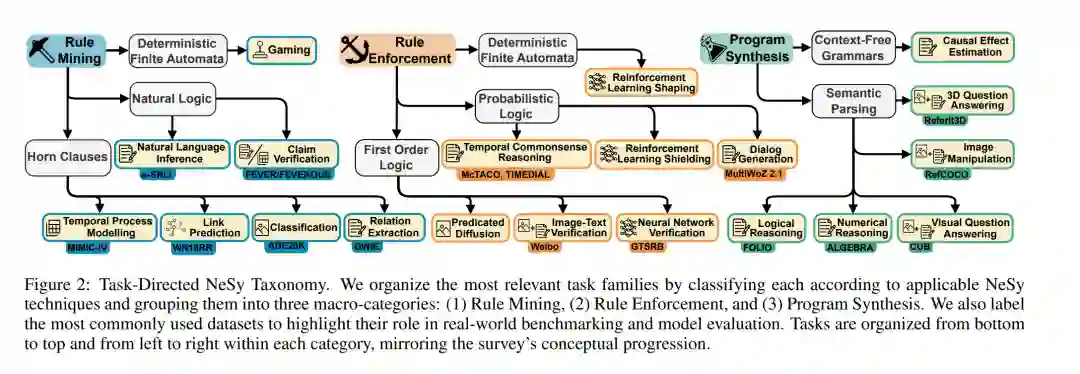

AI 领域对 NeSy 缺乏清晰定义、评估基准的不一致,以及大量缺乏统一比较基础的零散研究方向,是驱动本综述的主要原因。在本文中,我们进行了以任务为导向的文献分析,重点关注 NeSy 方法在不同应用场景中的应用与扩展。我们评估了这些方法的方法论完备性,并将其与现实场景中的黑盒系统进行对比,以识别当前策略的局限性。 区别于近期尝试沿分类维度或网络架构变化进行分类的综述,我们提出了一种新的方法论,通过提供对 NeSy 系统的全面且批判性的概述,解构了这些概念与实践中的不一致性。我们的目标是加深对这些混合系统优势及其内在局限性的理解,为未来的研究奠定基础,并弥合 AI 领域中可解释性与性能之间的鸿沟。