【泡泡一分钟】实现城市环境中定位的交叉视图匹配方法(CVPR-7)

每天一分钟,带你读遍机器人顶级会议文章

标题:Cross-View Image Matching for Geo-localization in UrbanEnvironments

作者:Yicong Tian, Chen Chen, Mubarak Shah

来源:CVPR 2017

编译:蔡纪源

播音员:大大马

欢迎个人转发朋友圈;其他机构或自媒体如需转载,后台留言申请授权

摘要

今天介绍的文章是“Cross-View Image Matching for Geo-localization inUrban Environments”——实现城市地理定位的交叉视图匹配方法,该文章发表在VPR2017。

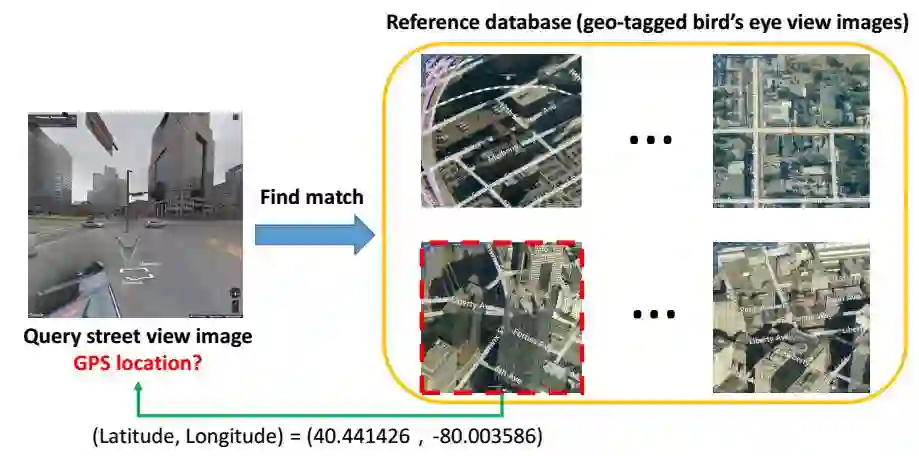

在本文中,作者旨在解决交叉视图地理定位问题。如下图所示,在带地理信息的鸟瞰图参考数据库中搜索匹配图像(图示右侧),来估计一幅街景视角的图像(图示左侧)所对应的GPS位置。

由于深卷积神经网络(CNN)在图像分类和目标检测中已经有了巨大成功,作者借此提出一个新的框架来解决交叉视图地理定位问题,流程示意图如下。

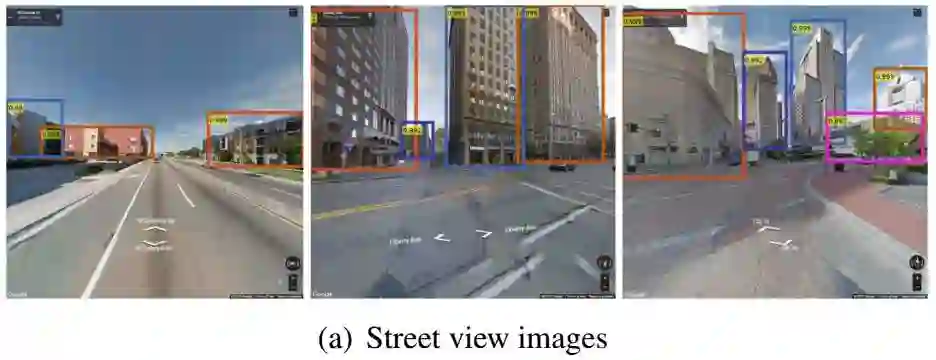

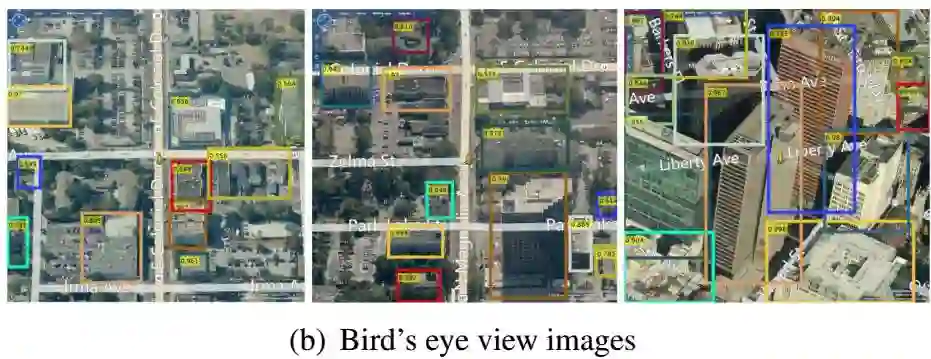

首先,采用Faster R-CNN[16]在待查询图像和参考图像中检测建筑物(下图颜色框)。

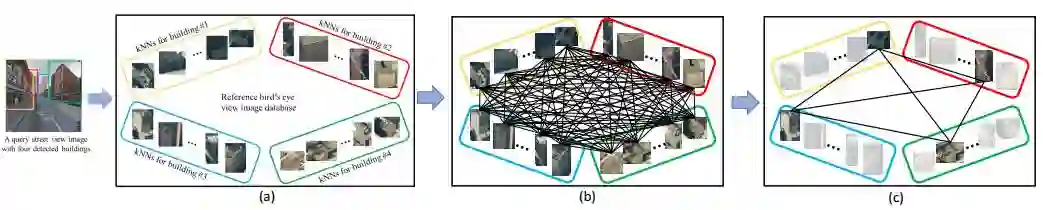

其次,对于待查询图像中的每个建筑物(下图最左4个检测框,代表4个建筑),我们使用训练好的Siamese网络(包含正匹配对和负匹配对)在参考建筑物中检索K最近邻(下图a中,4个聚类集合对应了待查询图像中4个建筑)。为让每个待查询建筑找到正确的最近邻,我们开发一个基于优势集(Dominant Set)的高效多个最近邻匹配方法(下图b)。这种方法同时考虑了全局相似和局部相似,最终用最优选取的4个建筑GPS平均值代表该查询图像的GPS位置(下图c)。

作者借用Google Street View Dataset建立了由成对街景和鸟瞰图像组成的新数据集,用于评估提出的算法框架。实验结果表明,该方法得到的地理定位精度优于其他方法,并且它能够推广到没见过的图像集上(未经训练的)。

啦啦啦!

如果你对本文感兴趣,想要下载完整文章进行阅读,可以关注【泡泡机器人SLAM】公众号。

回复关键字“CVIM”,即可获取本文下载链接。

泡泡机器人SLAM的原创内容均由泡泡机器人的成员花费大量心血制作而成,希望大家珍惜我们的劳动成果,转载请务必注明出自【泡泡机器人SLAM】微信公众号,否则侵权必究!同时,我们也欢迎各位转载到自己的朋友圈,让更多的人能进入到SLAM这个领域中,让我们共同为推进中国的SLAM事业而努力!

商业合作及转载请联系[email protected]