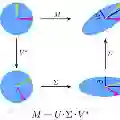

Partial Least Squares (PLS) learns shared structure from paired data via the top singular vectors of the empirical cross-covariance (PLS-SVD), but multimodal datasets often have missing entries in both views. We study PLS-SVD under independent entry-wise missing-completely-at-random masking in a proportional high-dimensional spiked model. After appropriate normalization, the masked cross-covariance behaves like a spiked rectangular random matrix whose effective signal strength is attenuated by $\sqrtρ$, where $ρ$ is the joint entry retention probability. As a result, PLS-SVD exhibits a sharp BBP-type phase transition: below a critical signal-to-noise threshold the leading singular vectors are asymptotically uninformative, while above it they achieve nontrivial alignment with the latent shared directions, with closed-form asymptotic overlap formulas. Simulations and semi-synthetic multimodal experiments corroborate the predicted phase diagram and recovery curves across aspect ratios, signal strengths, and missingness levels.

翻译:偏最小二乘法(PLS)通过经验互协方差矩阵(PLS-SVD)的顶部奇异向量从配对数据中学习共享结构,但多模态数据集通常在两个视图中均存在缺失条目。我们在比例高维尖峰模型下,研究了独立逐项完全随机缺失掩码下的PLS-SVD。经过适当归一化后,掩码互协方差矩阵的行为类似于一个有效信号强度被衰减$\sqrtρ$倍的尖峰矩形随机矩阵,其中$ρ$为联合条目保留概率。因此,PLS-SVD表现出尖锐的BBP型相变:低于临界信噪比阈值时,主导奇异向量渐近无信息;高于该阈值时,它们与潜在共享方向实现非平凡对齐,并具有闭式渐近重叠公式。模拟和半合成多模态实验验证了在不同纵横比、信号强度和缺失水平下的预测相图与恢复曲线。