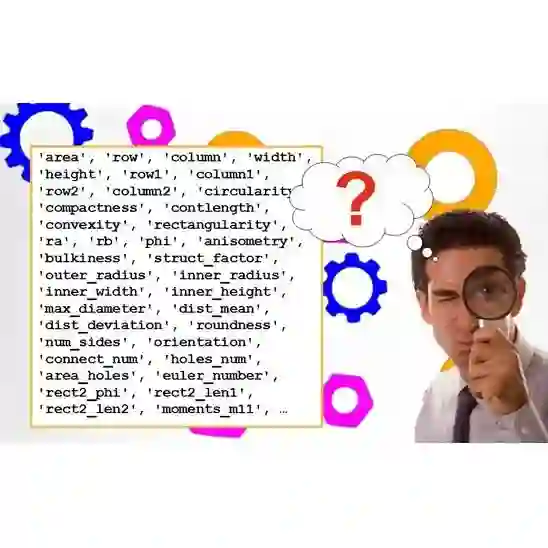

The perceived advantage of machine learning (ML) models is that they are flexible and can incorporate a large number of features. However, many of these are typically correlated or dependent, and incorporating all of them can hinder model stability and generalizability. In fact, it is desirable to do some form of feature screening and incorporate only the relevant features. The best approaches should involve subject-matter knowledge and information on causal relationships. This paper deals with an approach called Markov boundary (MB) that is related to causal discovery, using directed acyclic graphs to represent potential relationships and using statistical tests to determine the connections. An MB is the minimum set of features that guarantee that other potential predictors do not affect the target given the boundary while ensuring maximal predictive accuracy. Identifying the Markov boundary is straightforward under assumptions of Gaussianity on the features and linear relationships between them. But these assumptions are not satisfied in practice. This paper outlines common problems associated with identifying the Markov boundary in structured data when relationships are non-linear and the predictors are of mixed data type. We propose a multi-group forward-backward selection strategy that addresses these challenges and demonstrate its capabilities on simulated and real datasets.

翻译:机器学习(ML)模型公认的优势在于其灵活性,能够纳入大量特征。然而,这些特征通常存在相关性或依赖性,全部纳入可能损害模型的稳定性与泛化能力。实际上,进行某种形式的特征筛选并仅纳入相关特征是更为可取的。最佳方法应结合领域知识与因果关系信息。本文探讨一种称为马尔可夫边界(MB)的方法,该方法与因果发现相关,利用有向无环图表示潜在关系,并运用统计检验确定连接关系。马尔可夫边界是指在保证最大预测精度的前提下,能够确保给定该边界时其他潜在预测变量不影响目标变量的最小特征集合。在特征服从高斯分布且特征间呈线性关系的假设下,识别马尔可夫边界是直接的。但这些假设在实践中往往不成立。本文概述了在关系非线性且预测变量为混合数据类型时,结构化数据中识别马尔可夫边界面临的常见问题。我们提出一种多组前向-后向选择策略以应对这些挑战,并在模拟和真实数据集上验证了其有效性。