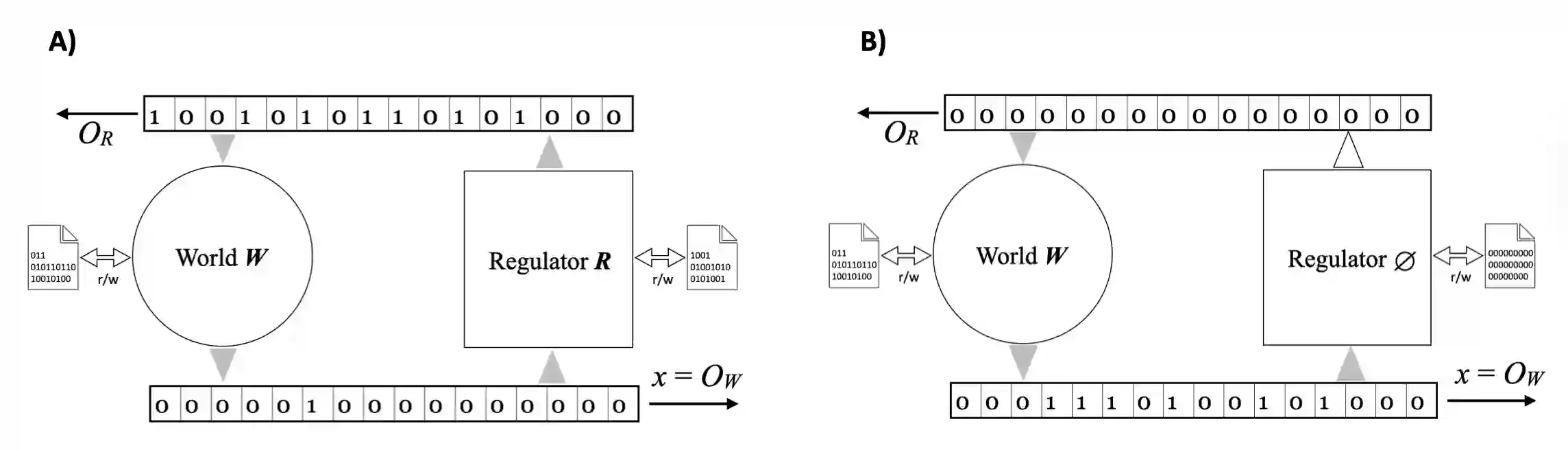

The regulator theorem states that, under certain conditions, any optimal controller must embody a model of the system it regulates, grounding the idea that controllers embed, explicitly or implicitly, internal models of the controlled. This principle underpins neuroscience and predictive brain theories like the Free-Energy Principle or Kolmogorov/Algorithmic Agent theory. However, the theorem is only proven in limited settings. Here, we treat the deterministic, closed, coupled world-regulator system $(W,R)$ as a single self-delimiting program $p$ via a constant-size wrapper that produces the world output string~$x$ fed to the regulator. We analyze regulation from the viewpoint of the algorithmic complexity of the output, $K(x)$. We define $R$ to be a \emph{good algorithmic regulator} if it \emph{reduces} the algorithmic complexity of the readout relative to a null (unregulated) baseline $\varnothing$, i.e., \[ \Delta = K\big(O_{W,\varnothing}\big) - K\big(O_{W,R}\big) > 0. \] We then prove that the larger $\Delta$ is, the more world-regulator pairs with high mutual algorithmic information are favored. More precisely, a complexity gap $\Delta > 0$ yields \[ \Pr\big((W,R)\mid x\big) \le C\,2^{\,M(W{:}R)}\,2^{-\Delta}, \] making low $M(W{:}R)$ exponentially unlikely as $\Delta$ grows. This is an AIT version of the idea that ``the regulator contains a model of the world.'' The framework is distribution-free, applies to individual sequences, and complements the Internal Model Principle. Beyond this necessity claim, the same coding-theorem calculus singles out a \emph{canonical scalar objective} and implicates a \emph{planner}. On the realized episode, a regulator behaves \emph{as if} it minimized the conditional description length of the readout.

翻译:调节器定理指出,在一定条件下,任何最优控制器都必须包含被调节系统的模型,这奠定了控制器显式或隐式地嵌入被控对象内部模型的思想基础。该原理支撑着神经科学和预测性大脑理论,如自由能原理或柯尔莫哥洛夫/算法智能体理论。然而,该定理仅在有限条件下得到证明。本文通过一个恒定大小的封装程序,将确定性的封闭耦合世界-调节器系统$(W,R)$视为单个自定界程序$p$,该程序产生输入调节器的世界输出字符串$x$。我们从输出的算法复杂性$K(x)$视角分析调节行为。若调节器$R$能相对于无调节基线$\varnothing$降低读数的算法复杂性,即满足\[ \Delta = K\big(O_{W,\varnothing}\big) - K\big(O_{W,R}\big) > 0 \],则定义其为\emph{优良算法调节器}。我们进而证明:$\Delta$越大,具有高互算法信息的世界-调节器对越受青睐。更精确地说,复杂性间隙$\Delta > 0$导致\[ \Pr\big((W,R)\mid x\big) \le C\,2^{\,M(W{:}R)}\,2^{-\Delta} \],使得低$M(W{:}R)$值随$\Delta$增长呈指数级不可信。这是“调节器包含世界模型”思想的算法信息论版本。该框架无需预设分布,适用于个体序列,并与内部模型原理形成互补。超越这一必要性论断,相同的编码定理演算导出了\emph{规范标量目标函数}并隐含了\emph{规划器}的存在。在已实现的交互过程中,调节器的行为\emph{如同}最小化了读数的条件描述长度。