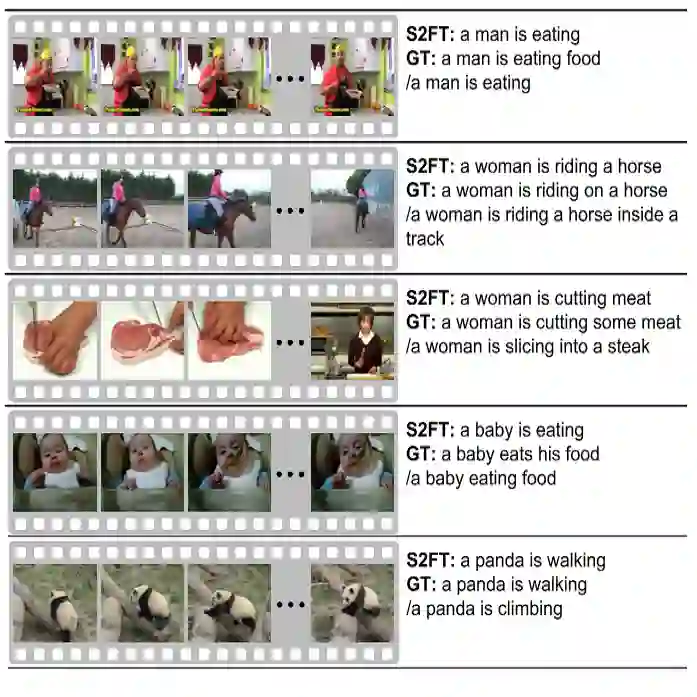

Tactical understanding in badminton involves interpreting not only individual actions but also how tactics are dynamically executed over time. In this paper, we propose \textbf{Shot2Tactic-Caption}, a novel framework for semantic and temporal multi-scale video captioning in badminton, capable of generating shot-level captions that describe individual actions and tactic-level captions that capture how these actions unfold over time within a tactical execution. We also introduce the Shot2Tactic-Caption Dataset, the first badminton captioning dataset containing 5,494 shot captions and 544 tactic captions. Shot2Tactic-Caption adopts a dual-branch design, with both branches including a visual encoder, a spatio-temporal Transformer encoder, and a Transformer-based decoder to generate shot and tactic captions. To support tactic captioning, we additionally introduce a Tactic Unit Detector that identifies valid tactic units, tactic types, and tactic states (e.g., Interrupt, Resume). For tactic captioning, we further incorporate a shot-wise prompt-guided mechanism, where the predicted tactic type and state are embedded as prompts and injected into the decoder via cross-attention. The shot-wise prompt-guided mechanism enables our system not only to describe successfully executed tactics but also to capture tactical executions that are temporarily interrupted and later resumed. Experimental results demonstrate the effectiveness of our framework in generating both shot and tactic captions. Ablation studies show that the ResNet50-based spatio-temporal encoder outperforms other variants, and that shot-wise prompt structuring leads to more coherent and accurate tactic captioning.

翻译:羽毛球比赛中的战术理解不仅涉及对单个动作的解读,还涉及战术如何随时间动态执行。本文提出\textbf{Shot2Tactic-Caption},一个用于羽毛球视频语义与时序多尺度描述的新颖框架。该框架能够生成描述单个动作的击球级描述,以及捕捉这些动作在战术执行过程中如何随时间展开的战术级描述。我们还引入了Shot2Tactic-Caption数据集,这是首个包含5,494条击球描述和544条战术描述的羽毛球视频描述数据集。Shot2Tactic-Caption采用双分支设计,两个分支均包含一个视觉编码器、一个时空Transformer编码器和一个基于Transformer的解码器,分别用于生成击球描述和战术描述。为了支持战术描述,我们额外引入了一个战术单元检测器,用于识别有效的战术单元、战术类型和战术状态(例如,中断、恢复)。对于战术描述,我们进一步融入了一个基于击球的提示引导机制,其中预测的战术类型和状态被嵌入为提示,并通过交叉注意力注入解码器。这种基于击球的提示引导机制使我们的系统不仅能够描述成功执行的战术,还能捕捉那些暂时中断后又恢复执行的战术过程。实验结果证明了我们的框架在生成击球和战术描述两方面的有效性。消融研究表明,基于ResNet50的时空编码器优于其他变体,并且基于击球的提示结构能产生更连贯、更准确的战术描述。