大语言模型(LLMs)在医疗考试类任务中展现出强劲性能,激发了学术界与工业界对其部署于真实临床环境的广泛兴趣。然而,临床决策本质上具有高安全性要求、上下文依赖性,且需在动态演进的证据支持下进行。在这些复杂场景中,大语言模型的可靠性并非仅取决于事实检索能力,更取决于稳健的医疗推理能力。 在本研究中,我们对基于大语言模型的医疗推理进行了全面的综述。立足于临床推理的认知理论,我们将医疗推理概念化为一个包含**溯因(Abduction)、演绎(Deduction)及归纳(Induction)**的迭代过程,并将现有方法归纳为涵盖“基于训练”与“免训练”方式的七大技术路线。此外,我们在统一的实验设置下,对具有代表性的医疗推理模型进行了跨基准评估,从而对现有方法的经验影响实现了更为系统化且具可比性的评价。 为了更好地评估基于临床实证的推理能力,我们推出了 MR-Bench,这是一个源自真实医院数据的基准测试集。在 MR-Bench 上的评估结果揭示了模型在考试级表现与真实临床决策任务准确率之间存在显著差距。总体而言,本综述为现有的医疗推理方法、基准测试及评估实践提供了统一的视角,并重点指出了当前模型性能与实际临床推理需求之间的关键缺口。 **代码地址:**https://github.com/RXH04-USTC/Medical-Reasoning-Survey 关键词: 临床决策;跨基准评估;大语言模型;医疗推理

1 引言

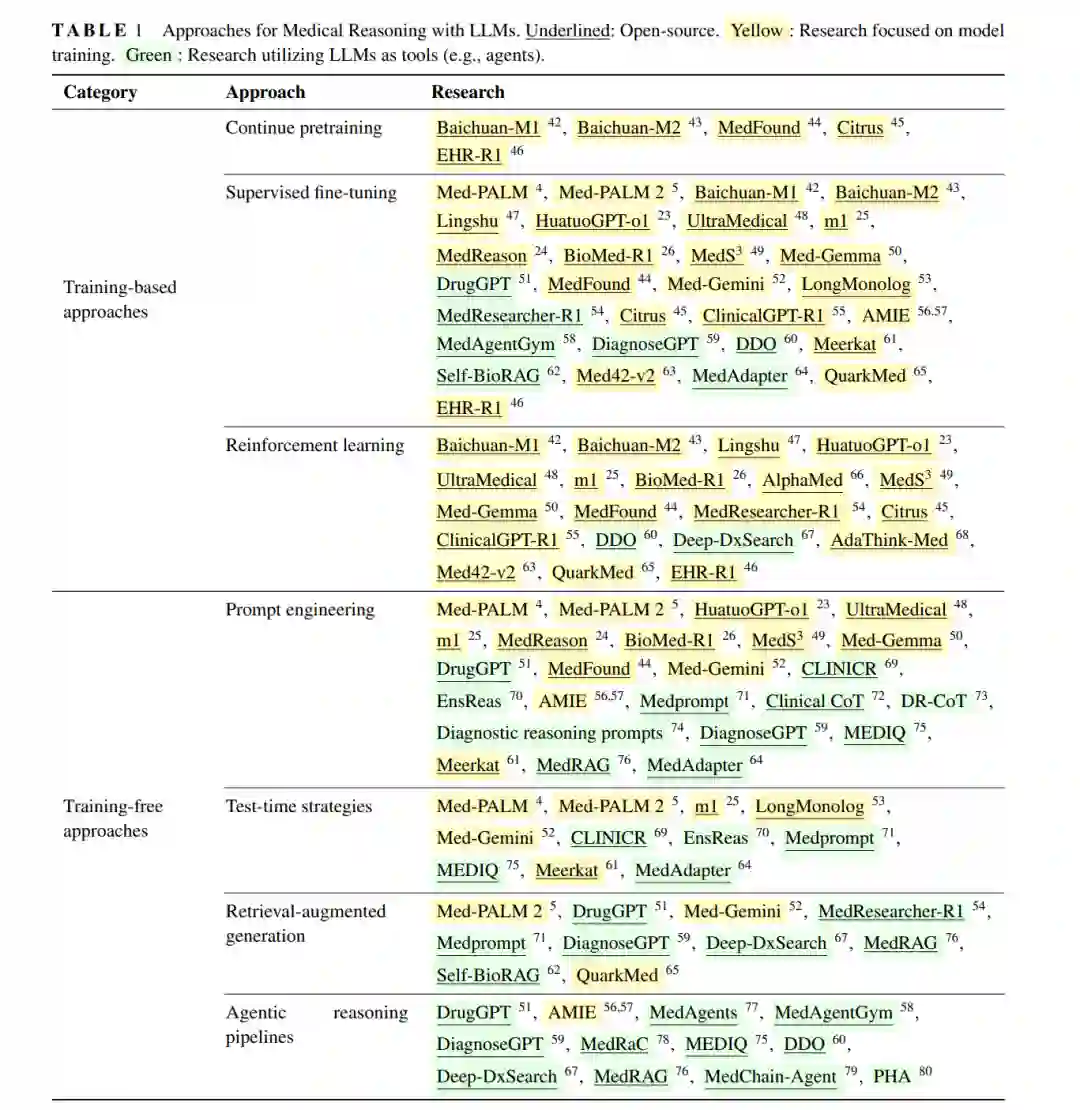

大语言模型(LLMs)的最新进展表明,通用基座模型在标准化医疗考试中已能达到及格甚至接近专家的水平 [1,2,3]。在此基础上,Med-PaLM 和 Med-PaLM 2 [4,5] 等领域专用医疗 LLMs 通过医疗特定数据微调与对齐,进一步强化了这一能力,在考试类基准测试(benchmarks)中表现优异。因此,LLMs 正日益广泛地部署于各类医疗工作流,包括电子病历摘要生成 [6]、自动化临床文档撰写 [7]、医患对话系统 [8] 以及初级临床决策支持 [9,10]。这些应用的广泛性与关键性不仅彰显了 LLMs 在医学领域的变革潜力,也对其可靠性与安全性提出了更高要求。因此,使 LLMs 在此类场景中安全有效地运行,是临床部署面临的核心挑战,直接关乎患者安全、临床责任归属以及医疗服务体系层面的信任 [11,12]。 然而,在静态且以考试为导向的评估中取得成功,并不意味着能可靠地转化为现实世界的医学实践 [1,2]。临床决策本质上是动态且安全敏感的,要求推理过程能够处理不完整且不断演进的证据、适应患者特定的上下文,并与持续更新的临床指南及社会约束保持一致。针对这一差距,实证研究表明,LLM 在涉及多步推理 [13]、因果推断 [14] 或显式不确定性管理 [3,15] 的任务中,性能会显著下降。在缺乏稳健医疗推理的情况下,这些局限性表现为临床不安全行为,包括幻觉出的临床细节、不当的泛化以及失准的置信度 [16,17]。因此,强大的医疗推理能力对于缓解此类风险、实现安全可靠的临床部署至关重要。 基于这一需求,我们提出了一个规范化框架,旨在指导 LLMs 医疗推理能力的发展。医疗推理是一个复杂的认知过程,涉及为临床决策进行的迭代信息采集、假设生成与证据综合 [18]。假说-演绎模型(Hypothetico-deductive model) [19] 将推理过程规范化为“溯因性假设生成、演绎性测试和归纳性验证”的循环。借鉴这一视角,我们将医疗推理划分为三个互补维度:医疗溯因(Medical Abduction),即根据初始临床发现生成合理的鉴别诊断 [20];医疗演绎(Medical Deduction),即通过预测预期表现或选择判别性检查来评估这些假设 [21];以及医疗归纳(Medical Induction),即综合积累的证据以确定最可能的诊断 [22]。 然而,目前基于 LLM 的方法在多大程度上接近了这一理想化的推理过程尚不明确。尽管 LLM 医疗推理受到了越来越多的关注,但现有技术及其评估仍处于碎片化状态。先前的研究 [23,24,25,26] 通常孤立地考察单一方法,且依赖不同的基准测试和实验设置,这使得评估不同方法之间性能提升的真实幅度和一致性变得十分困难 [27]。为了弥补这一空白,我们对基于 LLM 的医疗推理进行了结构化综述。我们将现有方法系统地组织为七大技术路线,并关键性地开展了全面的跨基准评估(cross-benchmark evaluation),以在统一且可复现的实验设置下量化其性能。通过在尽可能多的常用医疗基准上评估代表性方法,我们旨在为当前技术究竟能带来多少提升提供一个更清晰、更具可比性的全貌。此外,我们对现有基准进行了批判性分析,并引入了两个更具挑战性、更贴近临床实证的基准,以更好地探测现实世界的医疗推理。 具体而言,我们首先将现有方法分为两大范式:基于训练的方法,包括持续预训练 [28]、有监督微调 [29,30] 和强化学习 [31,32];以及免训练方法,涵盖提示工程 [33]、测试时推理策略 [34,35]、检索增强生成 [36] 和智能体推理流水线 [37]。 在方法论综述的基础上,我们分析了广泛采用的基准测试,并对代表性医疗推理模型进行了统一的跨基准评估,从而实现跨方法、跨设置的系统性比较。此外,我们进一步识别了流行基准测试的局限性。通过对 MedQA [38] 和 HealthBench [39] 等代表性基准的针对性分析,我们发现考试类问答(QA)基准往往缺乏临床必需的上下文,而基于判断器的开放式评估可能会引入受评价者影响的变数,从而偏离现实临床决策的约束。为解决这些问题,我们引入了 MR-Bench,这是一个源自真实医院数据的临床实证基准 [40,41],它将医疗推理具象化为具有安全敏感性的临床决策过程。实证结果显示,即使是先进的基座模型,在标准考试表现与真实临床任务准确率之间仍存在巨大差距,这突显了开发更符合临床实践的评估方式的必要性。 总之,虽然 LLMs 在医疗知识基准上取得了令人印象深刻的进展,但实现可靠且临床可用的医疗推理仍是一个开放性挑战。通过统一综述、跨基准评估以及临床实证基准的引入,本综述阐明了医疗推理 LLMs 的当前能力与持续存在的差距。展望未来,该领域的发展将需要向临床实证评估、主动及工具增强型推理,以及可靠且具备安全意识的决策支持转变。我们希望本工作能提供一个结构化的基础,引导未来研究开发出不仅强大,而且可验证、可交互且符合医疗实践的医疗推理系统。