包括大语言模型(LLMs)、多模态大语言模型(MLLMs)、图像生成模型(即文本生成图像模型及图像编辑模型)以及视频生成模型在内的基座模型,已成为在法律、医学、教育、金融及科学等诸多领域具有广泛应用前景的核心工具。随着这些模型在现实场景中的部署日益增加,确保其可靠性(Reliability)与负责任性(Responsibility)已成为学术界、工业界及政府部门关注的焦点。 本综述旨在探讨基座模型的可靠且负责任的发展路径。我们深入研究了若干关键问题,包括偏差与公平性、安全性与隐私、不确定性、可解释性以及分布偏移。此外,本研究还涵盖了模型的局限性(如幻觉问题),以及对齐(Alignment)和人工智能生成内容(AIGC)检测等技术方法。 针对每一研究领域,我们均回顾了其发展现状并概述了具体的未来研究方向。此外,本文还讨论了这些领域之间的交叉点,强调了它们内在的联系与共同挑战。我们希望本综述能推动基座模型向不仅强大,而且符合伦理、可信、可靠且具备社会责任感的方向发展。

- 引言 近年来,人工智能(AI)系统的构建范式发生了根本性转变,这一转变由双重使命驱动:既要开发日益强大且通用的基座模型(Foundation Models),又要构建本质上可靠且负责任的模型。这场变革的核心在于“基座模型”的兴起——即在海量且多样化数据集上进行预训练的大规模神经网络 [492]。这些模型的一个显著特征是其通用性:它们不再针对单一任务设计,而是作为一个“底座”,通过上下文学习(In-context learning)、有监督微调(Supervised fine-tuning)或强化学习(Reinforcement learning)等方法,适配广泛的下游应用 [100]。

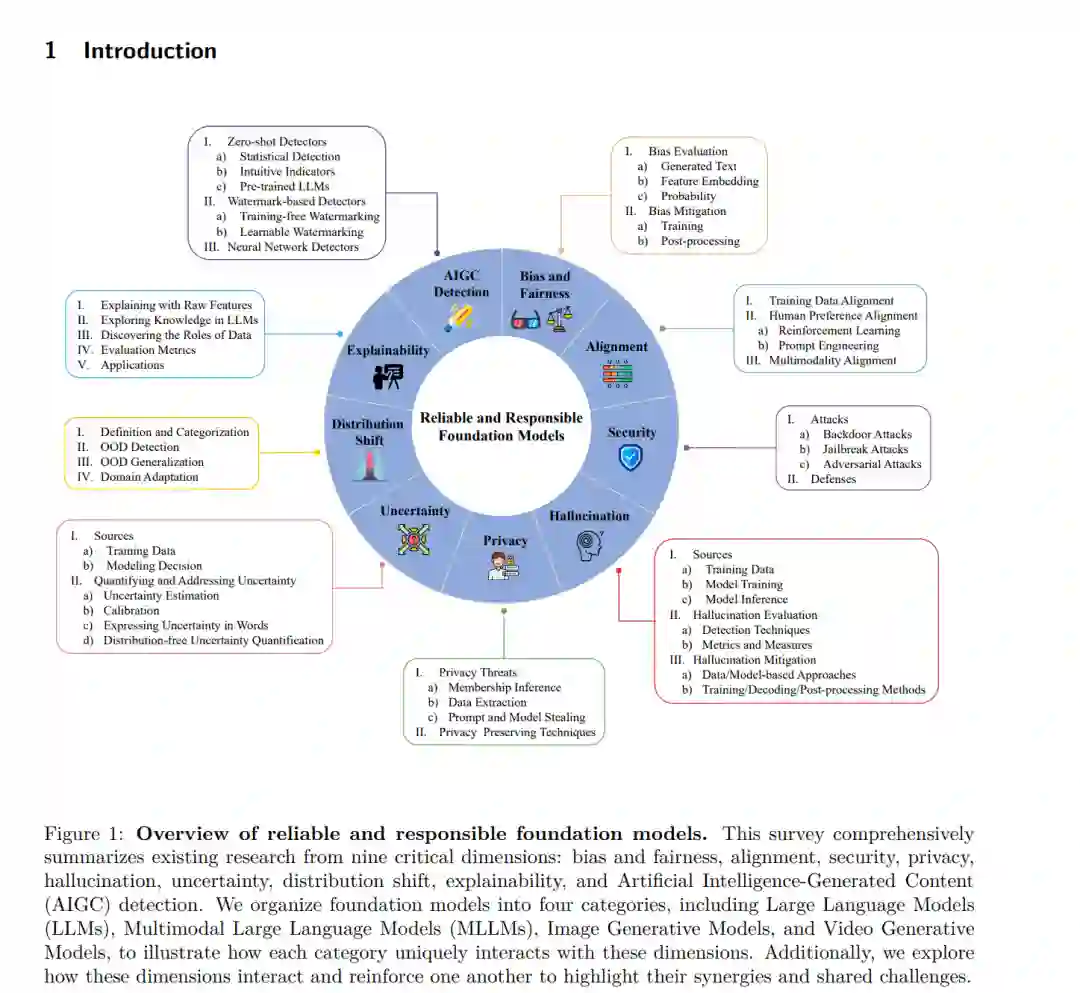

在这些基座模型中,有四类模型从根本上重塑了我们使用 AI 并与其交互的方式,包括:大语言模型(LLMs)、多模态大语言模型(MLLMs)、图像生成模型(即文生图模型与图像编辑模型)以及视频生成模型。这些模型展现了一系列强大的能力:LLMs 能够进行多轮对话和类人推理;MLLMs 能从手绘网页截图生成 HTML 代码;图像生成模型能根据文本指令合成并编辑写实图像;视频生成模型则能模拟物理世界的交互动力学与常识知识。

基座模型的诞生可追溯至大规模语言表示的发展,从早期的词嵌入技术(如 GloVE [717] 和 word2vec [655])演进到情境化表示(如 ELMo [719])。这一进展为基于 Transformer 的模型(如 BERT [221])铺平了道路,通过提供强大的表示能力来提升各种下游任务的性能,BERT 彻底改变了自然语言处理领域。随后,GPT 系列 [113, 740, 741] 自回归生成模型证明了通过“下一个标记预测(Next-token prediction)”进行的自监督学习可以产生高质量的文本生成模型。随着 ChatGPT [692] 的发布,基座模型的强大能力通过直观的对话式用户界面引起了主流社会的广泛关注。 如今,此类自回归生成模型已成为超越自然语言处理的既定范式,涵盖了诸如 GPT-4V(ision) [693]、GPT-4o [694]、Gemini 系列 [313]、Claude 3/4 [33, 36]、Qwen2.5/3 系列 [18, 20, 1044] 等多模态模型。与此同时,OpenAI o1 [696]、OpenAI o3/o4-mini [698]、DeepSeek R1 [209]、Claude 3.7 [35] 以及 Grok 3 [1019] 等模型通过增加测试时计算(Compute at test time)显著提升了推理能力。这些模型背后的核心创新是自注意力机制(Self-attention) [915],它通过允许每个标记对输入序列中的其他标记进行权重分配和信息聚合,从而构建情境化表示。与早期的循环模型 [193, 318] 相比,其固有的可并行性成为预训练阶段大规模扩张的关键催化剂,使得训练超大规模模型成为可能,从而开启了基座模型时代 [100]。 与此同时,该领域见证了生成式扩散模型(Generative Diffusion Models)的飞速发展,该类模型通过学习逆转受控的噪声注入过程来捕获底层数据分布。这一方法已成为高质量内容生成的领先范式,尤其在视觉生成任务中表现卓越 [365, 836]。其中,图像生成模型(如 DALL·E 3 [85]、Stable Diffusion 3.5 [261]、FLUX.1 [72] 等)能根据文本描述生成高分辨率图像。同样,视频生成领域的进步(由 Sora [697] 开辟,随后涌现出 HunyuanVideo [466]、Kling 2.5 [471]、Wan2.2 Video [931]、Veo 3 [312] 等)强调了对物理规律和常识推理的遵循。这些模型致力于生成真实的物理世界场景和以人为中心的内容,在空间分辨率和时间连贯性上取得了显著成就。 这些快速演进的模型所展现的强大能力,推动了其在经济领域的迅速融合 [200]。为了量化其广泛用途,ChatGPT 在不到三个月内达到了约 1 亿月活跃用户,而 DeepSeek-R1 仅用一个月就实现了同样的里程碑,使其成为历史上增长最快的消费级互联网应用 [14, 904]。如此规模的使用量及其产生的社会经济影响,凸显了确保这些模型既可靠又负责任的紧迫性 [324]。 在本综述中,我们对这些核心概念给出了明确定义: * 可靠性(Reliability):指模型准确、一致且稳健地履行其预期功能的能力,尤其是在分布偏移等挑战性条件下。 * 负责任性(Responsibility):指模型行为与伦理原则及社会价值观的对齐,涵盖公平性、隐私、安全性和透明度等关键维度。

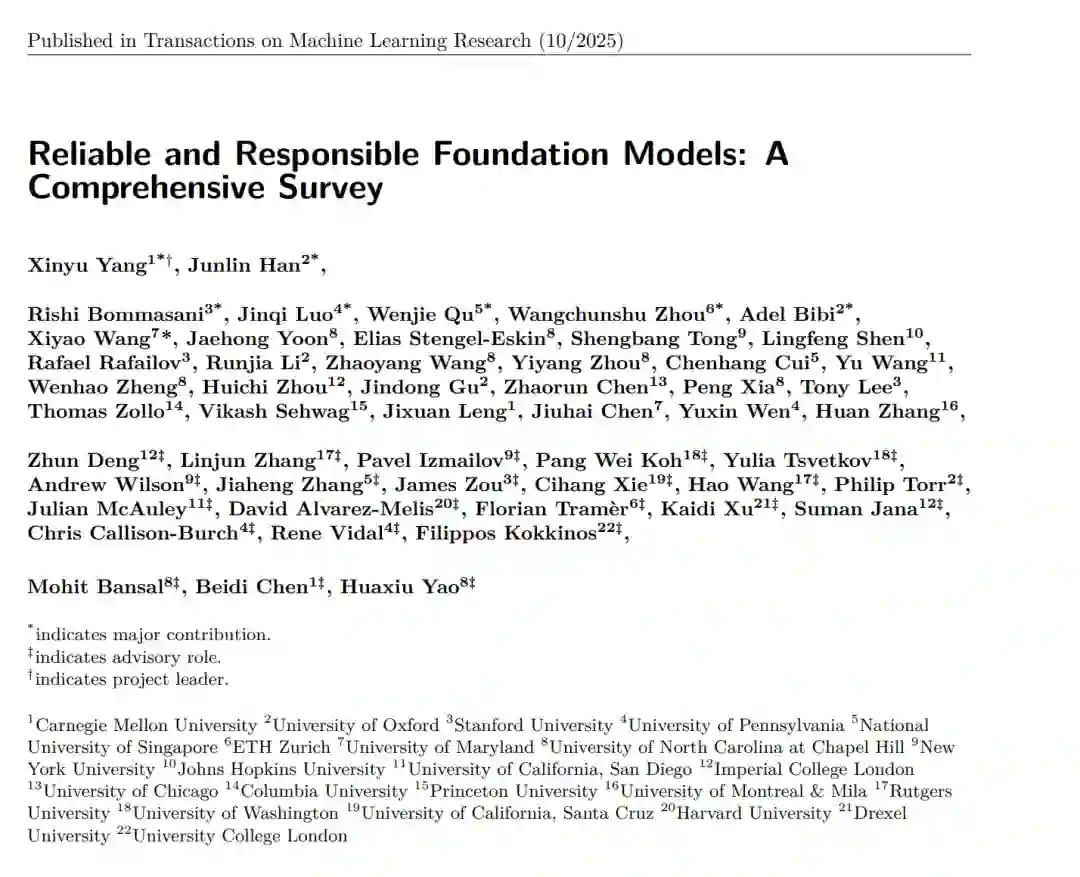

本综述旨在整合构建满足这两项关键标准的模型的技术挑战与解决方案。与以往侧重于特定问题(如幻觉 [390] 或安全 [620])的综述不同,我们的核心贡献在于提供了一种跨领域的综合分析,将四大类模型中的九个关键维度连接起来(见图 1 和图 2)。这种独特的视角揭示了各维度之间的内在联系与权衡(Trade-offs),提供了在专门性评论中常被忽视、但对推进可靠且负责任的 AI 至关重要的见解。此外,我们的范畴侧重于确保模型在开发者预期用途下表现可靠,关注其内在属性而非外部恶意滥用场景(如虚假信息、网络攻击等)。 本论文各章节预览如下: * 偏差与公平性:分析偏差来源、评估与缓解方法。 * 对齐(Alignment):探讨为何及如何使模型符合人类价值观。 * 安全性(Security):界定威胁并探讨安全部署措施。 * 数据隐私:在大规模数据采集过程中尊重隐私权。 * 幻觉(Hallucination):研究模型高置信度地陈述错误“事实”的现象。 * 不确定性(Uncertainty):探讨模型表达不确定性以防止误导性结果的必要性。 * 分布偏移(Distribution Shifts):确保模型在域外场景下的稳健性。 * 可解释性(Explainability):理解模型内部工作机制及其知识表示。 * AIGC 检测:辨析人类生成与 AI 生成内容的挑战及前沿方法。

本综述为可靠且负责任的基座模型发展现状提供了详尽回顾,为旨在以负责任的方式设计、部署和监管 AI 系统的研究者、从业者和政策制定者提供了宝贵见解。