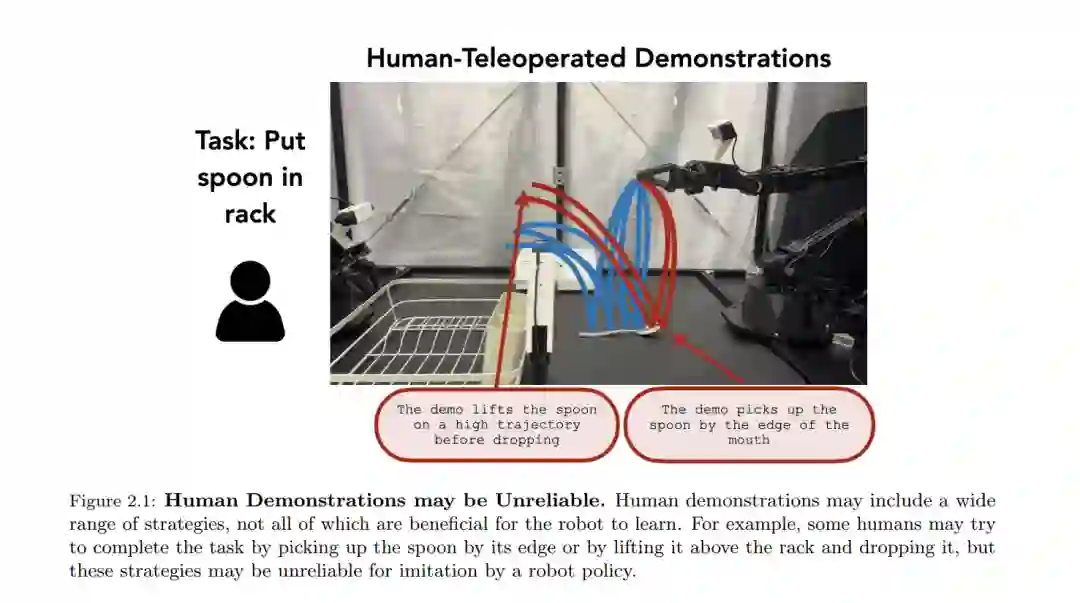

机器人学习领域长期以来的愿景是开发出能够在非结构化真实环境中进行稳健交互的通用智能体 (generalist agents)。尽管新兴的大规模模仿学习范式已赋予机器人广泛的基础能力,但这些系统在实际部署时往往表现出脆性。一个关键瓶颈在于对静态、预采集演示数据集的过度依赖,因为此类数据通常存在次优性 (suboptimal)、覆盖范围狭窄以及部署环境处于分布外 (out of distribution) 等问题。 本论文提出,若要实现更高的可靠性,必须超越静态演示数据集,将在线经验 (online experience)——即智能体与世界的直接交互——有效转化为自我提升与自适应的有信息信号。为了实现这一愿景,我们提出了一系列方法,旨在从在线经验中提取关键信号以增强策略的稳健性。 * 针对数据质量问题: 我们引入了一种利用在线策略展开 (online policy rollouts) 来实证评估演示质量的方法,从而能够过滤次优数据并筛选出高可靠性的训练数据。 * 针对覆盖范围不足: 我们提出了一种探索策略,通过引入源自当前策略与专家行为之间差异 (divergence) 的噪声,提升了强化学习的样本效率。 * 针对停滞 (idling) 故障模式: 我们开发了一个自我提升框架,当机器人陷入困境时通过施加扰动使其脱离,并利用由此产生的交互数据进行基于偏好的微调 (preference-based fine-tuning)。 * 针对部署时的实时适配: 我们探讨了智能体必须在无人工干预的情况下即时适应新场景的挑战。我们正式定义了单次生命周期部署 (single-life deployment) 设定,并引入了一种利用中间奖励塑形 (intermediate shaped rewards) 来平衡任务探索与恢复的方法。 * 针对快速自适应: 我们提出了一种利用学习到的价值估计 (value estimates) 在每个时间步对预训练行为进行调制的方法。 * 针对语义歧义: 我们使智能体能够利用视觉语言模型 (VLM) 对交互历史进行推理,从而从过往经验中推断出符合语境的策略。

综上所述,这些算法贡献表明,构建稳健的通用机器人策略,其最佳途径是闭合静态演示与策略经验之间的环路。