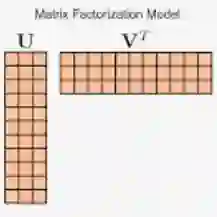

Poisson non-negative matrix factorization (NMF) is a widely used method to find interpretable "parts-based" decompositions of count data. While many variants of Poisson NMF exist, existing methods assume that the "parts" in the decomposition combine additively. This assumption may be natural in some settings, but not in others. Here we introduce Poisson NMF with the shifted-log link function to relax this assumption. The shifted-log link function has a single tuning parameter, and as this parameter varies the model changes from assuming that parts combine additively (i.e., standard Poisson NMF) to assuming that parts combine more multiplicatively. We provide an algorithm to fit this model by maximum likelihood, and also an approximation that substantially reduces computation time for large, sparse datasets (computations scale with the number of non-zero entries in the data matrix). We illustrate these new methods on a variety of real datasets. Our examples show how the choice of link function in Poisson NMF can substantively impact the results, and how in some settings the use of a shifted-log link function may improve interpretability compared with the standard, additive link.

翻译:泊松非负矩阵分解(NMF)是一种广泛应用于计数数据可解释"部件式"分解的方法。虽然存在多种泊松NMF变体,但现有方法均假设分解中的"部件"以加性方式组合。该假设在某些场景下可能成立,但在其他场景中则不然。本文引入具有平移对数连接函数的泊松NMF以放宽此假设。该连接函数包含单个调节参数,当参数变化时,模型将从假设部件加性组合(即标准泊松NMF)转变为假设部件更趋向乘性组合。我们提出了通过极大似然拟合该模型的算法,以及能显著降低大规模稀疏数据集计算时间的近似方法(计算复杂度与数据矩阵非零元素数量成比例)。我们在多种实际数据集上展示了这些新方法的应用。实例表明泊松NMF中连接函数的选择会对结果产生实质性影响,且在特定场景下,相较于标准加性连接函数,使用平移对数连接函数可提升结果的可解释性。