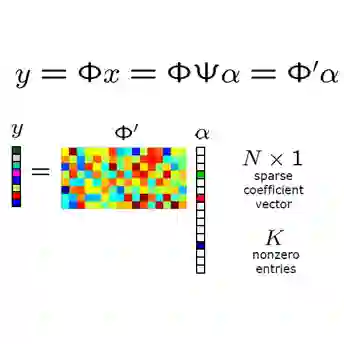

This paper addresses the unsourced/uncoordinated random access problem in an integrated sensing and communications (ISAC) system, with a focus on uplink multiple access code design. Recent theoretical advancements highlight that an ISAC system will be overwhelmed by the increasing number of active devices, driven by the growth of massive machine-type communication (mMTC). To meet the demands of future mMTC network, fundamental solutions are required that ensure robust capacity while maintaining favorable energy and spectral efficiency. One promising approach to support emerging massive connectivity is the development of systems based on the unsourced ISAC (UNISAC) framework. This paper proposes a spectrum-sharing compressive sensing-based UNISAC (SSCS-UNISAC) and offers insights into the practical design of UNISAC multiple access codes. In this framework, both communication signals (data transmission) and sensing signals (e.g., radar echoes) overlap within finite channel uses and are transmitted via the proposed UNISAC protocol. The proposed decoder exhibits robust performance, providing 20-30 dB capacity gains compared to conventional protocols such as TDMA and ALOHA. Numerical results validate the promising performance of the proposed scheme.

翻译:本文研究了集成感知与通信(ISAC)系统中的无源/非协调随机接入问题,重点关注上行多址接入码设计。近期理论进展表明,随着大规模机器类通信(mMTC)的发展,活跃设备数量的增长将使ISAC系统不堪重负。为满足未来mMTC网络的需求,需要从根本上构建在保证良好能量与频谱效率的同时维持鲁棒容量的解决方案。支持新兴海量连接的一种有效途径是基于无源ISAC(UNISAC)框架开发系统。本文提出一种基于频谱共享压缩感知的UNISAC(SSCS-UNISAC)方案,并对UNISAC多址接入码的实际设计提供了见解。在该框架中,通信信号(数据传输)与感知信号(如雷达回波)在有限信道使用时隙内重叠,并通过所提出的UNISAC协议进行传输。所设计的解码器展现出鲁棒性能,相较于TDMA、ALOHA等传统协议可获得20-30 dB的容量增益。数值结果验证了所提方案的优越性能。