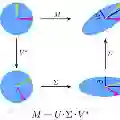

The Koopman operator provides a principled framework for analyzing nonlinear dynamical systems through linear operator theory. Recent advances in dynamic mode decomposition (DMD) have shown that trajectory data can be used to identify dominant modes of a system in a data-driven manner. Building on this idea, deep learning methods such as VAMPnet and DPNet have been proposed to learn the leading singular subspaces of the Koopman operator. However, these methods require backpropagation through potentially numerically unstable operations on empirical second moment matrices, such as singular value decomposition and matrix inversion, during objective computation, which can introduce biased gradient estimates and hinder scalability to large systems. In this work, we propose a scalable and conceptually simple method for learning the top-$k$ singular functions of the Koopman operator for stochastic dynamical systems based on the idea of low-rank approximation. Our approach eliminates the need for unstable linear-algebraic operations and integrates easily into modern deep learning pipelines. Empirical results demonstrate that the learned singular subspaces are both reliable and effective for downstream tasks such as eigen-analysis and multi-step prediction.

翻译:库普曼算子为通过线性算子理论分析非线性动力系统提供了一个原理性框架。动态模态分解(DMD)的最新进展表明,轨迹数据可用于以数据驱动的方式识别系统的主导模态。基于这一思想,诸如VAMPnet和DPNet等深度学习方法被提出来学习库普曼算子的主导奇异子空间。然而,这些方法在目标计算过程中,需要对经验二阶矩矩阵(如奇异值分解和矩阵求逆)进行可能数值不稳定的操作,并通过反向传播进行优化,这可能导致有偏的梯度估计,并阻碍其扩展到大型系统。在本工作中,我们基于低秩逼近的思想,提出了一种可扩展且概念简单的方法,用于学习随机动力系统库普曼算子的前$k$个奇异函数。我们的方法消除了对不稳定线性代数运算的需求,并能轻松集成到现代深度学习流程中。实证结果表明,学习到的奇异子空间对于下游任务(如特征分析和多步预测)既可靠又有效。