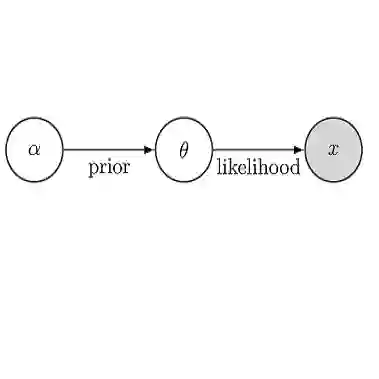

Robotic grasping in highly noisy environments presents complex challenges, especially with limited prior knowledge about the scene. In particular, identifying good grasping poses with Bayesian inference becomes difficult due to two reasons: i) generating data from uninformative priors proves to be inefficient, and ii) the posterior often entails a complex distribution defined on a Riemannian manifold. In this study, we explore the use of implicit representations to construct scene-dependent priors, thereby enabling the application of efficient simulation-based Bayesian inference algorithms for determining successful grasp poses in unstructured environments. Results from both simulation and physical benchmarks showcase the high success rate and promising potential of this approach.

翻译:在高噪声环境下的机器人抓取面临复杂挑战,尤其当场景先验知识有限时。其中,通过贝叶斯推理识别优质抓取姿态存在两大难点:其一,基于无信息先验生成数据的效率低下;其二,后验分布往往呈现定义在黎曼流形上的复杂分布。本研究探索利用隐式表示构建场景依赖先验,进而将高效的仿真驱动贝叶斯推理算法应用于非结构化环境中成功抓取姿态的确定。仿真与物理基准实验的结果均表明,该方法具有高成功率和良好的发展潜力。