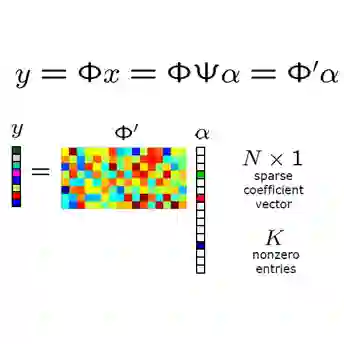

We study the fundamental problem of learning an unknown object from data using a prescribed model class. We introduce a unified framework that accommodates objects in arbitrary Hilbert spaces, general (possibly vector-valued) random linear measurements and general types of nonlinear models. We establish novel learning guarantees for this framework that explicitly relate the required amount of data to structural properties of the model class, yielding near-optimal generalization bounds. A central concept we introduce is the variation of a model class relative to a distribution of sampling operators, which quantifies how the model interacts with the measurement process. Combined with entropy integrals that capture the model's complexity, this forms the foundation of our guarantees. Our framework is sufficiently general to recover and unify various well-known problems, such as matrix sketching, compressed sensing with isotropic measurements and compressed sensing with generative models. In each case, existing results arise as direct corollaries of our theory. For compressed sensing with generative models, we also derive the first guarantees for arbitrary Lipschitz generative maps combined with general linear measurements. Overall, our work provides a unified perspective on learning from general data and introduces novel theoretical guarantees that consolidate, sharpen and extend existing results.

翻译:我们研究从数据中学习未知对象的基本问题,使用预设的模型类。我们引入了一个统一框架,该框架适用于任意希尔伯特空间中的对象、一般(可能为向量值)随机线性测量以及一般类型的非线性模型。我们为该框架建立了新颖的学习保证,明确地将所需的数据量与模型类的结构性质联系起来,从而得到近乎最优的泛化界。我们引入的一个核心概念是模型类相对于采样算子分布的变差,它量化了模型与测量过程的交互方式。结合捕捉模型复杂度的熵积分,这构成了我们保证的基础。我们的框架足够通用,能够恢复并统一各种众所周知的问题,例如矩阵草图、各向同性测量下的压缩感知以及生成模型下的压缩感知。在每种情况下,现有结果都作为我们理论的直接推论出现。对于生成模型下的压缩感知,我们还首次推导了任意Lipschitz生成映射与一般线性测量相结合时的保证。总体而言,我们的工作为从一般数据中学习提供了统一的视角,并引入了新颖的理论保证,这些保证巩固、强化并扩展了现有结果。