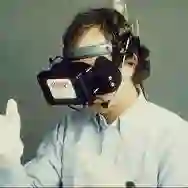

Prospective memory (PM), defining the currently conceived intention of a future action, is crucial for daily functioning, particularly in aging populations. This study develops and validates a virtual reality prospective memory training (VR-PMT) system that integrates visual imagery training (VIT) and virtual reality training (VRT) to enhance the PM abilities of users. The framework is designed to progressively challenge users by simulating real-life PM tasks in a controlled VR environment. The VIT component is designed to improve the generation and utilization of visual imagery by users, while the VRT component provides PM tasks based on time and event cues within a virtual environment.The framework was evaluated on ten healthy adults (university students and elderly participants) over nine weeks. During the initial session, the baseline PM abilities of the participants were assessed using the memory for intentions screening test (MIST). The subsequent sessions alternated between VIT and VRT with increasing task complexity. The MIST scores were significantly positively correlated with task achievement, confirming the efficacy of the system. Imagery abilities were also strongly correlated with task performance, underscoring the importance of visual imagery in PM training.Usability and user experiences, evaluated on the Jikaku-sho Shirabe questionnaire and the user experience questionnaire, indicated an overall positive user experience but higher fatigue levels in elderly participants. This study demonstrates that the VR--PMT system effectively trains and assesses PM abilities by integrating VIT and VRT, supporting its potential for broader applications in clinical settings.

翻译:前瞻记忆(PM)指对将来执行某项行动的预先构想意图,对日常功能至关重要,尤其在老年群体中。本研究开发并验证了一套整合视觉意象训练(VIT)与虚拟现实训练(VRT)的虚拟现实前瞻记忆训练(VR-PMT)系统,旨在提升用户的前瞻记忆能力。该框架通过在受控VR环境中模拟真实生活PM任务,逐步提升对用户的挑战难度。VIT模块旨在增强用户生成与运用视觉意象的能力,而VRT模块则在虚拟环境中提供基于时间线索和事件线索的PM任务。本研究对十名健康成年人(包含大学生与老年参与者)进行了为期九周的评估。在初始阶段,采用意图记忆筛查测试(MIST)评估参与者的基线PM能力。后续训练阶段交替进行VIT与VRT,并逐步提高任务复杂度。MIST得分与任务完成度呈显著正相关,证实了系统的有效性。意象能力亦与任务表现高度相关,凸显了视觉意象在PM训练中的重要性。通过《自觉所调问卷》与用户体验问卷评估的可用性及用户体验显示,用户整体体验积极,但老年参与者疲劳感较高。本研究表明,通过整合VIT与VRT,VR-PMT系统能有效训练与评估PM能力,为其在临床环境中更广泛的应用提供了支持。