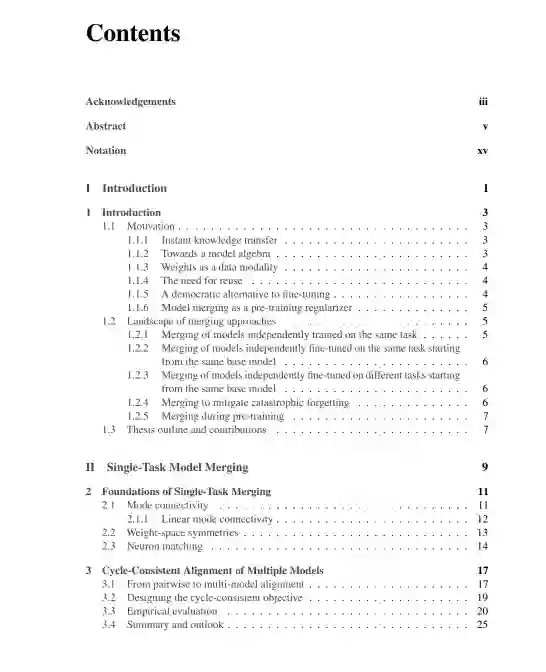

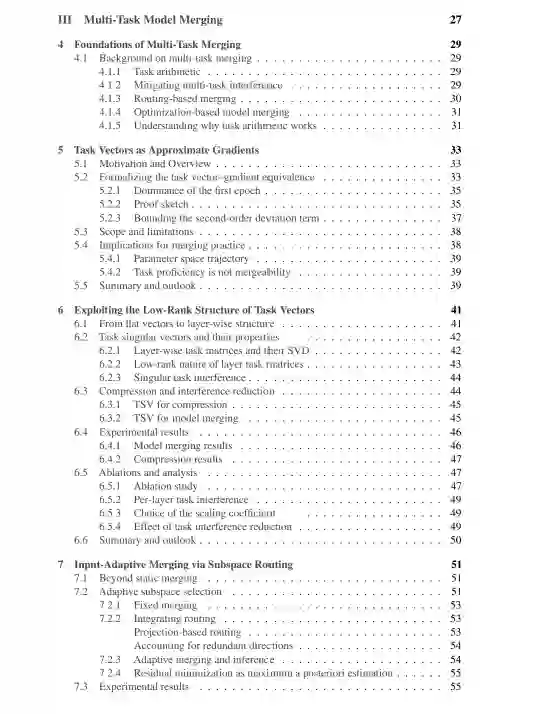

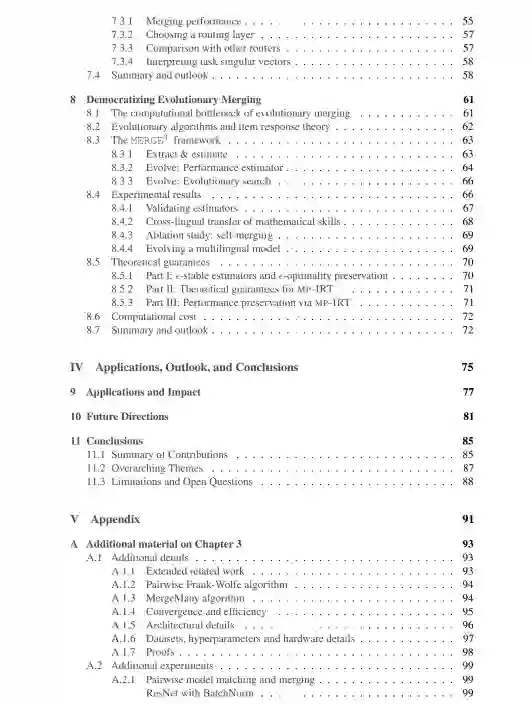

现代深度学习通常将模型视为独立的产物:它们被独立训练,针对特定用途进行特化,并在出现改进版本时被直接替换。本论文研究了一种替代范式——模型合并(Model Merging):即直接在权重空间内,将独立训练的多个神经网络合并为单一模型,且该过程无需访问额外的训练数据,亦仅需极少甚至无需进一步优化。 本论文围绕两种范式展开。在单任务场景(Single-task setting)下,模型共享共同的目标函数但初始化状态不同。为此,我们提出了 $C^2M^3$——一种基于 Frank-Wolfe 优化的循环一致性合并算法(Cycle-consistent merging algorithm)。$C^2M^3$ 将多个网络对齐到一个共享的参数空间,该空间作为一个无参考的聚合点,使得权值平均(Weight averaging)在无需指定任何特定模型作为锚点(Anchor)的情况下依然具有意义。 在多任务场景(Multi-task setting)下,模型针对不同的下游任务进行微调。我们首先对任务向量(Task vectors)(即微调模型与其预训练初始状态之间的参数差异)进行了理论阐释。我们证明,在标准假设下,任务向量具有基于梯度的解释性,从而阐明了任务算术(Task arithmetic)的成功原因及其局限性。这种梯度视角带来了一个直接结论:众所周知梯度表现出低秩结构,而任务向量继承了这一特性。我们通过任务奇异向量(Task Singular Vectors, TSV)对这种低秩结构进行了形式化定义与利用。这种分解技术支持模型压缩,并通过 TSV-Merge 减少任务干扰。随后,我们提出了 MASS——一种输入自适应路由机制,利用 TSV 几何结构引导推理流经任务相关的子空间。最后,我们引入了 MERGE³,这是一个演化合并框架,它结合了项目反应理论(Item Response Theory),在保持解质量的同时将评估成本降低了高达 50 倍。 综上所述,这些贡献为模型合并奠定了更坚实的理论与算法基础,推动了一种使学习到的能力能够在不同模型间进行组合、复用与扩展的新范式。