Abstract / 摘要

音视频智能(Audio-Visual Intelligence, AVI)已成为人工智能的核心前沿领域,通过桥接听觉与视觉模态,使机器能够在多模态真实世界中感知、生成和交互。在大基础模型时代,对音频与视觉进行联合建模——不仅用于理解,更用于可控生成和跨动态、时间锚定信号的推理——正变得日益关键。Meta MovieGen、Google Veo-3 等最新成果凸显了工业界与学术界对从海量多模态数据中学习的统一音视频架构的日益关注。然而,尽管进展迅速,已有文献仍呈碎片化状态,涵盖多样化的任务、不一致的分类法与异质的评估实践,阻碍了系统比较与知识整合。本综述首次从大基础模型的视角对音频-视觉智能进行全面回顾。我们建立了一个统一的分类法,涵盖音频-视觉智能任务的广阔图景:从理解(例如语音识别、声音定位)到生成(例如音频驱动视频合成、视频到音频),再到交互(例如对话、具身化或智能体接口)。我们综合了方法论基础,包括模态标记化、跨模态融合、自回归与扩散生成、大规模预训练、指令对齐和偏好优化。此外,我们整理了代表性的数据集、基准和评估指标,提供了跨任务家族的结构化比较,并识别了同步、空间推理、可控性和安全性等方面的开放挑战。通过将这一快速扩张的领域整合到一个连贯的框架中,本综述旨在为未来大规模音视频智能研究提供基础性参考。

1 Introduction / 引言

大基础模型通过扩展数据、算力和模型容量,解锁了广泛的通用性和涌现能力,彻底改变了人工智能[191, 239, 651]。人类的感知本质上是多模态的,而音频与视觉构成了理解、预测和控制真实世界环境中最普遍且最具互补性的感知模态[150, 268, 278, 639]。在社会各层面,这种音视频配对支撑着辅助技术、教育、机器人、娱乐和创意工具,在这些场景中,感知与生成越来越多地共存而非孤立出现。在大模型时代,进展因此依赖于统一音视频智能,以支持在时空约束下的稳健理解、可控生成和交互推理。Meta MovieGen[439]与Google Veo-3[120]等工业系统代表了向端到端音频-视觉建模与协同合成这一战略转变的典型示例,标志着技术成熟度与应用需求的同步增长。在此背景下,我们将论文贡献定位为整合大模型规模下音视频智能的概念、方法和趋势,为研究与部署奠定连贯的基础。

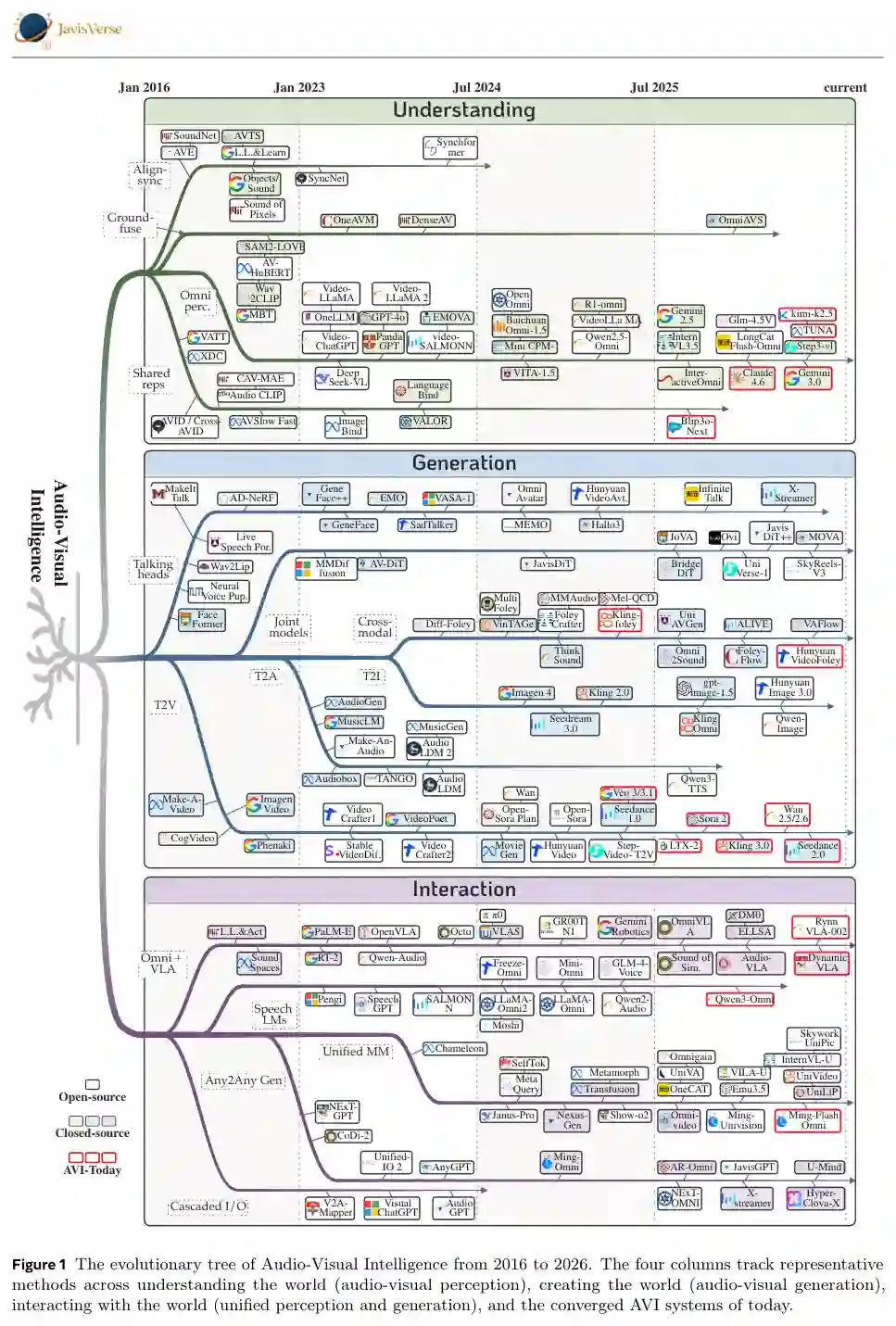

如图1所示,音视频智能跨越了一个广阔且快速演进的任务谱系,反映了自然环境中声音与视觉如何协同存在。在感知方面,代表性问题包括音视频语音识别[393]、唇读[498]、主动说话人检测[466]、声源定位与分离[536]、事件理解[413]、跨模态检索[204]和音视频问答[655],这些都依赖于模态间的同步与具身化。在生成方面,研究探索音频驱动的说话头[568]、视频条件语音或拟音[101]、与视觉节奏对齐的音乐生成[217]、配音与对齐[374]、跨模态编辑与风格化[156],以及具有长程连贯性的可控多模态叙事[719]。交互场景则进一步引入流式推理[630]、工具使用[667]和具身化[268],系统必须在尊重延迟和用户意图的同时,对时间纠缠的信号进行推理。总体而言,这些任务家族促使了对输入、目标和评估的统一形式化,以便在不同设置间公平比较方法。

在方法论上,音视频智能构建于模态特定的音频与视觉编码器或标记化器、跨模态融合与对齐,以及强大的生成解码器之上[75, 639]。自回归Transformer[49]驱动语音、音乐和视频令牌的序列建模,实现了大规模条件下的解码和指令跟随。扩散模型[215, 362]在高质量合成与灵活编辑方面表现突出,并已通过交叉注意力和引导机制逐步适应多模态控制。自监督目标(如对比对齐和掩码/去噪建模)仍然是表示学习的核心,而指令微调与偏好优化则为交互式音视频应用定制行为[177, 639]。缩放定律、数据混合与策展策略——涵盖语音语料库、音乐数据集、视频-音频对和合成管线——共同决定了能力与鲁棒性,也引发了关于覆盖度、偏见和许可的新问题[679]。

尽管取得了令人印象深刻的进展,已有文献在研究子社区间仍呈碎片化状态,存在重叠的定义、不一致的术语和分歧的分类法,阻碍了累积性理解。评估实践在数据集、指标和协议方面差异巨大,尤其是在开放式生成、对齐质量、时间一致性以及以人为中心的判断方面,这加剧了可复现性和基准测试的复杂性[55, 655]。安全与治理问题(如音视频中的隐私、语音与音乐的知情同意、水印与溯源,以及大模型训练的能耗足迹[87, 120])日益重要,但尚未得到均衡解决。这些差距凸显了进行一项全面的、分类法驱动的综述的必要性,以统一该领域,并为音视频智能研究和实践建立可操作的、可比较的标准。 论文配图说明:Figure 1(第4页)展示了从2016年到2026年音视频智能的进化树图,四列分别追踪了“理解世界(音视频感知)”、“创造世界(音视频生成)”、“与世界交互(统一感知与生成)”以及“今日汇聚的音视频系统”四个方面的代表性方法。Figure 2(第7页)是音视频智能的分类法。Figure 3(第8页)是音视频数据表示的概述。Figure 4(第10页)是音视频智能任务的概览图。

1.1 贡献总结

- 首次全面综述 本文在大基础模型范式下,首次对音视频智能进行系统、深入的综述,将感知、生成和交互研究统一在一个连贯的框架下。

- 统一分类法 建立了一个原则性的分类法,组织多样化的音视频任务(涵盖语音、音乐、声音事件、视频及开放世界理解、生成和交互),并阐明了任务范围、假设及子问题之间的关系。

- 核心方法论综合 整合了音视频智能的方法论基础,包括音频/视觉标记化、跨模态融合、自回归与扩散生成、指令对齐和大规模预训练策略。

- 基准与评估概述 整理了跨任务家族的数据集、基准和评估指标,识别了评估协议中的关键空白,并提出了促进公平和可重复比较的实用指南。

- 前沿与未来方向 突出了新兴研究挑战(如时间同步、空间音频推理、多模态可控性、安全、水印与治理),并概述了下一代音视频基础模型的有前途的路径。

- 资源共享 所有总结的资源、参考文献和组织结构将公开发布,以支持透明度和加速研究社区进展。

1.2 范围与组织

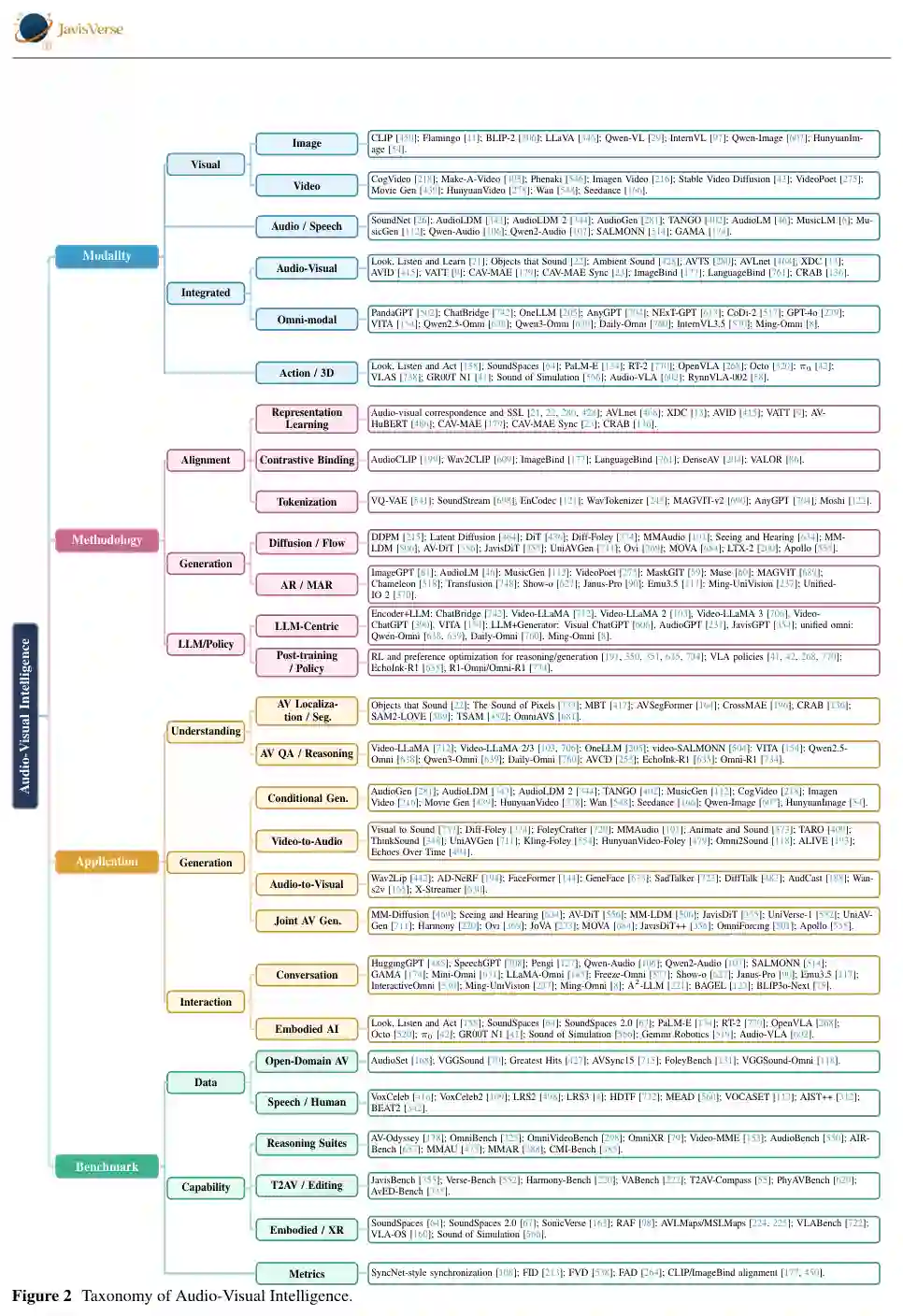

如图2分类法所示,在正式定义音频和视觉的数据模态(第2节)后,我们首先呈现音视频智能的原则性分类法(第3节),阐明任务家族的范围、假设、监督信号和关系,为深入具体内容提供全局地图。然后综合音视频智能的基础技术(第4节),涵盖标记化与表示、跨模态融合与对齐、自回归与扩散生成、训练目标、数据缩放与策展,以及交互式使用的指令对齐。在此基础上,我们沿着三大支柱组织文献:感知(第5节)、生成(第6节)和交互(第7节),对每个支柱回顾代表性方法、总结数据集和指标,并提供比较分析和提炼的要点。之后,我们介绍音视频智能的代表性应用(第8节),如数字人类与沉浸式体验,并突出管道中的相关方法。最后,讨论开放挑战和未来方向(第9节),包括同步与时间推理、空间音频与3D/4D基础、可控性与编辑、流式效率与延迟、开放式音视频生成的评估,以及大规模安全性、水印和数据治理。

2 Preliminary / 预备

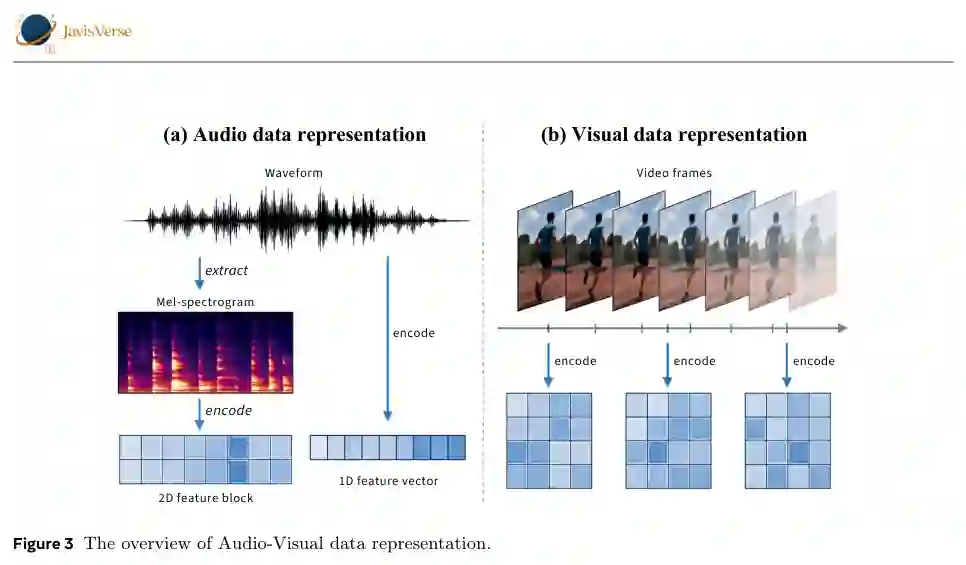

本综述的其余部分假定读者对“音频”和“视觉”的数字形式有清晰的理解:物理信号如何被采样,如何被转换为神经网络的张量或令牌,以及哪些单模态表示后续被输入跨模态和生成系统。我们因此首先独立定义每种模态,然后再引入融合、对齐或特定任务处理。图3总结了主要的数据形状和表示家族;以下子节分别精确阐述声音和图像/视频的这些概念,包括连续嵌入和离散标记化。

2.1 音频模态:数据与表示

音频模态源于物理振动以声波形式传播,可分为语音、音乐(包括乐器和人声)和一般声音事件(涵盖环境、城市、家庭声音或声效)。对于数字处理,这些模拟信号通过麦克风传感器振动捕获,并进一步采样生成1D时间序列数字信号,即波形。通常格式为单声道(1通道)或立体声(2通道),也存在多通道空间音频格式。 如图3所示,音频信号主要通过两种形式建模:原始波形和时频表示。单声道波形表示为1D时间序列(a \in \mathbb{R}^L),以固定速率采样;多声道音频可表示为(A \in \mathbb{R}^{C \times L})。或者,可通过短时傅里叶变换(STFT)将波形转换为频谱图,其幅度通常映射到Mel尺度并对数压缩,得到log-Mel频谱图(S \in \mathbb{R}^{T \times F})。这两种表示主导了多模态基础系统中音频编码器的输入[384]:

- 全局嵌入 将整个音频段编码为单个语义向量,捕获高层声学和语义特征[28, 219, 397]。形式上,编码器(f^g_\theta)将输入信号映射到d维嵌入:(z = f^g_\theta(x) \in \mathbb{R}^d)。

- 连续稠密表示 保留时间(和可选的频率)结构,生成潜在特征序列或图[83, 228]。设(\tilde{x})为音频输入表示(波形或时频变换,如log-Mel频谱(\tilde{x} \in \mathbb{R}^{F \times L}))。编码器(f_\theta)产生d维、下采样的稠密表示:(e = f_\theta(\tilde{x}) \in \mathbb{R}^{\frac{F}{s_f} \times \frac{L}{s_t} \times d}),其中(s_f)和(s_t)是频率和时间方向的下采样因子(对于1D波形特征,频率轴可视为(F=1))。

- 离散令牌表示 向量量化模型将音频离散化为令牌序列,实现语言模型风格的序列建模和生成[121, 245, 698]。使用学到的码本,标记化器(f^{VQ}\theta)将(\tilde{x})映射为m个令牌ID序列:(q = f^{VQ}\theta(\tilde{x}) \in \mathbb{N}^m)。

2.2 视觉模态:数据与表示

视觉数据通常指作为像素强度捕获的图像和视频。图像可视为3D场景在2D图像平面上的投影(如针孔相机模型),视频由一系列图像帧组成。形式上,3通道RGB彩色图像表示为矩阵(I \in \mathbb{R}^{H \times W \times 3}),其中H、W分别为高度和宽度。视频表示为有序帧序列(V = {I_1, I_2, \ldots, I_T} \in \mathbb{R}^{T \times H \times W \times 3}),通常以固定帧率(如30fps)播放,并在计算机视觉模型中作为4D张量存储和处理。 视觉数据包含多种形式,包括自然图像[471]、虚拟图像[253]、绘画[181]等。在音视频应用中,人类中心内容是一个关键子集,包括人体[253]、说话头[85]和唇同步视频[247]。除了2D图像,许多工作探索3D视觉表示,如深度图[407]、点云[195]、表面网格[262]、NeRF[161]和3D高斯溅射[147]。这些格式支持更丰富的几何和空间交互建模。 原始图像或视频数据是高维的,因此采用多种表示方法提取紧凑、信息丰富的特征:

- 全局嵌入 常见方法将整个图像(或视频帧)编码为单个全局特征向量,捕获语义内容[450]。卷积神经网络(CNN)[210]或视觉Transformer(ViT)[133]作为提取器(f^g_\theta),将每个图像映射到d维向量:(z = f^g_\theta(I) \in \mathbb{R}^d)。

- 连续稠密表示 另一种策略将图像映射到连续潜在空间,同时保留空间结构[133, 210]。形式上,编码器函数(f_\theta)将图像(I \in \mathbb{R}^{W \times H \times 3})映射到d维、s下采样的特征图或序列(e = f_\theta(I) \in \mathbb{R}^{\frac{W}{s} \times \frac{H}{s} \times d})。

- 离散令牌表示 VQ-VAE[541]等向量量化模型可进一步使用学到的码本离散化图像特征。每个图像表示为m个令牌ID序列,对应最近的码本条目:(q = f^{VQ}_\theta(I) \in \mathbb{N}^m)。

3 Task Taxonomy / 任务分类

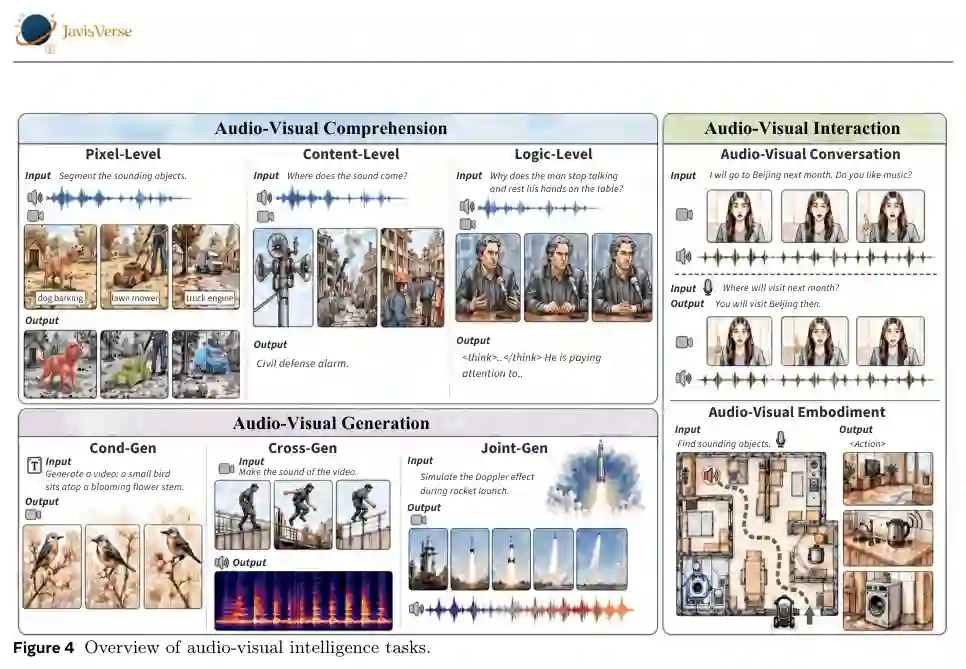

本节系统概述音视频智能中涉及的任务,涵盖三个关键维度:理解、生成和交互。如图4所示,这些维度勾勒出未来AGI发展的路线图。每个任务的具体细节将在第5、6和7节中讨论。

3.1 理解世界:音视频感知

感知是音视频智能的基础,使模型能够从原始听觉和视觉信号中感知和解释世界。本节沿三个逐渐递增的抽象层次呈现音视频感知任务的分类法:像素级感知、内容理解和逻辑推理。这些任务类别共同概述了构建通用音视频智能所需的感知和认知能力。

- 像素级感知 关注学习原始音频信号与视觉像素之间的直接对应关系,强调低层感知和对齐,是多模态感知的基础。代表性示例包括单模态任务如自动语音识别(ASR)[441]和视觉中的目标检测[771]或跟踪[375],以及跨模态任务如音视频事件定位[527]和分割[750],将声音与其空间视觉起源关联。像素级感知为声音源在视觉场景中的细粒度空间和时间基础。

- 内容理解 旨在从音视频输入中提取高层语义信息,包括对象、事件及其时间和因果关系。典型例子是音视频问答(AVQA),模型通过联合理解音频和视频内容来回答问题[299]。这些任务需要时间上对齐多模态线索并解释其语义交互。与像素级感知相比,内容理解在更高的抽象层次上操作,反映了模型理解多模态场景中发生了什么的能力。

- 逻辑推理 进一步扩展音视频理解,要求模型进行超越直接观察的推理,融入物理常识、因果关系或数学推理。模型需要从音视频证据中推断潜在原因或预测结果,例如物理音视频常识推理[691]。这些任务评估模型能否将感知与结构化推理相结合,以解释或预测多模态世界中的事件。

3.2 创造世界:音视频生成

音视频生成旨在通过建模视觉和听觉信号的联合分布,合成连贯且真实的多模态内容。与解释输入的理解任务不同,生成任务需要创建时间对齐、语义一致且感知真实的输出。本节将生成任务分为三种范式:条件生成、跨模态生成和联合音视频生成,分别代表构建世界创建多模态系统的渐进深度融合。

- 条件音视频生成 由外部控制信号(如文本、标签或结构化属性)引导产生输出,包括(1)条件音频生成:模型基于文本或音频上下文创建声音(如语音、声效)[313, 344];(2)条件视觉生成:模型基于文本、视觉线索或场景表示合成图像或视频[54, 548]。这些任务强调可控性和语义对齐,通过高层条件连接意图与输出。

- 音视频跨模态生成 以一种模态为条件合成另一种模态,需要细粒度的跨模态学习能力,包括(1)音频到视觉生成:如说话头合成或音频驱动化身[5, 165];(2)视频到音频生成:如从视觉输入生成配乐、语音或空间音频[101, 554]。这些任务要求音频-视觉模态之间的强时间对齐和因果基础。

- 音视频联合生成 建模声音和视觉在生成过程中的耦合演变,实现同步且因果一致的多模态输出。关键设置包括(1)文本/图像条件联合生成:从共享提示中同时生成两种模态[200, 355];(2)音视频编辑与扩展:在保持连贯性的同时修改现有多模态内容[156];(3)结构化/空间联合生成:如包含几何和空间音频的文本到3D音视频合成[661]。该范式追求整体场景演变和多模态一致性。

3.3 与世界交互:音视频统一感知与生成

音视频统一感知与生成将多模态理解与生成决策结合在交互式设置中。与孤立的感知或离线生成不同,这些系统必须解释正在进行的音视频输入,基于上下文或意图进行推理,并产生及时的多模态输出或行动。我们将此类系统分为两种范式:交互式音视频对话(数字世界)和交互式音视频具身化(物理世界)。

- 交互式音视频对话 涉及处理多模态输入并生成相应响应的对话系统,包括对话式编辑、指令跟随生成和多模态世界建模。根据输出模态,这些系统可分为:(1)音频中心:从多模态上下文产生语音响应[231];(2)视觉中心:在对话中生成或编辑图像/视频[123, 237];(3)全模态:在统一接口中支持灵活的输入输出模态[8, 354]。

- 交互式音视频具身化 扩展到物理环境,系统将多模态理解转化为行动。应用包括(1)音视频导航:利用感官线索引导移动[363, 663];(2)具身化问答与操作:智能体基于音视频输入进行推理和行动[602, 738]等。这些任务要求感知、推理和行动的紧密集成,将统一音视频模型定位为具身智能的关键推动者。

4 Foundation Techniques / 基础技术

本节介绍大基础模型时代发展的基础技术,为走向通用音视频智能提供关键技术路径,包括表示中心、生成中心和以大语言模型(LLM)为中心的方法。

4.1 表示中心方法

如图5所示,表示中心方法旨在将原始输入数据(包括图像像素、视频帧和音频波形)转换为连续嵌入或离散令牌,可被神经网络高效处理并支持相关AI应用。

# 4.1.1 音视频特征提取与表示

音视频表示学习利用未标记视频中视觉和听觉信号的自然同步性,学习跨模态语义而无需人工标注。现有方法主要依靠自监督目标、对比对齐、相关建模或任务导向的编码器设计学习共享的音视频嵌入。

- 自监督表示学习 利用跨模态同步作为监督信号学习联合表示。早期代理任务如音视频对应和时间同步鼓励模型预测跨模态对齐[21, 280],后续方法通过基于聚类的表示学习、对比目标和可扩展Transformer架构扩展了该思想[9, 13, 415]。近期工作进一步通过演化的自监督目标探索结构化表示分解为共享、唯一和协同的语音信息[731]。

- 多模态对比学习 通过最大化同步对之间的相似度同时分离共享嵌入空间中的不匹配样本来对齐音频和视觉模态。代表性方法包括跨模态语义迁移和多模态对齐框架[177, 609],以及改进的对比目标和序列对齐策略[229, 267, 533]。额外工作放宽严格同步假设或引入针对下游任务(如事件定位)的任务特定对比目标[36, 476]。

- 音视频相关建模 在表示架构内融入显式跨模态交互机制,捕获时间和空间依赖。示例包括基于瓶颈的跨模态注意力[417]、音视频分割的双向重建框架[207],以及容忍部分时间不对齐的训练策略[476]。

- 任务导向编码器 融入领域知识或任务特定监督,改进特定应用的表示学习。音频-视觉语音单元学习与掩码预测[486]和模态感知掩码自编码用于情感理解[617]是代表性示例。

# 4.1.2 音视频变分自编码与重建

在音视频智能中,变分自编码(VAE)为学习紧凑表示和实现跨模态重建提供了统一框架[271, 461]。如图5所示,VAE采用编码器-解码器架构,将音频或视觉输入映射到概率潜在空间,并通过从该空间采样的重建原始信号[461]。通过在潜在变量上施加结构化先验,VAE既支持表示学习也支持生成重建,使其成为音视频建模的基础技术[445]。 特别是,近期多模态VAE探索从同步音频和视觉输入学习联合潜在空间[445, 472]。通过将潜在变量结构化为共享和模态特定组件,这些模型在解耦模态不变语义和模态特定信息的同时支持跨模态重建[445, 472]。这种结构化潜在设计使VAE成为音视频设置中跨模态重建和生成的有用框架[472]。

# 4.1.3 音视频离散标记化

音视频离散标记化将连续声学和视觉信号转换为紧凑符号单元,为令牌基多模态模型提供常见离散令牌接口[541, 698]。通过将向量量化应用于学到的潜在空间,结构化信号被转换为适合自回归建模的令牌序列。 在音频方面,基于向量量化的编解码器如SoundStream[698]、EnCodec[121]和DAC[287]逐步改进重建质量,而WavTokenizer[245]降低令牌率。来自自监督模型(如HuBERT[219])的语义令牌捕获语言内容但省略细粒度声学细节,从而激发了包括X-Codec[672]、BiCodec[576]和Mimi[122]在内的混合设计。在视觉方面,离散潜在建模起源于VQ-VAE[541]和VQGAN[141],随后在码本可扩展性和效率方面取得改进,如MAGVIT-2[690]、VQGAN-LC[766]、SimVQ[768]和TokenFlow[446],并扩展到视频令牌化包括Divot[167]。 近期努力追求统一多模态标记化,其中共享或交错词汇支持跨模态推理和生成。SpeechGPT[708]、AnyGPT[704]和Moshi[122]是令牌级多模态建模的典型代表,突显了高效且语义良好的标记化器设计对音视频基础模型的重要性。

4.2 生成中心方法

生成中心方法支持单模态(T2I、T2V、T2A)和跨模态(A2V、V2A、T2AV)音视频任务的条件合成与编辑,语义连贯性和时间同步是关键要求。图6展示了几个主导生成范式。

# 4.2.1 生成对抗网络

生成对抗网络(GAN)通过生成器和判别器之间的对抗训练学习生成模型[182]。改进如DCGAN[449]、WGAN[24]和StyleGAN[261]在扩散模型[215, 464]兴起前显著推动了图像合成。GAN也曾被探索用于跨模态音视频生成[430],包括文本条件合成[458, 535]、神经音频生成[276, 286]和音频驱动视觉动画[290, 427, 442, 757]。 尽管有这些早期演示[34],扩散基生成器的进展使这些新范式在近期音视频生成研究中日益常见[44, 464, 654]。

# 4.2.2 扩散基生成

扩散模型通过学习从噪声到数据分布的去噪过程来生成数据[215, 497]。相关连续时间生成器如流匹配和修正流学习将噪声传输到数据的速度场[337, 362]。在架构上,扩散及相关连续时间模型已从卷积UNet[465]演变为扩散Transformer(DiT)[436],后者在数据和模型规模上更具可扩展性[142]。 基于这些基础,扩散及相关连续时间生成器推动了音视频和多模态生成的快速进展[654]。在图像和视频生成中,潜在扩散和修正流模型支持了最近的文本到图像[53, 54, 607]和文本到视频[166, 278, 328, 548]系统,实现了更高分辨率、更长时长和改进的时间一致性。对于音频生成,潜在扩散及相关连续时间模型已应用于语音[15]和声效[344]合成,通常在学到的潜在空间中操作。最近的音视频系统也探索了跨文本、音频和视觉输入的对齐潜在条件,用于音频条件视频合成[165]、视觉基础声音生成[101]和联合音视频生成[369]等任务。 扩散及相关连续时间模型已成为现代音视频生成的主导范式,相对早期的GAN方法提供了改进的稳定性和可扩展性[362, 654, 680]。

# 4.2.3 自回归生成

自回归(AR)生成器将数据分布建模为逐令牌预测序列,通过顺序解码实现生成。借助图像、音频和视频的离散标记化,多模态生成可表述为令牌流上的语言建模[121, 539–541, 698]。该范式启用令牌基生成器,包括用于图像/视频生成的VAR[524]、LlamaGen[507]、Emu3[575]/Emu3.5[117]和NOVA[124],以及用于音频和音乐生成的编解码器语言模型,包括AudioLM[46]、MusicLM[6]、MusicGen[112]、VALL-E 2[84]和CosyVoice 2[139]。 AR Transformer共享大语言模型[49]的下一个令牌预测接口,并可通过交错模态特定令牌流支持多模态提示,如系统VideoPoet[275]和V-AURA[545]所示,用于同步音视频生成。然而,顺序解码导致高采样延迟和长序列的误差累积,从而激发了更高效的替代方案,如掩码令牌生成(第4.2.4节)和扩散方法(第4.2.2节)。

# 4.2.4 掩码自回归生成

掩码自回归(MAR)生成,又称掩码-预测解码,用迭代掩码令牌预测取代严格顺序解码,从而在令牌子集上实现并行生成[171]。代表性系统包括用于图像的MaskGIT[59]和Muse[60],用于视频令牌的MAGVIT[377, 689, 690]、MaskViT[197]和Phenaki[546],以及用于并行音频编解码器生成的SoundStorm[47]。 与严格自回归解码相比,MAR可在离散视觉或音频令牌上实现更快的并行细化[314],但其性能通常取决于标记化质量和解码计划[314, 597]。

4.3 以LLM为中心的方法

随着生成式大语言模型(LLM)[2, 191]在语言理解和生成方面取得强劲表现,以LLM为中心的框架已成为音视频智能的一个突出方向,其中音频和视觉输入被转换为LLM可处理的表示,以激发多模态智能。

# 4.3.1 编码器+LLM用于多模态感知

- 定义 编码器+LLM系统将模态编码器(如视觉或音频)连接到预训练LLM骨干。编码的感官特征通过轻量级MLP或注意力基适配器投影到LLM嵌入空间,使语言模型能够解释和推理多模态输入。

- 分类与代表性系统 依模态意识分组。(1)视觉-LLM感知:从预训练编码器(如CLIP[450]、SigLIP[31, 703])投影视觉特征,通过适配器或交叉注意力模块连接LLM,如Flamingo[11]、BLIP-2[306]、MiniGPT风格系统[762]。视频理解扩展包括Video-ChatGPT[390]、Video-LLaVA[329]、Video-LLaMA[712]、Vitron[149]和LLaMA-VID[321]。近期模型通过更强的编码器和令牌压缩扩展感知,如Qwen2.5/3-VL[30, 31]、InternVL[96, 570]和长视频框架LongVA[720]、LongVU[484]。推理加速方法如FastV[78]进一步在推理时提高令牌效率。(2)音频-LLM感知:使用预训练声学模型(如HuBERT[219]、SpeechT5[20]、BEATs[83]、Whisper[451])编码波形,将输出投影到语言空间。代表性工作包括Pengi[127]、LLaSM[492]、GAMA[174]、SALMONN[514]和Qwen-Audio系列[106, 107]。(3)音频-视觉编码器-LLM集成:联合集成视觉和声学编码器与LLM的系统,如Video-LLaMA 2[103]、NExT-GPT[613]、OneLLM[205]、AnyGPT[704]和VITA[154]。相关全模态模型如GPT-4o[239]、Qwen2.5-Omni[638]、Ming-Omni[8]和Qwen3-Omni[639]进一步探索更紧密的联合训练和更广泛的多模态交互。

- 优势与挑战 编码器+LLM提供模块化框架,通过结合强预训练编码器与LLM推理实现灵活集成,训练需求有限。但间接特征投影可能限制细粒度跨模态对齐,高维令牌为长视频和连续音频流带来计算开销。

# 4.3.2 LLM+生成器用于多模态生成

- 定义 LLM+生成器将指令跟随LLM与外部模态生成器(如扩散模型或神经编解码器用于图像/视频/音频)耦合,通过解释和推理用户输入支持可控多模态合成与编辑,无需训练整体模型即可利用现成生成器和可选感知工具实现灵活的多模态生成。

- 分类与代表性系统 (1)提示/工具编排:LLM将用户意图转换为工具调用和提示,最小化学接口。Visual ChatGPT[606]组合多个视觉模型进行多步图像编辑和生成;AudioGPT[231]将请求路由到专用音频和说话头生成器,包括AudioLDM[343]。这些系统操作于相对固定的工具集,仍以生成器为中心。(2)学到桥接到生成器:引入可训练接口(适配器或可学习查询)连接LLM与下游生成器。NExT-GPT[613]和CoDi-2[517]将该设计扩展到多模态生成;JavisGPT[354]定位为统一音视频理解和生成;A2-LLM[221]聚焦于对话式音频-化身交互。独立模型如Qwen-Image[607]和UniVideo[599]也可用作即插即用的视觉渲染器。

- 优势与挑战 LLM+生成器通过解耦高层推理与模态特定生成提供强模块化,可重用SOTA音频和视觉生成器。但级联管道可能遭受接口不匹配、误差累积以及跨音频-视觉生成器维持时间同步的困难。

# 4.3.3 联合感知与生成的统一模型

- 定义 统一模型在单一端到端架构中执行多模态感知和生成,将模态标记化器和解码器集成到共享骨干的原生组件中。与级联的LLM+生成器管道相比,减少了接口不匹配和级联误差,同时实现更紧密的跨模态对齐和更低延迟的交互。

- 分类与代表性系统 根据主要建模目标分为三类。(1)全模态流式助手:目标实时多模态交互,紧密耦合感知与生成,支持原生语音输入输出,如GPT-4o[239]、Qwen2.5-Omni[638]、Mini-Omni[631]和InteractiveOmni[530]。最新包括Moshi[122](全双工语音-文本基础模型,通过Inner Monologue方法实现160ms理论延迟)和Qwen3-Omni[639](引入Thinker-Talker MoE架构,在2万亿令牌上联合多模态训练)。(2)统一令牌空间/交错多模态模型:在单一Transformer中建模混合模态令牌序列,实现交错文本-图像内容的统一理解和生成。代表性模型包括Emu[509]、DreamLLM[132]、Janus[608]、Chameleon[518]和Show-o[627]。最新进展包括Janus-Pro[90](将视觉编码解耦为SigLIP用于理解和VQ令牌化器用于生成)、BAGEL[123](MoT架构展示涌现组合推理)、Emu3[575](通过纯下一个令牌预测统一图像和视频理解与生成)和Transfusion[748](在单一Transformer中结合自回归和扩散目标)。(3)统一音视频生成器:通过紧密耦合的多模态生成框架支持带有同步音频的联合视频生成或编辑。代表性示例包括VideoPoet[275](自回归音视频生成)、JavisGPT[354](统一音视频理解与生成)和Object-AVEdit[156](对象级音视频编辑)。总体而言,音视频联合建模仍处于早期阶段,音频和视频建模均在积极探索中。

- 优势与挑战 优势包括更低的端到端延迟、更一致的跨模态对齐和模块间更少的脆弱接口。关键挑战包括:异构音频(语音/音乐/声效)的稳定通用标记化、视频的长上下文时间建模、流式内存和中断处理,以及开放式多模态输出的评估协议。

# 4.3.4 用于交互式感知与生成的智能体系统

- 定义 智能体系统将(多模态)LLM视为规划器,将用户请求分解为多步行动,并与外部工具交互以进行感知和生成。与第4.3.2节中的固定级联管道不同,它们动态选择工具、迭代中间结果并维护任务状态,从而实现对复杂多模态任务(如音视频工作流)的自适应控制。

- 分类与代表性系统 (1)通用工具路由智能体:使用LLM规划任务并将请求分发到异构模型枢纽或API。代表性示例HuggingGPT[485]展示了跨多样模型的大规模工具选择和编排。(2)感知中心视频智能体:近期工作探索用于长视界视频理解的交互式智能体,模型迭代查询感知工具并基于中间观察更新推理,如DoraemonGPT[665]和VCA[664]。(3)生成导向创意智能体:其他系统专注于通过多步编辑和生成工作流进行结构化媒体创作,如视频创作智能体V-Stylist[697]和Preacher[352],以及音频聚焦框架Audio-Agent[595]和AudioToolAgent[604]。

- 优势与挑战 智能体系统通过将复杂任务分解为模块化工具执行和迭代推理步骤,支持灵活的多模态工作流,支持长视界交互、异构工具集成和自适应细化。但可靠的工具基础、状态管理和误差传播仍是主要挑战,尤其是在协调音视频管道中的多个感知和生成模块时。

# 4.3.5 用于具身交互的视觉-语言-动作模型

- 定义 视觉-语言-动作(VLA)模型通过纳入动作空间并与物理环境交互来扩展LLM,使智能体能够闭合感知-推理-行动循环。典型VLA系统接收多模态观察(如图像、音频和语言指令)并输出动作或策略,可以是离散导航命令或连续机器人控制信号。

- 分类与代表性系统 (1)语言条件策略模型:RT-2[770]通过联合预训练视觉-语言模型在机器人轨迹和互联网规模视觉-语言数据上建立现代VLA范式,将动作表示为与语言表示对齐的令牌序列。后续扩展如RT-H[37]引入分层策略分离高层规划与低层控制;RT-Trajectory[187]使用事后轨迹草稿改进任务泛化。(2)开源可扩展VLA:OpenVLA[268]证明大规模多模态预训练与机器人演示数据集结合可产生跨任务和具身化的强泛化。其他高效设计如TinyVLA[603]和SmolVLA[493]针对轻量级部署;大型工业系统如GR00T-N1[41]和Gemini Robotics[519]将VLA概念扩展到全身机器人控制。(3)扩散与规划基VLA策略:探索生成策略表示和结构化规划的若干工作,包括流匹配策略π0[42]、开源通用策略Octo[520]、统一感知-动作模型GraspVLA[125],以及融合轨迹推理或模块化动作头的架构如TraceVLA[745]、CogACT[311]和CogVLA[315]。近期工作也探索鲁棒性和故障恢复,如FailSafe[336],以及世界模型集成如RynnVLA-002[58]。

- 优势与挑战 VLA模型使具身智能体能够在统一多模态框架中集成感知、推理和行动,受益于大规模视觉-语言预训练和语言条件规划。但长视界规划、跨具身化迁移和动态环境中鲁棒执行的挑战依然存在。提高数据效率、安全性和跨机器人平台的泛化仍是现实世界具身部署的关键。

5 Audio-Visual Perception / 音视频感知

音视频系统中的感知始于从原始信号中可读取的内容,进而探讨信号在上下文中的含义,最后分析事件之间如何及时、为何相关;图8示意了这种递进。本节沿三个层次组织:首先从每个模态及联合设置中的像素/样本级结构开始,然后处理语义内容理解,最后涵盖超越单步识别的推理。我们区分单模态预览材料(简要定义和指针)与音频-视觉问题(跨模态对齐、数据和基准得到更深入发展),以适应第3节概述的调查范围。

5.1 音频-视觉像素感知

像素级感知关注声音中的时频结构、图像和视频中的空间布局,以及跨模态的精确空间-时间锚定。

# 5.1.1 音频感知

音频感知包括自动语音识别(ASR)、音乐信息检索、声音事件检测与分类等任务。这些任务将原始波形或频谱图转换为高层语义标签。代表性数据集包括AudioSet[168]、VGGSound[70]等;评估指标包括词错误率(WER)、分类准确率等。

# 5.1.2 视觉感知

视觉感知包括目标检测、语义分割、实例分割、人体姿态估计、3D场景理解等。这些任务从像素数组中提取空间结构和语义内容。代表性方法包括Faster R-CNN[771]、Mask R-CNN[375]、ViT[133]等。数据集包括ImageNet[471]、COCO[253]等。

# 5.1.3 音视频事件定位/接地

音视频事件定位旨在从视频流中识别出由特定声音引发的视觉事件,并将音频事件与视觉区域或时间段精确关联。代表性方法包括AVTS[280]、CRAB[136]等。任务要求在时间或空间上对齐音频和视觉信号。

# 5.1.4 音视频分割

音视频分割任务在视觉帧中分割出发声对象或区域的像素级掩码。典型方法包括Sound of Pixels[733]、AVSegFormer[164]、SAM2-LOVE[589]和OmniAVS[681]。数据集如Greatest Hits[427]包含声源掩码标注。

# 5.1.5 音视频同步

音视频同步任务判断音频和视觉流是否在时间上匹配,或估计其对齐偏移量。常用方法基于SyncNet[108]架构,扩展到自监督学习(CAV-MAE Sync[23])。数据集包括AVSync15[715]等。

5.2 音频-视觉内容理解

内容理解阶段从音频-视觉输入中提取高层语义信息,包括对象、事件及其时间与因果关系。典型任务包括音视频问答(AVQA),模型需要联合理解音频和视频内容来回答问题。内容理解比像素级感知操作在更高的抽象层级上,反映了模型理解多模态场景中发生了什么的能力。

# 5.2.1 音频理解

音频理解扩展了音频感知,包括音频场景分类、情绪识别、说话人识别等。代表性系统如Qwen-Audio[106]、Qwen2-Audio[107]等,将音频编码为LLM可处理的表示,支持复杂语义理解。

# 5.2.2 视觉理解

视觉理解包括图像/视频描述、视觉关系检测、场景图生成等。VLM系统(如LLaVA[346]、InternVL[96])通过视觉编码器+LLM架构实现。

# 5.2.3 音视频问答

音视频问答(AVQA)要求模型基于同时提供的音频和视觉内容回答问题。代表性数据集包括AVQA[655]、Music-AVQA[299]等。模型需对齐多模态线索并推理语义交互。

# 5.2.4 音视频跨模态检索

跨模态检索旨在使用一种模态的查询检索另一种模态的内容,如用音频查询检索视频片段,或反之。代表性方法包括ImageBind[177]、LanguageBind[761]、DenseAV[204]等,通过对比学习将两种模态对齐到共享嵌入空间。

5.3 音频-视觉逻辑推理

逻辑推理拓展了音视频理解,要求模型进行超越直接观察的推理,融入物理常识、因果关系或数学推理。模型需要从音视频证据中推断潜在原因或预测结果,例如物理音视频常识推理[691]。该任务评估模型能否将感知与结构化推理相结合,以解释或预测多模态世界中的事件。

# 5.3.1 音频推理

音频推理要求模型从音频输入中进行逻辑推断,如推断事件因果关系、空间方位或时间顺序。代表模型包括SALMONN[514]等,具备音频逻辑推理能力。

# 5.3.2 视觉推理

视觉推理包括视觉常识推理、视觉问答中的关系推理、物理场景推理等。VLM系统(如InternVL系列、Qwen-VL系列)具备视觉推理能力。

# 5.3.3 音视频推理

音视频推理联合两种模态进行结构化推理,如推理“为什么狗叫是因为汽车经过”。代表性基准包括OmniBench[325]、OmniVideoBench[298]、AIR-Bench[657]等。模型需整合音视频线索,输出因果解释或预测。

6 Audio-Visual Generation / 音视频生成

音视频生成旨在通过建模视觉和听觉信号的联合分布,合成连贯且真实的多模态内容。本节组织为条件生成、跨模态生成和联合生成,对应第3.2节的分类。

6.1 条件音频/视觉生成

# 6.1.1 条件音频生成

条件音频生成基于文本、标签或音频上下文创建声音。代表性方法包括AudioGen[281]、AudioLDM[343]、AudioLDM 2[344]、TANGO[402]、MusicGen[112]等。系统通常采用扩散或自回归架构,从文本描述生成语音、音乐或声效。评估指标包括FAD[264]、CLAP Score等。

# 6.1.2 条件视觉生成

条件视觉生成基于文本、图像或视频线索合成图像或视频。代表性文本到图像系统包括Qwen-Image[607]、HunyuanImage[54];文本到视频系统包括CogVideo[218]、Make-A-Video[495]、Movie Gen[439]、HunyuanVideo[278]、Wan[548]、Seedance[166]等。评估指标包括FID[213]、FVD[538]等。

6.2 音频-视觉跨模态生成

# 6.2.1 视频到音频生成

视频到音频生成从视觉输入生成配乐、语音或空间音频,要求强时间对齐与因果基础。代表性方法包括Diff-Foley[374]、FoleyCrafter[729]、MMAudio[101]、ThinkSound[348]、UniAVGen[711]、Kling-Foley[554]、HunyuanVideo-Foley[479]等。数据集如FoleyBench[131]提供标注。评估包括同步质量(SyncNet-style)和音频质量(FAD)。

# 6.2.2 音频到视频生成

音频到视频生成从音频线索合成视觉内容,如说话头合成(Wav2Lip[442]、AD-NeRF[194]、SadTalker[723]、Wan2sv[165])和音频驱动化身(X-Streamer[630])。要求音频与唇形、面部表情的精确同步。

# 6.2.3 音频同步图像动画

音频同步图像动画将静态图像与音频对齐生成动画,如基于NeRF或扩散模型的头部动画(EMO[5]、VASA-1[165]、Hallo3[165])。

# 6.2.4 音频驱动3D视觉生成

音频驱动3D视觉生成从音频输入合成3D场景或人物,如语音驱动3D面部动画(VOCASET[113])。

6.3 联合音视频生成

# 6.3.1 文本到音视频生成

文本到音视频生成从共享文本提示同步生成音频和视频。代表性方法包括MM-Diffusion[469]、Seeing and Hearing[634]、AV-DiT[556]、MM-LDM[506]、JavisDiT[355]、UniVerse-1[552]、Ovi[369]、Jova[233]、MOVA[684]、Apollo[555]等。评估需同步质量和整体感知质量。基准如JavisBench[355]、Verse-Bench[552]、Harmony-Bench[220]。

# 6.3.2 图像到音视频生成

从输入图像+文本提示联合生成音视频,如UniAVGen[711]等。

# 6.3.3 联合音视频编辑

联合编辑既有的音视频内容,保持多模态一致性。代表工作Object-AVEdit[156]。基准如AvED-Bench[335]。

7 Audio-Visual Interaction / 音视频交互

音视频统一感知与生成结合多模态理解与生成决策于交互式场景。本节涵盖交互式对话和具身化智能体。

7.1 交互式音视频对话

# 7.1.1 音频驱动对话

音频驱动对话系统以多模态上下文生成语音响应,如SpeechGPT[708]、Qwen-Audio[106]、SALMONN[514]、Mini-Omni[631]、LLaMA-Omni[145]等。支持端到端语音理解和生成。

# 7.1.2 统一视觉理解与生成

在对话中同时理解和生成视觉内容,如Show-o[627]、Janus-Pro[90]、Emu3.5[117]、Ming-UniVision[237]等。这些模型统一了文本、图像令牌的架构,实现交互式编辑和生成。

# 7.1.3 全模态音视频对话

支持灵活的输入输出模态组合的统一系统,如GPT-4o[239]、Qwen2.5-Omni[638]、Qwen3-Omni[639]、Ming-Omni[8]、InteractiveOmni[530]等。这些模型在单一主干中联合处理音频、视频和文本,实现低延迟交互。

7.2 交互式音视频具身化

# 7.2.1 音视频导航

音视频导航利用音频和视觉线索引导移动。代表性系统包括SoundSpaces[64]、SoundSpaces 2.0[67];模型如Audio-VLNet[468]、Audio-VLA[602]等。智能体需学习从声音中推理空间信息。

# 7.2.2 音视频场景理解与重建

结合音频和视觉进行3D场景理解与重建,如AVLMaps[224]、Sound of Simulation[566]。

# 7.2.3 音视频具身交互与操作

智能体基于音视频感知执行物理操作,如OpenVLA[268]、π0[42]、GR00T N1[41]、音频-VLA[602]等。这类模型统一感知、推理和行动。

8 Applications / 应用

8.1 AIGC与创意内容生产

音视频生成技术广泛应用于电影制作、游戏开发、虚拟IP、配音、音乐视频等。系统如Movie Gen[439]、Veo-3[120]使创作者能从文本直接生成音视频内容。

8.2 数字人类与社交互动

数字人类(如虚拟主播、客服化身)利用音频驱动说话头、面部表情同步进行实时互动。代表性系统包括Wav2Lip[442]、AD-NeRF[194]、VASA-1[165]等。

8.3 以人为本的智能服务

辅助技术(如视频字幕、跌倒检测)、会议转录、教育(自动生成多媒体教学材料)等。代表性感知模型如Whisper[451]、Qwen-Audio[106]可实现跨场景服务。

8.4 沉浸式体验与元宇宙

VR/AR中,空间音频与视觉的联合生成和建模对于创建真实沉浸感至关重要。系统如SoundSpaces[64]和OmniXR[79]探索了该方向。

8.5 具身AI与机器人

机器人通过音视频感知进行导航、操作和人机交互。代表性VLA系统如RT-2[770]、OpenVLA[268]、Gemini Robotics[519]。

8.6 泛在感知与安全

监控、异常事件检测(如枪声检测结合视频)、声源定位等安防应用。模型如AudioSet[168]训练的事件检测器、CRAB[136]等。

9 Open Challenges / 开放挑战

9.1 从时间同步到因果事件-源基础

当前系统主要依赖于成对的同步音视频剪辑。未来需要在动态、未配对流中建立因果事件-源基础,理解“什么声音导致了什么视觉事件”以及“为何如此”。需要因果推理和反事实能力。

9.2 从成对剪辑到动作条件音视频世界模型

现有模型主要基于固定镜头或剪辑训练。未来需要能够预测智能体采取特定行动后音频和视觉世界如何变化的世界模型,对机器人和交互式AI至关重要。

9.3 音视频上下文记忆

缺乏长期跨模态上下文记忆能力。需要开发存储和检索过去音视频事件记忆的机制,以实现长时对话和具身交互中的连贯性。

9.4 因果音视频干预

实现真正控制和推理需要模型能进行因果干预:在虚拟世界中修改一个模态(如移除声音)并预测对另一个模态(视觉)的影响。需要世界理解中的因果关系建模。

9.5 验证器与奖励生态系统

需要建立强大的验证器和奖励系统评估生成结果的质量、对齐度、安全性和真实性,尤其在开放式音视频生成任务中挑战巨大。

9.6 交互与负责任的音视频智能

涉及安全性、水印、溯源、治理、隐私保护和公平性。随着音视频生成能力增强,确保负责任开发和使用至关重要。需要数据许可、内容认证、偏见控制等机制。

10 Conclusion / 结论

本综述首次全面审视了在大基础模型范式下的音视频智能。我们建立了一个统一的分类法,涵盖从理解、生成到交互的任务领域,综合了方法论基础(包括表示、生成与LLM为中心的技术),整理了代表性的数据集和基准,并指出了在时间同步、空间音频推理、可控性、安全性与治理等方面的开放挑战。通过将这一快速扩张的领域整合到一个连贯的理论框架中,本综述旨在为未来大规模音视频智能研究提供一份可靠的参考。

原文信息

英文题目:Audio-Visual Intelligence in Large Foundation Models: A Comprehensive Survey 作者:You Qin, Kai Liu, Shengqiong Wu, Kai Wang, Shijian Deng, Yapeng Tian, Junbin Xiao, Yazhou Xing, Yinghao Ma, Bobo Li, Roger Zimmermann, Lei Cui, Furu Wei, Jiebo Luo, Hao Fei arXiv ID:2605.04045 类别:cs.CV Comments/项目信息:56 pages, 16 figures, 24 tables. GitHub repository: https://github.com/JavisVerse/Awesome-AVI 原文链接:http://arxiv.org/abs/2605.04045v1