迈向高效、科学且普适的小语言模型开发

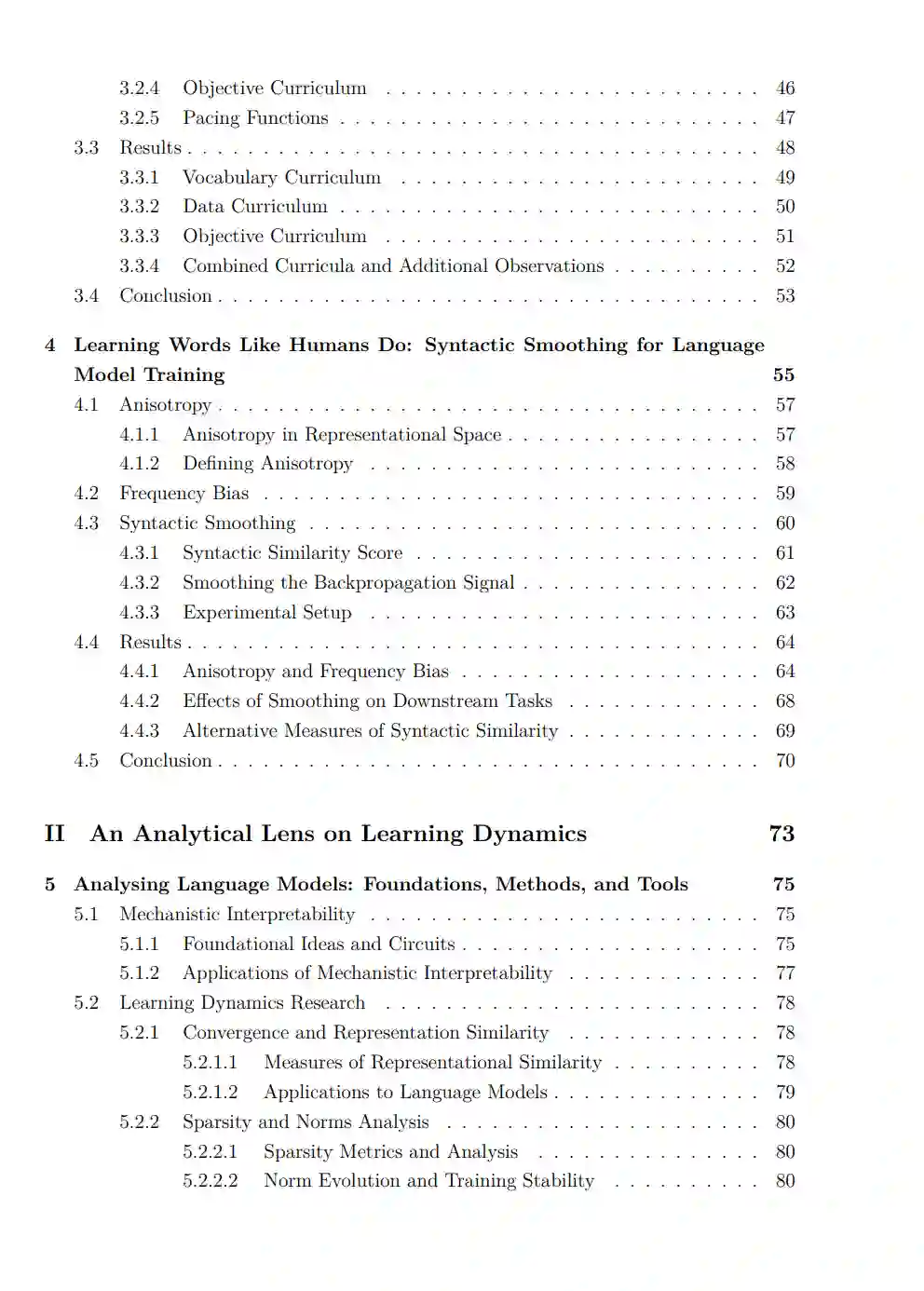

**摘要:**尽管语言模型的规模在持续增长,但我们对其内部工作机制的理解,以及高效训练模型(尤其是小模型)的能力仍然有限。参数量在十亿以下(Sub-1 billion)的小模型在经济成本、环境影响及可访问性方面具有显著的实际优势,这促使研究界迫切需要更有效的训练方法论。本论文通过两个互补的视角探讨了小语言模型的开发挑战:认知启发(Cognitive Inspiration)与分析探究(Analytical Investigation)。 首先,借鉴人类高效习得语言的过程,本文探索了用于训练小模型的认知启发技术。通过一个名为 CLIMB 的框架,本文研究了在数据受限场景下,受人类语言习得启发的课程学习策略。此外,本文提出了一种认知驱动的方法——句法平滑(Syntactic Smoothing),该方法通过利用句法结构增强了对低频词的表示能力。 其次,本文采用分析视角研究了小模型的训练动力学与瓶颈。通过对 Pythia 模型系列的逐层行为分析,本文识别了小模型中的收敛挑战与饱和现象。该分析揭示了当前语言模型开发中一个更广泛的缺陷:即训练工具与分析工具之间的脱节,这种脱节阻碍了以科学、迭代的方式改进模型。为了解决这一问题,本文推出了 Pico——一个开源、轻量化且模块化的小模型开发框架。Pico 集成了模型训练与学习动力学的细粒度分析功能,由 pico-train 和 pico-analyze 两个组件构成,旨在为开发小语言模型提供一种基于原则(Principled)且实验驱动的方法论。 最终,本论文贡献了创新的技术方案与工具,旨在提升小语言模型训练的效率、科学性,并使其对更广泛的用户群体更具普适性。

成为VIP会员查看完整内容