自2021年4月至5月的危机以来,人工智能(AI)在塑造以色列在巴勒斯坦军事行动方式方面发挥了作用。这场由东耶路撒冷紧张局势引发的事件,在埃及斡旋的停火结束敌对行动前,已演变为以色列与哈马斯之间为期11天的冲突¹。在此背景下,在以色列“城墙守护者”行动期间,以色列国防军(IDF)情报部队的一名高级军官宣称“人工智能是与敌人作战的关键组成部分和力量倍增器”²。以军表示,在第一个月内,其通过使用“福音”(Habsora)系统打击了“超过1500个恐怖目标”³。

相比之下,在2023年10月7日哈马斯和巴勒斯坦伊斯兰圣战组织(PIJ)发动袭击后引发的加沙冲突的前35天,以色列当局宣布其已打击了超过15000个目标⁴。轰炸数量的显著增加是以色列大规模报复的特殊背景下的结果。无论有无人工智能,造成的破坏或许相同;由于缺乏另一种现实,无法断言。然而,明确的是,对加沙地带的打击特点是更多地使用人工智能来确定目标。福音系统革新了目标确定流程,每天可生成多达100个目标,而人类分析员过去每年仅能识别约50个⁵。2024年4月⁶,独立的巴以调查新闻媒体《+972杂志》披露,另外两个基于人工智能的系统——“薰衣草”(Lavender)和“爸爸在哪”(Where's Daddy)——也在目标选择及其地理定位的自动化过程中发挥了关键作用。

在加沙使用人工智能受到了调查新闻界、非政府组织⁷(NGOs)以及联合国⁸(UN)专家的严厉批评。在一份旨在证明使用这些技术合法性的以军声明中,一位高级情报官员表示,该系统能够识别目标以进行精确打击,“对敌人造成巨大损害,对非战斗人员的损害最小”⁹。然而,这些精确性的承诺与现实形成了反差,因为人工智能的使用已导致大量平民伤亡¹⁰。尽管确切数字仍不确定,截至2024年12月16日,加沙当局报告死亡人数超过45000人¹¹。

如何解释,尽管观察到大范围的破坏、造成了大量平民伤亡,并且在人质和囚犯交换的背景下哈马斯组织了武力展示,但将人工智能用于目标瞄准仍被辩解为一种作战优势,即使它引发了与决策自动化相关的重大伦理关切?

为回答这个问题,本文分三步进行。首先,介绍以色列三种人工智能系统的运作原理,以及与之相关的滥用行为。其次,讨论与人类控制缺失和决策过程受制约相关的伦理问题。第三,探讨有必要区分“有意义的人类控制”和“名义上的人类介入”这两个概念,正如巴勒斯坦国提交给联合国的信函中所强调的那样。

1. 三种以色列人工智能系统的运作原理

将人工智能融入以色列军事行动植根于多年期“动量”(Momentum,希伯来语为Tenufa)计划,该计划于2020年在以军总参谋长阿维夫·科哈维的领导下制定。该计划基于一个长期愿景,旨在打造一支联系更紧密、更具杀伤力的军队,能够在尽可能短的时间内消除敌方能力¹²。整合新技术,如高级信息处理、数字连接和自动化¹³,是该计划的一个重要维度¹⁴。其目标是利用这些创新的潜力,开发能够大幅缩短从传感器识别目标到“在数秒内”¹⁵将其摧毁之间时间的方法¹⁶。通过这种方式,“动量”计划提议将以色列国防军转变为一台“智能战争机器”¹⁷。

继“动量”计划之后,前以色列精锐情报部队8200部队指挥官约西·萨里埃尔准将所著的《人机团队:如何创造人与人工智能之间的协同效应,这将彻底改变我们的世界》一书,也对军队内部整合人工智能的概念化起到了核心作用。萨里埃尔推广了一种能够快速处理海量数据的机器的理念,旨在解决他所谓的“人类瓶颈”¹⁸ 目标识别和验证问题。伦敦玛丽女王大学讲师埃尔克·施瓦茨认为,基于人工智能的目标瞄准系统使得“从统计学角度评估什么构成一个潜在目标”成为可能¹⁹。

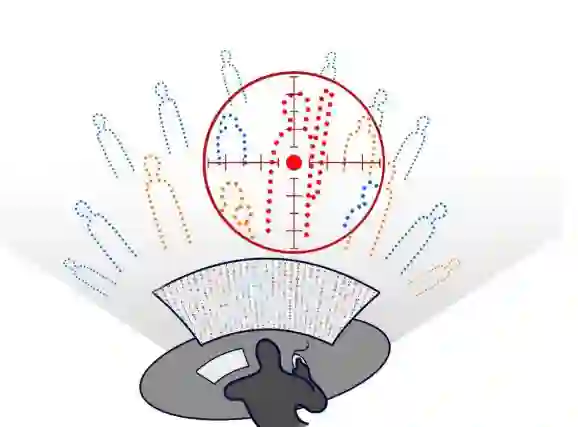

《+972杂志》强调了前述三种基于人工智能的目标瞄准系统在近期以色列对加沙的反击中发挥的重要作用:福音、薰衣草和爸爸在哪。这些系统结合了先进的分析能力、海量数据处理和实时连接,改变了战场上的决策动态。它们每一个都设计有不同的但互补的目标。迄今为止,关于所涉及的数据类型及其处理方式的信息相对有限²⁰。据报道,福音系统专注于建筑物和构筑物,据以军称,武装人员在此类地点活动²¹。薰衣草系统更进一步,基于据称或怀疑与哈马斯和伊斯兰圣战组织武装分支的关联,生成数以万计的人员目标²²。该系统分析加沙人的通信模式,例如频繁更换电话号码或与这些组织相关的号码进行互动²³。其结果随后由“爸爸在哪”系统处理,该系统追踪目标到其家庭住址²⁴。该系统在目标返回时警告军官,从而能够在目标位于家中时执行打击,即使有平民在场²⁵。所有三个程序都建立在“机器学习”原则之上,这使得人工智能能够“从数据中推断并识别模式,而无需明确的指令”²⁶。因此,在“铁剑”行动²⁷(以色列国防军为其对加沙的军事进攻所取名称)的头几周,薰衣草系统协助生成了列出37000人作为潜在目标的数据。

基于人工智能的决策支持系统(AI DSS)必须整合和分析来自多种来源的数据才能运行。这些数据来自以色列数十年来为控制加沙地带和被占领的约旦河西岸所使用的无数监视方法:无人机、卫星、视频监控摄像头、通信拦截系统,以及通过传感数据检测个人、物体和建筑物²⁹。

据一位负责电磁情报的前8200部队成员称,所有电话交谈都被以色列军队通过内置在进口到加沙、经凯雷姆沙洛姆过境点的手机中的设备拦截³⁰。2022年,帕尔马希姆空军基地指挥官奥姆里·多尔表示,“整个加沙都被无人机‘覆盖’,这些无人机全天24小时收集情报”³¹。类似的设备被用于收集人工智能行动所需的数据。

先进技术的结合使用使得以色列军队能够以前所未有的速度扩大和强化其行动。人工智能的使用极大地增加了产出的目标数量,远超没有其支持的情况下人类团队所能确定的数量³²。一位使用过薰衣草系统的以色列高级军官坦率地表示,自动化是对“不断推动产生更多刺杀目标”³³ 需求的回应。这种逻辑属于一个执行速度成为作战要务的过程。实际上,这些人工智能系统的操作员面临着强大的压力,要尽可能多地识别目标并“非常迅速地”³⁴ 将其消灭。据《+972杂志》报道,情报官员会应用预定义的“附带损害”阈值来批准对居民区目标的打击³⁵。例如,一项5级指令授权可造成5名或更少平民死亡的打击³⁶。自10月7日以来,这些阈值已被提高:以色列军官被授权可接受每名哈马斯战斗人员最多造成20名平民死亡,对于高级指挥官则可接受超过100名平民死亡³⁷。在行动初期,以色列国防军忽视了估计为10%的人工智能误报率,并且“在明知平民受伤可能性增加的情况下,仍故意使用无制导的‘哑弹’袭击据称的武装分子住所”³⁸ ³⁹。

目标确定流程和具体打击执行时间的加速,是一个更广泛方法的一部分。在该方法中,平民伤亡的可接受性已在独立于人工智能使用的情况下被预先定义。这些系统(通过人为干预)武断地整合了对每个目标造成平民伤亡数量的高容忍度,无视了国际人道法(IHL)的比例原则。制约人工智能运作的偏见因此显得存在严重缺陷,并且与规范武装冲突的法律规则相悖⁴⁰。

2. 关于决策过程自动化的伦理关切

以色列军官的披露引发了学术界和媒体界的强烈反应和愤慨,暴露了目标确定过程非人化背后的伦理问题。他们部分地加入了关于致命性自主武器系统(LAWS,常被称为“杀手机器人”)的辩论,该辩论已因伦理和法律关切导致国际动员。一个显著的例子是“停止杀手机器人运动”非政府组织联盟,该联盟一直倡导禁止致命性自主武器系统的条约⁴¹。

虽然关于在使用致命武力的决策中自主性问题的辩论相对详尽,但与武器系统不直接相关的人工智能使用则被更谨慎地讨论⁴²。然而,针对致命性自主武器系统提出的关切——例如人类控制的丧失、瞄准错误或伦理影响——同样适用于上述三种以色列人工智能系统。自动化深刻地改变了决定打击的方式,将人类操作员的作用降低为仅仅是机器所做选择的批准者。尽管它们不是无需人工干预即可杀人的致命性自主武器系统,但人工智能决策支持系统直接参与目标确定,并显著影响军事决策。因此,有必要强调与这些实践相关的滥用行为。

首先,对人工智能系统的过度依赖导致了监督不足,尽管对其算法偏见有明确的认识⁴³。内部验证证实其准确率为90%,这意味着在加沙行动的规模上,37000个指定目标中约有3700人实际上与哈马斯军事分支无关,并且“被错误地列入击杀名单”⁴⁴。法国国际关系研究所(Ifri)的研究员阿梅莉·费雷和洛尔·德鲁西-罗什贡德也强调了错误的算法参数。例如,对哈马斯成员的识别基于频繁更换电话号码。这种方法被证明是不精确的,因为这种更换在“人权活动家、记者,以及因轰炸而流离失所的人”⁴⁵ 中也普遍存在。算法偏见已是致命性自主武器系统的一个主要问题,有时会造成重大损害,且未能被及时发现或纠正⁴⁶。

这突显了一个更深层的问题,即当人类监督被置于仓促、宽松的条件下,并最终对错误风险和平民伤亡(在“附带损害”一词下被非人化)关注不足时,问题便会产生。这正是巴勒斯坦国提交给联合国秘书长的分析的核心观点:人工智能的使用助长了“数字非人化”⁴⁷。被瞄准的个人不再被视为具有身份的人,而是被简化为一连串的数据点,包括身体形状、体温、肤色或移动速度等物理特征⁴⁸。这种方法加剧了歧视性偏见,因为一个人很容易基于一般标准被误认为是另一个人。

目标的非人化问题也在致命性自主武器系统的背景下被提出⁴⁹。“停止杀手机器人运动”强调,无法将人类识别为人的机器对攻击行使决策权,这构成了“非人化的终极形式”⁵⁰。因此,对情境的评估和辨别力逐渐消失。通过在其人工智能系统中采用这种视角,以色列军方合法化了一种观念,即杀戮不再被视为一项具有严重后果的重大决定,而是一种实现战术和战略目标的优化方式。这种转变在比致命性自主武器系统更广泛的背景下,提出了人类对人工智能进行有意义控制的问题;以色列的自动化目标瞄准案例说明了人类在使用致命武力的决策中沦为附属品的风险。

3. 有意义的人类控制 vs. 名义上的人类介入:批判性反思

由于过度依赖人工智能,目标建议在很大程度上在没有真正人类控制的情况下得到执行。负责打击验证的士兵“通常仅充当机器决定的‘橡皮图章’”⁵¹,尽管他们知道目标识别的错误率约为10%,但每次打击验证花费的时间不超过20秒⁵²。人类介入常被简化为简单的机械行为,削弱了操作员在采取行动前行使批判性判断的能力。

此外,尽管有能够核实平民伤亡的信息来源⁵⁴,以色列国防军似乎并未系统、严格地进行战斗损害评估⁵³。据《+972杂志》报道,对于低级别战斗员的评估甚至被取消⁵⁵。士兵们最近的证词表明,以色列国防军已逐步减少人类在决策回路中的参与,限制了他们的批判性思考能力。

事实很清楚:不基于道德或法律考量的人类介入不足以建立有意义的人类控制。尽管尚未形成普遍定义,但该原则基于在使用武器系统时保持人类操作员的控制和道德责任⁵⁶。多年来,这已成为讨论,特别是在致命性自主武器系统政府专家组(GGE)内部讨论的核心要素⁵⁷。

无论对有意义的人类控制采取何种定义,以色列国防军所采取的方法似乎都未能满足该原则的最低要求。在这方面,巴勒斯坦国引入了“名义上的人类介入”这一概念,以区分以色列操作员的有限参与与构成真正人类控制的情况。这一概念强调,如果人类介入被简化为快速批准人工智能驱动的决定⁵⁸,则不能被视为是有意义的,因为它缺乏对局势的辨别力和批判性评估⁵⁹。

以色列的例子说明了有意义的人类控制所面临的悖论。自动化的论点基于人工智能能够以超越人类能力的速度处理数据这一理念⁶⁰。然而,这种速度是以牺牲真正的人类控制为代价的。确实,操作员无法在不将人工智能功能减慢到损害其操作效用的程度的情况下,充分核实人工智能驱动的决定。

结论

本文论证了人工智能在武装冲突中带来的挑战,与关于其在致命性自主武器系统框架内军事应用的伦理和法律辩论相一致并扩展了该辩论。基于人工智能的目标瞄准系统直接影响致命决策,且常常缺乏真正的控制。

以色列三种系统的案例说明了目标瞄准自动化如何将人类控制降低为仅仅是程序性的批准角色。快速行动的压力、人工智能使用的条件,以及质疑其通过不透明算法运作机制的无能为力,都有效地阻止了任何有意义的人类控制。然而,这一维度对于伦理决策和遵守国际人道法至关重要。加沙的平民伤亡不仅仅是算法失灵的结果。它们是蓄意的政治、军事和技术决策的结果,即使用那些局限性众所周知、且没有足够保障措施来避免重大失误的系统⁶¹。

以色列的人工智能系统并非致命性自主武器系统;它们不会自主杀人。是人类的选择决定了它们的使用方式,而政治、伦理和法律辩论应围绕这些选择展开。这需要解决问责问题,既针对这些人工智能系统的开发者,也针对其操作者。

参考文献:见原文