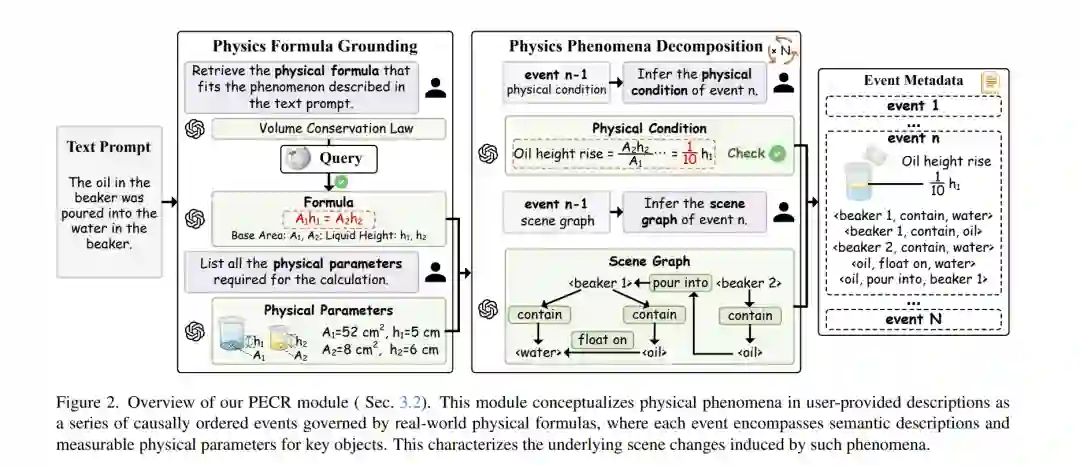

物理一致性视频生成(Physically Plausible Video Generation, PPVG)已成为模拟现实世界物理现象的一种重要范式。PPVG 的核心在于对物理常识的深刻理解,而这对于现有的视频扩散模型而言仍是一项严峻挑战。目前的主流方法多利用大语言模型(LLM)的常识推理能力,将物理概念嵌入提示词(Prompts)中。然而,由于缺乏建模因果演进(Causal Progression)的调节机制,生成模型往往仅能将物理现象渲染为由提示词定义的“孤立瞬间”。 在本文中,我们将 PPVG 视为一系列因果关联且动态演变的事件生成过程。为实现这一范式,我们设计了两个核心模块: 1. 物理驱动的事件链推理(Physics-driven Event Chain Reasoning):该模块利用**思维链(CoT)**推理,将提示词描述的物理现象分解为若干基础事件单元。为消除因果歧义性,我们将物理公式嵌入为约束条件,从而在推理过程中引入确定性的因果依赖。 1. 演变感知的跨模态提示(Transition-aware Cross-modal Prompting, TCP):为确保事件间的连续性,该模块将因果事件单元转化为时序对齐的视觉-语言提示。通过对离散事件描述的整合,该模块能够构建因果一致的叙事逻辑,并结合交互式编辑技术逐步合成各事件的视觉关键帧。

在 PhyGenBench 和 VideoPhy 基准测试上的详尽实验表明,本框架在多物理领域的物理一致性视频生成任务中表现卓越。相关代码即将开源。

成为VIP会员查看完整内容