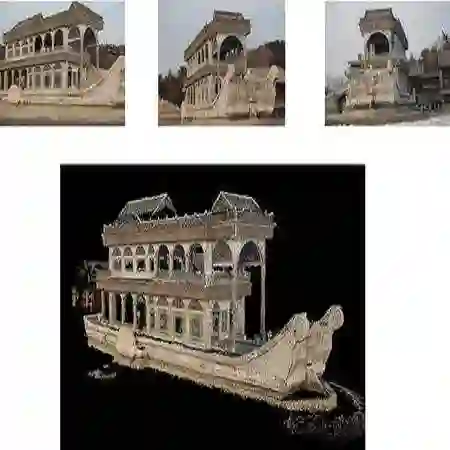

MoE3D is a mixture-of-experts module designed to sharpen depth boundaries and mitigate flying-point artifacts (highlighted in red) of existing feed-forward 3D reconstruction models (left side). MoE3D predicts multiple candidate depth maps and fuses them via dynamic weighting (visualized by MoE weights on the right side). When integrated with a pre-trained 3D reconstruction backbone such as VGGT, it substantially enhances reconstruction quality with minimal additional computational overhead. Best viewed digitally.

翻译:MoE3D 是一种专家混合模块,旨在锐化现有前馈式三维重建模型(左侧)的深度边界并减轻其飞点伪影(以红色高亮显示)。MoE3D 预测多个候选深度图,并通过动态加权(由右侧的 MoE 权重可视化)将其融合。当与预训练的三维重建主干网络(如 VGGT)集成时,它能以最小的额外计算开销显著提升重建质量。建议以数字方式查看以获得最佳效果。

相关内容

专知会员服务

37+阅读 · 2020年2月27日