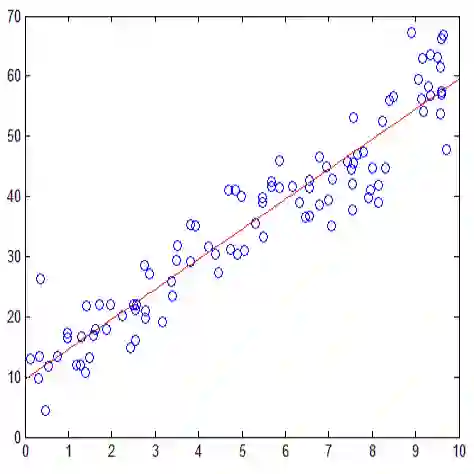

Generalized linear models (GLMs) are fundamental tools for statistical modeling, with maximum likelihood estimation (MLE) serving as the classical approach for parameter inference. While MLE performs well for canonical GLMs, it can become computationally challenging in more general settings with non-canonical, non-smooth, or nonlinear link functions, where the resulting optimization landscape may be ill-conditioned, non-convex, or non-differentiable. In this paper, we study an alternative estimation framework based on variational inequalities (VIs), which formulates GLM estimation through an operator-based equilibrium condition rather than likelihood minimization. We analyze the VI estimator from a statistical perspective and establish finite-sample error bounds and asymptotic normality under mild regularity conditions, together with convergence guarantees for fixed-point and stochastic approximation algorithms. The framework accommodates a broad class of link functions, including non-canonical and non-monotone cases satisfying a strong Minty-type condition, and extends naturally to generalized additive models via basis expansion. Numerical experiments demonstrate that the VI approach achieves competitive finite-sample accuracy and improved numerical stability relative to MLE, particularly in GLMs and GAMs with non-canonical or non-smooth link functions.

翻译:广义线性模型(GLMs)是统计建模的基础工具,其中最大似然估计(MLE)是参数推断的经典方法。尽管MLE在标准GLMs中表现良好,但在更一般的非标准、非光滑或非线性连接函数设置中,其计算可能变得困难,因为由此产生的优化问题可能呈现病态、非凸或不可微的特性。本文研究了一种基于变分不等式(VIs)的替代估计框架,该框架通过基于算子的平衡条件而非似然最小化来构建GLM估计。我们从统计角度分析了VI估计量,在温和的正则条件下建立了有限样本误差界和渐近正态性,并给出了定点算法和随机逼近算法的收敛性保证。该框架适用于广泛的连接函数类别,包括满足强Minty型条件的非标准和非单调情形,并通过基展开自然地扩展到广义可加模型。数值实验表明,相对于MLE,VI方法在有限样本精度上具有竞争力,并提高了数值稳定性,特别是在具有非标准或非光滑连接函数的GLMs和GAMs中。