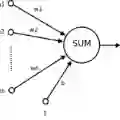

In contrast to biological neural circuits, conventional artificial neural networks are commonly organized as strictly hierarchical architectures that exclude direct connections among neurons within the same layer. Consequently, information flow is primarily confined to feedforward and feedback pathways across layers, which limits lateral interactions and constrains the potential for intra-layer information integration. We introduce an artificial neural network featuring intra-layer connections among hidden neurons to overcome this limitation. Owing to the proposed method for facilitating intra-layer connections, the model is theoretically anticipated to achieve faster convergence compared to conventional feedforward neural networks. The experimental findings provide further validation of the theoretical analysis.

翻译:与生物神经回路不同,传统人工神经网络通常被组织为严格的分层架构,排除了同一层内神经元之间的直接连接。因此,信息流主要局限于跨层的前馈和反馈通路,这限制了横向相互作用,并制约了层内信息整合的潜力。我们引入了一种在隐藏神经元之间具有层内连接的人工神经网络以克服这一限制。由于所提出的促进层内连接的方法,该模型在理论上预期比传统前馈神经网络实现更快的收敛。实验结果进一步验证了理论分析。