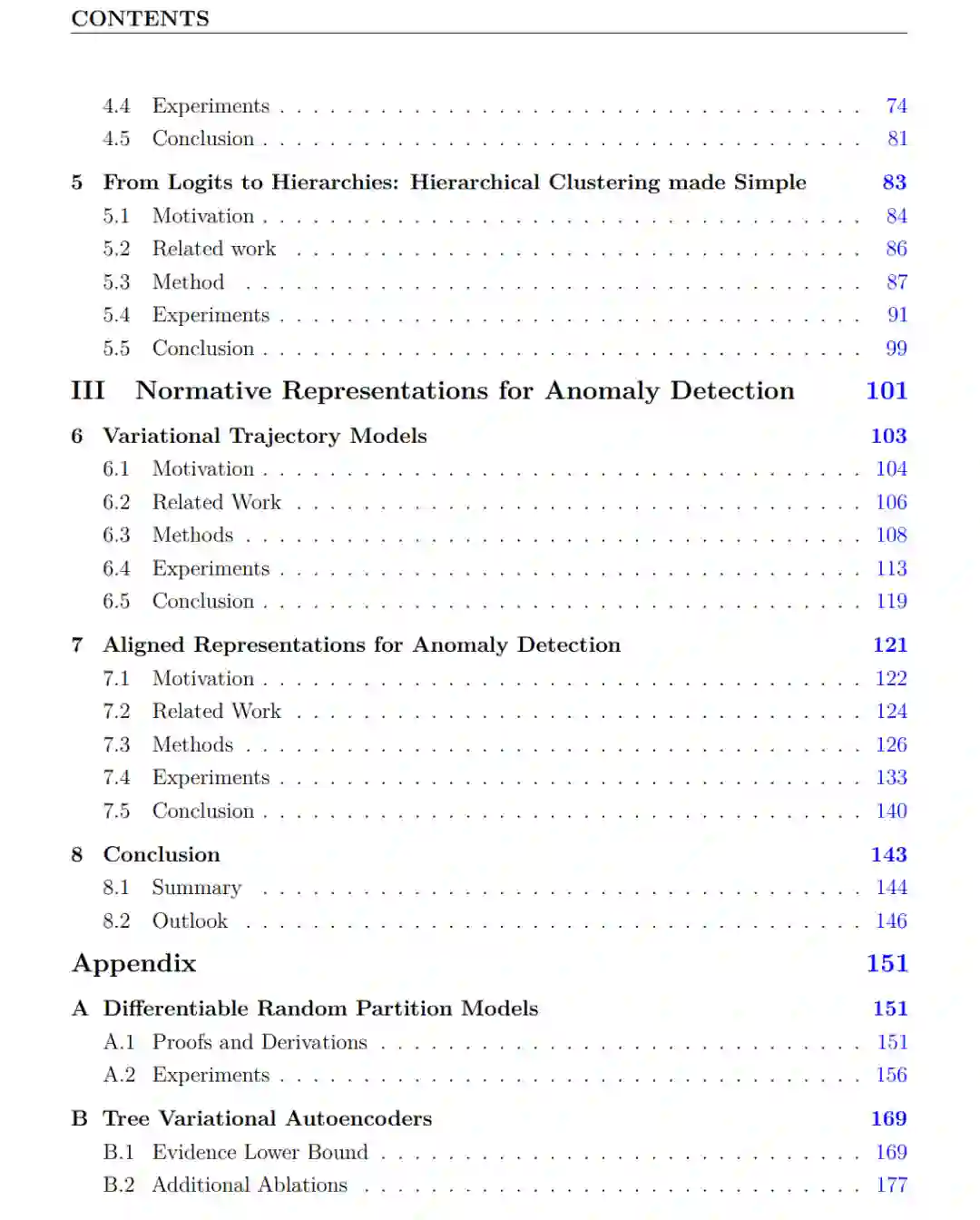

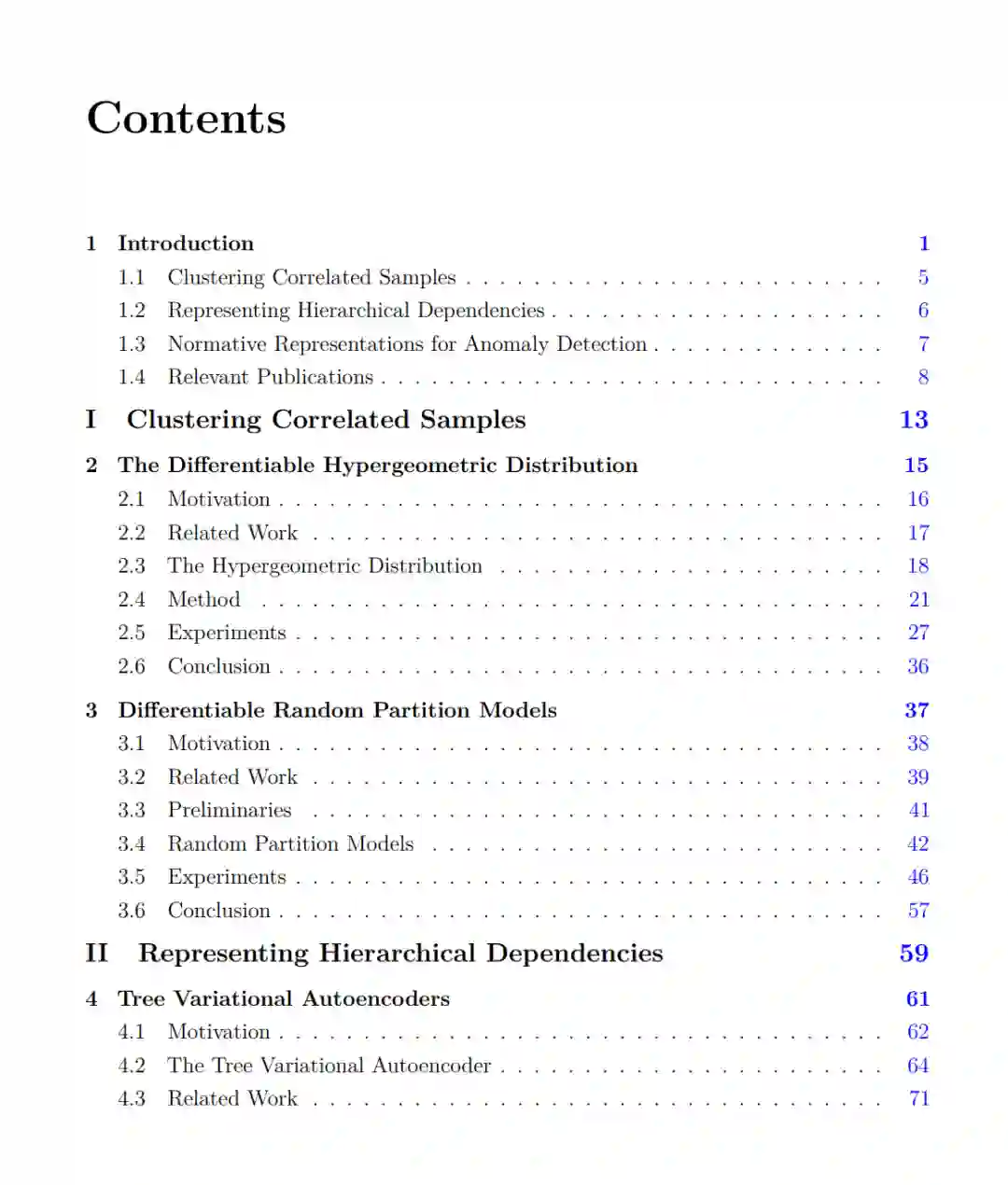

自监督表示学习能够从无标签数据中提取信息丰富的特征,构成了诸多现代机器学习方法的基础。然而,传统方法往往忽视了宝贵的专家与领域知识,而这些知识对于增强模型的可解释性、鲁棒性以及与现实世界语义的对齐至关重要。本论文探讨了如何系统性地将先验知识集成到自监督学习中,并将聚类与异常检测作为无监督学习的核心问题进行深入研究。 我们提出了一系列通过利用结构化先验和概率建模,将先验知识直接引入神经网络训练的方法。通过扩展变分自编码器(VAEs)以考虑样本间的依赖关系、层级关系及规范行为(normative behaviors),我们论证了自监督方法如何从通用的模式识别工具演变为语义理解机制。具体而言,我们展示了如何学习数据内部相关且层级化的聚类结构,以及如何编码关于正常状态(normality)的先验知识,以提升对稀有或特定领域异常项的检测能力。在这些设定下,集成先验知识能够持续产生更丰富的潜表示(latent representations),提高可解释性,并在特定领域展现出卓越的泛化性能。 综上所述,本论文的贡献表明,显式地将先验知识集成到机器学习中,所构建的模型不仅准确度更高,且能更好地捕获现实世界数据的语义。通过将数据驱动的学习与领域见解相对齐,我们获得的表示能够更深层次地揭示底层结构并支持知识发现,从而为迈向更具原则性、可解释性且应用感知的机器学习铺平道路。

成为VIP会员查看完整内容