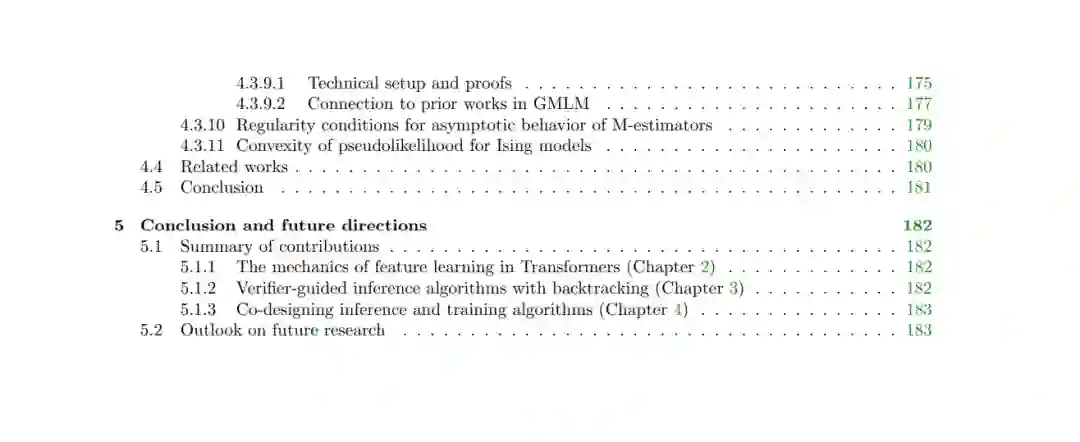

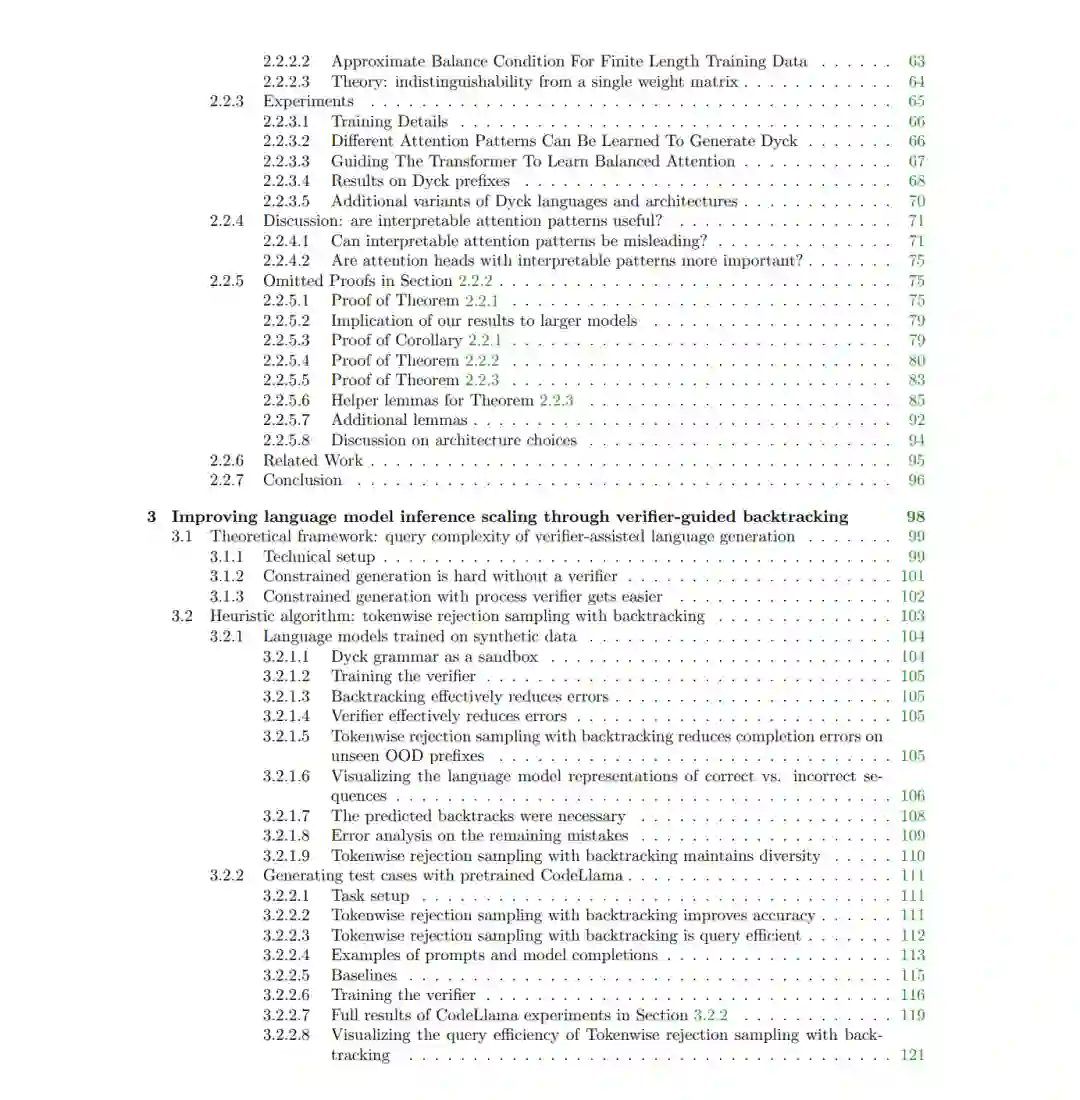

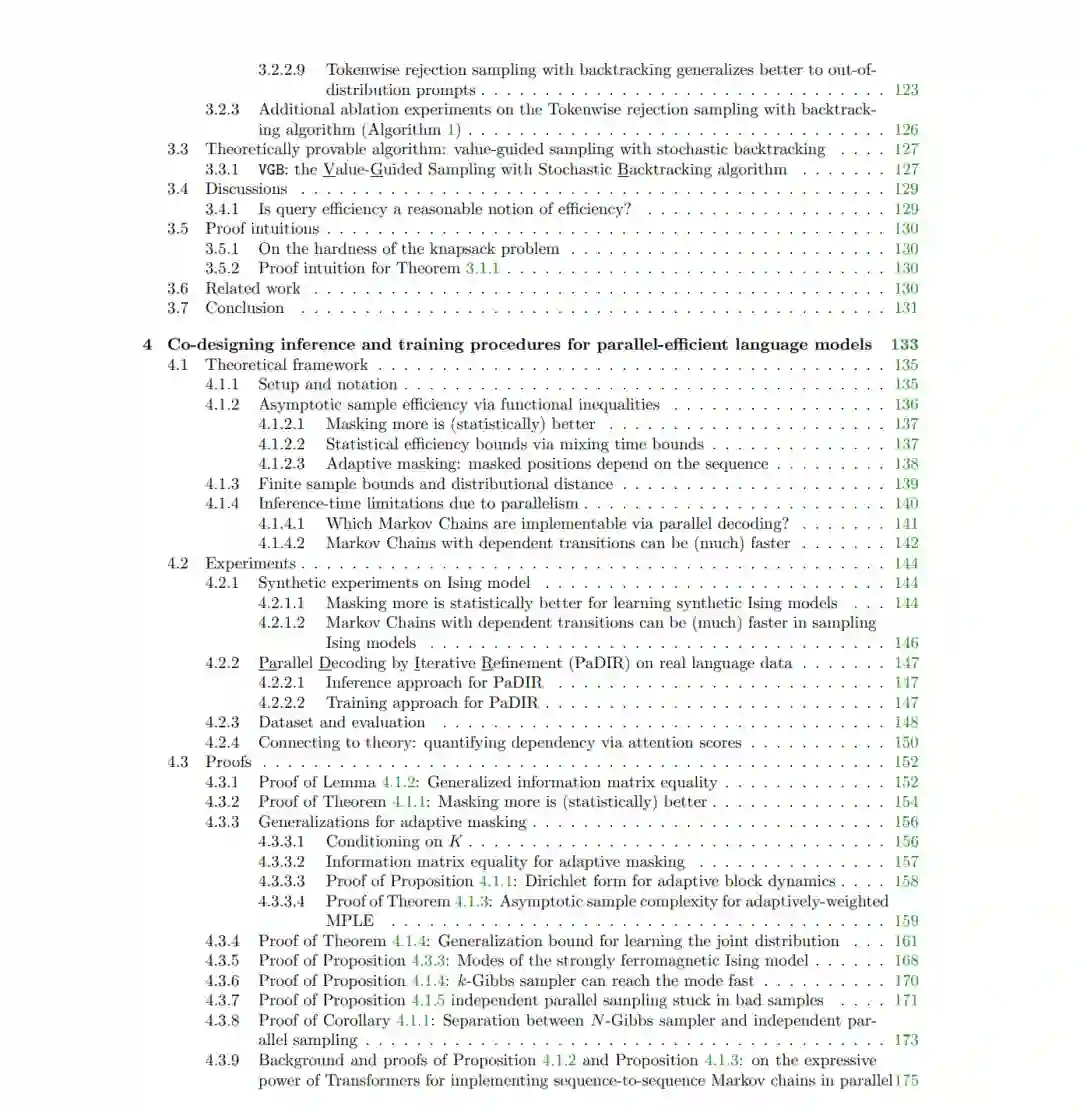

语言模型是一项极其复杂的工程技术成就——目前,研究人员和从业者对其许多维度的(数学和概念层面)理解仍显匮乏。本论文综述了本人旨在开发一套语言模型理论推理方法论的相关研究。该方法论的基础在于:通过关注语言数据中普遍存在的关键结构(如语法和主题),对数据生成过程进行数学建模。这些结构在特定的抽象层次上为数据提供了现实的假设,从而有助于研究数据、训练与推理之间的交互作用。 第 2 章探讨训练过程:本章涵盖了我们阐明 Transformer 架构模型在常规训练程序下如何学习简单语言结构的研究工作。第 3 章探讨推理过程:本章介绍了我们在存在验证器(Verifier)引导自回归语言模型生成器的情境下,关于推理时间缩放(Inference Time Scaling)的研究。最后,第 4 章探讨在并行高效(Parallel-efficient)语言模型的语境下,如何对训练和推理程序进行协同设计。 上述研究结果将现代神经网络架构的理论分析与具体的经验现象(Empirical Phenomena)联系起来,并通过基于合成沙箱(Synthetic Sandboxes)和真实语言数据的实验验证了我们的理论。通过这些进展,本人的研究为推理语言建模中数据、训练与推理之间的交互贡献了数学基础,并激励了基于理解和利用这些交互作用的有原则的(Principled)算法设计。

成为VIP会员查看完整内容