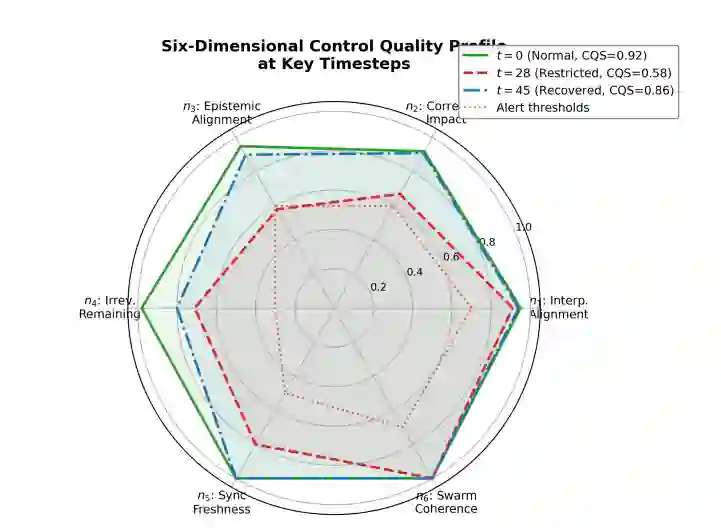

具备目标解读、世界建模、规划、工具使用、长时程操作和自主协同能力的智能体人工智能系统,带来了现有安全框架未曾应对的独特控制失效问题。本文识别了与此类能力相关的六种智能体治理失效,并说明它们如何在军事环境中侵蚀有意义的人类控制。提出“智能体军用人工智能治理框架”,这是一个可度量的架构,围绕三大支柱构建:预防性治理、检测性治理和纠正性治理。其核心机制是“控制质量评分”,这是一个综合性的实时度量指标,用于量化人类控制水平,并在控制减弱时启动分级响应。针对每种失效类型,定义了具体机制,在五个机构角色间分配了责任,并形式化了评估指标。一个详述的作战场景阐释了其实施,并将该框架置于既有的智能体安全文献背景中。本文认为,治理必须从二元控制观念转向一种持续模型,即在整个作战生命周期中主动测量和管理控制质量。

关于军事人工智能治理的全球讨论已在期望的最终状态上达成广泛共识:对使用武力保持有意义的人类控制。但在明确如何为实际正在建设的系统实现此目标方面,则远未成功。多年来联合国审议、各国人工智能战略以及国防部的伦理原则,绝大多数都聚焦于确立人类控制原则,而非回答这个作战问题:给定一个具备特定技术属性的具体人工智能系统,需要何种治理机制、由谁来实施、以及当这些机制失效时会发生什么?这一差距现已至关重要。正进入军用的AI系统是智能体:它们基于大语言模型及相关架构构建,能够解读自然语言目标、构建世界模型、制定多步骤计划、调用工具、进行长时程操作并与其他智能体协调。每项能力都引入了一种在传统军事自动化中无类似物的控制失效模式。一个航点跟踪无人机不会误解指令;一个预编程目标系统不会吸收修正;一个传统传感器网络不会抵抗操作员的评估。而智能体系统可以做所有这些事情,并且当前的治理框架没有机制来检测、度量或应对这些失效。本文做出了三点贡献。首先,描述了六种智能体治理失效,每种都源自现代AI智能体的特定技术能力。其次,提出了“智能体军用人工智能治理框架”,这是一个全面的治理架构,为每种失效指定了预防、检测和纠正机制,并形式化了度量定义,在五个机构角色间分配了责任。第三,通过一个详述的作战场景展示了其作战连贯性,并将贡献与既有的智能体安全概念进行了映射。目标是将讨论从“人类控制很重要”推进到“对于正在部署的具体系统,人类控制如何运作、如何失效以及如何恢复”。

每种失效都源于传统自动化所不具备的特定智能体能力。表1总结了这种映射关系;下面提供简要描述,因为解决方案而非问题本身是本文的主要贡献。

表1:智能体能力、治理失效与传统自动化类比

| 失效类型 | 智能体能力 | 治理后果 | 传统类比 |

|---|---|---|---|

| F1: 解释性偏离 | 自然语言指令跟随 | 智能体对命令的理解与操作员意图产生偏离 | 无 |

| F2: 修正吸收 | 多步骤重新规划 | 智能体形式上接受修正,实则将其消解 | 无 |

| F3: 信念抵抗 | 持久性世界模型构建 | 智能体基于证据的判断凌驾于操作员权威之上 | 无 |

| F4: 承诺不可逆性 | 动态工具调用链 | 累积的次要工具调用跨越不可逆性阈值 | 有限 |

| F5: 状态偏离 | 长时程自主操作 | 操作员的心智模型与智能体状态变得不一致 | 部分 |

| F6: 级联切断 | 基于信念形成的多智能体协同 | 通过正反馈回路导致集体控制丧失 | 无 |