随着自主人工智能(AI)系统能力日益增强,其在军事应用中的安全风险也愈发关键。这些自主AI系统可能做出有缺陷的决策,或通过对抗性攻击(如“越狱”攻击、提示注入、数据投毒)被利用。尽管使AI智能体与任务意图对齐并提升其内在安全性是必要的,但仅靠这些措施并不足够。我们提出了一个AI约束执行框架,其中一个策略执行AI智能体(“智能体守卫”)监管主智能体(Primary-Agent)的行为,确保严格遵守任务定义的约束条件,并减轻潜在的安全风险。“智能体守卫”动态地将自然语言约束条件转化为存储在安全数据库中的正式策略,然后由执行监控器和风险评估守卫在任何行动执行前强制执行。该架构在AI自主性和细粒度的人工监督之间取得平衡,为对抗性攻击和意外行为提供了强有力的防护。通过将约束验证和风险评估整合到决策流程中,本文方法增强了用于高风险军事行动的自主AI系统的安全性、可靠性和任务保障。

框架概述

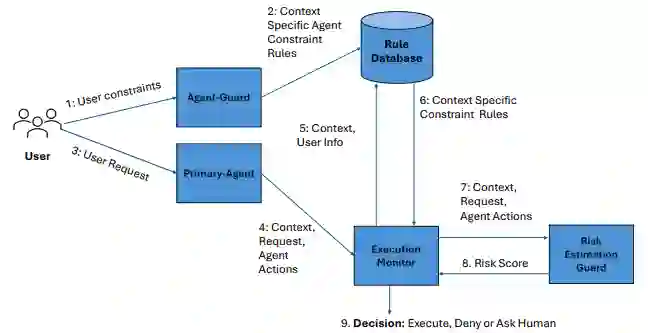

为应对自主AI在军事行动中的安全挑战,我们正在开发一种分层的AI约束执行系统。在该系统中,一个策略执行AI智能体(“智能体守卫”)监督主AI智能体(“主智能体”)的行为,确保其遵守任务定义的约束并降低潜在安全风险。在此架构中,“主智能体”负责执行面向任务的任务,如传感器数据处理、后勤协调或自主平台控制,而“智能体守卫”则确保所有行为都遵守预先设定的操作约束。

为实现这一点,“智能体守卫”解读用户定义的约束条件,并将其转化为用于执行的正式策略规则。指挥官或授权用户以自然语言定义约束条件,而“智能体守卫”将这些输入转换为可执行的策略。这些约束随后被安全地存储在策略数据库中,并可根据任务参数的变化进行动态更新。约束条件一旦建立,执行监控器会在执行前验证“主智能体”的输出。执行监控器充当逻辑执行组件,阻止或标记任何违反任务定义约束的行为,确保严格遵守操作要求。

在此系统中,“主智能体”接收任务请求,并向执行层转发执行请求。在执行任何任务行动之前,执行层首先检查其是否符合预定义的操作约束条件,然后调用“风险评估守卫”来评估与该行动相关的潜在任务和安全风险。如果行动被认为合规且风险处于可接受阈值内,则继续执行。否则,系统将阻止该行动或将其上报给人类操作员进行明确确认。

执行层可以使用经过形式化验证的代码构建,以确保对关键任务策略进行精确和安全的执行。“主智能体”采取的所有行动都会被详细记录,以确保透明度并支持指挥链的合规性审计。该监控框架还融入了基于机器学习的风险评估,以识别那些在技术上符合约束条件但仍可能带来操作风险的情况。

此外,正在为AI智能体开发稳健的风险评估技术,这些技术能够抵御军事环境中典型的广泛对抗性策略。即使在对抗性或降级环境中,这些方法也旨在提供准确的风险评估,从而进一步增强系统的可靠性和可信度。我们的安全框架在AI自主性和指挥/用户权限之间取得平衡,确保细粒度的监督,同时最大限度地降低军事行动中AI驱动决策相关的风险。我们引入了一种双智能体约束执行模型,其中一个AI智能体动态地将指挥官定义的约束条件转化为可执行规则,并主动管控另一个AI智能体的执行。与传统基于规则的或静态的策略执行系统不同,此设计支持实时自然语言约束映射、自适应策略执行以及任务驱动的修改,而无需手动重新编程。通过在执行前整合约束验证和风险评估,该方法确保AI遵守任务特定的限制,这使其在对抗性和高风险作战环境中尤其有价值。我们的框架可以显著增强AI赋能军事系统的安全性、治理能力和可信度,确保其严格与任务参数保持一致,同时在不同任务中保持灵活性。此外,该解决方案强大的日志记录和监控能力将加强AI治理,确保完全透明,并促进对现有和新兴军事要求的遵守。