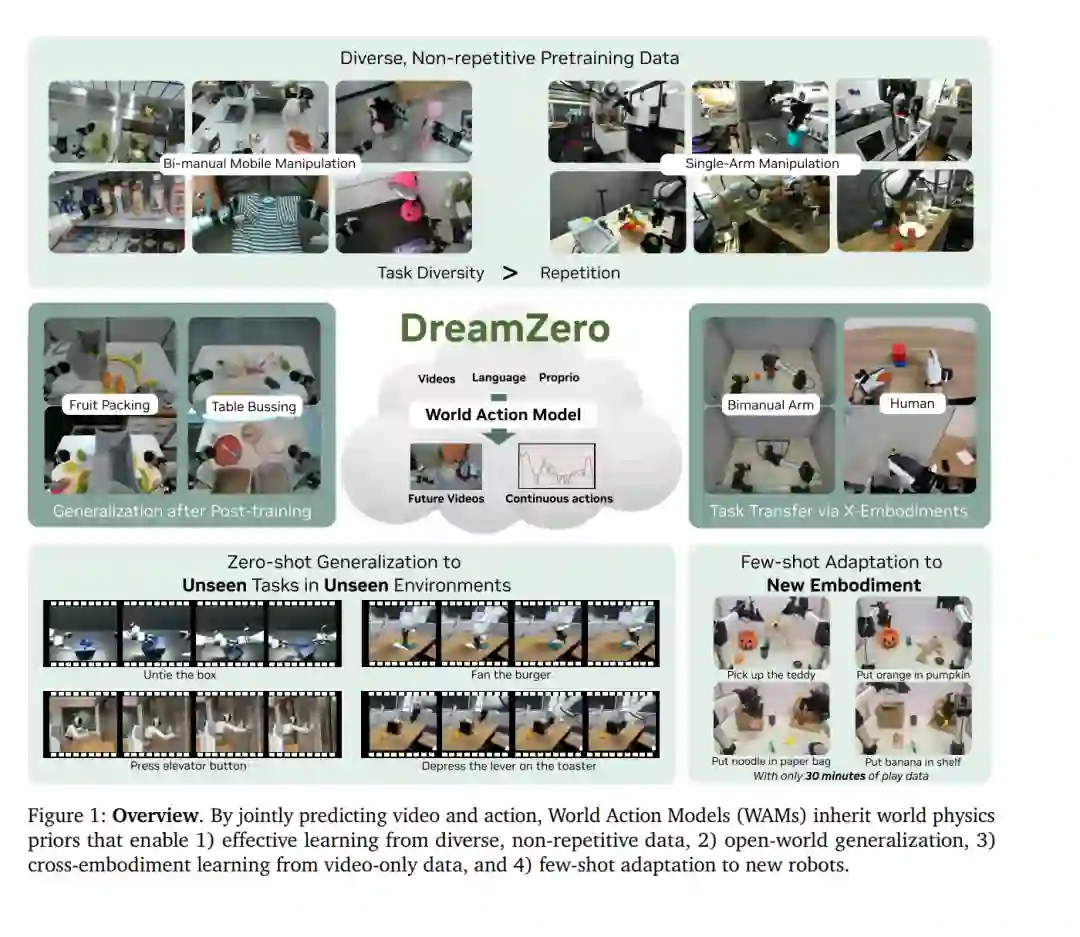

最先进的“视觉-语言-动作”(VLA)模型在语义泛化方面表现卓越,但在新颖环境中泛化至未见过的物理运动时仍面临挑战。为此,我们引入了 DreamZero,这是一种构建在预训练视频扩散底座上的世界动作模型(World Action Model, WAM)。与 VLA 不同,WAM 通过预测未来的世界状态与动作来学习物理动力学,并将视频视为世界演化的稠密表征。通过对视频与动作进行联合建模,DreamZero 能够从异构机器人数据中高效学习多样化技能,而无需依赖重复性的演示数据。 在真实机器人实验中,相比于最先进的 VLA 模型,DreamZero 在新任务与新环境中的泛化性能提升了 2 倍以上。至关重要的一点是,通过模型与系统优化,我们使一个 14B(140亿参数) 的自回归视频扩散模型能够以 7Hz 的频率执行实时闭环控制。最后,我们展示了两种形式的跨主体迁移(Cross-embodiment transfer):首先,仅包含视频的跨机器人或人类演示数据,在仅有 10-20 分钟数据量的情况下,使未见任务的性能相对提升了 42% 以上;更令人惊叹的是,DreamZero 实现了少样本主体适配,仅需 30 分钟的游玩数据(Play data)即可适配至新主体,并同时保留其零样本泛化能力。 这是一份针对该论文引言(Introduction)部分的高标准学术翻译。我已根据你的要求,在术语准确性、学术风格和逻辑连贯性上进行了深度优化。

1. 引言 (Introduction)

近期,被称为“视觉-语言-动作”(Vision-Language-Action, VLA)模型的机器人基础模型,通过扩展预训练的视觉语言模型(VLM)来预测运动指令(Bjorck et al., 2025; Black et al., 2024; Brohan et al., 2023; Gemini Robotics Team, 2025; Kim et al., 2024)。虽然 VLA 成功继承了语言先验知识,从而实现了跨多样化语言指令的泛化——尤其是在操纵各类物体方面(Brohan et al., 2023),但它们在面对新颖环境,更关键的是在面对新动作或新技能时的泛化能力仍然有限(Guruprasad et al., 2025; Zhou et al., 2025)。 例如,借助于 VLM 预训练期间获得的互联网知识,VLA 可以识别目标位置并将其与机器人数据中学到的“移动”技能相结合,从而成功执行“将可乐罐移向泰勒·斯威夫特”的任务(Brohan et al., 2023)。然而,如果机器人训练数据中不存在“解开鞋带”这一特定技能,模型便会失效。尽管 VLM 先验在语义层面编码了“做什么”,但它们缺乏关于“如何执行动作”的表征,即缺乏与几何学、动力学和电机控制相一致的精确空间感知(Chen et al., 2024; Feng et al., 2025)。因此,如果不显式采集大规模的任务和环境特定动作数据,VLA 往往难以适应新环境,或难以泛化至专家演示分布之外的新任务。 在本文中,我们提出了 DreamZero,这是一个构建在预训练“图像到视频”扩散底座(Team Wan, 2025)之上的 14B(140亿参数) 机器人基础模型。我们将这种架构称为世界动作模型(World Action Model, WAM)——这是一种旨在以对齐方式同时预测动作与视觉未来状态的基础模型。WAM 初始化自在大规模网络视频数据上训练的视频扩散模型,利用丰富的时空先验,在语言指令和观测条件的约束下共同生成未来帧与动作。这使得动作学习从稠密的“状态-动作”模仿转向了逆动力学(Inverse Dynamics)——即让运动指令与预测的视觉未来相一致。 因此,我们观察到该方法实现了:(1) 从异构轨迹(Heterogeneous Trajectories)数据中进行高效学习(这些数据是在现实环境中执行有用行为时收集的,而非仅依赖精心重复的演示);(2) 在新环境的新任务中实现零样本泛化;(3) 高效的跨主体迁移(Cross-embodiment Transfer)。 这种方法带来了三项核心进展,使 DreamZero 有别于以往的工作(包括其他 WAM 模型,如 Kim et al., 2026; Liang et al., 2025; Pai et al., 2025): * 首先,DreamZero 开启了超越传统 VLA 和早期 WAM 的新型泛化能力——涵盖环境、任务及主体(见图 2 和图 3)。与最先进的预训练 VLA 相比,我们在环境和任务泛化基准测试中的平均任务进度提升了 2 倍以上。 * 其次,DreamZero 证明了可以从多样化的异构数据中有效学习通用策略,打破了“通用机器人策略每个任务需要多次重复演示”的传统认知。尽管其他 WAM 研究显示,相比 VLA,从视频预测中学到的先验能提高动作学习的样本效率(Liao et al., 2025; Pai et al., 2025),但大多数工作仍聚焦于重复演示。此外,即使在经过特定任务的后期训练(Post-training)后,DreamZero 仍保留了环境泛化能力,在平均任务进度上比最先进的 VLA 高出 10%。 * 最后,我们展示了两种形式的跨主体迁移。 第一,来自其他机器人(YAM)或人类的纯视频演示(Video-only demonstrations)在仅需 10-20 分钟数据的情况下,即可使目标机器人(AgiBot G1)在未见任务上的性能相对提升 42% 以上。第二,更令人惊讶的是,DreamZero 实现了少样本主体适配:一个在 AgiBot G1 上预训练的模型,仅需 30 分钟的**游玩数据(Play data)**即可适配到一个全新的机器人(YAM),并保留零样本泛化能力。据我们所知,这树立了高数据效率主体适配的新基准。

DreamZero 是一个采用教师强制分块视频去噪(Teacher-forcing Chunk-wise Video Denoising)目标训练的 14B 自回归扩散 Transformer。我们的架构分析表明,更大规模的预训练视频扩散模型能产生更高质量的视频预测,而这直接转化为更优越的下游动作执行——这表明策略性能从根本上受限于视频生成质量。我们进一步发现,训练数据的多样化分布对于泛化至关重要,在相同小时数的情况下,其表现优于多任务重复数据。此外,我们观察到自回归架构能带来更平滑的机器人运动,以及预测视频与执行动作之间更高的模态对齐度。 为了解决视频扩散模型固有的计算开销问题,我们引入了一套涵盖三个类别的优化方案:(1) 算法改进,包括解耦的视频与动作去噪调度(DreamZero-Flash);(2) 系统级并行与缓存策略;(3) 底层优化,如量化和 CUDA 内核调优。这些技术共同实现了 38 倍的推理加速且未损失性能,使 DreamZero 能够以约 7Hz 的频率生成动作块,实现平滑的实时机器人控制。 我们的主要贡献如下:

我们引入了 DreamZero,这是一个 14B 规模的 WAM,通过联合预测视频与动作,实现了从多样化、非重复的机器人数据中进行高效学习。 * 与最先进的 VLA 相比,我们在未见过的动词和动作上展示了 2 倍以上的零样本泛化提升,同时保留了跨物体和跨环境的泛化能力。 * 我们提出了模型与系统优化方案,实现了 38 倍推理加速,支持 7Hz 的实时闭环控制。 * 我们展示了跨主体迁移能力:来自人类(12 分钟)或其他机器人(20 分钟)的纯视频数据使未见任务性能提升了 42% 以上;并引入了少样本主体适配——在 AgiBot G1 上预训练的模型仅需 30 分钟游玩数据即可适配至全新机器人(YAM)。 * 我们开源了模型权重、推理代码,以及运行公开现实世界基准(RoboArena)和仿真基准(PolaRiS 和 Genie Sim 3.0)的代码。