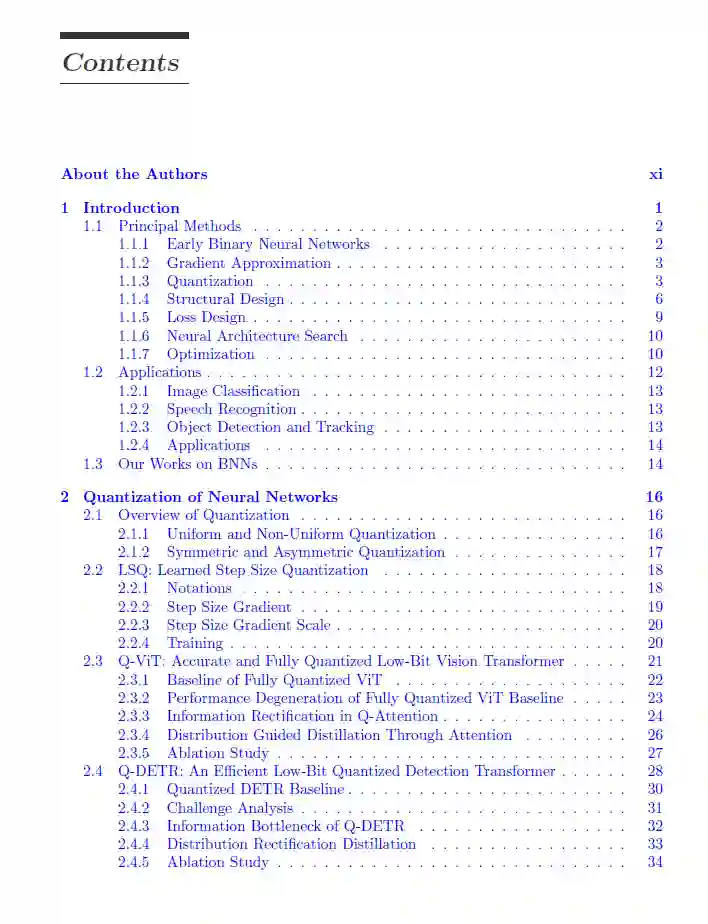

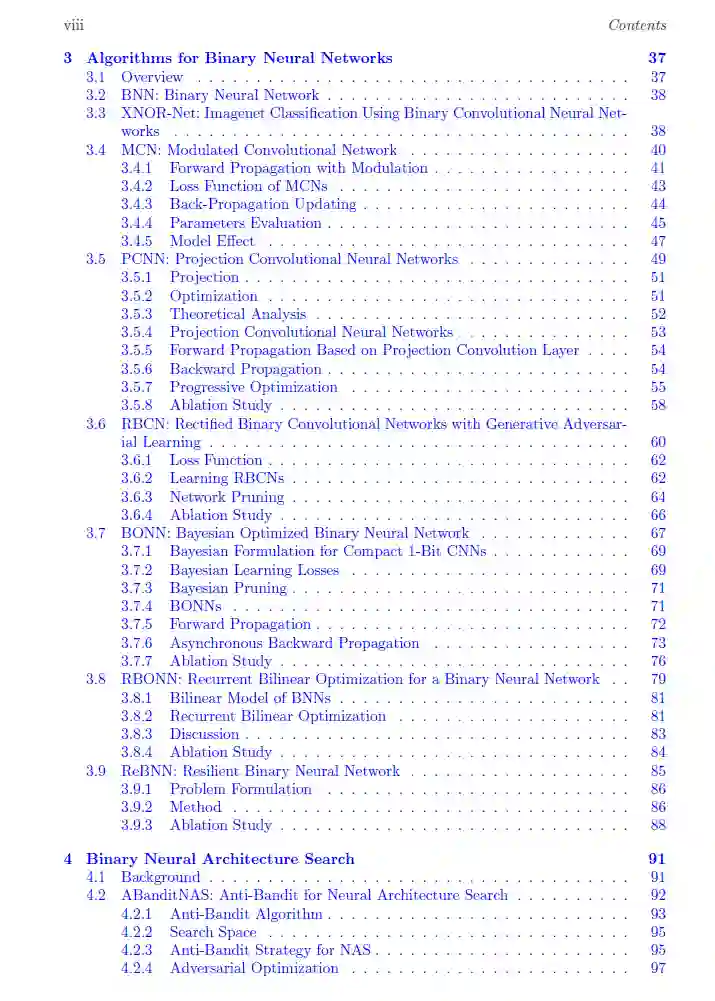

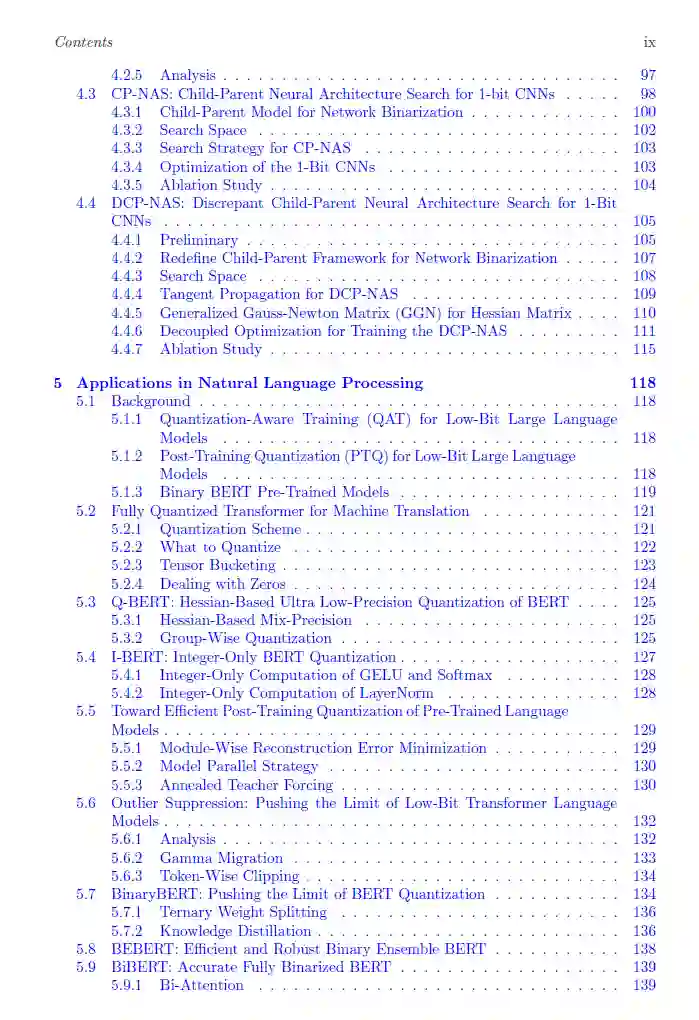

二值神经网络 深度学习在图像分类、计算机视觉和自然语言处理方面取得了令人印象深刻的结果。为了实现更好的性能,已经设计了更深、更宽的网络,这增加了对计算资源的需求。随着网络规模的增大,浮点操作数(FLOPs)急剧增加,这已经成为为移动和嵌入式设备开发卷积神经网络(CNNs)的障碍。在这个背景下,《二值神经网络:算法、架构和应用》将专注于CNN的压缩和加速,这对研究社区非常重要。我们将描述许多方法,包括参数量化、网络剪枝、低秩分解和知识蒸馏。最近,为了减少(从二值到低位)手工设计架构的负担,神经架构搜索(NAS)已经被用来自动构建神经网络,通过在广阔的架构空间中搜索。我们的书还将介绍NAS和二值NAS以及它在各种应用中的优越性和最先进的性能,如图像分类和物体检测。我们还描述了压缩深度模型在图像分类、语音识别、物体检测和跟踪的广泛应用。这些主题可以帮助研究人员更好地理解网络压缩在实际应用上的有用性和潜力。此外,感兴趣的读者应该对机器学习和深度学习有基本的了解,以便更好地理解本书中描述的方法。 **主要特点 **

• 评论CNN压缩和加速的最近进展 • 阐述了二值神经网络(BNN)技术的最近进展 • 介绍了BNN在图像分类、语音识别、物体检测等方面的应用

成为VIP会员查看完整内容

相关内容

Arxiv

43+阅读 · 2023年4月19日

Arxiv

231+阅读 · 2023年4月7日

Arxiv

87+阅读 · 2023年4月4日

Arxiv

155+阅读 · 2023年3月29日