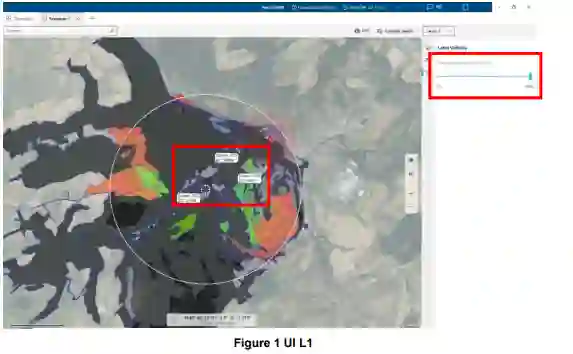

鉴于军事战场日益复杂,防务部门正在寻找先进的解决方案,为操作员提供工具,以使其决策过程比对手更快、更有效。这些工具通常被称为决策支持系统,在过去数十年中一直被使用。人工智能技术常在决策支持系统中实施,以确保相比单个人类表现具有更低的错误率和更快的决策速度。此类人工智能在决策支持系统中实施的效果,在很大程度上取决于操作员理解并进而信任人工智能所提供建议的能力。可解释性人工智能允许用户通过决策支持系统用户界面中的过程可视化,来理解系统是如何得出其决策建议的。然而,这也带来了一个固有的问题,即:在用户变得信息过载、导致操作员决策绩效下降之前,应向用户呈现多少过程信息?在本研究中,开发了一个人工智能驱动的应用程序,用于协助操作员规划军事直升机任务。在此场景中,操作员需要为直升机上的士兵寻找两个合适的着陆区,以接近小城市区域内的恐怖分子据点。决策支持系统支持选择合适直升机着陆区的过程,并考虑多个方面,例如与目标区域的距离、地点大小、地表类型和坡度。为了评估需要多少透明度才能达到最佳的信任水平和任务绩效,定义了四个可解释性级别,每个级别都提供更高的信息透明度和控制度。针对这四个级别中的每一个,都设计了独特的用户界面,并在测试环节中进行了开发和评估。结果表明,第三和第四级用户界面设计(相比前两级提供了更多信息和更多交互可能性)带来了绩效提升(决策时间更短,着陆区决策正确率高,且提交的着陆区的感知得分与实际得分之间偏差小,反映了良好的人机交互)。结果还表明,用户倾向于个性化其用户界面,以满足其角色、经验水平和个人偏好。

成为VIP会员查看完整内容