【一分钟知识】七种损失函数

阅读大概需要1分钟

跟随小博主,每天进步一丢丢

主要内容:

0-1, Hinge, Logistic, Cross Entropy, Square, Absolute, Huber

简述:

损失函数刻画了模型与训练样本的匹配程度。

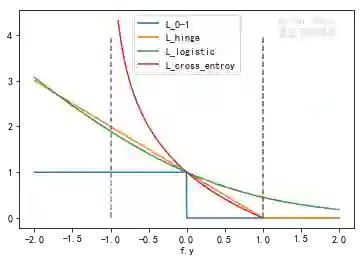

分类Loss.png

1. 对于二分类问题,Y={1,-1},我们希望

0-1损失:

最自然的损失函数是0-1损失,表示的是,当且仅当预测不正确的时候取值为1,否则取值为0。该损失函数能够直观的刻画分类的错误率,但是由于其非凸、非光滑的特点,使得算法很难直接对该函数进行优化。

Hinge损失:

Hinge损失函数是0-1损失函数相对紧的凸上界,且当

Logistic损失函数:

Logistic损失函数也是0-1损失函数的凸上界,且该函数处处光滑,因此可以使用梯度下降法进行优化。但是,该函数对所有样本点都做惩罚,因此对异常点更为敏感。

Cross Entropy:

交叉熵损失函数是常用的二分类损失函数。交叉熵损失函数也是0-1损失的光滑凸上界。

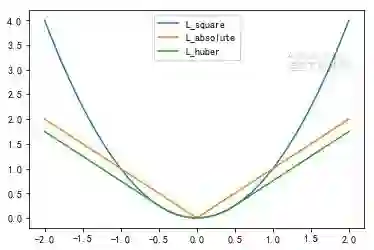

回归Loss.png

1.对于回归问题,我们期望

Square损失:

平方损失函数是光滑函数,能够使用梯度下降法优化。然而当预测值距离真实值越远时,平方损失函数的惩罚力度越大,因此对异常点比较敏感。

Absolute损失:

绝对损失函数相当于在做中值回归,相比做均值回归的平方损失函数,绝对损失函数对异常点更鲁棒。但是,绝对损失函数在f=y处无法求导。

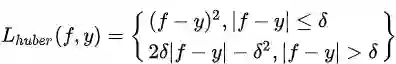

Huber损失:

Huber损失函数在|f-y|较小时为平方损失,在|f-y|较大的时采用线性损失,处处可导,且对异常点鲁棒。

写作不易,还望给个在看!

登录查看更多

相关内容

Arxiv

3+阅读 · 2018年3月26日