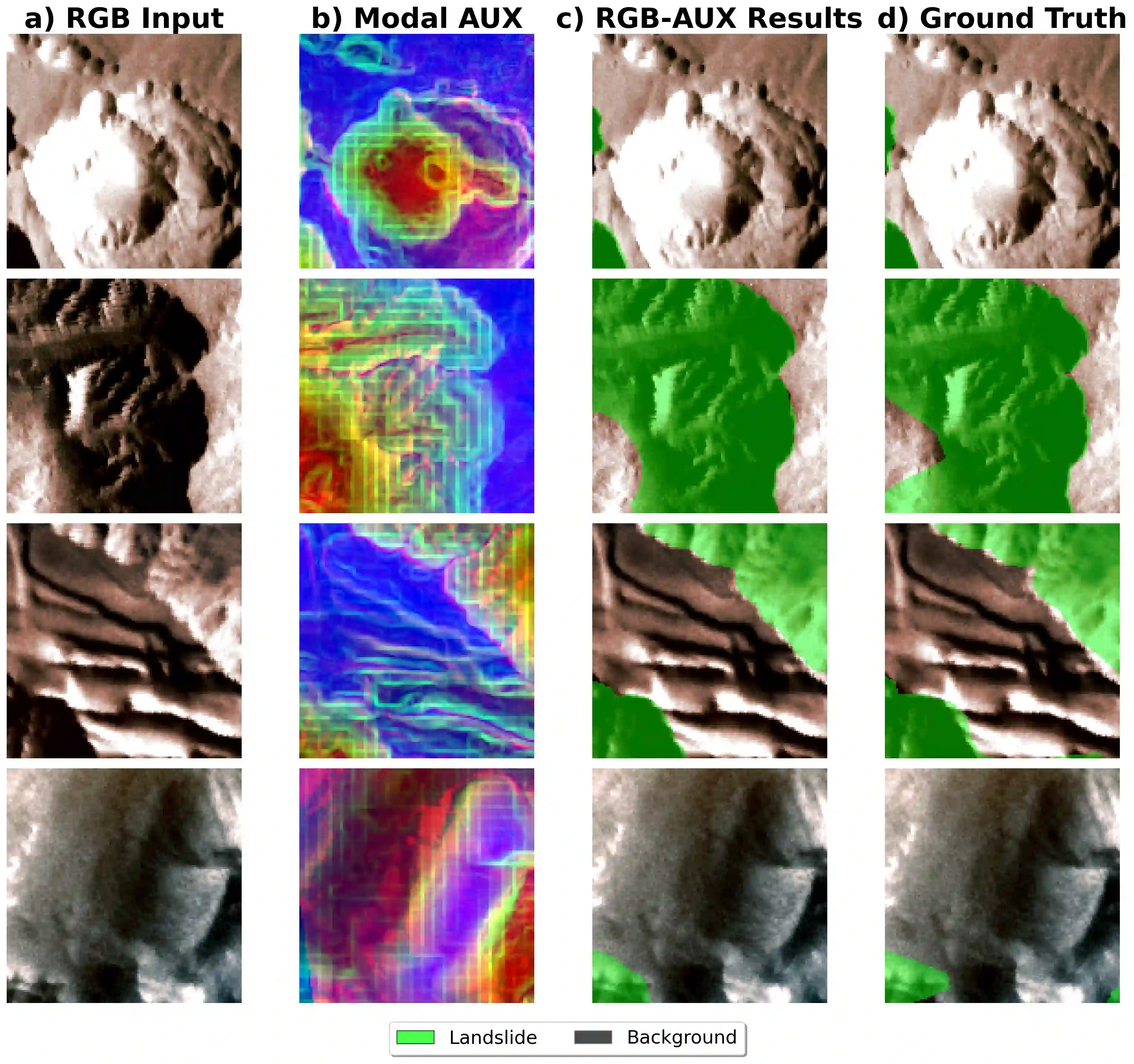

Automated segmentation of Martian landslides, particularly in tectonically active regions such as Valles Marineris,is important for planetary geology, hazard assessment, and future robotic exploration. However, detecting landslides from planetary imagery is challenging due to the heterogeneous nature of available sensing modalities and the limited number of labeled samples. Each observation combines RGB imagery with geophysical measurements such as digital elevation models, slope maps, thermal inertia, and contextual grayscale imagery, which differ significantly in resolution and statistical properties. To address these challenges, we propose DualSwinFusionSeg, a multimodal segmentation architecture that separates modality-specific feature extraction and performs multi-scale cross-modal fusion. The model employs two parallel Swin Transformer V2 encoders to independently process RGB and auxiliary geophysical inputs, producing hierarchical feature representations. Corresponding features from the two streams are fused at multiple scales and decoded using a UNet++ decoder with dense nested skip connections to preserve fine boundary details. Extensive ablation studies evaluate modality contributions, loss functions, decoder architectures, and fusion strategies. Experiments on the MMLSv2 dataset from the PBVS 2026 Mars-LS Challenge show that modality-specific encoders and simple concatenation-based fusion improve segmentation accuracy under limited training data. The final model achieves 0.867 mIoU and 0.905 F1 on the development benchmark and 0.783 mIoU on the held-out test set, demonstrating strong performance for multimodal planetary surface segmentation.

翻译:火星滑坡的自动分割,特别是在诸如水手号峡谷等构造活跃区域,对于行星地质学、灾害评估以及未来的机器人探测具有重要意义。然而,由于可用传感模式的异构性以及标记样本数量有限,从行星图像中检测滑坡具有挑战性。每次观测都结合了RGB图像与地球物理测量数据,如数字高程模型、坡度图、热惯量以及上下文灰度图像,这些数据在分辨率和统计特性上存在显著差异。为应对这些挑战,我们提出了DualSwinFusionSeg,一种多模态分割架构,它分离了模态特定的特征提取并执行多尺度跨模态融合。该模型采用两个并行的Swin Transformer V2编码器来独立处理RGB和辅助地球物理输入,生成层次化特征表示。来自两个分支的对应特征在多个尺度上进行融合,并使用具有密集嵌套跳跃连接的UNet++解码器进行解码,以保留精细的边界细节。广泛的消融研究评估了模态贡献、损失函数、解码器架构和融合策略。在PBVS 2026 Mars-LS挑战赛的MMLSv2数据集上的实验表明,模态特定的编码器和基于简单拼接的融合在有限训练数据下提高了分割精度。最终模型在开发基准上取得了0.867 mIoU和0.905 F1分数,在保留测试集上取得了0.783 mIoU,展示了其在多模态行星表面分割任务上的强大性能。