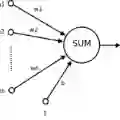

We introduce a simple initial working system in which relations (such as part-whole) are directly represented via an architecture with operating and learning rules fundamentally distinct from standard artificial neural network methods. Arbitrary data are straightforwardly encoded as graphs whose edges correspond to codes from a small fixed primitive set of elemental pairwise relations, such that simple relational encoding is not an add-on, but occurs intrinsically within the most basic components of the system. A novel graph-Hamiltonian operator calculates energies among these encodings, with ground states denoting simultaneous satisfaction of all relation constraints among graph vertices. The method solely uses radically low-precision arithmetic; computational cost is correspondingly low, and scales linearly with the number of edges in the data. The resulting unconventional architecture can process standard ANN examples, but also produces representations that exhibit characteristics of symbolic computation. Specifically, the method identifies simple logical relational structures in these data (part-of; next-to), building hierarchical representations that enable abductive inferential steps generating relational position-based encodings, rather than solely statistical representations. Notably, an equivalent set of ANN operations are derived, identifying a special case of embedded vector encodings that may constitute a useful approach to current work in higher-level semantic representation. The very simple current state of the implemented system invites additional tools and improvements.

翻译:本文提出一种简单的初始工作系统,其中关系(如部分-整体)通过一种在运算与学习规则上根本区别于标准人工神经网络方法的架构直接表示。任意数据均可被直接编码为图结构,其边对应于来自固定小型原始元素对关系集合的编码,使得简单关系编码并非附加组件,而是内在地发生于系统最基础的构件中。一种新颖的图-哈密顿算子计算这些编码间的能量,其基态表示图顶点间所有关系约束的同时满足。该方法仅使用极低精度算术运算;计算成本相应较低,且随数据中边数量线性扩展。所得非常规架构既能处理标准人工神经网络示例,也能生成展现符号计算特征的表示。具体而言,该方法识别数据中的简单逻辑关系结构(部分关系;相邻关系),构建层次化表示以实现生成基于关系位置编码的溯因推理步骤,而非仅产生统计表示。值得注意的是,本文推导出等效的人工神经网络操作集,识别出嵌入式向量编码的特殊情形,这可能为当前高层语义表示研究提供有效途径。已实现系统目前极为简单的状态为附加工具与改进提供了空间。