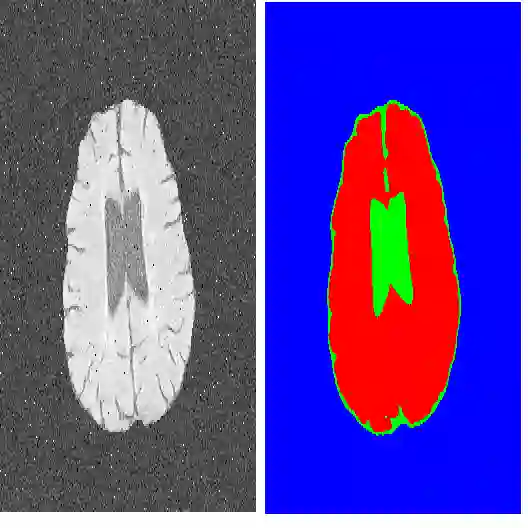

Vision models pretrained on large-scale RGB natural image datasets are widely reused for electron microscopy image segmentation. In electron microscopy, volumetric data are acquired as serial sections and processed as stacks of adjacent grayscale slices, where neighboring slices provide symmetric contextual information for identifying features on the central slice. The common strategy maps such stacks to pseudo-RGB inputs to enable transfer learning from pretrained models. However, this mapping imposes channel-specific semantics inherited from natural images, even though electron microscopy slices are homogeneous in the modality and symmetric in their predictive roles. As a result, pretrained models may encode inductive biases that are misaligned with the inherent symmetry of volumetric electron microscopy data. In this work, it is demonstrated that RGB-pretrained models systematically assign unequal importance to individual input slices when applied to stacked electron microscopy data, despite the absence of any intrinsic channel ordering. Using saliency-based attribution analysis across multiple architectures, a consistent channel-level asymmetry was observed that persists after fine-tuning and affects model interpretability, even when segmentation performance is unchanged. To address this issue, a targeted modification of pretraining weights based on uniform channel initialization was proposed, which restores symmetric feature attribution while preserving the benefits of pretraining. Experiments on the SNEMI, Lucchi and GF-PA66 datasets confirm a substantial reduction in attribution bias without compromising or even improving segmentation accuracy.

翻译:在电子显微镜图像分割领域,广泛复用基于大规模RGB自然图像数据集预训练的视觉模型。电子显微镜成像中,体数据以连续切片形式采集,并作为相邻灰度切片堆栈进行处理,其中邻近切片为中心切片上的特征识别提供对称的上下文信息。常见策略是将此类堆栈映射为伪RGB输入,以实现预训练模型的迁移学习。然而,尽管电子显微镜切片在模态上具有同质性且在预测作用上呈现对称性,这种映射仍会强加从自然图像继承的通道特定语义。因此,预训练模型可能编码与体电子显微镜数据固有对称性不一致的归纳偏差。本研究表明,当应用于堆叠电子显微镜数据时,RGB预训练模型会系统性地为各输入切片分配不均衡的重要性权重,尽管数据本身并不存在任何内在的通道顺序。通过对多种架构进行基于显著性的归因分析,观察到持续存在的通道级不对称现象,这种现象在微调后仍然存在并影响模型可解释性,即使分割性能未发生改变。为解决此问题,提出了基于均匀通道初始化的预训练权重针对性修正方法,该方法在保持预训练优势的同时恢复了对称的特征归因。在SNEMI、Lucchi和GF-PA66数据集上的实验证实,该方法在未损害甚至提升分割精度的前提下,显著降低了归因偏差。