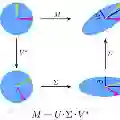

Consistent text-to-image (T2I) generation seeks to produce identity-preserving images of the same subject across diverse scenes, yet it often fails due to a phenomenon called identity (ID) shift. Previous methods have tackled this issue, but typically rely on the unrealistic assumption of knowing all target scenes in advance. This paper reveals that a key source of ID shift is the native correlation between subject and scene context, called scene contextualization, which arises naturally as T2I models fit the training distribution of vast natural images. We formally prove the near-universality of this scene-ID correlation and derive theoretical bounds on its strength. On this basis, we propose a novel, efficient, training-free prompt embedding editing approach, called Scene De-Contextualization (SDeC), that imposes an inversion process of T2I's built-in scene contextualization. Specifically, it identifies and suppresses the latent scene-ID correlation within the ID prompt's embedding by quantifying the SVD directional stability to adaptively re-weight the corresponding eigenvalues. Critically, SDeC allows for per-scene use (one scene per prompt) without requiring prior access to all target scenes. This makes it a highly flexible and general solution well-suited to real-world applications where such prior knowledge is often unavailable or varies over time. Experiments demonstrate that SDeC significantly enhances identity preservation while maintaining scene diversity.

翻译:一致文本到图像(T2I)生成旨在为同一主体在不同场景中生成身份保持的图像,但由于一种称为身份(ID)偏移的现象,其效果往往不佳。先前的方法已尝试解决此问题,但通常依赖于预先知晓所有目标场景这一不切实际的假设。本文揭示了ID偏移的一个关键来源是主体与场景语境之间的固有相关性,称为场景语境化,这种相关性在T2I模型拟合海量自然图像的训练分布时自然产生。我们形式化地证明了这种场景-ID相关性的近乎普遍性,并推导了其强度的理论界限。在此基础上,我们提出了一种新颖、高效、无需训练的提示嵌入编辑方法,称为场景去语境化(SDeC),该方法对T2I内置的场景语境化过程施加逆操作。具体而言,它通过量化奇异值分解(SVD)方向稳定性来自适应地重新加权相应特征值,从而识别并抑制ID提示嵌入中的潜在场景-ID相关性。关键的是,SDeC允许按场景使用(每个提示对应一个场景),而无需预先访问所有目标场景。这使其成为一种高度灵活且通用的解决方案,非常适合现实世界应用中此类先验知识通常不可用或随时间变化的情况。实验表明,SDeC在保持场景多样性的同时,显著增强了身份保持能力。