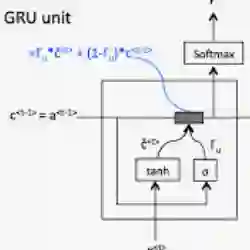

The prediction of time series is a challenging task relevant in such diverse applications as analyzing financial data, forecasting flow dynamics or understanding biological processes. Especially chaotic time series that depend on a long history pose an exceptionally difficult problem. While machine learning has shown to be a promising approach for predicting such time series, it either demands long training time and much training data when using deep recurrent neural networks. Alternative, when using a reservoir computing approach it comes with high uncertainty and typically a high number of random initializations and extensive hyper-parameter tuning when using a reservoir computing approach. In this paper, we focus on the reservoir computing approach and propose a new mapping of input data into the reservoir's state space. Furthermore, we incorporate this method in two novel network architectures increasing parallelizability, depth and predictive capabilities of the neural network while reducing the dependence on randomness. For the evaluation, we approximate a set of time series from the Mackey-Glass equation, inhabiting non-chaotic as well as chaotic behavior and compare our approaches in regard to their predictive capabilities to echo state networks and gated recurrent units. For the chaotic time series, we observe an error reduction of up to $85.45\%$ and up to $87.90\%$ in contrast to echo state networks and gated recurrent units respectively. Furthermore, we also observe tremendous improvements for non-chaotic time series of up to $99.99\%$ in contrast to existing approaches.

翻译:时间序列预测是一项具有挑战性的任务,在金融数据分析、流体动力学预测或生物过程理解等多种应用中具有重要意义。尤其依赖于长历史的混沌时间序列构成了一个异常困难的问题。虽然机器学习已被证明是预测此类时间序列的一种有前景的方法,但在使用深度循环神经网络时,它要么需要较长的训练时间和大量训练数据。替代地,当采用储备池计算方法时,它伴随着较高的不确定性,并且通常需要大量的随机初始化和广泛的超参数调优。在本文中,我们专注于储备池计算方法,并提出了一种将输入数据映射到储备池状态空间的新方法。此外,我们将此方法融入两种新颖的网络架构中,从而提高了神经网络的并行化能力、深度和预测能力,同时降低了对随机性的依赖。为了进行评估,我们近似了一组来自Mackey-Glass方程的时间序列,这些序列兼具非混沌和混沌行为,并将我们方法在预测能力方面与回声状态网络和门控循环单元进行了比较。对于混沌时间序列,我们观察到与回声状态网络和门控循环单元相比,误差分别降低了高达$85.45\%$和$87.90\%$。此外,我们还观察到对于非混沌时间序列,与现有方法相比,误差降低高达$99.99\%$,取得了巨大改进。