摘要——低秩自适应(Low-Rank Adaptation, LoRA)作为一种基础的参数高效微调(PEFT)方法,实现了大型神经网络中微调效率与性能之间的卓越平衡。然而,LoRA 变体的激增导致了研究在方法论、理论体系、代码实现以及实验评估等维度的碎片化。针对这一现状,本研究首次提出了 LoRA 变体的统一性研究,涵盖了系统的分类体系、统一的理论综述、结构化的代码库以及标准化的实证评估。 首先,我们从秩(Rank)、优化动力学(Optimization Dynamics)、初始化策略(Initialization)以及与混合专家模型(MoE)的集成这四个核心维度对 LoRA 变体进行了归类。随后,在专注于低秩更新动力学的统一理论框架下,我们梳理了各变体间的内在联系与演进逻辑。此外,本文推出了 LoRAFactory——一个模块化的开源代码库,该库通过统一接口实现了多种变体,支持即插即用的实验方案与细粒度的特性分析。 最后,依托该代码库,我们在自然语言生成(NLG)、自然语言理解(NLU)及图像分类任务中开展了大规模评估,并系统探讨了关键超参数的影响。研究发现:相比于其他超参数,LoRA 及其变体对**学习率(Learning Rate)**的选择具有极高的敏感性;此外,若超参数配置得当,原始 LoRA 的性能水平始终能够与大多数变体持平甚至实现超越。本文所有的代码与配置均已通过链接公开。 索引词——参数高效微调 (PEFT),低秩自适应 (LoRA),大语言模型 (LLMs),优化

I. 引言

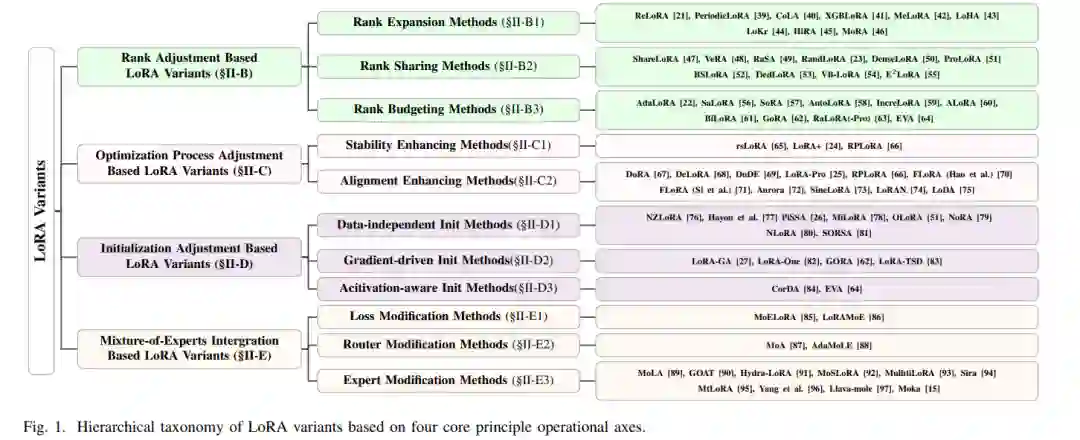

拥有数十亿参数的大规模模型(如大语言模型 LLM)在海量语料库上进行了预训练,已在各类任务中展现出卓越的性能,深刻改变了从自然语言处理到多模态推理的众多领域 [1]–[3]。然而,大模型的全量微调(Full Fine-tuning)极度消耗资源,这主要是由于存储优化器状态(Optimizer States)需要巨大的 GPU 显存。为了缓解这一负担,研究者提出了众多的参数高效微调(PEFT)方法 [4]–[8]。这些方法通过最小化可训练参数量或优化(特别是针对自适应优化器的)优化器状态管理,显著降低了显存占用 [9], [10]。因此,PEFT 方法还能通过减少通信开销,提升在 ZeRO [11] 和 FSDP [12] 等分布式框架下的训练效率。 低秩自适应(LoRA)[8] 已成为应用最广泛的 PEFT 方法之一。其普及得益于强大的实证性能、实现简单,以及在参数化知识存储 [13], [14]、多模态学习 [15], [16] 和联邦学习 [17], [18] 等领域的广泛通用性。尽管 LoRA 效率极高且效果显著(例如通过量化方法可在消费级 GPU 上微调 32B 规模的模型 [19], [20]),但它仍存在局限性,例如其低秩结构在面对复杂的下游任务时,往往与全量微调之间存在性能差距。 为了弥补这一差距,研究者开发了大量的 LoRA 变体,大致可归纳为以下几类:基于秩调整的变体(第 II-B 节),包括组合多个低秩更新子空间的 ReLoRA [21]、动态掩蔽次要秩的 AdaLoRA [22] 以及通过秩共享策略实现高秩训练的 RandLoRA [23];基于优化过程调整的变体(第 II-C 节),涵盖了通过解耦低秩权重学习率以提升优化稳定性的 LoRA+ [24],以及通过参数更新空间对齐来缩小与全量微调差距的 LoRA-Pro [25];基于初始化调整的变体(第 II-D 节),包括对预训练权重进行奇异值分解(SVD)以提取主导特征进行初始化的 PiSSA [26],以及对预训练权重梯度进行 SVD 初始化的 LoRA-GA [27];最后是基于混合专家模型(MoE)集成的变体(第 II-E 节),它们将 LoRA 与 MoE 机制结合以实现参数的自适应激活,例如将低秩更新分布到多个条件激活的专家中的 Mixture-of-LoRAs [28]。 尽管发展迅速,该领域仍存在关键空白。首先,现有的分类体系(无论是在通用的 PEFT 领域还是专门的 LoRA 领域)组织结构均较为宏观且表浅,未能建立一个针对 LoRA 变体核心操作维度的细粒度、系统化框架。其次,缺乏深度综述。 现有的 LoRA 调研未能对区分各类变体的理论基础、设计原则和运行机理进行透彻回顾。这一点结合许多提案中复杂的数学推导,阻碍了非专业人士的研究。第三,代码支持碎片化且笨重。 虽然流行的 PEFT 库 [29] 提供了基础的 LoRA 实现及实用功能(如多 LoRA 推理服务),但它仅支持有限的变体。更糟糕的是,其代码库已变得逻辑深嵌套且耦合严重,难以阅读和扩展。第四,评估标准不一且范畴受限。 原始 LoRA 论文使用 RoBERTa [30]、GPT-2 [32] 和 GPT-3 [34] 进行评估,而近期作品转向 LLaMA3 [37] 和 Qwen3 [38],导致了对比鸿沟。此外,尽管 LoRA 在各领域应用日益广泛,评估仍主要局限于语言任务。 为了应对上述挑战,本项工作展示了首个关于 LoRA 变体的统一研究: 1. 我们根据操作原则提出了一种结构化、细粒度的分类体系(图 1); 1. 基于该分类体系,我们在第 II 节中基于统一理论框架进行了深度综述; 1. 我们提供了一个清晰、模块化的代码库(详见第 III 节),将各变体实现为 LoRA 基类的子类,显著提升了可读性与扩展性; 1. 基于这些基础设施,我们启动了横跨自然语言生成、自然语言理解和图像分类三大维度的大规模实证研究,在广泛的超参数搜索下评估了 20 种被 AI/ML 顶级会议接收的代表性变体。

我们在第 IV 节中揭示了若干核心发现,特别是:只要配置适当的超参数,LoRA 即可达到或超越大多数变体的性能。 本研究为未来工作奠定了坚实基础,贡献总结如下: * 构建了 LoRA 变体的结构化分类体系,基于核心操作维度提供了一个细粒度的系统框架。 * 提供了 LoRA 变体的理论综述,植根于低秩自适应动力学建立了统一的理论基础,以促进学术理解。 * 推出了 LoRAFactory,实现了超过 50 种 LoRA 变体,它不仅是一个工具包,更支持标准化和可扩展的评估。 * 开展了大规模评估,在 3 种模型架构和 22 个任务上进行了超过 3000 次实验,涵盖 NLG、NLU 及图像分类。 * 揭示了若干关键发现,其中两点尤为显著:(1) 相比于其他超参数,LoRA 及其变体对学习率高度敏感;(2) 在超参数配置得当的情况下,LoRA 能与大多数变体性能持平甚至更优。