强化学习在近期的学术与商业研究项目中的应用,已催生出能够达到或超越人类表现水平的稳健系统。本论文的目标是确定通过强化学习训练的智能体是否能够在小型战斗场景中实现最优性能。在一系列计算实验中,训练在一个能够实施确定性与随机性战斗模型的简单聚合级、构造性仿真中进行,并通过集中兵力和节约兵力这两项战术原则来验证神经网络性能。总体而言,神经网络能够习得理想行为,其中战斗模型和强化学习算法对性能影响最为显著。此外,在集中兵力为最佳战术的场景中,训练持续时间和学习率被确定为最重要的训练超参数。然而,当节约兵力更为理想时,折扣因子是唯一具有显著影响的超参数。总而言之,本论文的结论是,强化学习为在战斗仿真中发展智能行为提供了一种有前景的方法,可应用于训练或分析领域。建议未来研究考察更庞大、更复杂的训练场景,以充分理解强化学习的能力与局限。

人工智能的能力在过去几十年稳步发展,已在跳棋、国际象棋和围棋等游戏中击败世界冠军级人类选手。然而,深度强化学习的最新进展现已使研究人员能够在流行的即时战略游戏和多人联机在线竞技游戏中达到职业人类水平,如《星际争霸II》和《DOTA 2》。与传统棋盘游戏不同,即时战略游戏和多人联机在线竞技游戏为玩家提供的是对环境的不完整描绘,要求基于估计和不完善信息做出决策。这为军事领域带来了机遇,因为在构造性仿真中表现出色的人工智能智能体有潜力改进专业军事教育、支持行动方案分析,并验证条令策略。

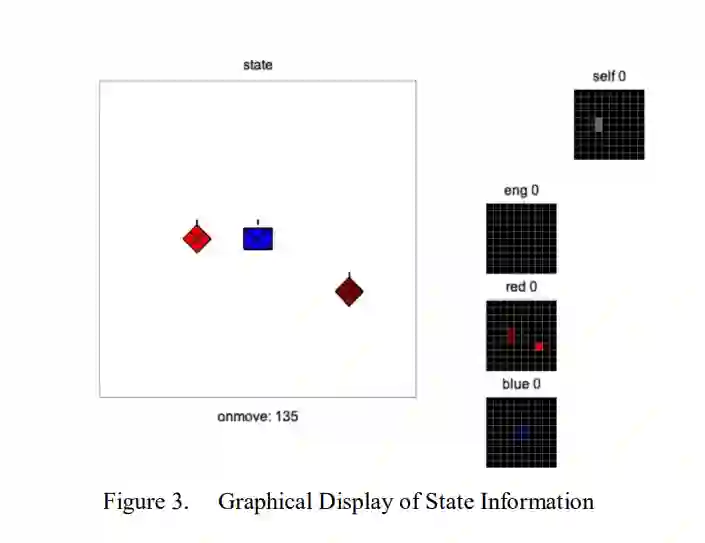

本论文所进行的研究考察了强化学习是否能够在小型战术交战中产生最优的进攻性人工智能假想敌行为。就此而言,最优行为与战术行为是不同的概念;然而,交战被设计为使最优行为符合战争的两项战术原则——集中兵力与节约兵力。人工智能智能体在一个回合制、聚合级的构造性仿真中接受训练,其中实体代表连级或排级规模的单位。这些实体进行机动的训练环境是一个十乘十的无特征平原,划分为六边形空间。因此,实体每回合能够以六种可能方向之一进行离散移动,这是兵棋推演中常用的方法。采用渐进式方法,训练前馈神经网络进行日益复杂的交战,包括二对一、二对二和三对二场景。在每种情况下,神经网络控制两个或更多红色进攻性假想敌实体,而静态的蓝色己方实体则保持固定防御。测试了数种不同的强化学习算法和大量神经网络训练超参数配置,以确定影响性能的主要因素。

本论文的第一部分通过测试几种不同的战斗模型和强化学习算法,考察了智能体能否在二对一场景中习得理想行为。在此情况下,智能体性能根据集中兵力这一战争原则进行验证,因为最佳行动方案是智能体同时将力量集中到对手单位上。总体而言,智能体习得了期望的行为,尽管在确定性战斗环境中训练的智能体通常优于在随机性环境中训练的智能体。具体来说,在确定性模型中训练的智能体在机动上更为同步,花费更少时间即可使两个人智能体控制的实体汇聚到对手单位上。下一个测试配置是二对二场景。同样地,该情况下的性能根据集中兵力原则进行验证,因为最佳策略是两个红色实体以先后顺序攻击并击败每个蓝色防御单位。此项任务也取得了成功,训练后的智能体以合理的顺序协同摧毁了对手。再次观察到,在确定性战斗模型中训练的智能体表现优于随机性模型中的智能体,显示出更快的集中兵力对抗对手的能力。

本论文的第二部分根据节约兵力这一战术概念验证了人工智能性能。在三对二场景中,三个人工智能控制的进攻连对阵一个静态排和一个以防御阵型部署的连。在此情况下,出现了两种不同的行为。第一种严格遵循集中兵力原则,所有三个人工智能控制的实体协同对敌方单位进行连续攻击。然而,第二种行为则展示了不同的战争原则——节约兵力,因为三个人工智能控制的实体分成了两组。在这种情况下,一组两个实体攻击连级规模单位,同时一个单独的实体牵制排级单位。这些行为之间的性能差异被发现与折扣因子有关。较低的折扣因子产生注重速度和节约兵力的智能体,而接近1的较大折扣因子则训练智能体集中攻击目标。此外,隐藏层的大小和数量似乎影响了整体性能质量,但这未被发现具有统计学显著性。

本论文的最后一部分比较了三种强化学习算法在实施确定性战斗模型的二对一场景中的性能,包括普通策略梯度算法、近端策略优化算法和信任域策略优化算法。就此而言,普通策略梯度算法与近端策略优化算法之间没有性能差异,而信任域策略优化算法通过表现出比近端策略优化算法和普通策略梯度算法更高的团队合作与协调水平,优于后两者。

总体而言,本论文表明强化学习技术能够在小型战斗场景中实现最优性能。研究发现,训练环境中实施的战斗模型类型和算法显著影响智能体性能,确定性战斗模型通常产生更优结果。此外,在智能体可以选择追求两种不同策略的场景中,所选的超参数,特别是折扣因子,将影响最终行为。虽然此项研究在将强化学习应用于军事领域方面取得了显著进展,但仍需研究更复杂多样的场景,以充分理解强化学习的能力与局限。