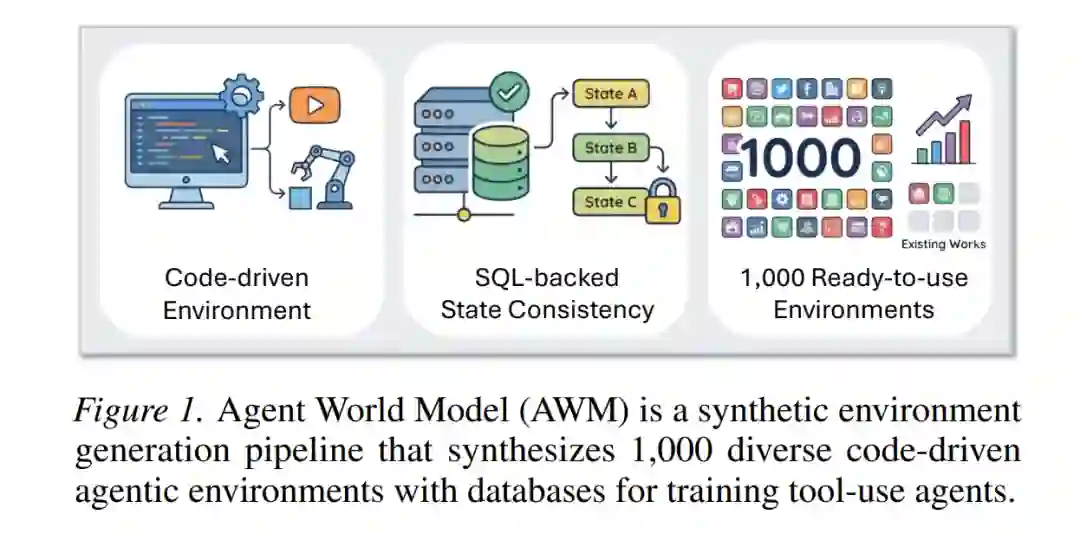

大语言模型(LLM)的最新进展赋予了自主智能体执行复杂任务的能力,这些任务通常涉及与工具及环境的深层多轮交互。然而,由于缺乏多样化且可靠的模拟环境,此类智能体训练的规模化(Scaling)仍面临严峻挑战。 在本文中,我们提出了智能体世界模型(Agent World Model, AWM)——一种全合成的环境生成流水线。依托该流水线,我们构建了涵盖日常场景的 1,000 个模拟环境。在这些环境中,智能体能够调用丰富的工具集(平均每个环境包含 35 个工具)并获取高质量的观测信息。显著之处在于,这些环境采用**代码驱动(Code-driven)并由数据库支撑,相较于基于 LLM 模拟的环境,能够提供更为可靠且一致的状态转移(State transitions)。此外,相较于从真实物理环境中采集轨迹(Trajectories),该方案显著提升了智能体交互的效率。 为验证该资源的有效性,我们针对多轮工具使用智能体开展了大规模强化学习。得益于环境的全程可执行性及可访问的数据库状态,我们得以设计高可靠性的奖励函数。在三个基准测试上的实验结果表明,仅在合成环境中进行训练(而非依赖特定基准的训练集),即可使智能体具备极强的分布外泛化(Out-of-distribution generalization)**能力。

1. 引言

大语言模型(LLMs)在指令遵循、推理、代码生成及工具使用方面取得了显著进展(Chen et al., 2021; Schick et al., 2023; OpenAI, 2025; Anthropic, 2025a; Comanici et al., 2025; Guo et al., 2025)。以 LLM 为驱动的智能体已成为处理现实环境中多步复杂任务的一种极具前景的范式(Nakano et al., 2021; Yao et al., 2023; Yang et al., 2024; Qin et al., 2024)。然而,此类智能体的训练通常需要针对多样化的环境进行大规模强化学习(RL),而这些环境相对资源匮乏且扩展成本高昂。 使用现实世界环境进行训练极其昂贵且难以规模化,因为许多场景并不开放公共 API,且 RL 训练通常要求智能体以稳定高效的方式与其进行数千次交互(Dulac-Arnold et al., 2021; Qin et al., 2024; Xu et al., 2024a; Luo et al., 2025)。人工创建的环境同样难以扩展且往往缺乏多样性。例如,$\tau^2$-bench (Barres et al., 2025) 和 TheMCPCompany (Esfandiarpoor et al., 2025) 分别仅包含 3 个和 5 个环境,这对于训练通用 AI 智能体而言远未足够。现有关于智能体的合成研究大多聚焦于任务合成(Wang et al., 2023; Chen et al., 2024; Xie et al., 2025; Patil et al., 2024; Wang et al., 2026)和轨迹采集(Xu et al., 2024b; Li et al., 2025a; Song et al., 2024),而非环境合成。另一类研究路径是模拟工具响应甚至整个环境,即每个状态转移均由 LLM 生成(Liu et al., 2024b; Lu et al., 2025; Li et al., 2025b;c; Chen et al., 2025)。然而,受限于幻觉问题(Wang et al., 2024; Kalai et al., 2025)及 LLM 高昂的推理成本,这种方法既不可靠也不高效。 这些局限性突显了一个缺失的环节:可扩展的环境合成。具体挑战在于如何大规模合成可执行且可靠的环境,从而实现可复现的智能体交互与学习。近几个月来,DeepSeek-V3.2 (DeepSeek-AI et al., 2025) 引入了一种合成流水线,为通用智能体创建了数千个可执行环境;而 Qwen 通义 (Fang et al., 2025) 也描述了一个环境合成流水线,但其主要用于监督微调(SFT)而非 RL 训练。基于代码(Code-based)的方法在构建此类大规模环境方面极具潜力,因为它可以控制状态转移并确保环境的一致性。然而,上述工作均未公开其生成流水线或开源环境。近期一些并行的社区尝试(Feng et al., 2025; Sullivan et al., 2025; Cai et al., 2025; Zhang et al., 2025a; Song et al., 2026)也在探索通过编程进行环境合成,但它们要么针对类游戏环境,要么依赖人工先验(如代码文档),或缺乏强大的状态一致性保证,且规模有限。 为解决这一问题,我们提出了 Agent World Model (AWM),这是一个能够大规模合成可执行工具使用环境的开源流水线。其核心洞察在于,智能体环境具有共同的结构:有状态的后端、工具接口层以及特定任务的成功准则。通过将合成过程分解为这三个组件,我们可以利用 LLM 系统化地生成每个部分,同时保持一致性。 我们的 AWM 镜像了现实中软件的构建流程。从高层次的场景描述(如“在线购物平台”)开始,我们首先生成用户在该场景中可能执行的常见需求(即任务)。随后,生成数据库模式(Schema)以定义满足这些用户需求所需的实体和关系。该模式能够指导接口层(工具集)的设计,并辅助生成接口的后端代码,确保每个工具都有清晰的数据模型支撑。这些接口通过 模型上下文协议 (Model Context Protocol, MCP) (Anthropic, 2024) 暴露,从而实现智能体与环境间统一的工具交互。最后,我们生成验证代码,通过对比智能体执行前后的数据库状态,辅助“LLM-as-a-Judge”为 RL 训练提供稳健的奖励信号。至关重要的是,每个阶段都包含自动化执行和简单的自校正机制:若生成的代码运行失败,我们将错误信息反馈给 LLM 进行修正。 该流水线使我们能够扩展至 1,000 个涵盖大多数现实场景(如购物、社交媒体、金融和旅游)的独特环境。每个环境都提供了一个可执行的沙箱,智能体可在其中与数十个工具交互;环境完全支持并行隔离实例,且易于重置或重启,这对于高效的在线 RL 至关重要。为了验证 AWM,我们执行了大规模 RL(每步包含 1,024 个环境实例),训练智能体使用 MCP 工具完成任务。与某些在测试环境中进行训练的工作不同,我们的环境和任务并未针对任何基准测试或特定场景进行定制。在三个工具使用基准测试上的实验结果证明了我们框架的泛化性能。综上所述,我们的贡献包括三个方面: 1. AWM:一个用于自动生成具有数据库支撑状态一致性的可执行工具使用环境的开源流水线; 1. 1,000 个即插即用的多样化环境,适用于大规模 RL 训练; 1. 实证结果表明,在 AWM 上训练的智能体能够泛化至分布外(OOD)环境。