近年来,大视觉语言模型 (LVLMs) 的迅猛发展促使多模态虚假新闻检测 (MFND) 领域发生了深刻的范式转换:即从传统的特征工程方法向统一的、端到端多模态推理框架演进。早期方法主要依赖浅层融合技术 (Shallow Fusion Techniques) 来捕捉文本与图像间的关联,但在应对高层语义理解及复杂的跨模态交互时往往力有不逮。LVLMs 的兴起从根本上重塑了这一研究格局,其凭借强大的表示学习 (Representation Learning) 能力实现了视听语言的联合建模,显著提升了识别跨文本叙述与视觉内容之误导信息的能力。

尽管进展显著,目前该领域仍缺乏系统性的综述来追溯这一演进路径并整合前沿发展。为填补这一空白,本文从 LVLMs 的视角出发,对 MFND 进行了详尽综述。首先,本文提供了一个历史演进视角,描绘了从传统多模态检测流水线向基座模型驱动范式 (Foundation Model-driven Paradigms) 跨越的蓝图。其次,我们构建了一个涵盖模型架构、数据集及性能基准的结构化分类体系 (Structured Taxonomy)。此外,本文深入探讨了尚存的技术挑战,包括可解释性、时序推理及领域泛化。最后,我们展望了未来的研究方向,旨在为该范式转换的后续阶段提供指引。据我们所知,这是首篇系统性记录并分析 LVLMs 在对抗多模态虚假新闻中变革性作用的综述文章。

1. 引言

虚假新闻在网络平台的快速扩散已演变为严峻的社会挑战 [1, 2, 3, 4],不仅侵蚀了公众信任 [5, 6, 7, 8],还动摇了民主话语权,并加剧了全球性危机(如 COVID-19 疫情及地缘政治冲突)[9, 10, 11, 12, 13]。不同于早期以文本为主的误导信息,现代虚假新闻活动日益利用多模态内容,将经过篡改的图像 [14, 15, 16, 17, 18]、误导性视频 [19, 20, 21] 以及逻辑自洽但在语义上具有欺骗性的说明文字 [22, 23] 相结合。这种对跨模态欺骗(Cross-modal deception)的日益依赖,使得传统的单模态检测技术难以为继,从而促使研究重心向多模态虚假新闻检测 (MFND) 转移 [24, 25, 18, 26]。 多模态虚假新闻检测旨在揭示文本、图像、视频及其他模态之间的不一致性,从而评估在线信息的真实性 [27, 28, 29]。然而,各模态间复杂的交互作用——如微妙的语义错配 [30, 31, 32, 33]、视觉蕴含冲突以及时序或上下文的不连贯——带来了巨大挑战 [34, 16, 35]。早期的 MFND 方法通常依赖晚期融合架构或浅层跨模态对齐,缺乏捕捉细微欺骗策略所需的语义深度和推理能力 [36]。

重要的是,MFND 中的跨模态不一致概念并非权宜之计,而是植根于视觉语言预训练 (VLP) 模型已证实的局限性。先沿研究表明,即使是大规模 VLP 模型在细粒度语义对齐方面也存在系统性缺陷,特别是在处理语言否定、属性归属及空间关系时 [37]。这些局限性对于虚假新闻检测尤为关键,因为欺骗性内容往往在维持表面连贯性的同时,违反了跨模态的隐性语义约束。正如 Wang 等人 [37] 所指出的,仅凭朴素的跨模态相似度无法可靠地识别此类不一致性,这揭示了缺乏显式语言基元(Linguistic grounding)的跨模态对齐的脆弱性。这一观察为 MFND 提供了理论基础,因为许多形式的多模态误导信息正是刻意利用了这些对齐盲点。

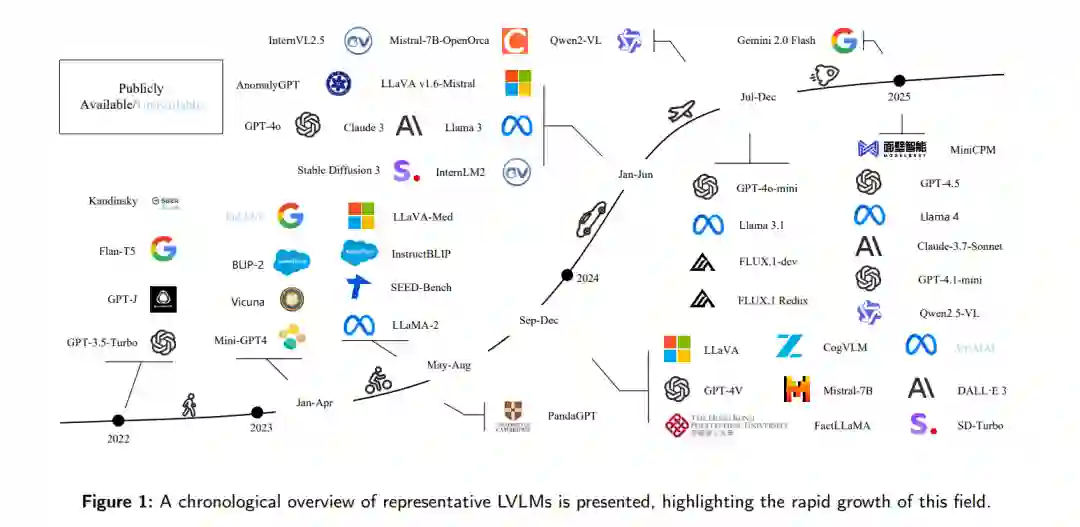

大视觉语言模型 (LVLMs) 的出现从根本上改变了这一现状 [38]。如图 1 所示,LVLMs 构建在大型语言模型 (LLMs) 和预训练视觉编码器的进步之上 [39, 40]。如 CLIP [41]、BLIP-2 [42]、Flamingo [43]、Kosmos-1 [44]、LLaVA [45] 及 GPT-4V [46] 等模型提供了能够进行跨模态联合表示学习与推理的统一架构 [47]。这些模型在图像-文本匹配 [48]、视觉问答 (VQA) [49] 以及多模态蕴含等任务上展现了卓越的零样本 (Zero-shot) 和少样本 (Few-shot) 性能,使其非常适合需要语义基元和跨模态验证的高阶虚假新闻检测任务 [50]。

尽管如此,LVLMs 在 MFND 中的应用仍显碎片化,缺乏系统性理解。现有研究在集成 LVLMs 的方式上差异巨大,包括架构设计、监督策略 [51]、任务形式 [52] 以及训练成本 [53]。为统一这一领域,我们提出了一种新型的三支路分类体系 (Three-branch taxonomy),将当前基于 LVLM 的 MFND 方法归纳为三种截然不同的范式: 1. 参数冻结型应用 (Parameter Freezing Applications):此类方法直接利用预训练 LVLMs 而不修改其内部参数 [54]。它们在冻结的主干网络之上采用上下文学习 (In-context learning) [55]、基于提示的适配 [56] 或轻量级分类头 [36]。该范式因其快速部署和高泛化性而在资源受限或实时应用中极具吸引力,但牺牲了一定的任务特定适配能力 [57]。 1. 参数微调型应用 (Parameter Tuning Applications):此类方法涉及对 LVLMs 进行全量或部分微调以增强任务对齐 [27]。技术手段包括全模型微调 [58]、适配器插入 (Adapter insertion) [59]、前缀微调 (Prefix tuning) [60] 或低秩适配 (LoRA) [61]。微调使模型能够捕捉领域特定语义 [62]、细微的模态不一致性 [63] 以及对于精准检测至关重要的上下文线索,尽管其对计算和数据量有更高要求 [64]。 1. 推理范式应用 (Reasoning Paradigm Applications):这一新兴范式侧重于 LVLMs 如何通过结构化的多步推理来提升检测精度。该范式强调使用多智能体系统 (Multi-agent systems) 或显式推理流水线,对多模态证据和声明进行序列化分析。代表性方法包括基于智能体的推理(将任务分解为证据检索和冲突分析等子任务)[65] 以及基于提示的推理(通过精心设计的提示引导模型完成推理过程)[66]。推理范式能够更深层次地理解复杂的误导信息,充分结合了预训练大模型的优势与特定任务的推理策略,但通常伴随着更高的推理成本和架构复杂度 [67]。

在本综述中,我们首次对大视觉语言模型在多模态虚假新闻检测中的应用进行了全面且结构化的回顾。本文的主要贡献总结如下: * 新分类体系:提出了针对 MFND 的新型三支路分类体系,将现有方法系统性地划分为参数冻结、参数微调及推理范式应用,并首次分析了结构化推理和智能体策略的变革作用。 * 全面综述:系统追溯了从单模态到多模态方法的演进,分析了代表性 LVLM 架构,并对比了其在各检测基准上的性能与设计原则。 * 统一框架:构建了涵盖模型设计、任务形式、训练范式及评估标准的结构化分析框架,为不同资源约束下的策略选择提供指导。 * 基准与评估:汇总并对比了 MFND 公开数据集的模态构成、标注策略及现实复杂度,并指出了当前评估指标的缺口。 * 挑战与未来方向:识别了多模态幻觉 (Hallucination)、跨模态偏差及数据稀缺等开放性问题,提出了反事实生成和知识增强适配等具有前景的研究方向。

本文结构安排如下:第 2 节介绍背景知识;第 3 节概述基于 LVLM 的检测范式;第 4-6 节分别讨论数据集、评估指标及实验结果对比;第 7-8 节探讨优缺点、挑战及未来方向;第 9 节总结全篇。