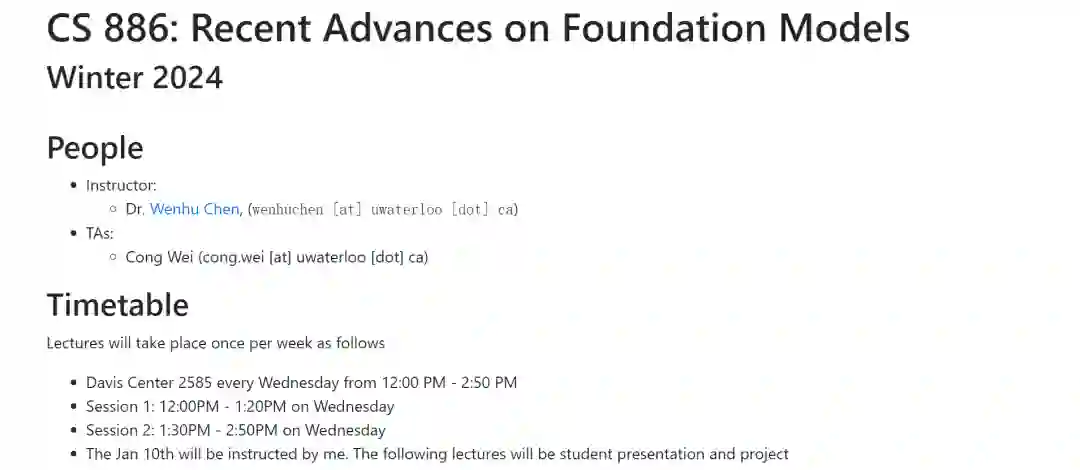

来自滑铁卢大学Wenhu Chen老师的课程“Recent Advances on Foundation Models”在滑铁卢大学是公开的。

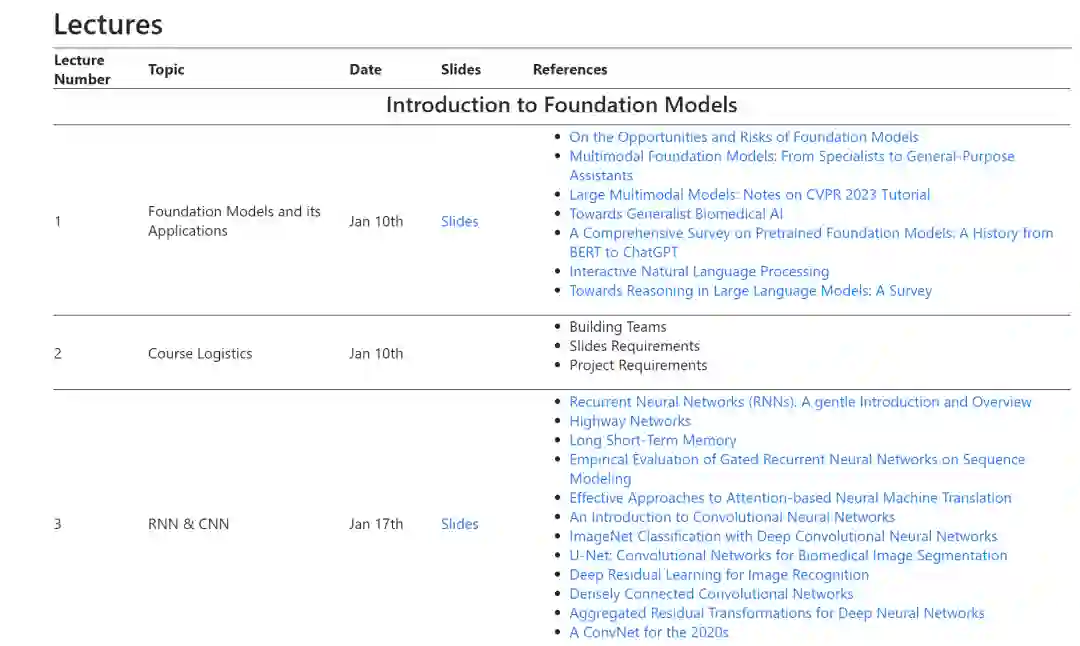

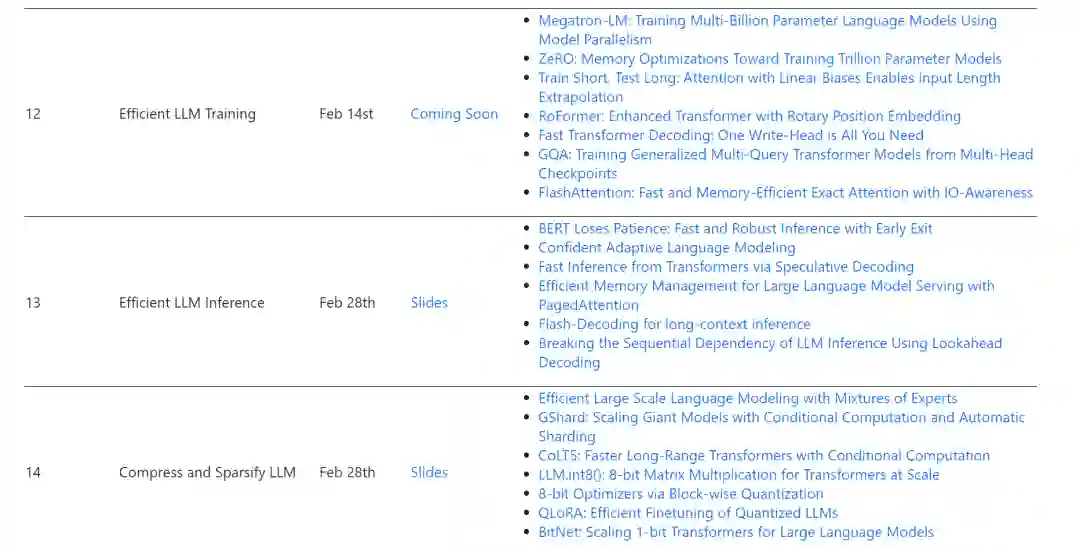

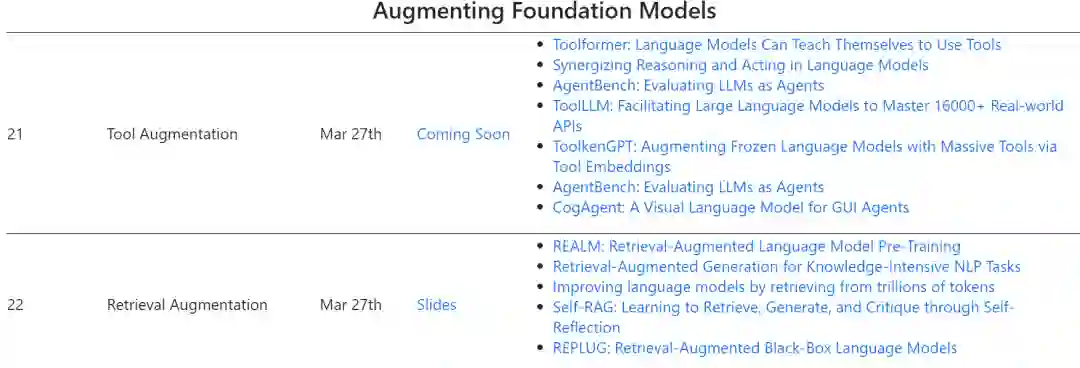

课程中,覆盖了许多有趣的话题,包括Transformers、LLM、预训练、量化、稀疏注意力、指令调整、RLHF、提示、视觉Transformers、扩散模型、多模态模型、代理、RAG等。 我将继续上传幻灯片(ppt)到网站上。其中一些很快也会有录制视频。现在已经有12个讲座幻灯片可用。这些幻灯片是由课程的出色参与者制作的。 https://cs.uwaterloo.ca/~wenhuche/teaching/cs886/

成为VIP会员查看完整内容

相关内容

大语言模型是基于海量文本数据训练的深度学习模型。它不仅能够生成自然语言文本,还能够深入理解文本含义,处理各种自然语言任务,如文本摘要、问答、翻译等。2023年,大语言模型及其在人工智能领域的应用已成为全球科技研究的热点,其在规模上的增长尤为引人注目,参数量已从最初的十几亿跃升到如今的一万亿。参数量的提升使得模型能够更加精细地捕捉人类语言微妙之处,更加深入地理解人类语言的复杂性。在过去的一年里,大语言模型在吸纳新知识、分解复杂任务以及图文对齐等多方面都有显著提升。随着技术的不断成熟,它将不断拓展其应用范围,为人类提供更加智能化和个性化的服务,进一步改善人们的生活和生产方式。