在本文中,我们提出了一种用于图像生成的 3D 资产参考扩散模型,旨在探索如何将 3D 资产集成至图像扩散模型中。现有的基于参考的图像生成方法主要利用大规模预训练扩散模型,展现出在单张参考图像约束下生成多样化图像的强大能力。然而,这些方法局限于单图参考,无法有效利用 3D 资产,从而限制了其实际应用中的通用性。

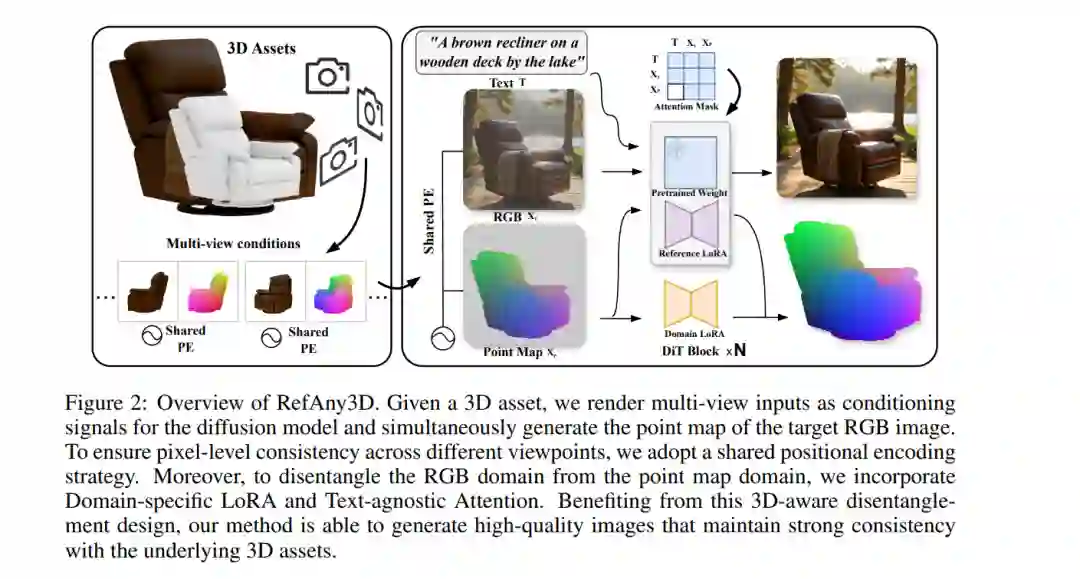

针对这一空白,我们提出了一种具备双分支感知能力的跨域扩散模型。该模型利用 3D 资产的多视图 RGB 图像和点图(point maps)来共同建模其颜色与规范空间坐标(canonical-space coordinates),从而实现生成图像与 3D 参考内容之间的精确一致性。我们设计的空间对齐双分支生成架构以及领域解耦生成机制,确保了两个在空间上对齐但在内容上解耦的输出(即 RGB 图像和点图)能够同步生成,进而将 2D 图像属性与 3D 资产属性建立关联。

实验结果表明,本方法能够有效地将 3D 资产作为参考,生成与给定资产保持一致的图像,为扩散模型与 3D 内容创作的结合开辟了新的可能性。

项目主页:https://judgementh.github.io/RefAny3D

成为VIP会员查看完整内容