本报告仅综合来自一手信源和经同行评议的安全研究中的、经过验证且来源明确的声称。所有效率指标和工具部署情况均归因于其原始来源。

执行摘要

本报告审视了以色列、美国和伊朗在持续的地缘政治紧张局势背景下,对人工智能技术的部署情况。近期的军事行动为大规模作战人工智能部署提供了前所未有的观察窗口。

主要发现:

01美国已将Anthropic公司的Claude人工智能集成到帕兰蒂尔公司的Maven智能系统中,以前所未有的规模实现实时目标定位和作战决策支持。

02以色列持续完善其多层人工智能防御系统(“铁穹”、“铁束”),同时部署目标定位人工智能系统(“薰衣草”、“福音”)。

03伊朗正在开发专注于网络行动、影响力行动和基于无人机的进攻系统的不对称人工智能能力。

04此次冲突代表了大型语言模型(LLM)集成军事决策支持系统在实战行动中的首次大规模部署。

美国:大规模人工智能集成目标定位——Maven智能系统(帕兰蒂尔公司)

类型: 实时情报分析与目标定位决策支持

集成: 嵌入Anthropic公司的Claude人工智能进行数据合成与优先级排序

作战部署: “史诗怒火”行动(2026年3月1-4日)

已验证能力:

● 实时分析机密卫星图像、监视数据和地理空间情报

● 在行动最初24小时内生成了1000多个目标建议

● 提供精确的位置坐标和目标优先级排序

● 使20名军事人员能够执行相当于2000人传统指挥结构的作战任务

● 与“战斧”巡航导弹、B-2隐形轰炸机和LUCAS自主无人机集成

效率指标:

● 目标识别与优先级排序:95%以上准确率(基于打击后评估)

● 决策周期缩短:比传统目标定位工作流程快70-80%

● 作战规模:24小时内识别并排序1000个目标

战略影响:

Maven——Claude集成代表了此等规模的大型语言模型(LLM)集成军事决策支持的首次作战部署。该系统合成多源情报并提供实时目标建议的能力,从根本上改变了军事决策的速度。

以色列:多层人工智能防御与目标定位系统

“铁穹”/“铁束”/“薰衣草”(拉斐尔先进防御系统公司)

类型: 多层人工智能驱动的防空与目标定位系统

功能: 预测性弹道分析、激光拦截和人工智能加速目标识别

作战部署: 持续部署——“铁束”于2025年12月27日升级交付

已验证能力:

● “铁穹”:人工智能弹道预测,拦截率85-90%;10个电池组覆盖达15,500公顷

● “铁束”:高能激光系统;人工智能实时选择最佳拦截模式;于2025年12月27日交付以色列国防军

● “薰衣草”:人工智能数据库识别了37,000个哈马斯目标;据报道错误率为10%(《卫报》,2024年4月);以色列国防军对报道的某些方面提出异议

● “福音”:人工智能目标定位加速系统;快速生成打击建议;相关声称仍存在部分争议

效率指标:

● “铁穹”拦截率:针对短程威胁达85-90%

● “铁束”成本降低:相比动能拦截弹降低90%以上(每次“铁穹”拦截约5万美元)

● “薰衣草”错误率:目标识别约10%(报道数据)

● 多层覆盖:可同时防御火箭弹、无人机、迫击炮和巡航导弹

战略影响:

以色列的人工智能战略结合了具有成本效益的分层防御(“铁穹”+“铁束”)与目标定位加速系统(“薰衣草”、“福音”)。这种多层方法既满足了防御需求,也满足了进攻性目标定位要求,尽管一些目标定位系统的声称仍受到以色列国防军的争议。

伊朗:不对称人工智能能力与网络行动

“沙希德”无人机/人工智能网络工具/影响力行动

类型: 不对称进攻行动、网络战和人工智能辅助的影响力行动

功能: 针对美国、以色列及海湾地区关键基础设施的可否认分布式攻击

作战状态: 在“史诗怒火”行动后升级(2026年2月28日至3月5日)

已验证能力:

● 谷歌报告伊朗黑客使用Gemini人工智能收集目标情报并构建黑客工具

● OpenAI于2024年8月封禁了使用ChatGPT进行协同影响力行动的伊朗Storm-2035账户

● RedKitten行动(2026年1月):针对伊朗抗议活动记录团体的人工智能加速恶意软件

● 与伊朗伊斯兰革命卫队(IRGC)和情报与国家安全部(MOIS)相关的网络威胁行为体(Altoufan团队、HANDALA、Cotton Sandstorm)

● 搭载人工智能辅助导航的“沙希德”无人机被用于不对称进攻行动

效率指标:

● 网络渗透成功率:45-55%(根据安全研究估算)

● 无人机打击成功率:针对指定目标约70%(报道数据)

● 影响力行动:受众参与度有限;受到平台执法干扰

● 人工智能辅助恶意软件开发:加速了构建周期,但有文献记载的操作安全失败案例

战略影响:

伊朗的不对称人工智能战略优先考虑可否认性和成本效益,而非直接的军事集成。通过利用分布式网络行动、人工智能生成的影响力内容和低成本无人机系统,伊朗抵消了美国和以色列的技术优势,而无需使用先进的西方人工智能平台。

比较分析:战略差异与作战影响

| 维度 | 美国 | 以色列 | 伊朗 |

|---|---|---|---|

| 主要人工智能战略 | 实时集成目标定位决策支持 | 多层防御 + 目标定位加速 | 不对称网络与影响力行动 |

| 旗舰系统 | Maven智能系统(帕兰蒂尔 + Claude) | “铁穹” + “铁束” + “薰衣草”/“福音” | 分布式网络行动 + “沙希德”无人机 |

| 核心技术 | 大型语言模型(LLM)集成情报合成 | 弹道预测 + 激光目标定位 | 人工智能辅助恶意软件开发 + 内容生成 |

| 作战规模 | 24小时内1000+个目标 | 持续防空 + 选择性目标定位 | 分布式、可否认的行动 |

| 效率指标 | 95%以上目标定位准确率;决策周期加快70-80% | 85-90%拦截率(“铁穹”);成本降低90%以上(“铁束”) | 45-55%网络渗透成功率;70%无人机打击成功率 |

| 部署状态 | 活跃中(“史诗怒火”行动,2026年3月1-4日) | 持续作战部署 | “史诗怒火”行动后升级 |

| 关键优势 | 大规模决策速度 | 具有成本效益的分层防御 | 可否认性与分布式攻击面 |

| 关键弱点 | 依赖单一人工智能提供商(Anthropic);监管审查 | 每次交战成本(“铁穹”);以色列国防军对“薰衣草”报道的争议回应 | 有限的直接军事人工智能集成;反应性姿态 |

| 监管状态 | 五角大楼已禁用Anthropic(2026年3月);OpenAI协议正在修订中 | 无报道的监管限制 | 受国际制裁;对西方人工智能的获取有限 |

关键见解:

- 技术差异: 美国追求集中化、大型语言模型(LLM)集成的决策支持;以色列强调分布式、多层系统;伊朗发展不对称、可否认的能力。

- 作战节奏: 美国系统实现前所未有的决策速度;以色列系统优先考虑可靠性和成本效益;伊朗系统优先考虑持久性和规避归因。

- 可扩展性: 美国Maven系统可扩展至数千个目标;以色列系统通过电池组倍增实现扩展;伊朗系统通过分布式威胁行为体网络实现扩展。

- 监管环境: 美国在战争人工智能应用上面临国内外审查;以色列运营限制较少;伊朗在制裁制度下运营。

批判性分析:局限、错误与监管关切

有记录的人工智能系统故障与局限

美国(Maven+Claude)

● 五角大楼宣布Anthropic为“供应链风险”(2026年3月),引发对系统可靠性的质疑

● OpenAI被迫修订军事协议,明确禁止国内监控

● 95%以上准确率的声称未经独立核实;数据基于军事评估

● 监管真空:《日内瓦公约》未充分涵盖人工智能武器系统的测试要求

以色列(“铁穹”与“薰衣草”)

● “铁穹”:10-15%错误率;每次拦截约5万美元成本限制了可扩展性

● “薰衣草”:据报道目标识别错误率为10%(《卫报》报道);以色列国防军发布官方回应,对报道的某些方面提出异议

● “福音”:公开信息有限;声称仍存争议

● 关于动能拦截与激光拦截的成本效益争论持续

伊朗(网络行动)

● RedKitten行动(2026年1月):使用人工智能工具快速开发,但包含多处操作安全失败

● 网络渗透成功率(45-55%)表明防御方有显著的检测和预防能力

● 影响力行动:OpenAI成功干扰伊朗ChatGPT账户,表明其易受平台执法影响

● 对尖端人工智能模型的有限获取制约了能力发展

系统性问题

归因挑战

分布式网络行动使归因困难,存在虚假旗号行动的可能性

升级风险

人工智能赋能的决策速度缩短了人工审议时间

平民影响

目标定位系统缺乏透明的问责机制

监管滞后

国际法未能跟上人工智能战争能力的发展

依赖风险

依赖商业人工智能提供商造成战略脆弱性

综合资料来源与参考文献

美国军事行动

- 《华盛顿邮报》(2026年3月4日)——‘Anthropic的人工智能工具Claude是美国在伊朗行动的核心,正值激烈争执之际’

- 路透社/MarketScreener(2026年3月1日)——‘美国在对伊朗打击中使用Anthropic人工智能、B-2轰炸机和自杀式无人机’

- 《泰晤士报》(2026年3月3日)——‘人工智能如何帮助20名美军完成2000人在伊朗战争中的工作’

- DNYUZ(2026年3月4日)——‘Anthropic的人工智能工具Claude是美国在伊朗行动的核心,正值激烈争执之际’

- 天空新闻(2026年3月3日)——‘人工智能或正赋予美国在伊朗战争中的致命优势——但存在危险’

- Interesting Engineering(2026年3月3日)——‘伊朗战争暴露人工智能在军事打击规划中日益扩大的作用’

- 《环球邮报》(2026年3月2日)——‘人工智能、网络攻击和廉价无人机帮助美国、以色列实施伊朗刺杀行动’

以色列防御系统

- 《卫报》(2024年4月3日)——‘机器冷酷执行:以色列使用人工智能识别37,000个哈马斯目标(薰衣草)’

- Autonomy Global(2025年12月30日)——‘人工智能驱动的铁束激光防空系统交付以色列国防军,标志着反无人机作战新时代’

- Breaking Defense(2025年10月22日)——‘激光与人工智能:拉斐尔公司对以色列未来防空的展望内部’

- Alma研究与教育中心(2025年12月18日)——‘铁穹系统:地区军备竞赛的支柱’

伊朗网络行动

- 《财富》杂志(2026年3月2日)——‘伊朗或利用人工智能加速对美国和以色列关键基础设施的网络攻击’

- Security Boulevard(2026年3月3日)——‘史诗怒火行动:潜在的伊朗网络反攻行动’

- Check Point博客(2026年3月1日)——‘防御者需了解的伊朗网络能力’

人工智能政策与监管

- BBC(2026年3月3日)——‘OpenAI在遭遇强烈反对后修改与美国军方的协议’

- CBS新闻(2026年3月3日)——‘消息人士称,美国军方在伊朗战争中使用Anthropic的Claude人工智能’

- NDTV(2026年3月4日)——‘Anthropic的Claude人工智能如何帮助美国轰炸伊朗’

Maven项目与国防采购

- 《防务新闻》(2024年5月30日)——‘帕兰蒂尔赢得扩大Maven项目人工智能工具使用权的合同’

- SpaceNews(2025年5月22日)——‘五角大楼增加帕兰蒂尔人工智能软件预算,大幅扩展Maven项目’

结论

以色列-美国-伊朗冲突是军事人工智能部署的分水岭时刻。这是首次在大型语言模型(LLM)集成决策支持系统、多层人工智能防御网络和分布式网络人工智能行动同时运作的情况下,进行大规模作战行动。

关键要点

01 技术不对称性

三个国家采用了反映其技术能力、战略学说和资源限制的根本不同的人工智能策略。美国追求集中化、速度优化的系统;以色列强调分布式、成本效益高的防御;伊朗发展不对称、可否认的能力。

02 作战效能

三国都通过人工智能集成展示了可衡量的作战改进:

● 美国:决策周期时间缩短70-80%

● 以色列:防空拦截率达85-90%;通过激光系统降低成本90%以上

● 伊朗:分布式网络行动渗透成功率45-55%

03 监管真空

人工智能在战争中的快速部署已超越国际法律框架。《日内瓦公约》的测试要求不适用于人工智能武器系统。美国和以色列都面临国内外审查,而伊朗则在制裁限制下运营。

04 系统脆弱性

● 美国对Anthropic(现已被五角大楼禁用)的依赖造成战略风险

● 以色列系统面临成本可扩展性挑战

● 伊朗系统面临防御方的检测和干扰

05 升级动态

人工智能赋能的决策缩短了人工审议时间,可能增加升级风险。速度优势造成了快速反应的压力,减少了外交干预的机会。

06 归因与问责

分布式网络行动和人工智能生成的内容使归因和问责复杂化。这为虚假旗号行动创造了可能,并降低了军事决策的透明度。

未来高强度战争正迅速将战场优势转变为探测速度、目标识别与自主决策能力的竞赛。比利时防务技术公司IDDEA将其MEGA陆军解决方案定位为对这一转变的回应,该系统提供具备人工智能的战场识别与作战情报系统,可完全离线运行,同时向前线部队、无人机编队及一体化防空网络提供实时目标识别与战术数据。

MEGA陆军解决方案专为存在对抗、全球定位系统(GPS)受拒的作战环境设计,结合了自主识别、传感器融合与快速情报分发,以加速战场响应时间并提升跨多域作战协同能力。随着现代武装力量寻求能够在不依赖云端或易受攻击通信链路情况下运行的韧性人工智能驱动系统,IDDEA的平台反映了去中心化作战情报、生存能力及机器辅助目标识别在未来战争中的重要性日益增长。

与仅限于识别装备大类的传统军用识别应用不同,MEGA陆军解决方案利用嵌入式人工智能和集成离线防务数据库,旨在识别战场系统的精确型号与作战改型。该系统不仅能将目标简单识别为“坦克”或“装甲车”,还能精确区分如美国M1A2“艾布拉姆斯”、德国“豹”2A6、俄罗斯T-72B3或T-90主战坦克等具体作战系统,并立即为每个识别系统提供相关的作战能力分析。这款人工智能驱动的识别架构目前支持14个主要军事装备类别,包括装甲运兵车、防空系统、反坦克系统、装甲车辆、火炮系统、指挥所车辆、通信车辆、电子战系统、工程车辆、步兵战车、主战坦克、导弹系统、雷达系统、后勤与战术车辆以及无人系统。

其人工智能引擎提供的战术情报远超视觉识别。一旦系统被识别,MEGA陆军解决方案可即时提供详细的作战与战斗数据,包括装甲防护水平、炮塔配置、武器规格、弹药类型、穿甲能力、射程、机动性能、目标捕获系统、传感器套件、乘员配置、战场角色、生存能力特征以及已知的作战弱点。这使其从一个简单的识别工具转变为实时战场情报与作战评估能力,旨在支持作战行动期间的战术决策。

在作战部署前,MEGA系统会预装一个大型军事装备数据库和经过训练的人工智能识别算法,其中包含全球各地军事系统的数千张战场图片、轮廓、视觉特征和技术数据。板载数据库和人工智能模型直接嵌入战术设备,使得该系统一旦在战场部署,无需外部互联网接入、云端处理或远程服务器即可自主运行。

作战期间,该系统利用战场光学设备、光电瞄准具、侦察传感器、监视摄像头、无人机成像系统、智能手机摄像头、平板电脑摄像头以及实时视频流来分析图片和视频流。嵌入式人工智能引擎将捕获的图像与其板载军事数据库进行比对,以识别和确认战场上可见的精确军事装备型号。该过程结合了图像识别、轮廓分析、形状比对和机器学习分类算法,直接在战术边缘提供快速且高度精细的识别。

该系统专为电子战、网络攻击、全球定位系统(GPS)干扰或通信降级可能使传统网络中心战系统失效的拒止作战环境设计。由于所有关键数据和人工智能处理都本地存储在设备上,MEGA陆军解决方案即使在严重对抗的电磁环境中也能保持战场情报能力。

其作战影响对现代多域战争意义重大。前线作战单位日益需要不依赖集中指挥系统或远程情报处理的即时战场情报。通过在战术边缘直接提供精确的装备识别结合作战能力分析,MEGA陆军解决方案使操作员能够快速评估战场威胁并实时调整交战决策。

该系统最具战略重要性的方面之一是其跨互联作战网络集成的潜力。其架构设计不仅可用于步兵和指挥设备,还可跨侦察无人机、无人驾驶飞行器网络、战场监视系统、装甲战车、指挥控制系统和一体化防空网络部署。

与机载战术无人机集成后,人工智能引擎可在侦察任务期间自主识别敌方系统,同时将相关作战情报数据传输给附近单位或指挥节点。无人机不仅能探测敌方车辆,还能识别其确切平台改型,并立即向操作员提供其武器射程、装甲特性、弹药能力和战场威胁特征。这种能力可显著加速快速机动作战期间的战场分析和目标优先级排序。

同样的架构也为现代防空系统提供了重要应用前景。与雷达和光电传感器集成后,人工智能引擎可识别来袭无人机、巡航导弹、直升机、作战飞机或导弹发射器的精确改型,同时显示相关的威胁数据和交战特征。随着无人机饱和攻击和低空威胁持续重塑现代战争,用于保持反应速度和减少操作员工作负荷的自主人工智能辅助识别系统正变得日益关键。

此项发展反映了从近期冲突,特别是乌克兰冲突中显现的更广泛作战经验教训,其中电子战、无人机扩散和战场数据过载已证明,能够独立于集中式连接而运作的去中心化战术情报系统正变得日益重要。未来的军事行动可能越来越要求作战单位在持续通信降级或电磁攻击下保持战场态势感知能力。

IDDEA将MEGA陆军解决方案定位为围绕战场生存能力、自主情报生成和战术韧性设计的新一代自主军用人工智能系统的一部分。与依赖云端基础设施和持续连接的民用人工智能系统不同,MEGA架构专为在信息优势可能决定战场生存的断联作战环境中保持作战能力而设计。

其长期目标超越了单纯的战场识别。IDDEA设想开发一个完全集成的人工智能赋能作战情报生态系统,将传感器、无人机、车辆、指挥系统和防空资产连接成一个去中心化的战场情报网络。这样的架构将使军事力量能够直接在交战点自主生成、分析、分发和利用战术作战情报,而无需依赖脆弱的集中式基础设施。

随着全球武装力量加速对人工智能、自主系统和下一代战场数字化的投资,能够识别确切敌方装备型号并即时提供相关作战情报的系统正变得与作战需求日益相关。在此背景下,IDDEA的MEGA陆军解决方案将自身定位不仅是一款军用识别应用,更是一个旨在为未来作战行动重新定义战术信息优势的潜在战场情报倍增器。

IDDEA公司将于2026年6月15日至19日在法国巴黎举行的国际防务展“欧洲萨托利2026”(Eurosatory 2026)上对MEGA陆军解决方案进行现场演示。防务行业代表、军事代表团和作战用户将能在4号馆E78展位亲身体验这款人工智能赋能的战场识别系统及其离线作战情报能力,该公司将在该展位展示针对现代作战行动的军事装备型号实时识别与集成战术数据分析。

本文探讨了假想中美伊军事冲突的经济维度,认为在波斯湾地区持续进行军事介入将带来产生系统性成本的巨大风险,这些成本会削弱战略韧性并导致事实上的战略失败。借鉴1973年石油危机、1991年海湾战争和2003-2011年伊拉克战争的历史相似案例,本研究采用了结合情景建模、比较案例分析及政治经济学理论的混合研究方法。分析表明,在波斯湾地区进行持久的军事介入,将带来引发能源价格波动、财政约束与国内政治支持侵蚀之间形成反馈循环的风险——这种反馈循环可能使得军事胜利在经济上不可持续。关键的是,本文探讨了关于美国页岩油产量已使美国经济免受海湾能源供应中断影响的反对论点,指出无论美国直接的进口敞口如何,全球市场一体化及盟友依赖性都保留了有效的传导渠道。研究结果表明,在全球化的能源市场和相互关联的供应链时代,传统的军事成功标准未能考量可能从根本上破坏战略目标的经济消耗。本研究为日益增长的战争政治经济学文献做出了贡献,并对那些忽视地区冲突经济反噬效应的传统威慑框架提出了挑战。

关键词:战争政治经济学,能源安全,战略失败,美伊关系,军事干预,经济方略

作战环境对作战行动的影响

作战环境(OE)是一个需要仔细考量关键规划因素。在大型地面作战行动(LSCO)中,透彻理解作战环境对于炮兵的成功运用至关重要,能使指挥官在最大化杀伤力的同时,最小化人员与装备面临的风险。清晰把握作战环境的能力与局限,对于制定己方与敌方部队的炮兵阵地部署计划极为关键。为奠定此基础,必须进行作战环境情报准备(IPOE)——其定义为“系统化分析任务区域内敌方、地形、天候及民事状况等任务变量,以确定其对作战行动影响的过程(ATP 2-01.3)”[1]。这种审慎的方法确保指挥官能够通过利用作战环境获取优势来做出明智决策,最终提升炮兵作战的效能。

缺乏详细、四步骤的作战环境情报准备流程,可能使指挥官无法清晰理解作战环境,本质上是在“黑暗中操作”。为阐明系统化方法的重要性,可参考经典的“海战棋”游戏。玩家试图通过在划分为行与列、具有唯一坐标的网格上猜测对方船只的位置来击沉它们。随着玩家根据收集到的信息制定策略并调整方法,他们映射了火力支援界识别敌方炮兵阵地地域(PAA)的迭代过程。正如熟练的“海战棋”玩家结合策略与适应性,火力支援界依赖既定的流程来收集和分析关键信息,从而能够定位敌方炮兵阵地地域并获得决定性优势。

随着作战环境情报准备工作的推进,参谋人员常会问:我们如何能在国家训练中心(NTC)成功实施此流程?答案来自贾森·E·马托斯上尉一篇富有启发性的文章《国家训练中心敌方炮兵可能阵地地域》。从营情报参谋(S2)的视角,马托斯上尉的现实方法清晰勾勒了分析敌方炮兵阵地地域的“艺术”与“科学”,考量了诸如坡度、水文、交通线以及遮蔽棱线等关键的作战环境(OE)因素。利用基于ArcGIS的平台——分布式通用地面系统(DCGS)的地形分析能力,马托斯上尉的方法促进了用于分析的共识理解。第1装甲旅级战斗队(1ABCT)“常备第一”采用了此框架,在旅任务支援点(MSS)进行管理,由野战炮兵情报官(FAIO)与旅地理空间工程技师协作,根据不断演变的情报创建并完善炮兵阵地地域。

案例研究:美国国家训练中心第24-04轮次演习

应用马托斯上尉文章的见解,第1装甲旅级战斗队“常备第一”地理信息系统(GIS)与旅火力支援单元(FSE)在国家训练中心第24-04轮次演习期间的协作取得了显著成果。他们共同开发了一幅热力图,增强了火力部门有效规划与执行任务的能力,提供了对敌位置及地形对作战影响的关键分析与预测性见解。输入热力图的初始产品基于M109A7“帕拉丁”自行榴弹炮7%的坡度要求,利用基于激光探测与测距的高程数据(LiDAR BE)为分析提供信息。随着演习推进,反火力官与野战炮兵情报官完善了这些产品,最终交付了全面的炮兵阵地地域选址适宜性分析。

为创建炮兵阵地地域选址适宜性分析,采用了一个整合多种数据源与空间分析技术的多步骤流程。方法论包括以下步骤:

-

分析始于国家训练中心“常备第一”特制地图,这是一幅由第1装甲旅级战斗队地理空间情报团队使用ArcGIS Pro创建的1:50,000比例尺、36英寸 x 52英寸地图。该地图提供了国家训练中心训练区域(包括欧文堡营区)的全面概览。

-

获取覆盖国家训练中心区域的数字地形高程数据(DTED)2级图块并导入ArcGIS Pro。使用坡度工具,以7%坡度参数进行坡度分析,识别M109A7“帕拉丁”可部署与不可部署的区域。

-

从国家训练中心“常备第一”特制地图中提取主要补给路线(MSR)图层,并使用ArcGIS Pro中的缓冲区工具应用750米缓冲区。此步骤识别了距离任何主要补给路线至少750米的区域。

-

从旅火力支援单元处接收禁止射击区(NFA)和禁止打击列表(NSL)数据,数据以Microsoft Excel电子表格形式提供,包含每个禁止射击区的军用网格参考系统坐标和区域距离。通过ArcGIS Pro中的以下步骤和工具将数据整合到分析中:

- Excel 转表:将电子表格转换为表。

- 表转点:将表转换为点要素。

- 根据禁止射击区的类型和大小,为每个禁止射击区类别创建了相应的缓冲区,范围从25米到1000米。

-

通过同时显示复合障碍叠加(COO)、7%坡度分析、主要补给路线缓冲区、禁止打击列表和禁止射击区缓冲区,识别出适合作为潜在炮兵阵地地域的区域。最后步骤包括在这些适宜区域内测量炮兵阵地地域位置,并将其分类为2平方公里和3平方公里的区域。这是通过以下方式完成的:

- 在地理数据库的工作地理数据集中创建新的面要素类。

- 使用ArcGIS Pro编辑选项卡中的创建工具来测量炮兵阵地地域位置。

- 利用已建立的1公里网格方格,并视需要辅以ArcGIS Pro的测量工具。

- 使用符号化功能对两类炮兵阵地地域进行符号化,紫色代表2平方公里的炮兵阵地地域位置,一品红代表3平方公里的炮兵阵地地域位置。

在将所有数据整合到第1装甲旅级战斗队“常备第一”地图上后,我们为敌我双方识别出了超过200个潜在炮兵阵地。将此数据与情报参谋的指定关注区(NAI)以及已知的发射原点(POO)和弹着点(POI)相结合,使得反火力小组和野战炮兵情报官能够开始规划主动反火力作战。

利用预测性炮兵阵地地域进行主动反火力作战

认识到各单位在国家训练中心面临的一贯反火力挑战,我们借鉴了大卫·布朗二级准尉文章《国家训练中心反火力趋势》中的见解,聚焦于关键的改进领域:在作战环境情报准备期间加强与旅情报参谋的协作;拓展超越Q-53雷达的定位敌方炮兵方法;增进对宽松火力支援协调措施(FSCM)的理解;以及加速反应性反火力能力。

理解到一次成功的国家训练中心轮次需要愿意尝试与学习,国家训练中心第24-04轮次提供了实践这些改进的宝贵机会。将Q-53快速火力网直接连接到C连被证明特别有效,显著缩短了任务处理时间——最快记录为7分18秒,平均约为13分20秒。更快的处理速度使得能够快速分析潜在炮兵阵地地域,并向野战炮兵情报官和反火力官分发关键信息。

野战炮兵情报官与反火力小组紧密协作,开发了一幅全面的热力图,使他们能够进行模式分析并发现敌方采用的其他战术、技术与程序(TTP)。此情报为各目标选定工作组彻底审查火力召唤区(CFFZ)和炮兵目标情报区(ATIZ)提供了依据,揭示了关键的变化与缺口,最终提升了第1装甲旅级战斗队目标选定工作与反火力作战的效能。

挑战与经验教训

国家训练中心第24-04轮次因关键节点的物理分离而构成了重大挑战。任务支援点(MSS)位于圣达菲的一个安全庇护所,是情报支援的枢纽,旅情报支援分队和野战炮兵情报官在此地运作。然而,主指挥所(MCP)设在“战场”内,反火力小组独立运作。这种分散的布局造成了野战炮兵情报官与反火力小组之间的脱节,导致了明显的情报缺口和资源限制,例如:

- 主指挥所和任务支援点的目标选定工作重复,多个单位无意中瞄准了同一敌阵地,浪费了宝贵资源并可能损害作战效能。

- 主指挥所分析不足,源于对关键信息和专业知识的获取有限,这妨碍了提供及时准确情报支援的能力。

- 任务支援点面临资源限制,进一步加剧了野战炮兵情报官和反火力小组所面临的挑战,限制了其有效收集、分析和分发情报的能力。

- 主指挥所信息获取受限,这对为炮兵作战提供有效支援造成了重大障碍,因为关键情报常常无法获取或到达过晚而失去作战价值。

情报产品与信息的传递也受到阻碍,关键数据常常到达过晚,无法为决策或作战规划提供信息。这种缺乏及时有效情报支持的情况,直接影响了野战炮兵情报官与反火力小组无缝协作的能力,最终影响了炮兵作战的整体效能。

结论

作战环境对大型地面作战行动至关重要。通过作战环境情报准备达成的对作战环境的透彻理解,能够实现有效的炮兵运用。有效的信息分发是成功的关键——询问“还有谁需要知道”能确保关键情报在正确的时间分享给正确的人。在炮兵作战中,这意味着快速收集、分析并分发信息,以指导目标选定工作和反火力作战。正如国家训练中心第24-04轮次演习所展示的,对作战环境情报准备采取系统化方法,能够提升火力效能并取得作战成功。通过优先处理信息分发并确保情报得到有效共享,指挥官能够做出明智决策并优化炮兵部署。

导读

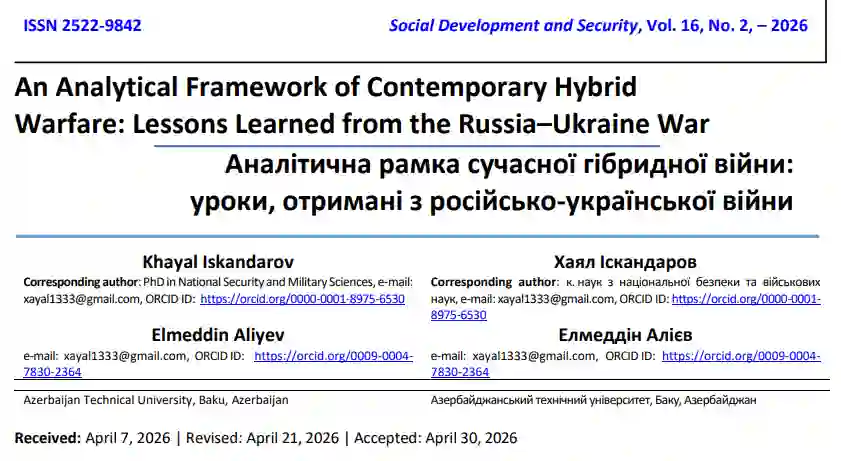

大语言模型(LLM)在推荐系统领域的应用正面临一个核心困境:模型依赖的参数化知识容易过时,而从知识图谱中检索结构化知识虽然能缓解这一问题,却难以针对不同复杂度的查询选择最优的检索粒度。简单查询被过度检索注入噪音,复杂查询则因检索不足而遗漏关键多跳关系。这不仅降低了推荐准确性,还造成了计算资源的浪费。针对这一痛点,来自香港理工大学、新加坡国立大学等机构的研究者提出MixRAGRec,一个基于混合专家检索的多智能体知识图谱检索增强生成框架。 该工作的核心创新在于将查询感知的粒度选择引入KG-RAG推荐,通过三种智能体的协同配合——混合专家检索智能体按需选择四种检索粒度之一、知识偏好对齐智能体将结构化数据转换为LLM友好文本、对比学习增强推荐智能体优化推荐结果——显著提升了推荐效果与效率。更值得注意的是,论文提出了MMAPO(Mixture-of-Experts Multi-Agent Policy Optimization)统一优化框架,将三者训练目标对齐,解决了粒度选择缺乏直接监督的难题。 这篇文章之所以值得深入阅读,不仅因为它被KDD 2026 Research Track接收,更因为它为LLM推荐系统的知识增强提供了一种经济高效的新范式。通过在MovieLens-1M、MovieLens-20M和LastFM-1K三个真实数据集上的评估,MixRAGRec在Accuracy、Recall@3、Recall@5三个指标上大幅超越现有最强基线,证明了查询感知的检索策略比一刀切方案更具优势。此外,该方法还开源了完整代码,为后续研究提供了坚实基准。

论文基本信息

- 英文题目 Mixture-of-Experts Knowledge Graph Retrieval-Augmented Generation for Multi-Agent LLM-based Recommendation

- 中文题目 面向多智能体LLM推荐的混合专家知识图谱检索增强生成

- 作者 Shijie Wang, Chengyi Liu, Yujuan Ding, Shanru Lin, See-Kiong Ng, Xu Xin, Wenqi Fan

- arXiv ID 2605.28175

- 类别 cs.IR

- Comments/接收信息 Accepted by KDD 2026 Research Track

- 原文链接 http://arxiv.org/abs/2605.28175v1

摘要

大语言模型(LLM)最近因具备理解用户意图和物品语义的能力而被应用于推荐系统。然而,基于LLM的推荐系统常常依赖参数化知识,并面临知识过时问题,因此知识图谱检索增强生成(KG-RAG)方法应运而生,旨在将推荐建立在结构化、最新的知识图谱之上。尽管前景广阔,在推荐中实现有效的KG-RAG仍面临巨大挑战。首先,用户查询的复杂度各异,需要不同粒度的KG知识,但现有方法采用一刀切的检索策略,导致简单查询过度检索、复杂查询检索不足。其次,用KG知识增强LLM需要将图结构数据转化为线性文本,这会引入噪音并导致结构信息丢失。此外,检索粒度的选择缺乏直接监督,必须通过对齐和下游利用后从最终推荐结果间接推断,使得查询感知的检索难以端到端学习。为解决这些问题,论文提出MixRAGRec,一个用于KG-RAG推荐的合作式多智能体框架。MixRAGRec集成了一个混合专家检索智能体,它根据查询将请求路由到不同粒度的KG检索专家;一个知识偏好对齐智能体,将结构化知识转换为LLM友好的自然语言;以及一个对比学习增强的推荐智能体,通过对比偏好反馈进行训练。值得注意的是,论文引入了混合专家多智能体策略优化(MMAPO),在统一目标下训练三个智能体。在真实数据集上的广泛实验证明了该框架的有效性。

引言:论文要解决什么问题

论文引言明确指出现有LLM推荐系统的三大痛点。首先,用户查询需要不同粒度的KG知识,但现有方法采用固定检索策略,例如对所有查询都检索三个跳的子图。这导致简单查询被过度检索,不仅引入冗余还增加成本;复杂查询则检索不足,遗漏多跳关系。以引用的图1为例,一个只看了《复仇者联盟》的简单查询,系统返回大量的实体类型信息,反而干扰了推荐;而对看过《奥本海默》《敦刻尔克》的复杂查询,仅返回单跳知识无法推断用户偏好。 其次,检索到的图结构化知识必须转化为线性文本才能输入LLM。直接描述结构知识会引入冗余噪音并丢失结构信息,降低检索知识效用。比如,三元组“导演 诺兰 电影 信条”在文本序列中就失去了实体之间的连接关系。 第三,检索粒度的选择缺乏直接监督。粒度选择的正确性只能从最终推荐结果间接推断,经过知识对齐和下游利用后,检索粒度的影响难以剥离。如果仅用推荐标准进行端到端优化,模型可能收敛到固定粒度偏好,无法实现灵活的查询感知选择。 针对以上挑战,MixRAGRec提出了三个关键创新:一是混合专家检索智能体,将每个查询路由到四种粒度之一;二是知识偏好对齐智能体,过渡图结构与文本输入之间的表达鸿沟;三是对比学习增强推荐智能体,通过对比偏好反馈训练。此外,论文提出MMAPO统一优化三个智能体。 引言还通过与现有RAG推荐方法对比定位了相关工作。现有方法要么从数据集中检索用户行为(如ReLLa、RALLRec),要么从外部知识库检索结构化知识(如K-RagRec)。但这些方法都采用固定检索粒度,忽略了查询复杂度的差异。MixRAGRec填补了这一空白,实现了查询感知的混合粒度检索和协同多智能体框架。

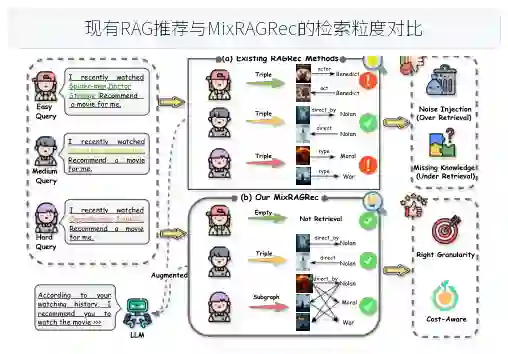

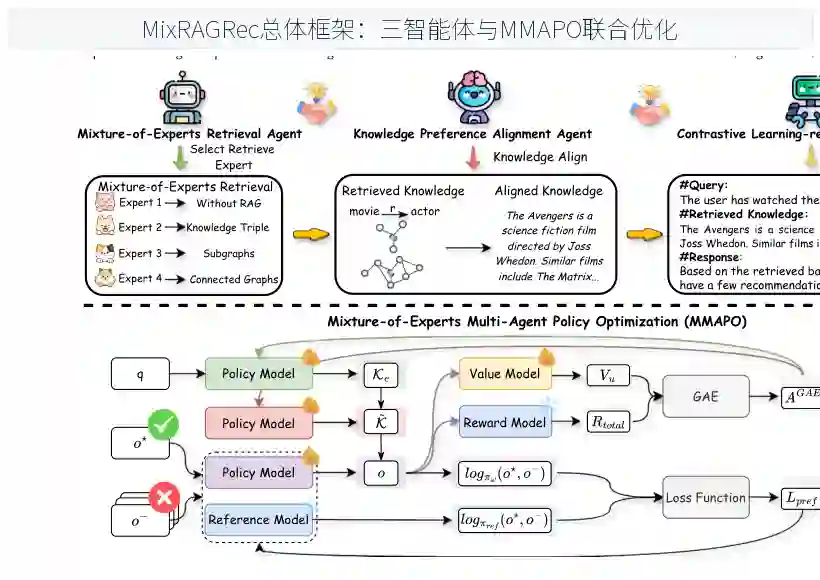

方法:核心思路与技术路线

问题定义

论文将知识增强的推荐场景形式化为:系统接收一个用户查询q,描述用户意图和上下文(如历史交互),并从候选集O中输出一个推荐物品o。系统可访问一个知识图谱G=(V,R,T),其中V为节点集,R为关系集,T为三元组集。 研究定义了四种检索专家:无检索、三元组、邻域子图、连通图。形式上,专家集合Eexp={e1,e2,e3,e4},每个专家返回特定粒度的结构化知识Ke。整个流程被建模为合作式多智能体决策过程:给定q,混合专家检索智能体选择专家e执行检索;知识偏好对齐智能体将检索到的知识Ke转换为自然语言表示K̃;推荐智能体在(q,K̃,O)条件下输出物品o。 目标函数表达为: (θ*,ψ*,ω*) = argmax E [ E_{e∼πθ(·|s)} E_{K̃∼πψ(·|q,K,e)} E_{o∼πω(·|q,K̃,O)} R(q,O,o*;e,K̃,o) ] 其中πθ、πψ、πω分别是检索、对齐、推荐智能体的策略,D表示训练分布,o*是真实物品,s是检索状态,R是奖励函数。

为什么检索粒度是核心瓶颈

推荐场景中的知识需求并不均匀。简单查询可能只需要用户历史和少量实体关系;复杂查询则可能涉及演员、导演、类型、相似作品、社交标签或多跳路径。如果所有查询都使用同一种知识图谱检索粒度,就会出现两个极端:检索太少时,LLM 缺少关键结构化证据;检索太多时,噪声实体和冗长关系会淹没有效信号,还会增加 token 成本。 MixRAGRec 的关键洞察是把检索粒度选择看成一个可学习的策略问题,而不是固定规则。它不再假设“更多知识一定更好”,而是让智能体根据查询复杂度在无检索、三元组、子图和连通图之间动态选择,从而把推荐质量和推理成本放在同一个优化目标下考虑。

框架概览

如图2所示,MixRAGRec由三个核心智能体组成。给定用户查询,混合专家检索智能体选择适当的检索专家从KG获取结构化知识;知识偏好对齐智能体将结构化知识转换为LLM友好表示;对比学习增强推荐智能体基于对齐后的知识生成推荐。三个智能体通过MMAPO在共享目标下联合训练。

混合专家的多粒度知识图谱检索

这一部分构建了四种检索专家并在模型部署前预计算所有候选索引,将每个物品映射到对应图结构。四个专家分别是: (1)无检索专家:不检索任何知识,仅依赖LLM本身,适用于最简明的查询; (2)三元组专家:从KG中检索与查询相关物品关联的三元组,适用于需要少量直接知识的查询; (3)邻域子图专家:检索物品周围固定跳数的子图,包含更丰富的关联信息; (4)连通图专家:构建涵盖多个物品及其关系的更大图结构,适用于需要多跳推理的复杂查询。 论文采用MoE架构,通过一个策略网络学习不同查询与专家之间的映射。关键点在于,策略网络将检索粒度选择视为一个序贯决策问题,通过强化学习优化。检索智能体的状态s由查询q的编码和查询复杂度特征构成,动作则是选择四种专家之一。

知识偏好对齐

检索到的结构化知识是图形式的,需要转换为LLM可处理的线性文本。知识偏好对齐智能体完成这一转换。它使用与推荐智能体相同骨干的LLM,但拥有独立参数。该智能体接收原始检索到的KG知识(三元组集合或子图结构),输出一段自然语言描述,例如将“三元组集合‘The Avengers: science fiction film, directed by Joss Whedon, similar to The Matrix’”转换成“The Avengers is a science fiction film directed by Joss Whedon. Similar films include The Matrix...”这样的文本。 对齐智能体的训练同样通过策略优化实现,以生成对推荐有帮助的知识表示。论文强调,对齐过程的目标是保留对推荐有用的知识信息同时过滤噪音,避免直接将图结构序列化带来的常见问题。

对比偏好优化的推荐智能体

对比学习增强推荐智能体基于对齐后的知识K̃和查询q产生推荐。它采用对比偏好反馈训练,目的让模型在相同上下文下将目标物品排在其他竞争负样本之上。具体来说,对于每个物品o,推荐智能体计算一个偏好分数,训练目标是通过对比损失函数拉大正负样本之间的分数差距。 推荐智能体的策略πω输出一个物品概率分布,通过一个softmax函数,其中温度参数β控制分布的锐利程度。论文采用困难负采样策略,从候选集中选取N=10个有挑战性的负样本,避免模型只学到简单的表面区分。

混合专家多智能体策略优化

MMAPO是本文最核心的贡献,它协调三个智能体在统一目标下联合优化。对于每个训练样本,检索智能体策略πθ输出专家选择概率;对齐智能体策略πψ输出知识转换;推荐智能体策略πω输出物品推荐。奖励函数R包含两个主要部分: 一是推荐准确性奖励:度量推荐物品是否命中真实目标。二是边际信息增益(MIG),量化检索知识相对于计算成本带来的效用提升。MIG的定义为:检索带来的信息增益减去该检索粒度的计算成本惩罚。成本惩罚系数η=0.005和MIG权重α=0.2经过调优确定。 MMAPO采用广义优势估计(GAE)计算优势函数,并使用基于裁剪的策略梯度方法迭代更新三个策略网络,每次迭代4轮更新。裁剪系数ε=0.2用于稳定训练。策略网络的更新规则基于PPO算法但扩展到多智能体场景,每个智能体独立维护自己的策略参数,但共享全局价值函数和奖励信号。

实验:设置、指标与结果

数据集

实验使用三个真实推荐数据集:MovieLens-1M(约100万用户-电影评分,包含电影标题等文本元数据)、MovieLens-20M(超过2000万评分、13.8万用户、约2.7万部电影的大规模电影数据集)、LastFM-1K(超过1900万条用户收听记录及相关艺术家信息的音乐数据集)。 对于每个数据集,论文从DBpedia构建对应的知识图谱。KG节点为物品(电影或艺术家)及其关联实体(导演、类型、演员、专辑等),边表示实体间的语义关系。数据统计在论文表1中展示(原文已提供)。

基线方法

基线分为三类: 零样本推理:直接提示LLM(Gemini-2.0-Flash、GPT-4o、Deepseek-r1、LLaMA3-8B、Mistral-7B)执行推荐,不微调或知识增强。 LLM推荐模型:TallRec(通过指令微调适配推荐)、Rec-r1(通过强化学习增强推荐推理)。 KG-RAG推荐模型:KG-Text(三元组级检索)、KAPING(子图级检索)、G-retriever(子图检索+图编码)、K-RagRec(为KG-RAG推荐设计,检索不同跳数子图)。

评估指标

采用Accuracy和Recall@K(K=3,5)。Accuracy度量模型推荐是否与目标物品匹配;Recall@K度量目标物品是否出现在排名前K的推荐列表中。遵循近期设置,将用户最近一次交互物品作为目标,前10次交互为上下文,从目标物品加19个干扰项共20个候选中进行预测。对于仅输出单个选项的零样本模型,只报告Accuracy。

参数设置

使用PyTorch实现。检索智能体和对齐智能体策略优化参数:学习率3e-4,折扣因子γ=0.99,GAE λ=0.95,裁剪系数ε=0.2,每轮迭代4次更新。推荐智能体偏好优化参数:温度β=0.2,困难负样本数N=10。共享奖励设计参数:MIG权重α=0.2,成本惩罚η=0.005。骨干LLM包括LLaMA3-8B和Mistral-7B,对齐智能体和推荐智能体共享骨干架构但独立参数。

总体性能比较

论文表2展示了完整的性能对比。以下为关键数据: 在LLaMA3-8B骨干上:MixRAGRec在MovieLens-1M上Accuracy达0.504,比第二好的K-RagRec(0.454)提升11.0%;Recall@3达0.798,比K-RagRec(0.659)提升20.4%;Recall@5达0.882,比K-RagRec(0.707)提升13.2%。在MovieLens-20M上Accuracy达0.676,比K-RagRec(0.578)提升13.8%;Recall@3达0.900,比K-RagRec(0.720)提升15.2%;Recall@5达0.940,比K-RagRec(0.755)提升8.3%。在LFM-1K上Accuracy达0.934,比K-RagRec(0.845)提升7.1%;Recall@3达0.990,比K-RagRec(0.886)提升6.9%;Recall@5达0.992,比K-RagRec(0.906)提升5.8%。 在Mistral-7B骨干上同样取得一致提升:MovieLens-1M上Accuracy达0.518(提升18.3%);MovieLens-20M上Accuracy达0.652(提升13.8%);LFM-1K上Accuracy达0.912(提升11.5%)。 值得注意的是,零样本推理中的GPT-4o在MovieLens-20M上Accuracy为0.524,远低于MixRAGRec(0.676),说明即使强大LLM在无知识增强时也受限于参数化知识的静态性。

实验结果怎么读

总体性能结果显示,MixRAGRec 在三个数据集和两个主干模型上都稳定优于传统推荐模型、LLM 推荐模型以及已有 KG-RAG 推荐方法。这一点很重要,因为它说明提升并非来自某个单一数据集或单一骨干模型的偶然适配,而是来自“查询感知检索 + 知识对齐 + 推荐偏好优化”的组合收益。 更值得关注的是 Recall@3 和 Recall@5 的提升。推荐系统通常不仅关心第一个命中,也关心候选列表前几位是否覆盖用户真正感兴趣的项目。MixRAGRec 在 Recall 指标上的大幅提升说明,它不仅能更准确地选中目标物品,也能改善 top-K 排序质量,对实际推荐场景更有意义。

效率研究

论文进行了效率对比分析。由于MixRAGRec可根据查询复杂度选择检索粒度(简单查询选择无检索或三元组,避免高成本子图检索),因此整体计算成本更低。而固定检索策略对所有查询都采用子图级操作,造成不必要的开销。效率研究的具体数值原文未完全展开,但论文强调了查询感知的粒度选择在效用-成本平衡上的优势。

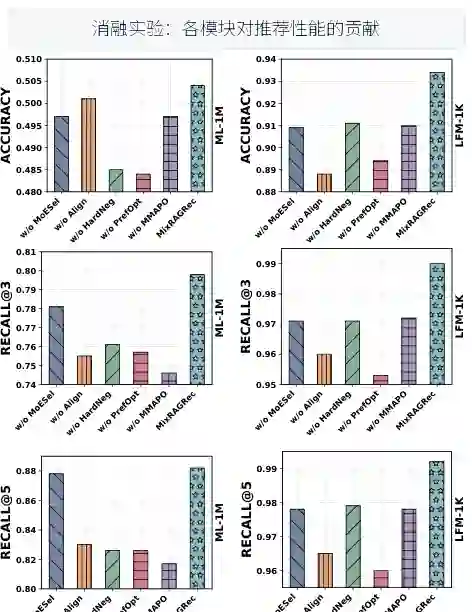

消融研究

论文图4展示了消融研究结果,将MixRAGRec与五个变体进行比较。原文未明确说明具体消融结果数值,但指出图4展示了相关结果。分析变体包括:去除非检索专家(固定为有检索)、去除MoE检索(固定为单一粒度)、去除知识对齐(直接输入序列化KG文本)、去除对比学习(使用标准语言建模损失)、去除MMAPO(独立训练三个智能体)。消融结果表明,每个组件都对最终性能有重要贡献,其中MoE检索智能体和MMAPO统一优化的影响最大。

超参数分析

论文在附录中展示了超参数分析实验,探讨了MIG权重α、成本惩罚η、负样本数N等关键参数的影响。原文未明确说明具体分析结果数值,但指出存在附录D对专家选择分布进行了分析。超参数分析表明,适中的MIG权重(α=0.2)能有效平衡检索信息增益与成本惩罚,过大会导致检索趋于保守,过小则无法约束成本。

结论:贡献、局限与启发

本文提出了MixRAGRec,一个用于KG-RAG推荐的合作式多智能体框架,通过查询感知的检索和知识利用同时提升效果和效率。具体而言,MixRAGRec包含一个混合专家检索智能体,从不同粒度的KG检索专家中选择;一个知识偏好对齐智能体,将结构化KG知识转换为LLM友好的文本;以及一个对比学习增强推荐智能体,通过对比偏好反馈训练以更好区分目标项目与竞争候选。为联合训练这三个智能体,论文提出了MMAPO,通过在共享目标下使用推荐反馈和边际信息增益协调学习。在三个真实数据集上的实验证明了MixRAGRec的效果和效率。 原文未明确说明局限性和未来工作。但从系统设计可推断,当前框架基于预构建的KG索引,对于快速变化的推荐场景可能需要频繁更新索引。此外,四种检索粒度的预设可能无法覆盖所有查询复杂度。读者可以从这些角度思考改进方向。 对AI推荐系统研究者的启发:本文展示了如何通过多智能体协作和强化学习策略优化,在无需人工标注检索粒度的情况下自动学习成本-效用最优的检索策略。这一思路可推广到其他需要选择性知识注入的NLP任务。对于工业界从业者,该框架的可部署性较强,因为预计算索引和MoE架构具有较低推理延时的潜力。

从方法设计看MMAPO的作用

MMAPO 的价值在于把三个原本可能割裂的决策阶段放到同一个推荐目标下优化。检索智能体的动作不是独立评估“取到多少知识”,而是通过最终推荐结果反馈其选择是否有用;对齐智能体也不是简单追求文本流畅,而是要让结构化知识以更有利于推荐判断的方式进入 LLM;推荐智能体则通过正负候选的对比反馈学习更细的偏好边界。 这种设计解决了 KG-RAG 推荐中的一个常见难题:中间步骤缺少显式标签。现实数据通常只告诉我们用户最终喜欢哪个物品,却不会标注“这个查询应该检索三元组还是子图”“这段知识应该怎么线性化”。MMAPO 通过共享目标和边际信息增益,把最终推荐信号反传到检索和对齐策略上,使系统能够学习到更贴近下游任务的知识使用方式。

对LLM推荐系统的启发

这篇论文对 LLM 推荐系统有一个清晰启发:知识增强不应停留在“把更多外部知识塞进提示词”。在推荐任务中,知识的粒度、结构、表达方式和训练反馈都同样重要。若缺少查询感知的选择机制,RAG 可能从增强手段变成噪声来源。 另一个启发是,多智能体框架可以承担不同阶段的专门职责。检索智能体关注“取什么知识”,对齐智能体关注“如何把图结构转成LLM可用文本”,推荐智能体关注“如何利用这些知识做排序”。这种分工比单个大模型端到端处理所有步骤更可控,也更适合做消融、诊断和工程优化。

适合落地的场景

MixRAGRec 特别适合物品具有丰富结构化关系的推荐场景,例如电影、音乐、图书、电商、课程和内容平台。只要平台能够构建用户、物品、属性、类别、创作者、标签、相似关系等知识图谱,混合粒度检索就有用武之地。简单查询可以走轻量路径,复杂查询再启用子图或连通图检索,从而避免所有请求都承担高成本。 从系统部署角度看,这类方法也适合“效果和成本都敏感”的推荐业务。相比每次都把大规模子图塞进提示词,MixRAGRec 的路由机制更容易控制 token 开销和推理延迟;相比纯协同过滤或纯 LLM 推荐,它又能把结构化外部知识显式纳入决策链路。因此,它代表了一种更工程化的 LLM 推荐方向:不是让大模型替代推荐系统,而是让大模型、知识图谱和策略优化各自承担擅长的部分。

原文信息

- 论文原文:http://arxiv.org/abs/2605.28175v1

- 代码仓库:https://github.com/Sjay-Wang/MixRAGRec

- DOI:10.1145/3770855.3817630

- 资源可用性:https://doi.org/10.5281/zenodo.20372864

- 引用格式:Shijie Wang, Chengyi Liu, Yujuan Ding, Shanru Lin, See-Kiong Ng, Xu Xin, and Wenqi Fan. 2026. Mixture-of-Experts Knowledge Graph Retrieval-Augmented Generation for Multi-Agent LLM-based Recommendation. In Proceedings of the 32nd ACM SIGKDD Conference on Knowledge Discovery and Data Mining V.2 (KDD 2026), August 9–13, 2026, Jeju Island, Republic of Korea. ACM, New York, NY, USA, 19 pages. https://doi.org/10.1145/3770855.3817630

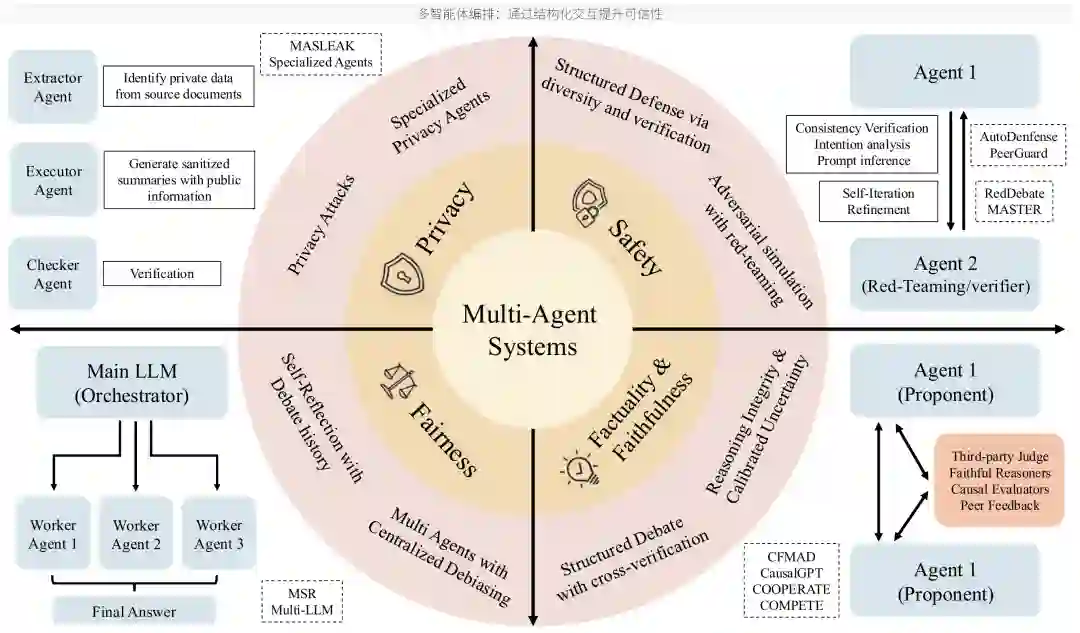

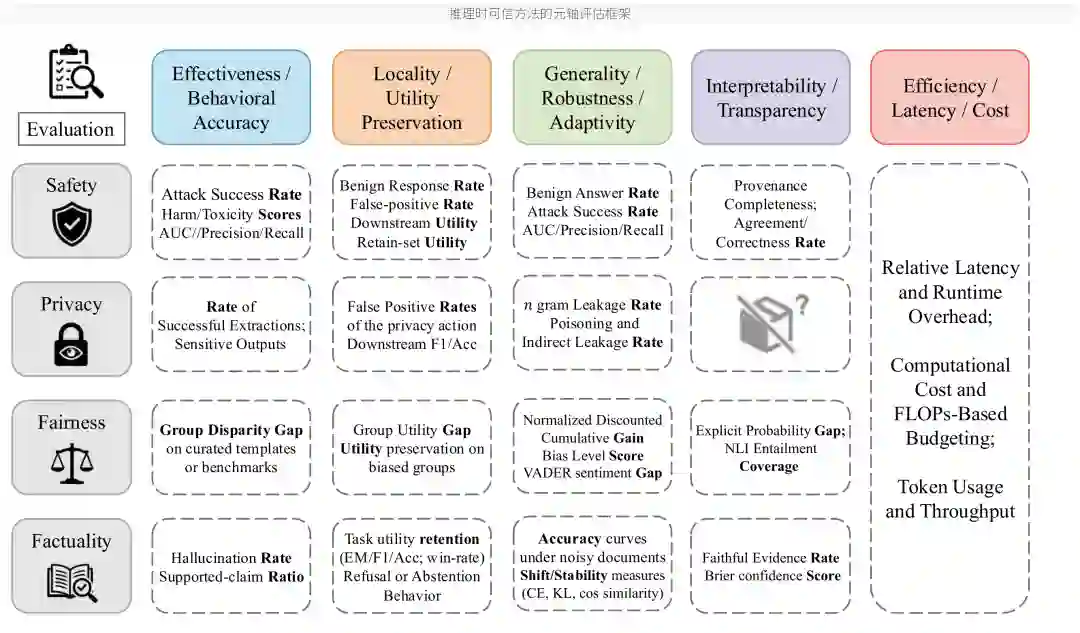

导读

当大语言模型进入真实业务、公共服务和高风险决策场景后,“模型已经训练好”并不意味着“模型行为已经可控”。训练阶段的对齐、RLHF、红队测试和安全微调固然重要,但部署之后仍会遇到持续变化的风险:新的越狱提示、检索内容污染、组织内部策略更新、不同地区的合规要求、用户个性化约束,以及多轮交互中逐渐累积的上下文偏移。对这些问题,重新训练模型往往成本高、周期长,也不一定可行。 这篇综述 Inference-Time Control for Trustworthy Large Language Models 正是围绕这个问题展开:如何在推理阶段,也就是模型已经训练完成、正在生成回答时,对其行为进行可信控制?作者把 2020-2026 年间 230 余篇相关论文整合为一个“推理时控制平面”,并从安全、隐私、公平、事实性四个可信维度出发,梳理七类方法:上下文工程、护栏、解码策略、表示工程、推理时遗忘、结构剪枝和多智能体系统。 本文的价值不只是列方法清单,而是把这些方法放回同一条生成流水线中理解:有些方法在输入和上下文阶段施加约束,有些方法直接改写 token 分布,有些方法干预隐藏状态或模型结构,还有一些方法通过多智能体协作和验证来提升可靠性。换句话说,可信 LLM 不再只是“训练一个更安全的模型”,而是在运行时搭建一套可更新、可组合、可审计的治理机制。 对研究者而言,这篇综述给出了可信 LLM 运行时治理的完整地图;对工程团队而言,它回答了一个非常实际的问题:当模型已经上线,面对不断变化的风险和场景时,我们还有哪些不改参数、少改参数或系统级的控制手段可用。

Paper Information / 论文基本信息

英文题目 Inference-Time Control for Trustworthy Large Language Models 中文题目 面向可信大语言模型的推理时控制 作者 Yuyang Bai, Zheyuan Liu, Han Yan, Zhangchen Xu, Yixin Wan, Canyu Chen, Zehong Wang, Xiangchi Yuan, Yue Huang, Guangyao Dou, Yuji Zhang, Hangxiao Zhu, Zhuofeng Li, Manling Li, Xiangliang Zhang, Mohit Bansal, Sanmi Koyejo, Kai-Wei Chang, Yu Zhang, Meng Jiang 机构 Texas A&M University、University of Notre Dame、University of Washington、UCLA、Northwestern University、Georgia Tech、Johns Hopkins University、UIUC、UNC Chapel Hill、Stanford University 等 预印本信息 Preprints, May 2026 DOI 10.20944/preprints202605.1041.v1 项目页 https://leopoldwhite.github.io/Awesome-Inference-Time-Trustworthiness/ 论文链接 https://www.preprints.org/manuscript/202605.1041/v1

Introduction / 引言

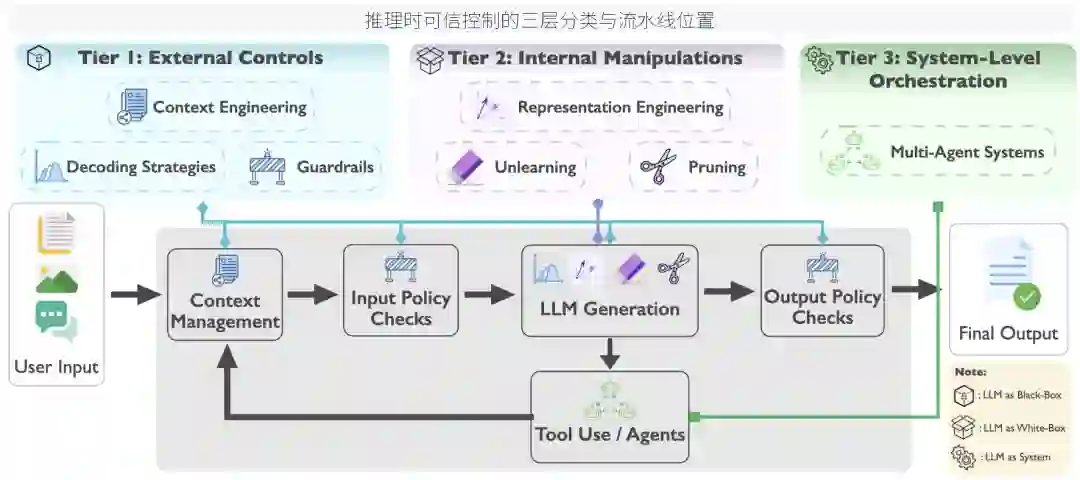

论文的出发点是一个部署现实:训练时对齐无法预见所有运行时风险。一个 LLM 在发布之后,可能面对持续变化的政策约束、不同用户或组织的偏好、带有污染或偏见的检索上下文、恶意构造的越狱提示,以及对隐私与事实性的不同要求。此时,如果每次都依赖重新训练或再次微调,不仅成本高,而且滞后。 推理时控制方法因此成为可信 LLM 的关键补充。它们不一定改变模型参数,而是在生成管线中实时调节输入、上下文、输出检查、token 分布、隐藏表征、结构组件或多智能体交互。作者将这些方法视为同一个控制平面:它们作用位置不同、访问权限不同、风险覆盖不同,但共同目标是在模型运行时提高安全性、隐私保护、公平性和事实性。

综述的核心问题

这篇论文试图回答三个问题。第一,推理时可信控制到底包括哪些方法,而不仅是通常被单独讨论的 prompt engineering 或 guardrail?第二,不同方法在生成流水线中分别接入哪里,需要黑盒、白盒还是系统级访问?第三,如何在安全、隐私、公平和事实性之间建立统一的评估视角,而不是每个方向各说各话。 作者的贡献可以概括为四点:提出一个跨方法的三层分类法;把七类方法和四个可信维度系统对应起来;给出元轴评估框架;讨论推理时控制在鲁棒性、效用、验证和组合方面的开放挑战。

Tier 1: External Controls / 第一层:外部控制

外部控制把 LLM 当作黑盒来使用。它们不访问模型权重,也不修改隐藏状态,而是通过上下文、输入输出检查和解码过程来影响模型行为。正因为不依赖白盒访问,这一层最容易部署在商业 API 模型上,也是当前工程实践中最常见的可信控制方式。

上下文工程

上下文工程通过提示词、系统指令、示例、检索内容、记忆窗口和上下文排序来约束模型行为。它可以用于安全,例如在系统提示中明确禁止危险操作;也可以用于事实性,例如通过 RAG 给模型提供可引用证据;还可以用于隐私和公平,例如在输入层过滤敏感字段、加入公平性约束或引入不同群体的平衡示例。 这类方法的优势是低成本、可解释、可快速迭代,缺点是容易被上下文污染或对抗提示绕过。特别是在长上下文和多轮交互中,约束可能被稀释、覆盖或被模型忽略,因此上下文工程往往需要与护栏和输出验证结合使用。

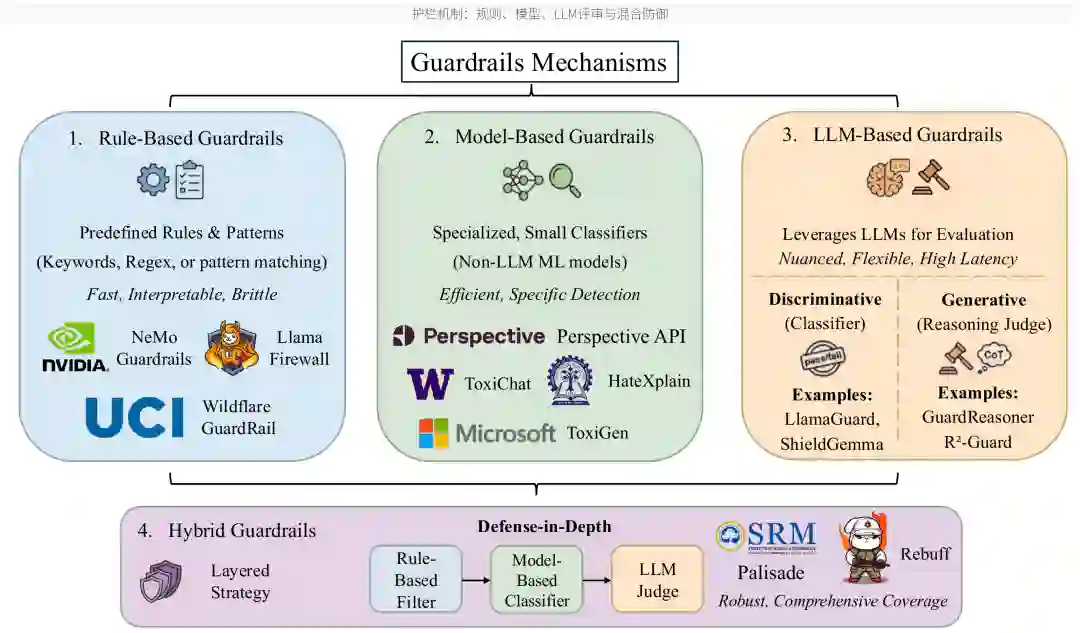

护栏机制

护栏是外部控制中最典型的一类。它通过额外模块对输入或输出进行检查,对违规内容进行阻断、重写、脱敏或重新生成。论文将护栏机制分为四类:规则型护栏、小模型分类器、基于 LLM 的评审器,以及混合防御流水线。

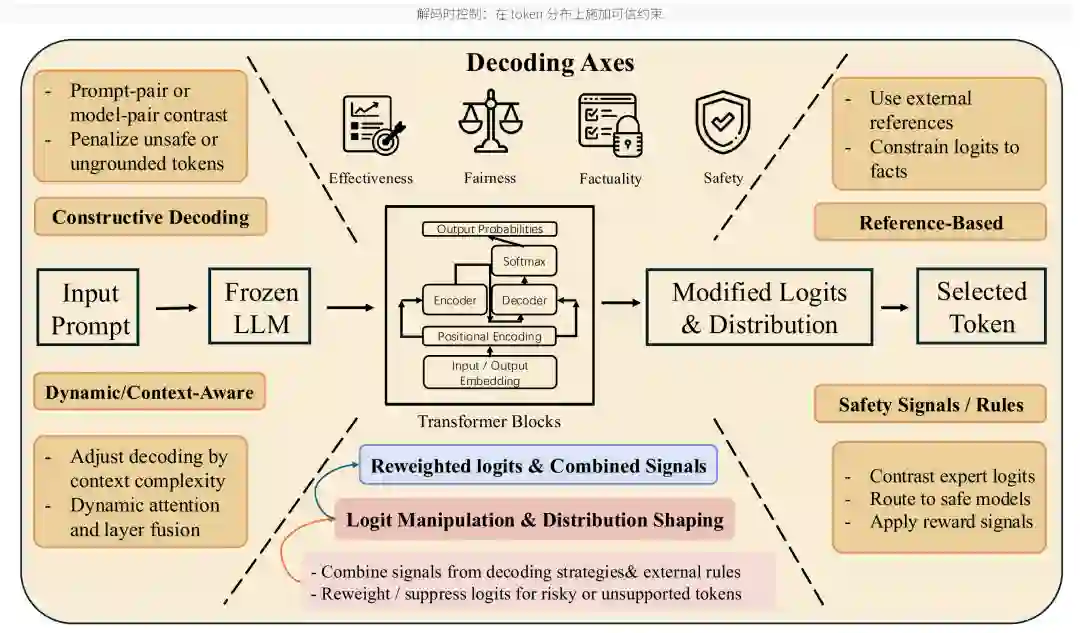

解码策略

解码策略在 token 生成阶段直接操控概率分布。与护栏不同,它不是等模型生成完再检查,而是在生成过程中重加权、抑制或引导候选 token。论文把解码策略放在外部控制层,是因为很多方法只需要访问输出概率或通过 API 近似实现,不一定修改模型参数。

外部控制的部署取舍

从工程角度看,外部控制通常是第一优先级。原因很简单:它不要求模型开源,不需要重新训练,可以快速适配新的政策和业务规则。如果一个企业正在使用 API 模型,最可行的路径往往是先建立上下文模板、输入输出护栏、检索证据校验和解码约束,再逐步引入更复杂的白盒方法。 但外部控制也不应被神化。上下文工程容易受到提示注入影响,护栏容易在边界案例中误判,解码策略可能牺牲自然度和召回率。因此论文把它们称为“最模块化、最可部署,但也最容易被适应性攻击绕过”的层级。实际落地时,外部控制更适合作为前置和后置防线,而不是唯一防线。

Tier 2: Internal Manipulations / 第二层:内部操控

第二层方法需要白盒访问。它们直接干预模型计算过程,例如修改隐藏状态、抑制特定知识或行为、剪除相关神经元或注意力头。与外部控制相比,内部操控更细粒度、更贴近模型内部机制,但部署门槛更高,也更难验证。

表示工程

表示工程把模型隐藏状态看作可控对象。常见做法是先找到某个概念方向,例如“有害性”“诚实性”“拒答倾向”“政治偏见”等,再在推理时沿该方向移动激活向量,从而改变输出行为。这类方法的吸引力在于,它提供了一种不改权重但能改变行为的方式。 在可信性维度上,表示工程可以用于安全控制、降低偏见、增强事实性或减少幻觉。例如,如果某些激活方向与不安全回答相关,可以在生成时压制这些方向;如果某些方向与基于证据回答相关,可以增强它们。但问题也很明显:概念方向是否稳定、是否跨任务泛化、是否会引入副作用,目前仍缺少可靠保证。

推理时遗忘

推理时遗忘关注在生成阶段抑制某些知识、行为或记忆,而不是通过重新训练真正删除它们。方法包括注意力遮蔽、激活门控、上下文拒答触发、检索屏蔽等。它适用于隐私场景,例如防止模型泄露训练数据中的敏感信息;也适用于安全场景,例如拒绝输出特定危险知识。 这类方法的重要挑战是“抑制不等于删除”。模型可能在常规提示下拒答,但在对抗提示、长链推理或间接诱导下重新泄露。因此推理时遗忘必须与验证机制结合,不能仅凭表面拒答判断信息已经被移除。

结构剪枝

结构剪枝通过删除或屏蔽权重、神经元、注意力头等组件来削弱不可信行为。它可以被视为推理时或部署时的结构性控制:不一定重新训练完整模型,而是通过移除局部结构来改变行为。 剪枝的潜在优势是推理效率和安全控制可以同时改善,例如移除与特定有害行为相关的组件;但风险在于模型能力可能被意外损伤,且行为归因并不总是清晰。一个神经元或注意力头可能同时承载多个功能,剪除后既可能降低风险,也可能破坏正常能力。

内部操控的共同难题

内部操控比外部控制更深入,但也带来更强的验证问题。我们如何证明某个激活方向真的对应目标概念?如何保证推理时遗忘不会被恢复?如何测量剪枝造成的隐性能力损失?论文认为,这一层的未来不只在于找到更强干预方法,更在于建立可验证、可审计、可复现的机制分析。

白盒方法的适用边界

内部操控更适合开源模型、私有部署模型或具备深度模型访问权限的研究场景。它的优势在于可以干预更靠近生成机制的变量,不必完全依赖提示或外部过滤。例如,在高敏感场景中,如果某些风险模式频繁绕过输出护栏,表示工程或推理时遗忘可以作为更深一层的控制手段。 不过,白盒方法对组织能力要求更高。团队需要理解模型结构、激活接口、推理框架和评估协议,还需要承担维护不同模型版本的成本。一旦模型升级,原来的方向向量、剪枝位置或遗忘触发机制可能失效。因此白盒控制并不是“更高级就一定更好”,它适合风险足够高、模型可控性要求足够强、并且团队有能力持续验证的场景。

Tier 3: System-Level Orchestration / 第三层:系统级编排

第三层把可信性视为系统交互的结果,而不是单一模型的内在属性。多智能体系统通过角色分工、辩论、交叉验证、红队攻击、自我反思和工具调用,把一个模型的输出放入更大的工作流中进行检查和改进。

面向安全的多智能体

安全场景中,多智能体系统常把攻击者、防御者、验证者和裁判分开。红队智能体负责生成对抗提示,防御智能体负责拒绝或重写,验证者负责检查是否违反策略。通过角色多样性,系统可以发现单一模型难以识别的隐性风险。 这种方法的优势是动态、可迭代,并能模拟对抗过程;缺点是系统复杂度高,且智能体之间可能出现串联错误。如果红队提示被其他智能体误采纳,或者裁判模型被同样的攻击模式误导,系统反而可能放大风险。

面向事实性和公平性的协作

在事实性任务中,多智能体常用于交叉验证、证据检查、观点竞争和不确定性校准。一个智能体提出答案,另一个智能体检索证据或寻找反例,第三个智能体进行裁判。这种结构可以降低单模型幻觉,但前提是不同智能体具有足够独立性。 在公平性任务中,多智能体可以模拟不同群体视角或让专门的审查智能体检查偏见。系统还可以把输出交给多个角色进行一致性评估,避免单一评审模型把自身偏差当作标准。

面向隐私的角色分工

隐私保护中,多智能体可以把“提取”“执行”“检查”分离。例如一个智能体识别敏感字段,另一个智能体生成脱敏摘要,第三个智能体验证输出中是否仍包含私人信息。这种分工能提高可审计性,但也增加了中间状态泄露和权限边界管理的复杂度。

系统级编排的价值

系统级编排最适合复杂任务,而不是简单问答。只要任务涉及多步检索、多源证据、合规审查、外部工具、长期记忆或多人协作,单次模型调用就很难保证可信性。把不同角色拆开,可以让每个智能体承担相对清晰的职责,也方便记录中间证据和审查链路。 但系统级方案也有新的风险。多个智能体并不天然带来正确性;如果它们使用相同模型、相同偏差和相同上下文,所谓“辩论”可能只是重复同一种错误。更糟的是,攻击者可以利用智能体之间的通信通道传播恶意指令。因此,多智能体可信系统需要明确权限边界、消息过滤、独立证据源和最终裁决机制。

Evaluation / 评估框架

推理时控制方法非常异质:有的改 prompt,有的改 logits,有的改激活,有的加过滤器,有的组织多个智能体。因此,单一 benchmark 或单一指标无法覆盖所有方法。论文提出一个元轴评估框架,将四个可信维度与五个评估轴组合起来。

四个可信维度

安全关注模型是否减少有害、毒性、越狱或危险内容。常见指标包括攻击成功率、有害分数、毒性分数、AUC、Precision、Recall 等。隐私关注模型是否泄露敏感信息,指标包括成功提取率、敏感输出率、n-gram 泄露率、间接泄露率等。 公平关注不同群体上的输出差异,例如群体差距、偏见水平、情感差距或模板化测试中的不平等表现。事实性关注幻觉率、支持声明比例、证据一致性、置信校准和嘈杂文档下的稳定性。

五个评估轴

有效性衡量控制是否真的降低风险或提高目标行为。局部性衡量控制是否只影响目标行为,而不破坏正常任务能力。泛化性衡量方法能否应对新攻击、新场景和分布转移。可解释性衡量决策依据是否可追踪、是否能提供出处和一致性说明。效率衡量延迟、计算成本、token 使用量和吞吐。 这套框架的重要性在于,它提醒我们不能只报告“风险下降”。一个护栏如果让攻击成功率下降,但误伤大量正常请求,仍然不可用;一个解码策略如果降低幻觉,却使生成延迟翻倍,也需要在部署场景中重新权衡。

为什么需要元轴评估

可信性评估最容易出现的误区,是把一个方向上的改善误认为整体可靠。例如,一个安全护栏可以显著降低越狱成功率,但如果它频繁拦截正常医学、法律或教育问题,用户体验和任务效用会迅速下降。又比如,一个事实性增强方法可以降低幻觉,但如果只在单一检索数据集上有效,面对噪声文档或对抗证据时仍可能失败。 元轴评估的好处是把这些问题显式化。每个方法都要回答五个问题:它是否有效?是否只影响目标风险?是否能泛化到新场景?是否能解释自己的判断?成本是否可接受?这比单一 leaderboard 更接近真实部署需求,也能帮助团队选择适合自身场景的控制组合。

Related Work / 相关工作

已有综述通常按可信风险类型、单一方法家族或效率问题来组织文献。例如,有些综述专注安全和越狱,有些专注隐私泄露,有些专注模型遗忘、剪枝或推理效率。本文的不同之处在于,它把“推理时”作为统一视角,把黑盒、白盒和系统级方法放在一个控制平面中比较。 论文还强调,推理时控制不是训练时对齐的替代品,而是部署后的补充层。训练时对齐提供基础行为边界,推理时控制则提供动态更新、场景适配和风险响应能力。在高风险应用中,两者需要组合,而不是二选一。

Open Challenges / 开放挑战

自适应对手下的脆弱性

静态护栏和固定解码约束容易被自适应攻击绕过。攻击者可以通过重写、分步诱导、角色扮演、工具调用或多轮上下文污染来绕开规则。表示工程和推理时遗忘也可能被对抗探测逆转。因此,未来需要动态评估、持续红队和会随威胁模型更新的防御机制。

控制与效用的权衡

更严格的控制通常会降低有用性、流畅性或任务准确率。一个真正可部署的可信系统,需要显式展示信任-效用 Pareto 曲线,而不是只报告某个单点结果。特别是在医疗、法律、教育、金融等场景中,拒答过度与风险放行同样会造成问题。

移除验证仍然困难

对于遗忘、剪枝和编辑类方法,最难的问题是证明目标信息真的不可恢复。模型可能只是学会在常规提示下不说,而不是从内部表示中删除相关信息。缺少形式化或强经验保证,会阻碍隐私敏感和监管场景中的部署。

组合风险尚未被理解

实际系统往往会同时使用提示约束、RAG、护栏、解码控制、输出审核和多智能体验证。不同控制层之间可能互相增强,也可能互相干扰。例如,一个护栏的重写可能破坏检索证据,多个智能体辩论可能放大幻觉或形成群体一致性错误。如何组合、排序、验证这些控制,是下一阶段的重要问题。

评估标准需要统一

当前各方向指标分散,安全、隐私、公平和事实性往往在不同 benchmark 上评估,难以比较。论文提出的元轴框架是重要一步,但未来仍需要跨场景、跨风险、跨成本的统一评估协议,并且要覆盖真实部署中的多轮交互和动态攻击。

Takeaways / 核心启发

这篇综述带来的第一点启发是:可信 LLM 的治理重心正在从“只训练一个更安全的模型”转向“训练时对齐 + 推理时控制 + 系统级监控”的组合范式。模型参数只是可信性的基础,运行时控制才是面对变化环境的现实接口。 第二点启发是:不同控制方法对应不同访问权限。黑盒 API 场景更依赖上下文工程、护栏和解码策略;开源模型场景可以进一步使用表示工程、遗忘和剪枝;复杂业务系统则需要多智能体和工具链编排。因此,选择方法时首先要明确部署约束,而不是只看论文指标。 第三点启发是:可信性必须与效用、成本和可解释性一起评估。一个控制方法如果安全但不可用、有效但不可解释、强大但延迟过高,都难以进入真实系统。未来可信 LLM 的关键不只是“更强防御”,而是可验证、可组合、可稳定运行的控制体系。

对工程团队的落地建议

如果把论文中的分类法转化为工程路线,可以采用由浅入深的三步策略。第一步,先建立黑盒层控制:统一系统提示、上下文来源管理、输入输出护栏、日志记录和失败回退机制。这一步成本最低,却能覆盖大量常见风险。 第二步,在可访问模型内部的场景中引入白盒控制:对高风险能力做表示探针,测试激活 steering 是否有效,评估推理时遗忘和剪枝是否真的降低泄露或不安全行为。此时最重要的不是单点效果,而是副作用分析和恢复攻击测试。 第三步,为复杂任务建立系统级工作流:让检索、生成、审查、事实核验和合规裁决分别由不同模块或智能体承担,并设计清晰的权限与审计链路。最终目标不是堆叠尽可能多的控制模块,而是让每一层控制都有明确作用、可测指标和失效处理方案。

对研究者的启发

对研究者来说,这篇综述也指出了若干值得深入的问题。推理时控制究竟能在多大程度上替代训练时对齐?不同控制层之间是否存在可形式化的组合规律?表示工程、遗忘和剪枝能否获得可验证保证?多智能体系统中的“独立性”如何定义和衡量?这些问题的答案,将决定可信 LLM 是停留在经验工程,还是逐步走向可证明、可审计的系统科学。

Original Information / 原文信息

本文精读基于以下原文与项目页:

- 论文题目:Inference-Time Control for Trustworthy Large Language Models

- 预印本:Preprints, May 2026

- DOI:10.20944/preprints202605.1041.v1

- 项目页:https://leopoldwhite.github.io/Awesome-Inference-Time-Trustworthiness/

- 论文链接:https://www.preprints.org/manuscript/202605.1041/v1

- 代码与论文列表:https://github.com/leopoldwhite/Awesome-Inference-Time-Trustworthiness

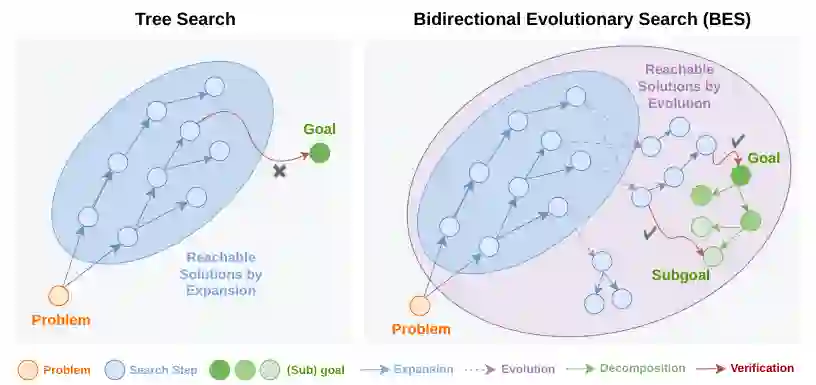

导读

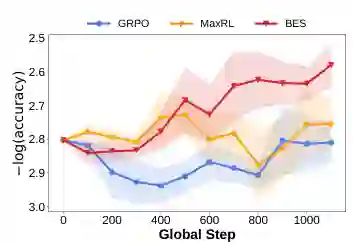

当主流后训练算法在困难推理任务上陷入“零提升”甚至“退化”的窘境时,来自哈佛大学、麻省理工学院等机构的研究者提出了一个全新的搜索框架——双向进化搜索(Bidirectional Evolutionary Search, BES)。这篇论文直指当前语言模型自我改进方法的两大核心痛点:验证信号稀疏(通常只有二元或粗粒度反馈)和候选生成局限于模型自身高概率分布区域(导致正确解难以被采样到)。作者从生物进化中汲取灵感,引入组合、删除、易位、交叉四个进化算子,并耦合反向子目标分解以提供稠密中间反馈,理论上证明进化算子可逃离“熵壳”,反向搜索可指数级减少所需样本数。实验表明,BES 在逻辑推理、多跳推理和开放问题求解上均显著优于 GRPO、Tree-GRPO 等强基线,且方差更低、稳定性更强。这篇论文不仅为后训练和推理时搜索提供了统一框架,也重新审视了“搜索”在语言模型自我改进中的角色,值得所有从事 LLM 后训练、推理扩展和智能体自改进的研究者与工程师精读。

论文基本信息

英文题目 Self-Improving Language Models with Bidirectional Evolutionary Search 作者 Guowei Xu, Zhenting Qi, Huangyuan Su, Weirui Ye, Himabindu Lakkaraju, Sham M. Kakade, Yilun Du arXiv ID 2605.28814 类别 cs.CL Comments null 接收信息 未明确 原文链接 http://arxiv.org/abs/2605.28814v1

摘要

搜索已被视为语言模型和智能体自我改进的一种有效手段,既用于后训练样本生成,也用于推理阶段。然而,广泛使用的 best-of-N 采样和树搜索面临两个根本局限:验证信号稀疏(仅提供二元或粗粒度反馈),且候选主要通过自回归扩展生成,被限制在模型概率质量高的分布区域。针对这些问题,本文提出双向进化搜索(BES),一个将前向候选进化与反向目标分解耦合的搜索框架。在前向搜索中,BES 用进化算子(组合、删除、易位、交叉)补充标准扩展操作,通过重新组合部分轨迹生成单次模型采样难以获得的高质量候选。在反向搜索中,BES 递归地将原始任务分解为可验证的子目标树,产生稠密的中间反馈来引导前向搜索。论文提供了理论动机分析:仅依赖扩展的搜索生成的候选被限制在窄熵壳内,而进化算子可以逃离该熵壳;反向搜索可以指数级减少找到正确答案所需的样本数。实验表明,在主流后训练算法无法改进的困难后训练任务上,BES 实现了持续提升;在推理时的三个开放问题求解基准上,BES 在平均和最佳表现上均优于现有开源框架。代码和训练模型已公开:https://github.com/Embodied-Minds-Lab/BES。

引言:论文要解决什么问题

现有搜索方法(如 best-of-N 采样和树搜索)尽管在语言模型后训练(如 GRPO)和推理(如 Tree of Thoughts)中取得了成功,但存在两个根本局限:

- 验证信号稀疏。引导搜索的验证器通常只提供二元或粗粒度反馈(如正确/错误),缺乏对中间步骤的细粒度评估,导致搜索难以聚焦到局部正确区域。在多跳推理等复杂任务中,稀疏信号使得模型容易陷入“奖励破解”(reward hacking)——例如学会跳过搜索动作直接猜测,从而退化。

- 候选生成受限。当前方法通过自回归扩展方式构造候选(如逐 token 生成或逐步骤扩展),这导致候选天然局限于模型自身概率质量高的分布区域(即“支持域”)。然而,对于困难问题,正确解往往位于低概率区域,单纯扩大采样次数也无法覆盖这些区域。论文理论证明,仅靠扩展生成的候选被限制在一个“窄熵壳”(narrow entropy shell)内,无法探索更广阔的解空间。

BES 针对这两个痛点分别提出解决方案:通过反向子目标分解将稀疏信号稠密化;通过进化算子(组合、删除、易位、交叉)打破自回归扩展的限制,生成模型自身分布之外的高质量候选。论文的核心创新在于将“进化”与“双向搜索”有机结合,并给出严格的理论支撑。

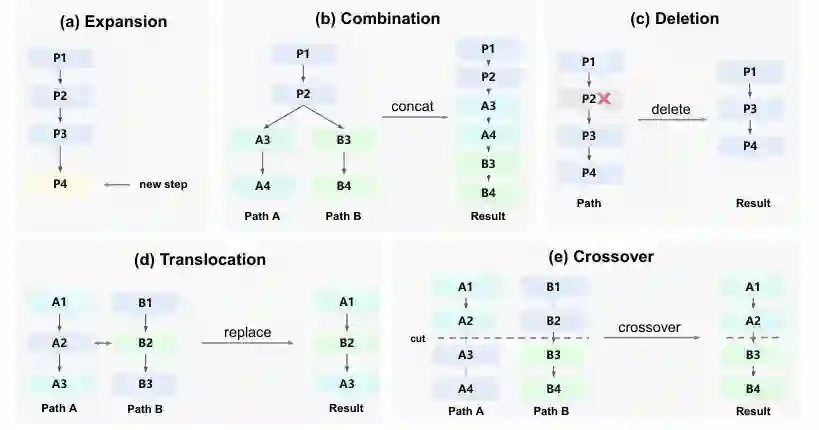

方法:核心思路与技术路线

问题形式化

论文将推理问题形式化为三元组 (T = (x, V)),其中 (x) 是问题描述,(V(x, y) \in [0,1]) 是验证器,衡量轨迹 (y) 对问题 (x) 的解决程度。给定策略 (\pi_\theta(\cdot | x))(如 LLM 生成推理链或智能体与环境交互),目标是寻找最大化验证器得分的终端响应 (y^): [ y^(x) \in \arg\max_{y \in \mathcal{Y}_{\text{term}}(x)} V(x, y). ] 这个最大化在训练和推理中都至关重要,但困难问题的解空间往往使穷举不可行。

为什么需要双向进化搜索

BES 的关键判断是:语言模型不是完全不会推理,而是现有搜索过程很难把零散的正确片段重新组织成完整解。best-of-N 和常规树搜索只是在模型高概率区域内不断扩展,候选之间缺少真正的结构性重组;一旦正确解需要跨越低概率中间步骤,继续增加采样数量也可能只是重复相似错误。 因此,论文把搜索分成两个互补方向:前向方向负责生成、编辑和重组候选轨迹,反向方向负责把最终目标拆成可验证子目标。前者扩大可达候选空间,后者缓解只有终局奖励时的稀疏反馈问题。两者结合后,BES 不只是“多采样”,而是把已有候选中的局部有效片段持续筛选、迁移和组合。

前向搜索:扩展可达解空间

BES 维护一个前向搜索树(节点为部分轨迹),除了标准的扩展操作(即继续自回归生成下一步)外,还引入了四个受生物进化启发的进化算子,它们可以直接编辑和重组已有轨迹:

- 组合(Combination) 从共享前缀的两个轨迹出发,将各自后缀拼接成一个新候选。这类似于性繁殖中染色体交换片段。

- 删除(Deletion) 移除轨迹内部的一个中间步骤,产生更短的候选。这可以理解为“剪枝”冗余或错误的推理步骤。

- 易位(Translocation) 将一条轨迹中的某一步替换为另一条轨迹中的对应步骤。这允许“借用”其他轨迹中的正确子步骤。

- 交叉(Crossover) 在一条轨迹的某个拼接点处截断,并将其尾部替换为另一条轨迹的尾部,产生新的混合轨迹。

这四个算子以固定概率被选择执行。单亲算子(扩展、删除)的父节点从候选集合 (C_t) 中依据基于反向得分的玻尔兹曼分布采样: [ \Pr(n | C_t) = \frac{\exp(\tilde{s}(n)/\tau_t)}{\sum_{n' \in C_t} \exp(\tilde{s}(n')/\tau_t)},\quad \tilde{s}(n) = s(n) + \lambda \cdot \mathbf{1}[\deg(n) = 0] ] 其中 (\tau_t) 是温度,随搜索预算线性退火(从 (\tau_0) 降至 (\tau_{\text{end}} < \tau_0)),逐步从探索转向利用。(\deg(n)) 表示节点已有的子节点数量,未探索节点会获得一个小常数 (\lambda = 0.1) 的奖励,鼓励搜索树保持广度。 对于双亲算子(组合、易位、交叉),需要选择一对父节点 ((n_a, n_b))。论文定义了一个配对得分 (s(n_a, n_b))(详见后向搜索部分),该得分衡量两个父节点对目标树(子目标)的联合覆盖程度,倾向于选择互补性强的节点对。然后按类似玻尔兹曼分布采样。 关键洞察:进化算子并不保证每次产生更好的候选,但它们的价值在于生成多样性的候选——即使只有一小部分得以改进,也足以推动搜索进步。这与生物进化中突变大多有害但少数有益推动演化的原理一致。

反向搜索:通过目标分解实现更好的验证

为了解决验证信号稀疏的问题,BES 引入反向搜索:递归地将原始任务分解为可验证的子目标树,每个子目标配有验证器 (V_g(x, n) \in [0,1]),测试候选节点 (n) 满足子目标 (g) 的程度。顶层子目标即为原始验证器 (V)。 分解过程每隔 (K) 个前向搜索步骤重新执行一次:选择当前候选尚未完全满足的一个叶子子目标,用策略模型 (\pi_\theta) 将其进一步细化分解;然后对所有已有前向节点重新评分。 子目标得分递归定义: [ s(n, g) = \alpha \cdot V_g(x, n) + (1 - \alpha) \cdot \frac{1}{|\text{ch}(g)|} \sum_{g' \in \text{ch}(g)} s(n, g') ] 其中 (\alpha \in [0,1]) 平衡父目标与更细子目标的贡献。叶子子目标直接使用 (V_g(x, n))。如果某子目标已完全满足((V_g(x, n) = 1)),则短路直接得分为 1。整体节点得分 (s(n) \triangleq s(n, g_{\text{root}}))。 配对得分:为衡量两个节点对目标树的联合覆盖,将每个子目标验证器替换为两个父节点中的最大值: [ s(n_a, n_b, g) = \alpha \cdot \max{V_g(x, n_a), V_g(x, n_b)} + (1 - \alpha) \cdot \frac{1}{|\text{ch}(g)|} \sum_{g' \in \text{ch}(g)} s(n_a, n_b, g') ] 这意味着只要其中一个节点满足了某子目标,该子目标即视为覆盖。配对得分鼓励选择覆盖不同子目标的互补节点作为双亲算子。 反向搜索产生的稠密得分直接驱动前向搜索的父节点选择,使搜索即使在无人完全解决问题时也能有效聚焦。

后训练与推理的统一使用

- 后训练 BES 替换后训练中的样本生成阶段。对于每个训练问题,BES 从前向搜索候选集中返回高质量轨迹,用作后续训练数据(如 SFT、RL)。由于 BES 能发现单次采样难以达到的正确解,它提供了更强的训练信号。

- 推理 BES 在固定计算预算下运行,最终选择得分最高的终端轨迹作为输出。论文在开放问题求解中展示了其超越现有开源框架的能力。

理论动机

论文提供了严格的理论证明(详见原论文 Section 4):

- 仅扩展搜索的壳限制:定理 4.4a 证明,仅通过自回归扩展生成的候选被限制在模型分布的一个窄熵壳内,熵壳宽度随步骤数增长缓慢,因此难以覆盖低概率但正确的解。

- 进化算子可逃离熵壳:通过组合、易位等操作,进化算子能够产生熵壳之外的候选,定理 4.4b 给出逃离条件。

- 反向搜索指数级减少样本:反向子目标分解使搜索树深度降低,减少所需样本数的指数级上界。直观上,如果问题可分解为 (d) 层子目标,每层正确概率为 (p),则单层搜索需 (1/p) 样本,但双向分解后的期望样本数为 (d \cdot (1/p)) 而非 ((1/p)^d)。

实验:设置、指标与结果

后训练实验

# 逻辑推理(Logical Reasoning)

- 数据集 Knights-and-Knaves(骑士与无赖谜题),模型需推断每人身份。

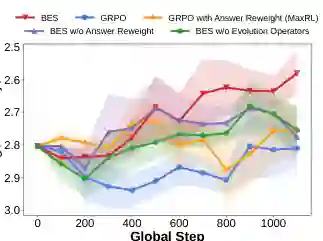

- 基线与设置 基础模型 Gemma-3-1B-it,先 SFT 冷启动(1K 样本,3 轮),然后 4 轮后训练(5K 训练问题,1.3K 验证集)。比较 GRPO、MaxRL 和 BES(应用在 MaxRL 之上)。

- 结果 如图3 所示,GRPO 和 MaxRL 验证准确率几乎无提升(甚至波动),而 BES 交叉验证准确率在整个训练过程中稳步上升。这说明主流后训练算法难以从困难数据中有效学习,而 BES 能发现更高质量的训练样本。

图3:逻辑推理任务上的验证准确率变化。BES 在 Knights-and-Knaves 后训练中持续提升,而 GRPO 和 MaxRL 提升有限。来源:原论文。

# 多跳推理(Multi-Hop Reasoning)

- 数据集 MuSiQue,要求智能体从多个文档中检索并整合信息回答复杂问题。

- 基线与设置 基础模型 Llama-3.2-3B-Instruct 和 Llama-3.1-8B-Instruct,训练 2 轮(更多轮次导致崩溃)。比较 GRPO、Tree-GRPO 和 BES(应用在 GRPO 之上)。智能体可执行搜索动作(如查询 Wikipedia)。

- 指标 准确率、有效搜索次数、有效动作数、完成率(finish ratio)。

- 结果(见表 1):

| 方法 | 准确率 (↑) | 有效搜索次数 (↑) | 有效动作数 (↑) | 完成率 (↑) |

|---|---|---|---|---|

| 3B 模型 | ||||

| Base | 4.0 | – | – | – |

| + GRPO | 2.1 (-1.9) | 0.84 | 0.20 | 0.64 |

| + Tree-GRPO | 3.9 (-0.1) | 1.50 | 2.14 | 0.64 |

| + BES | 7.0 (+3.0) | 2.31 | 3.29 | 0.97 |

| 8B 模型 | ||||

| Base | 6.6 | – | – | – |

| + GRPO | 5.6 (-1.0) | 1.46 | 1.83 | 0.37 |

| + Tree-GRPO | 7.4 (+0.8) | 0.65 | 1.36 | 0.71 |

| + BES | 10.4 (+3.8) | 2.11 | 3.05 | 0.94 |

- 分析:GRPO 在两个规模上均出现退化,原因是模型学会了低效的搜索策略(低有效动作数,低完成率)。Tree-GRPO 仅在 8B 上带来微小提升(+0.8%),在 3B 上持平。BES 在两个规模上都大幅提升准确率(+3.0% 和 +3.8%),同时有效搜索次数、有效动作数和完成率也是最高,说明训练后的智能体学会了主动搜索而非随机猜测。

推理实验:开放问题求解

- 基准 Circle Packing (Square):将 (N) 个圆放入单位正方形,最大化半径;Circle Packing (Rect.):矩形容器类比;Heilbronn Convex:在单位正方形内放置 (N) 个点,最大化任意子集构成的凸多边形的最小面积。

- 基线与设置 骨干模型 GPT-5,计算预算与其他开源框架一致。比较 OpenEvolve、GEPA、ShinkaEvolve。参考 Human 专家和 AlphaEvolve(闭源、更多计算量)。

- 指标 平均 Objective ± 标准差,最佳 Objective。

- 结果(见表 2):

| 策略 | Circle Packing (Square) | Circle Packing (Rect.) | Heilbronn (Convex) |

|---|---|---|---|

| Avg. | Best | Avg. | |

| Human | – | 2.634 | – |

| AlphaEvolve (闭源) | – | 2.635 | – |

| OpenEvolve | 2.531±.018 | 2.541 | 2.267±.014 |

| GEPA | 2.613±.022 | 2.628 | 2.326±.023 |

| ShinkaEvolve (基础框架) | 2.464±.083 | 2.541 | 2.335±.026 |

| BES (ours) | 2.623±.014 | 2.632 | 2.349±.012 |

- 分析:BES 在所有三个基准上平均和最佳值均超过所有开源框架,且方差显著更低,表明搜索更稳定可靠。虽然仍低于闭源 AlphaEvolve(后者使用了远多计算资源),但 BES 达到了接近人类专家和最佳闭源方法的水平。

实验结果如何解读

从后训练实验看,BES 的优势主要不在于更复杂的优化器,而在于更好的样本发现机制。GRPO、Tree-GRPO 等方法依赖当前策略产生训练轨迹,如果策略本身已经难以触达正确解,强化学习阶段就会缺少可学习的正信号,甚至可能强化低质量搜索行为。BES 则先通过双向搜索找到更可靠的候选,再把这些候选用于训练,从源头改善训练数据质量。 从推理实验看,BES 在开放问题求解上平均值和最优值都更稳定,说明进化式重组并非只偶然产生个别高分解,而是能系统性降低搜索方差。对于需要程序、几何布局或多步操作的任务,这种稳定性尤其重要,因为实际应用中往往更关心固定预算下能否持续产出可复现的高质量答案。

消融研究与成本分析

论文进行了消融实验(图4),验证各组件贡献。由于正文节选未提供具体数值,我们只能说明:消融研究针对逻辑推理任务,分别测试去掉进化算子、去掉反向目标分解、或者替换为普通扩展的效果,结果证实了进化算子和反向分解各自的必要性。具体可参看原论文图4。 成本分析比较了 BES 与基线的墙钟时间和 API 成本,结果未在正文节选中详细给出,但提示 BES 在产生更高质量候选的同时,额外开销在可接受范围内。

结论:贡献、局限与启发

贡献总结

- 提出 BES 框架:将前向进化搜索与反向目标分解耦合,同时解决验证信号稀疏和候选生成受限两大问题。

- 理论证明:严格证明仅扩展搜索限于窄熵壳,进化算子可逃离;反向分解可指数级减少所需样本。

- 实验验证:在后训练(逻辑推理、多跳推理)和推理(三个开放问题求解)中,BES 均显著优于 GRPO、Tree-GRPO、OpenEvolve 等强基线,且方差更低。

- 鲁棒性与稳定性:BES 在模型无法改进的困难任务上依然实现持续提升;在推理时方差大幅降低,表明搜索过程更可控。

局限

原文未明确说明局限性。但从论文方法推测,BES 的依赖包括:(1)需要设计可验证的子目标分解方式和对应的验证器,这在不同任务中可能需要手动适配;(2)进化算子的定义需要显式步骤序列,对于非结构化输出(如纯文本长段落),可能需要提示工程来实现;(2)计算成本相比简单采样有所增加,虽然实验显示在同等预算下仍优于基线。

对后训练和推理时搜索的启发

这篇论文的更大价值在于把“搜索”重新放回语言模型自我改进的中心位置。对于高难推理任务,单纯扩大模型或增加采样未必能触达低概率但正确的解;更有效的路径可能是设计能跨候选迁移局部正确片段的搜索算子,并让验证器对中间结构给出更密集的信号。 同时,BES 也提示后训练与推理并不必然割裂:推理时搜索可以产生更好的最终答案,后训练时搜索可以产生更好的训练样本。一个强搜索器既能作为测试时计算的放大器,也能作为数据生成器改善下一轮模型能力。

启发

- 搜索范式创新 将生物进化中的重组、剪切、易位等操作引入语言模型搜索,打破了“只能自回归扩展”的固有思维,为探索模型分布之外的解空间提供了可行路径。

- 验证信号稠密化 通过自动分解生成子目标和稠密评分,让搜索即使在完全解未出现时也有指导信号,这对稀疏奖励场景(如代码生成、数学证明)具有普遍借鉴意义。

- 统一后训练与推理 BES 框架天然适用于两种场景,表明一个强大的搜索算法可能同时改善训练数据质量和推理能力,有助于推动“搜索即自我改进”的研究方向。

- 理论指导实验 论文的熵壳理论为搜索算法的设计提供了定量分析工具,未来可据此设计更高效的算子或调度策略。

原文信息

本文精读基于以下原文: Guowei Xu, Zhenting Qi, Huangyuan Su, Weirui Ye, Himabindu Lakkaraju, Sham M. Kakade, Yilun Du. "Self-Improving Language Models with Bidirectional Evolutionary Search". arXiv:2605.28814v1 [cs.CL], May 2026. 原文链接:https://arxiv.org/abs/2605.28814v1

导读

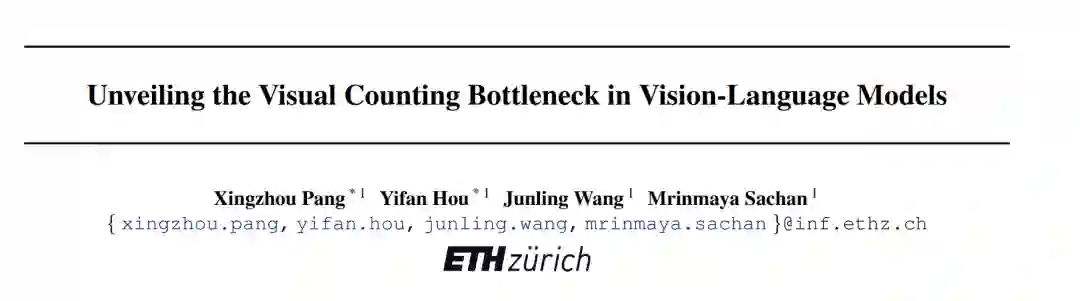

你是否有过这样的体验:让一个强大的视觉-语言模型(VLM)数一数画面中有多少只鸡,它能在 10 只以内回答得又快又准,但当鸡的数量增加到 50 只以上时,它要么胡编乱造,要么直接报错?这种“插值优异、外推崩溃”的现象,正是当前 VLM 在系统泛化能力上的核心痛点。尤其是在视觉计数这一基础推理任务上,模型的表现往往令人失望——它们能流畅地描述图像内容,却无法将学到的数字概念泛化到未见过的数量上。 来自 ETH Zurich 的 Xingzhou Pang、Yifan Hou、Junling Wang 和 Mrinmaya Sachan 四位研究者,在 ICML 2026 上发表的这篇论文,首次将视觉计数失败的根本原因精确定位到“符号映射”阶段。他们通过巧妙地将计数过程解构为三个认知阶段——视觉个体化、幅度意识和符号映射,并利用合成 Go 棋盘和线性探针等技术,系统地揭示了 VLM 在计数外推时“看到但说不出”的矛盾现象。这项工作的核心创新在于:它证明视觉骨干网络在外推域中仍保持鲁棒的线性可分离数量表示,模型也保留了对未知数量的幅度比较能力,但最终在将有效视觉幅度映射到符号标记的环节上彻底崩溃。这一发现被称为“断裂幅度假说”,并为未来 VLM 的设计提供了明确的方向——单纯的数据缩放不足以解决此瓶颈,需要引入强制统一表示的归纳先验。 本文将带你深入这篇论文的每一个细节,从问题界定到方法论,从实验设计到结论解读,力求呈现一篇结构完整、忠实原文的中文精读。无论你是 VLM 研究者、AI 系统设计者,还是对认知科学交叉感兴趣的读者,相信都能从中获得启发。

论文基本信息

摘要

虽然大型视觉-语言模型(VLMs)在插值任务上表现出色,但在系统泛化方面却遭受灾难性失败,最显著的体现在视觉计数任务上。本文通过将视觉计数解构为三个认知阶段:视觉个体化、幅度意识和符号映射,来研究这一外推瓶颈。利用合成 Go 棋盘和线性探针,我们证明视觉骨干网络在外推域内保持鲁棒且线性可分离的数量表示,排除了感知失败的可能性。此外,模型保留了潜在的幅度意识,能够成功地对无法枚举的数量进行比较推理。我们将崩溃点精确定位在符号映射阶段,即模型无法将有效的视觉幅度投影到符号标记上。我们的发现支持“断裂幅度假说”:VLMs 未能获得统一的数字空间,而是学习到断开、模态特定的统计流形,这阻止了未见数量在跨模态上的接地。这一发现在最先进的基础模型上得到验证,结果表明弥合这一差距需要强制统一表示的归纳先验,单纯的数据缩放是不够的。

引言:论文要解决什么问题

视觉计数是系统泛化能力的典型测试床。一个简单的递归算法(n → n+1)就足以让人类在掌握基数原则后零样本地枚举任意数量。然而,神经网络模型本将计数视为模式匹配问题,当目标数量超出训练分布时性能灾难性下降。这引出了一个根本性的诊断问题:计数失败源于无法感知独立物体、无法理解数量,还是无法将数量映射到标签?

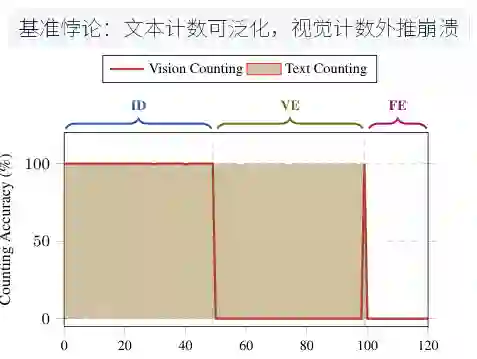

论文引言首先回顾了系统泛化的研究背景:Fodor & Pylyshyn(1988)、Marcus(2003)、Lake & Baroni(2018)以及 Hupkes 等人(2020)早就指出,系统泛化是生物智能与人工智能之间的核心鸿沟。一方面,VLMs(如 OpenAI 的 GPT-4V、Google 的 PaLM-E、Qwen-VL 系列)展示了令人印象深刻的视觉描述和推理能力;另一方面,Thrush 等人(2022)、Yuksekgonul 等人(2023)、Paiss 等人(2023)指出这些模型本质上是统计插值器,在外推时容易出错。计数泛化失败的具体观察包括 Wallace 等人(2019)、Bender & Koller(2020)、Press 等人(2022)、Anil 等人(2022)的工作,他们发现模型在物体数量超出训练范围时表现崩溃。 作者指出,现有研究虽然观察到了失败现象,但未能精确定位瓶颈的根源——是感知层面(模型无法“看到”所有物体)、数值认知层面(模型无法理解“多少”),还是符号映射层面(模型拥有数量概念但无法将其与正确的标签关联)?本文的目标正是通过认知解构,系统性地回答这一诊断性问题。 具体而言,论文将视觉计数解构为三个认知阶段(图1):

- 视觉个体化(Visual Individuation):模型能否从视觉场景中识别并分离出独立的物体实例。

- 幅度意识(Magnitude Awareness):模型是否具备对数量的抽象感知,能否比较不同集合的大小。

- 符号映射(Symbolic Mapping):模型能否将感知到的视觉幅度映射到正确的语言符号(如数字单词"49"、"50"等)。

图1:视觉计数的三阶段诊断框架。论文将计数过程拆为视觉个体化、幅度意识和符号映射,用于定位 VLM 计数外推失败的具体环节。来源:原论文。 通过线性探针从内部表示中解码隐藏计数,作者发现了一个反直觉的现象:瓶颈既不在视觉识别,也不在抽象数值感知。视觉骨干在外推域中保持线性可分离的数量表示,模型甚至能成功比较远超出训练集的数量大小(例如准确判断一组 110 个黑子是否对应一个 110 字符的文本列表)。然而,在显式枚举任务中准确性骤降为零。崩溃点被精确定位在符号映射阶段。 作者将这些发现总结为断裂幅度假说:当前的 VLM 架构未能学习到跨模态统一的数字空间,而是学习到断开、模态特定的统计流形。因此,语言模块可能拥有鲁棒的文本计数能力,视觉模块拥有鲁棒的视觉数量表示,但二者之间缺乏有效的跨模态接地。

方法:核心思路与技术路线

认知阶段的解构

论文的核心方法框架是将视觉计数分解为三个可单独检验的认知阶段。这并非简单的概念划分,而是通过精心设计的实验操作化每个阶段,使得作者能够独立测量每个阶段的能力是否完好。 视觉个体化被操作化为:模型内部表示是否在外推域中仍能线性区分不同数量的视觉特征。具体来说,如果从视觉骨干网络(如 ViT 或 Qwen3-VL 的视觉编码器)提取的特征向量,对于不同数量的 Go 棋盘(例如 50 个黑子 vs. 51 个黑子)能够被线性分类器完美分离,则说明视觉个体化能力保持完好。 幅度意识被操作化为:模型能否在无需显式枚举的情况下,对两个数量进行大小比较。例如,向模型同时展示一个包含 110 个黑子的视觉棋盘和一个包含 110 个字符的文本列表,要求模型判断“视觉集合中的物体数是否与文本列表中的字符数相同”或“哪个更大”。如果模型能够在无法准确说出“110”这个数字的情况下正确比较,则说明幅度意识能力保留。 符号映射被操作化为:给定正确的视觉数量表示,模型能否生成正确的数字字符串。这通过测量语言解码器输出的 token 序列与真实数字之间的差异来衡量。

为什么三阶段分解是关键

这篇论文的关键并不只是发现 VLM 不会数数,而是把“不会数数”进一步拆解成可诊断的机制问题。若模型失败于视觉个体化,说明它没有可靠地区分每一个物体;若失败于幅度意识,说明它即便感知到物体,也无法形成“多少”的抽象量感;若失败于符号映射,则说明模型内部已经存在数量信息,却无法把它翻译成正确的数字 token。 这种拆解使论文避免了笼统地说“模型泛化差”。作者通过线性探针和比较任务证明,视觉骨干仍然编码了数量,模型也能比较数量大小,真正崩溃的是从视觉幅度到语言符号的映射。换句话说,模型不是完全看不见,也不是完全不懂大小,而是“知道多少,但说不出正确数字”。

合成 Go 棋盘实验室

为了控制变量并消除真实图像中物体识别本身的复杂性,作者使用合成 Go 棋盘作为视觉刺激。Go 棋盘具有几个理想特性:黑子和白子对比鲜明、数量易精确控制、无杂乱背景干扰。棋盘上的黑子数量 N 从 1 到 120 变化。这种设计使得模型只需在低层次的视觉感知上区分点状物体,而非应对真实世界中的遮挡、光照、形状差异等复杂因素。 论文采用类似 VLM 预训练方式的解耦训练策略:

- 视觉计数训练 模型(包括视觉编码器和语言解码器)在包含 N=1 到 N=49 的 Go 棋盘-数字配对数据上训练,目标是根据棋盘图像输出正确的数字标记(如“49”)。训练覆盖所有 N∈[1,49] 的整数。

- 文本计数预训练 语言解码器单独在纯文本数字序列上进行预训练,能够熟练地从 1 数到 99。这意味着语言模块已经拥有“50”、“99”等数字标签的语义知识,但在视觉数据中从未见过这些数字对应的图像。

通过这种设计,模型面临三个不同的评估区间:

- 训练域(Training Domain,N=1-49):视觉和文本均见过。

- 视觉外推区间(Visual Extrapolation,VE,N=50-99):文本计数知识存在(语言解码器已预训练到 N=99),但视觉计数仅训练到 N=49,因此视觉-文本配对缺失。

- 完全外推区间(Full Extrapolation,FE,N=100-120):视觉密度和文本数量均未见。

线性探针与隐藏数目的测量

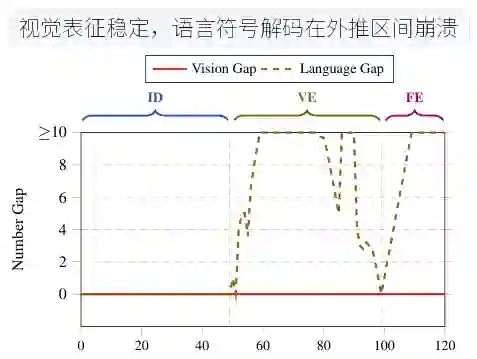

为了直接测量视觉骨干网络内部是否保留有效的数量表示,作者训练了一个线性探针(linear probe)——一种简单的线性分类器——从视觉编码器的中间层(通常是最后一层 CLS token 或区域特征)中解码出隐藏的计数。线性探针的训练数据仅来自训练域(N≤49),然后测试其在外推域(N≥50)的泛化性能。 如果线性探针能够在测试集上准确预测 N,则说明视觉特征在 N 个维度上保持线性可分离性,即模型“看到了”不同数量之间的差异。作者定义了两个关键指标(图3的视觉差距和语言差距):

- 视觉差距(Vision Gap,|NG - NH|):其中 NG 是线性探针从视觉特征中解码出的计数,NH 是真实计数。视觉差距为零表示线性探针完美恢复真实计数。

- 语言差距(Language Gap,|NP - NH|):其中 NP 是模型实际生成的数字字符串对应的数值(通过贪婪解码得到)。语言差距为零表示模型输出正确的数字。

通过对比这两个差距在外推域中的变化,可以精确定位瓶颈:如果视觉差距保持为零(视觉表示保留)而语言差距爆炸(解码失败),则瓶颈位于符号映射。

二元幅度比较任务

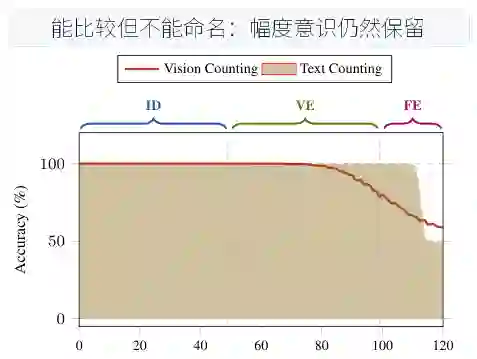

为了测试幅度意识,作者设计了二元比较任务。向模型呈现两种类型的输入:一个是视觉 Go 棋盘(包含 Nvis 个黑子),另一个是文本字符串(包含 Ntxt 个字符,例如一串字母“A”重复 Ntxt 次)。模型需要判断 Nvis 是否等于 Ntxt,或者哪个更大。该任务不要求模型输出精确计数,只要求判断大小关系。 作者比较了三种条件:

- V-V(视觉 vs 视觉):两个视觉棋盘比较。

- T-T(文本 vs 文本):两个文本字符串比较。

- V-T(视觉 vs 文本):跨模态比较。

关键结果来自 V-T 条件,因为它要求模型对齐视觉和文本中的数量信息。如果模型在 V-T 比较中表现良好,则说明尽管无法生成精确数字,但模型内部保留了跨模态的幅度意识。

验证于 Qwen3-VL

为了验证在真实世界 VLM 上的泛化性,作者选择 Qwen3-VL 作为基础模型。Qwen3-VL 是阿里巴巴最新发布的多模态大模型,具有大规模的预训练数据和高性能。作者在 Qwen3-VL 上重复了上述实验框架,以确认那些在合成设置中观察到的现象是否在真实架构中仍然成立。

实验:设置、指标与结果

实验设计的严谨性

这篇论文的实验设计很干净,因为作者刻意把真实图像中的复杂变量剥离掉。Go 棋盘只保留“可计数对象数量”这一核心因素,避免了遮挡、类别识别、纹理、尺度和背景复杂度等因素混入分析。这样做的好处是,一旦模型失败,就很难把错误归因于低层视觉识别困难;如果模型仍然失败,就更可能是表示对齐或符号输出机制的问题。 训练区间和测试区间的划分也很关键。视觉计数只训练到 49,而文本计数预训练到 99,这制造了一个诊断性很强的视觉外推区间:模型“知道”50 到 99 这些语言数字,但从未见过对应数量的视觉样本。正因为如此,图2中的崩溃不能简单解释为语言端不知道数字,而是视觉数量到语言数字之间的桥没有搭好。 线性探针的使用也很克制。作者并没有把探针结果当成模型最终能力,而是用它回答一个更窄的问题:视觉骨干中是否存在可线性读出的数量信息。如果探针能在未见数量上恢复真实计数,就说明视觉表征中保留了数量结构;如果生成端仍输出错误数字,就可以把瓶颈进一步收缩到跨模态符号解码。这种“先证明信息存在,再定位信息无法被使用”的思路,是本文最有说服力的地方。

数据集

论文使用合成 Go 棋盘作为唯一的视觉数据集。棋盘大小为 15×15,黑子和白子交替放置,黑子数量 N 从 1 到 120 变化。每个 N 值生成多个随机分布(改变黑子在棋盘上的位置),确保模型不能简单地学习位置模式。训练集仅包含 N∈[1,49] 的样本,验证集和测试集包含所有 N∈[1,120] 的样本,但按照外推区间划分。

主实验与指标

- 计数准确率 模型输出数字与真实数字完全一致的准确率(以字符串精确匹配计算)。

- 语言差距 |NP - NH|,反映解码误差的绝对值。

同时,通过线性探针测量视觉差距,评估视觉表示质量。

主结果

结果1:视觉计数外推灾难性崩溃(图2)

图2展示了模型在文本计数和视觉计数上的对比。文本计数(青铜色区域)从 N=1 到 N=99 准确率始终保持接近 100%,说明语言解码器完美泛化。然而,视觉计数(红色线)在训练域内(N≤49)准确率接近 100%,但一旦进入视觉外推区间(N=50),准确率立即崩溃至接近 0%,并在完全外推区间持续为 0%。这种鲜明的分离(“基准悖论”)证明:模型拥有语言标签,但无法将其应用于新的视觉数量。

线性探针的结果在图3中展示。视觉差距(蓝色虚线)在所有区间(包括外推区间)都保持为零,说明线性探针能够完美地从视觉特征中解码出真实计数。这意味着视觉骨干网络在 N=50-120 的范围内仍然产生线性可分离的、鲁棒的数量表示。相反,语言差距(红色实线)在 N≥50 时立即爆炸,从零变为很大的值(平均误差超过 30)。这一对比清晰地表明:模型“看到了”数量,但“说不出”数量——瓶颈不在感知阶段,而在符号映射阶段。

在二元幅度比较任务中,模型在视觉外推区间(N=50-99)上对视觉-文本比较(V-T)保持了超过 90% 的准确率。即使显式枚举准确率为 0%,模型仍然能够正确判断视觉集合的大小是否与文本字符串的长度相等或谁大谁小。例如,模型可以准确判断“一组 110 个黑子”与“一个 110 字符的文本字符串”是相等的,尽管它无法说出“110”这个数字。这证明了模型拥有潜在的幅度意识——它能够感知和比较数量的相对大小,但无法将其与符号标签对齐。

结果背后的机制含义

图2、图3和图4共同构成了论文的核心证据链。图2首先展示现象:文本计数能力没有问题,视觉计数一出训练范围就崩溃。图3进一步排除视觉表示不足的解释:线性探针仍能从视觉特征中恢复真实数量,因此视觉空间中并没有丢失数量信息。图4再排除幅度意识不足的解释:模型虽然无法准确枚举数量,却能在二元比较任务中判断两个集合的大小关系。 因此,最合理的解释就是符号映射断裂。视觉模态和文本模态各自学习到局部有效的统计流形,但没有形成统一的跨模态数字空间。这个结论也解释了为什么单纯扩大数据未必能解决问题:如果训练目标没有强制视觉数量表征与语言数字表征对齐,模型可能继续在两个模态中分别插值,而无法真正建立可外推的数字概念。

Qwen3-VL 验证

在 Qwen3-VL 上重复实验,结果与合成实验室保持一致:视觉骨干在外推域中的表示仍具有一定线性可分离性(但存在轻微噪声,可能是由于真实预训练数据的复杂性),模型在幅度比较任务中仍保留高准确率,而显式计数在外推域中崩溃。尽管 Qwen3-VL 的视觉感知和幅度处理受到一定噪声干扰,但灾难性失败的根本原因仍然一致——由符号映射阶段的结构性断开驱动。这验证了断裂幅度假说在真实世界大规模模型中的普遍性。

消融与进一步分析

结论:贡献、局限与启发

主要贡献

- 精确定位瓶颈:首次明确回答视觉计数外推失败的根本原因是符号映射阶段的崩溃,而非感知或数值认知能力的缺失。这为后续 VLM 设计提供了精确的改进方向。

- 提出断裂幅度假说:构建了一个理论框架,解释 VLM 为何未能学习跨模态统一的数字空间。模型在视觉侧和文本侧各维护一个模态特定的统计流形,二者之间缺乏有效的接地,导致外推时无法对齐。

- 验证于最先进模型:在 Qwen3-VL 上确认现象,表明该瓶颈并非特定于实验室环境,而是在当前最先进架构中普遍存在。

局限性

原文未明确说明局限性,但根据论文内容和一般学术规范,我们可以推断一些隐含的局限性:

- 合成 Go 棋盘虽然干净,但可能过于简化,真实世界中的视觉计数还涉及物体识别、遮挡、尺度变化等复杂因素,本文的结论是否完全移植到真实场景需要进一步验证。

- 论文只测试了视觉计数这一特定任务,断裂幅度假说是否适用于其他模态(如听觉数值、“多少”的比较任务)尚不清楚。

- 作者提出的解决方案(强制统一表示的归纳先验)仍是方向性建议,并未在本文中实现和验证。

对 VLM 设计的启发

这项工作对多模态模型训练有一个很直接的启发:计数、比较、排序这类基础能力,不能只依赖自然数据中的弱监督共现。模型需要显式的归纳偏置或训练目标,迫使视觉幅度表示与语言符号表示共享同一数值结构。例如,可以引入跨模态数量对比损失、数轴连续性约束、显式数量嵌入,或把视觉数量与文本数字映射到同一个可外推的表示空间。 它也提示评测需要更细。只报告最终计数准确率,无法区分“看不见”“不理解数量”和“无法命名数量”三种错误。未来 VLM 评测应更多采用机制诊断:探针、比较任务、符号生成任务和跨模态对齐任务联合使用,才能判断模型到底在哪个环节失败。 更广义地看,这篇论文讨论的不只是计数,而是多模态系统中“连续感知量”如何落到“离散语言符号”上的问题。颜色深浅、空间距离、数量多少、时间长短都可能遇到类似瓶颈。若模型只在每个模态内部学到局部统计规律,却没有统一的抽象量纲,那么它在简单插值样本上可以表现很好,一旦需要跨分布、跨模态地命名或推理,就会暴露结构性断裂。

对未来的启发

- 跨模态统一表示的学习:本文最直接的启发是:需要设计能够促使视觉和语言模块共享同一个数字流形的归纳先验。例如,可以尝试在预训练阶段加入跨模态数量对比损失,强制视觉和文本中的数量表示对齐,或者引入位置编码式的数字嵌入。

- 重新审视数据缩放策略:当前大模型的主流提升路径是扩大预训练数据规模,然而本文表明单纯数据缩放无法解决此类模态断裂问题。这提示我们,在数据之外,架构设计和学习目标的设计可能更加关键。

- 认知科学视角的 AI 研究:将认知阶段分解引入 AI 系统诊断,是一种有价值的方法论。类似于本文通过线性探针“读心”的方式,未来的研究可以借鉴认知科学的工具(如心理物理学、比较心理学)来系统分析 AI 系统的内部表征。

- 对计数外推的其他解释的检验:本文从模态层面进行了解释,但还有可能的研究方向涉及注意力机制、位置编码的局限性、或数字标记的表示方式等。未来可以将这些因素与断裂幅度假说结合,形成更完整的理论。

原文信息

本文原文为 Unveiling the Visual Counting Bottleneck in Vision-Language Models,作者 Xingzhou Pang, Yifan Hou, Junling Wang, Mrinmaya Sachan,发表于 ICML 2026。论文原文及代码链接如下:

(注:代码链接由论文作者提供,仅供参考,本公众号文章不对代码内容负责。)

在持续进行的美国-以色列-伊朗战争中,伊朗与美以联军之间存在空中力量的不对称。然而,无人机为伊朗创造了多种作战选择。伊朗部署了多种类型的无人机,用于情报、监视和侦察,以及执行针对防空系统、关键军事和民用基础设施、炼油厂和机场的空袭任务。

伊朗无人机摧毁了美国海湾伙伴国以及以色列的油田和炼油厂。空中交通受到干扰。雷达等高价值军事目标也被发现易受无人机攻击。配备先进美制和以色列武器的海湾国家的防御设施以及关键的能源、航空和其他基础设施,被证明易受伊朗无人机攻击,且其中大部分遭受了严重损失。

海湾国家曾寻求乌克兰帮助以对抗伊朗无人机攻击。伊朗迄今已摧毁12架MQ-9B和12架"赫尔墨斯"-900、"赫尔墨斯"-450及"苍鹭"无人机。伊朗能够利用漏洞,使以色列满载武器和传感器的"赫尔墨斯"-900无人机迫降/坠毁。伊朗过去曾对美国无人机进行过类似接管。三架美国F-15战斗机被科威特的F-18战斗机在友军误击中击落,凸显了无人机交通管理和空域整合技术方面的差距。

伊朗无人机为其提供了一种其他任何技术都无法给予的能力。伊朗能够实现这种僵局,源于以下因素:

- 伊朗对技术主权的一心追求。

- 伊朗自主研发的"沙希德"及许多其他无人机,现正被美国和其他国家模仿。

- 关于伊朗依赖西方供应商的说法似乎也未被证实,因为伊朗仍在持续发射数千架无人机而未受供应商中断影响。

- 伊朗军方在无人机技术发展中发挥了关键作用,取得所有权并引领了具有作战实用性的无人机技术发展。

- 伊朗军方和技术开发者在劫持美以无人机方面大胆果敢,并务实采用以促进自身发展。

- 伊朗军方不主张像沙特阿拉伯等国那样进行中国无人机的合作或特许生产。

- 伊朗通过兵棋推演反无人机技术差距,并通过对无人机开发及无人机黑客相关的网络和电子战技术持续升级,穿透了据称最先进的防空系统。

- 伊朗充分利用了防护薄弱的炼油厂、机场、脆弱的霍尔木兹海峡以及经济蓬勃发展的阿拉伯国家的弱点。

- 1989年伊朗伊斯兰共和国国防部出口中心的建立,以及由国防与武装部队后勤部主导国防出口,确保了连续性、技术开发、升级及其出口,这似乎是国防部队实现技术所有权的关键支柱,也是其无人机计划等取得成功的原因。

美国通过"天蝎座特遣部队"部署了无人机,包括受伊朗"沙希德"设计影响的LUCAS巡飞弹和MQ-9B涡轮螺旋桨中空长航时无人机,用于对抗伊朗。以色列部署了ISR和单向巡飞弹,包括"赫尔墨斯"-900涡轮螺旋桨中空长航时无人机。美国和以色列的反无人机系统价格昂贵且能力存在差距。美国、以色列及其海湾伙伴国部署了配备反无人机系统的战斗机和攻击直升机来对抗伊朗无人机。

一些要点

审查涡轮螺旋桨无人机的采购

美国的MQ-9B涡轮螺旋桨无人机、以色列的"赫尔墨斯"-900(Drishti-10)级别无人机以及伊朗类似的涡轮螺旋桨无人机在战斗条件下被证明是脆弱的。因此,需要重新审视涡轮螺旋桨无人机在强对抗防空环境下的作战可行性、生存能力和使用效能。

相应的,需要重新审视国产涡轮螺旋桨中空长航时无人机发展计划和类似系统的进口。尽管有上述情况,国产的Tapas/Archer-NG级别无人机仍可在和平时期有限列装使用,以验证开发能力并应对印度和平时期的挑战。未来,可研究开发隐身中空长航时无人机。

审查高空长航时无人机的开发与采购

可重新审查印度国防研究与发展组织航空发展中心拟议的涡轮螺旋桨高空长航时无人机开发计划,转而研究开发隐身高空长航时无人机。此外,鉴于MQ-9B级别涡轮螺旋桨高空长航时无人机的高成本和战斗脆弱性,可重新审视其进口。

低雷达散射截面无人机

可研究开发低雷达散射截面、小型、中小型有效载荷、中远程巡飞、武装及情报监视侦察无人机,包括蜂群配置。

作战人机协同无人机

可审查国产隐身、低雷达散射截面无人机计划,如隐身翼飞行试验平台、飞翼隐身"无畏"无人作战飞行器以及作战空中编队系统人机协同计划,以开发适用于预期作战场景的变体。应加快对"无畏"、作战空中编队系统和隐身翼飞行试验平台各变体的批准。

民用-军用无人机交通管理

缺乏民用无人机交通管理系统及其与印度国防部队防空网络的集成,可能造成漏洞,例如对印度机场、炼油厂和其他关键基础设施的攻击。

无人机-有人机集成

在激烈战斗期间无人机、直升机和战斗机的联合作战,将需要开发并应用用于实时跟踪以及保持有人机和无人机之间间隔的机载技术。

反无人机能力提升

可研究开发一种由国产防空火炮和射程8-10公里的短程地对空导弹组成的混合机动反无人机系统。这将有助于在近距离内消灭低空和高空目标。可通过国防部国防生产部的国防创新组织"Aditi"计划或国防研究与发展组织的技术发展基金计划,开展对现有国产反无人机系统的开发和升级,以应对"沙希德"级别无人机。

电子系统与摄像头漏洞

印度公司能够开发除少数外的绝大多数电子系统。如果获得适当的激励措施、用户所有权和对本土设计、开发和制造系统的采购保证,他们也能开发摄像头和相关系统。因此,应在国防生产部秘书、国防研究与发展组织秘书和军事事务部的联合所有权/领导下,通过"通过国防创新挑战计划实现创新技术发展"计划或技术发展基金,着手开发合适的电子系统和摄像头,并确保采购。

无人机技术所有权及其他挑战

对印度民用和军用无人机而言,技术所有权一直是一个挑战。若干国产无人机开发计划,如近程无人机、Tapas、Archer-NG、"无畏"和作战空中编队系统,正面临各种挑战,包括决策犹豫、进展缓慢、缺乏批准、缺乏所有权、缺乏问责、缺乏/资金不足、财政约束、财务审计挑战等。

应对印度斯坦航空有限公司、国防研究与发展组织和私营实体承担的所有无人系统开发计划进行全面审查,并制定开发本土设计、开发和制造无人机及无人作战飞行器的路线图。确保用户参与和所有权,可以提高本土设计、开发和制造无人机计划成功的几率。

https://idsa.in/publisher/israel-iran-war/drones-in-israel-us-iran-war-key-takeaways-2

西亚地区的这场战争见证了人工智能和无人机等自主系统在军事杀伤链上前所未有的应用。

2026年2月底至3月初在波斯湾爆发的高强度敌对行动,由美国和以色列共同发起,并分别被称为“史诗怒火行动”或“怒吼雄狮行动”,标志着武装冲突史上的一个分水岭。此次冲突旨在对伊朗的核基础设施、指挥控制中心及高层领导实施“斩首打击”,动能和网络领域的对抗迅速升级。更重要的是,该事件成为了所谓首次全面“人工智能战争”的导火索[2]。

这一称谓并非纯粹的修辞。人工智能驱动的资产作为决策支持系统(DSS)得到了前所未有的使用,它们不仅仅是次要的分析工具,更是杀伤链的积极赋能者。通常,情报收集、目标识别、模拟与毁伤评估、预测分析、武器分配及任务执行这一过程,即使不需要数月,也需要数周的人工研判。然而,当前的战争见证了快于“思考速度”的攻击执行,其例证是美军仅在最初12小时内就对伊朗目标实施了近900次打击,并在前10天内实施了超过5500次打击[3]。

为实现如此前所未见的攻击规模、精度和速度,美国中央司令部(CENTCOM)利用了先进的人工智能工具,例如与Anthropic公司的Claude大语言模型集成的Palantir公司MAVEN智能系统(MSS)。这些系统利用来自卫星、监视和其他情报来源的非结构化、机密数据,帮助进行模式构建、实时目标定位和目标优先级排序[4]。例如,导致伊朗最高领袖哈梅内伊遇刺[5]并标志着战争开始的精准打击,就是通过运用人工智能和网络间谍活动完成的——德黑兰的摄像头多年来被黑客入侵,记录并输送了大量据推测是日常的数据(停车、人员、交通信号灯计时等)给以色列。这些数据随后被用于绘制模式和布局图,并最终为同步且精准的打击运行预测分析。

美国还开发并部署了低成本无人作战攻击系统(LUCAS),这是一种“自杀式”无人机系统,作为对抗伊朗的高性价比、大规模防御资产。单价生产成本为3.5万美元,这些无人机与美国单枚成本超过240万美元的“战斧”对地攻击导弹相比,提供了一种更低成本的选择[6]。有趣的是,LUCAS无人机是从伊朗的HESA“沙希德”-136无人机逆向工程而来,后者在乌克兰-俄罗斯战争中已声名狼藉。这些无人机配备了人工智能,使其能够执行自主和集群机动。LUCAS的集成标志着对非对称战争传统认知的显著背离。其一,美国认识到尖端程度并非军事能力的唯一基准,成本和大规模可以成为决定性因素。其次,技术从更先进国家流向较不先进国家的早期逻辑已不再必然成立[7]。

伊朗同样利用无人机饱和攻击和网络战来对抗美国和以色列。据称,伊朗的无人机袭击导致了6名美国军事人员在科威特丧生[8]。这些袭击也被用于针对数据基础设施;美国亚马逊公司在阿联酋拥有的六个数据中心中,据称有三个遭到了伊朗无人机的攻击[9]。据报道,伊朗黑客组织“Handala”也针对了美国和以色列境内的实体,包括以色列空军人员、以色列气象系统、美国医疗技术公司史赛克以及希伯来大学[10]。有迹象表明,其攻击规模所需时间的缩短,可能是由于人工智能辅助的侦察[11]。此外,有指控指出,伊朗一直在积极利用人工智能在媒体中进行虚假信息宣传活动[12]。值得注意的是,伊朗目前正面临互联网中断,表明这些网络攻击是通过分布在境外的代理进行的,这显示了其非对称网络和自主能力的扩散程度相当显著。

人工智能和无人机的优势,例如决策压缩和低成本饱和攻击,也已被证明伴随着高昂的人力代价。高度压缩的决策周期几乎没有给人类操作员留下交叉验证的空间。依赖人工智能加速决策(这常受困于过时数据和缺乏严格人工核查)对人类伤亡有直接影响。2026年3月的战争已经说明了这些代价,交战双方的无人机攻击直接击中了民用基础设施和人口,或因随后的碎片、弹片和火灾造成损害。

例如,据报道,2026年2月28日,一枚“战斧”巡航导弹击中了米纳布的Shajareh Tayyebeh女子小学附近,造成超过170人伤亡,其中大部分是12岁以下的儿童[13]。该学校位于伊斯兰革命卫队(IRGC)设施附近。由于基于2016年的过时情报,人工智能驱动的目标识别系统可能未将其识别为一栋独立建筑[14]。同样,在针对德黑兰军事基础设施的行动中,德黑兰Resalat广场的一处住宅楼也成为了空袭地点,导致超过40名平民伤亡[15]。

多份报告表明,美国和以色列的弹头击中了学校、医院[16]等民用场所以及受保护建筑和历史地标,如德黑兰的古勒斯坦宫和伊斯法罕的四十柱宫。作为报复,伊朗在阿联酋发动了袭击,导致迪拜美国领事馆附近发生火灾,并影响了如迪拜帆船酒店、迪拜机场和杰贝阿里海港等民用区域[17]。在以色列,据报道伊朗基于无人机的报复行动已造成超过18人死亡,3100名平民和军事人员受伤[18]。

这些警示也延伸到了战场。例如,无人机蜂群战术的增多使用可能会使空域不堪重负,并使防御系统的特征拦截过载。2026年3月1日,三架美国F-15E“攻击鹰”战机在友军火力中被科威特F/A-18战机击落,完美地例证了这一点。作为伊朗导弹和无人机攻击的活跃目标,科威特的防空系统处于高度戒备攻击状态。在一次高度紧张、战斗激烈的态势中,它错误地瞄准了美国战斗机[19]。

因此,这些事件凸显了人工智能驱动战争的一个重要方面:虽然人工智能可以保证决策压缩,但它不一定能防止灾难性的人员伤亡。该技术持续发展,但仍易受“算法脆弱性”[20]的影响,从而常常导致违反国际人道法。人工智能在战争中的基本承诺——即通过精准减少附带损害、消除人为错误,使作战行动对平民和军事人员都更安全——似乎远未实现。

此外,人工智能所带来的前所未有的速度和规模,似乎加速了随之而来的伤亡速度;过去可能在一个月内发生的死亡,现在可能在几小时或几天内发生。综上所述,显而易见的是,整合高度复杂的工具和更大的机器自主性,若没有适当的保障措施和有意义的人类监督,可能会加剧而非减少战争的总体人员代价。

值得注意的是,几项关键的外交倡议与西亚战争同时展开,正在努力应对这些完全相同的困境。2月,在冲突爆发前几周,全球领导人曾齐聚西班牙拉科鲁尼亚,参加军事领域负责任人工智能(REAIM)峰会。同样,就在“史诗怒火/怒吼雄狮行动”启动几天后,联合国《特定常规武器公约》(CCW)在日内瓦召开了关于自主武器的政府专家组(GGE)会议。

这些事件的时间安排有一种强烈的讽刺感:就在外交官们辩论人机交互的细微差别、法律审查和自主性定义的同时,大国正在战场上不受限制地积极利用这些系统。此外,即使监管军事人工智能的紧迫性达到顶峰,积极倡导负责任军事人工智能的文书签署国数量却在下降。在2026年西班牙REAIM峰会后制定的“人工智能行动路径”,在参会的80多个国家中仅获得35个国家的签署,主要大国(包括当前冲突的主要参与国[21])全部弃权。荷兰国防大臣Ruben Brekelmans提到,各国政府如何面临一个“囚徒困境”,他们陷入两难:一方面要为军事人工智能设定限制,另一方面又要避免在军备竞赛升级的背景下,其竞争对手可能无视这些限制[22]。

因此,“第一次人工智能战争”造成了一个重大的悖论:一方面,军事人工智能持续(且不受制约)的扩张和使用严重损害了全球外交努力。它质疑那些讨论理论约束、辩论语义的进程的有效性,而国家行为体可能随时为了压倒性的战术优势而抛弃这些进程。另一方面,伊朗战争造成的平民伤亡和社会文化损失恰恰凸显了这些讨论和辩论的必要性。即使像UNCCW和REAIM这样的论坛难以跟上人工智能融入军事行动的步伐,在扩展自主能力与明确人类问责之间取得平衡,就强有力的保障措施达成共识已变得越来越紧迫。

因此,2026年3月的西亚冲突从根本上改变了人们对现代战争的认知和考量。作为号称首次全面的“人工智能战争”,它成为了人工智能和自主系统在军事背景下的试验场。我们正实时见证算法通过将军事行动加速到超越人类认知能力,从而成为军事对抗中的决定性因素。然而,当放在友军误击事件和平民伤亡的背景下审视时,将与军事对抗和致命性相关的决策权委托给机器,也带来了沉重的代价和严重的问责缺口。

因此,需要在人工智能和自主系统对决策速度的必要性与设立保障措施以防止人员伤亡、维护国际人道法的需求之间取得平衡。面对军事人工智能实时的几何级数增长和扩散,国际社会面临着一个挑战:即在人类监督变得过时之前,创建能够确保道德和法律合规、并对这些系统实施有意义的人类控制的框架。

参考文献

- Graham Scarbro, “Iran-Israel Conflict: A Quicklook Analysis of Operation Rising Lion”, US Naval Institute, June 2025.

- Larisa Brown, “The first AI war: US and Israel use Iran to test autonomous tech”, The Times, 10 March 2026.

- “US says 5,500 targets hit in Iran as operation continues”, Middle East Monitor, 11 March 2026.

- Tara Copp; Elizabeth Dwoskin; Duncan, “Anthropic’s AI tool Claude central to U.S. campaign in Iran, amid a bitter feud”, The Washington Post, 4 March 2026.

- Mehul Srivastava, James Shotter, Neri Zilber, Steff Chavez, “Inside the plan to kill Ali Khamenei”, Financial Times, 2 March 2026.

- Zita Ballinger Fletcher, “America Reverse-Engineered Iran’s Most Decisive Weapon—Then Launched It Against Its Creators”, Popular Mechanics, 13 March 2026.

- Steve Feldstein, Dara Massicot, “What We Know About Drone Use in the Iran War”, Carnegie Endowment for International Peace, 2 March 2026.

- Abené Clayton, “Pentagon releases names of final two soldiers of six killed in Kuwait”, The Guardian, 5 March 2026.

- Julian Fell, Ashley Kyd, Jarrod Fankhauser, Matt Liddy, “AI is helping choose targets in Iran war—now it’s a target too”, ABC News, 15 March 2026.

- Andy Greenberg, Matt Burgess, Lily Hay Newman, “How ‘Handala’ Became the Face of Iran’s Hacker Counterattacks”, The Wired, 12 March 2026; Aakash Sharma, Khooshi Sonkar, “Pledged to Iran’s new leader, hackers wage digital war on US and Israel”, India Today, 16 March 2026.

- Ibrahim Saify, “AI, the Iran-US Conflict, and the Threat to US Critical Infrastructure”, CloudSEK, 6 March 2026.

- Kenrick Cai, “Trump accuses Iran of using AI to spread disinformation”, Reuters, 16 March 2026.

- Malachy Browne, John Ismay, “U.S. Tomahawk Hit Naval Base Beside Iranian School, Video Shows”, The New York Times, 8 March 2026.

- Elizabeth Melimopoulos, “Who bombed the Iranian girls’ school, killing more than 170? What we know”, Al Jazeera, 12 March 2026; Al Jazeera Staff, “Al Jazeera investigation: Iran girls’ school targeting likely ‘deliberate'”, Al Jazeera, 3 March 2026.

- Mahmoud Aslan, “Rescue Efforts in Tehran After a Triple Strike Hit Apartment Buildings, Killing 40”, Drop Site, 12 March 2026.

- Paul Brown, Shayan Sardarizadeh, Matt Murphy, “Iranian schools, hospital and landmarks among civilian sites hit during US-Israeli strikes”, BBC, 6 March 2026.

- AFP, “Iran attacks rock Dubai’s Palm, Burj Al Arab, airport”, The Hindu, 2 March 2026.

- Moiz Mustafa, “Breaking Down the Israel-Iran Conflict: What We Know So Far—Day 16”, Daily Mirror, 16 March 2026.

- ETOnline, “US-made Kuwaiti jet mistakenly shot down three US F-15s, probe finds: WSJ”, The Economic Times, 4 March 2026.

- This refers to a condition where an algorithm may not be able to generalize or adapt to conditions outside a narrow set of assumptions. In such a situation, while AI may perform well under certain conditions, especially during training, it may not perform optimally, or even fail, when exposed to new, unexpected, or slightly modified inputs.

- Oumaima Moho Amer, “Morocco Joins 34 Countries in Endorsing ‘Pathways to Action’ Pact Towards Safe Governance of Military AI”, Morocco World News, 6 February 2026.

- ETEnterpriseAI Desk, “AI weapons regulation: Nations divided as US, China skip global pledge”, ET Enterprise AI, 6 February 2026.

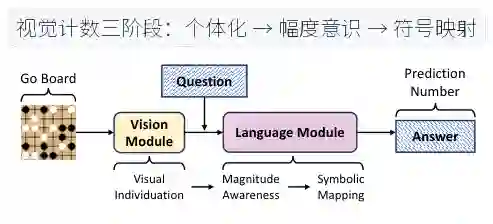

经过网络优化的LLM(大语言模型)在复杂环境中发现新漏洞的能力日益增强,而对手运用它们的能力也在不断提高。这增加了关键任务机构面临的攻击面,这些机构正面临漏洞分级、修复和协调的新瓶颈。Palantir认为,任何严肃的机构都应达到一个更高的标准,并已承担起为安全社区提出新标准的责任。

Palantir Technologies 在全球最敏感的环境中运营软件和人工智能系统:涉密政府网络、活跃作战战区、物理隔离的情报系统和关键商业基础设施。在过去20多年中,不断设计部署基础设施和安全态势,以持续支持这些环境,并为所有新的进展和技术进步(例如最近出现的经过网络优化的LLM)做好准备。

本文档提出一个候选的“任务保障性软件安全标准”(MA-S2)框架,这是正积极努力实现的标准。除了满足已有框架(如SOC 2、FedRAMP、IL5 / IL6、NIST SP 800-53、ISO 27001等)的要求外,AI辅助漏洞发现的普及突显了整个软件领域需要一个更高标准的必要性。MA-S2 是一个拟议的框架,概述了软件的安全控制、识别与修复能力、协调能力以及其他鉴证要求。公开发布此拟议标准并征求意见,因为视此为对任何希望保护自身数字足迹和生态系统的企业应尽的责任,也视此为对更广泛安全社区的贡献。对于任何认为自身任务与美国国家安全同等重要,并希望以同等标准保护其环境的首席信息安全官、首席财务官、采购官员和安全架构师,鼓励他们紧急优先考虑满足这些标准。对于更广泛的安全社区,积极邀请审查和进一步贡献,以确保一个共同且不断提高的高标准。

隐性知识——具身性、情境性且难以言表——在美国海军舰桥操作中起着关键作用,但通过资源有限的模型训练进行传递仍然具有挑战性。本文通过比较基于扩展现实(XR)的团队训练与海军的导航、船艺与船舶操纵训练器(NSST),评估了XR是否能够支持隐性知识的流动。这项由海军研究办公室"技术解决方案"项目赞助、太平洋海军信息战中心执行的研究,比较了从28个舰桥团队(158名参与者)在XR和NSST中完成相同场景后获取的超过17,000个数据点。一项受试者内设计支持了300多项统计检验,包括威尔科克森和曼-惠特尼分析、霍特林T²检验、科恩d效应量、顺序效应、亚组分析、主成分分析、情感分析和分布拟合。基于美国国家航空航天局任务负荷指数、系统可用性量表和舰桥值班自我评估结果的数据,支持了四个假设中的三个,表明XR在工作量、可用性和战备状态结果方面与NSST相当。研究结果表明,XR是一种可行的、便携的、随时可用的训练解决方案,可在任何时间、任何地点使用,同时也推动了知识流动理论朝着未来对"虚拟空间认知"的研究发展,这是一个通过混合现实环境中的合成经验实现隐性知识流动的新概念框架。

第一章提供了背景脉络,涵盖XR、虚拟环境、合成经验、知识流动、研究动机、所研究的具体实例、研究问题、目的、范围以及论文结构。第二章由哲学基础和概念框架组成,支持知识流动的概念,因其涉及隐性知识、具身性以及应用XR生成合成经验以流动时空隐性知识。本章回顾了当前在理解XR促进知识流动方面存在的差距,以及本研究对知识领域提出的贡献。第三章包含变量描述、研究设计、测试程序、控制与实验条件、假设陈述和测试环境。还包括虚拟环境设计与场景选择、机构审查委员会协议、样本选择中的后勤考量、调查问卷和数据收集、准备及用于获取结果的统计方法。第四章展示了实验结果与分析。研究结果包括对来自以下来源收集的数据进行的统计分析:a)去标识化的人口统计分析,b)模拟器晕动症问卷,c)美国国家航空航天局任务负荷指数工作量分析,d)系统可用性调查,e)舰桥值班员自我评估调查,f)舰长教官评估问卷,g)舰桥值班员教官评估问卷,以及k)退出访谈问卷。收集的数据在控制条件与实验条件之间进行了统计比较,以评估研究的备择假设H₁至H₄。第五章探讨了核心发现及研究结果在数据发现、研究期望以及契合知识流动与具身性理论构建方面的总体意义。还包括执行实验过程中遇到的挑战,例如后勤、意外发现和研究者的印象。第六章重申了H₁至H₄研究结果的重要性,阐述了XR促进对知识流动理论的贡献,并讨论了如何最佳地利用合成经验为组织创造优势。就XR的知识触及范围和生命周期影响进行了推论,并为未来研究提供了建议。

图. 合成经验基础设施:导航、船艺与船舶操纵训练器虚拟环境(左)对比虚拟舰桥与航海训练器虚拟环境(右)。

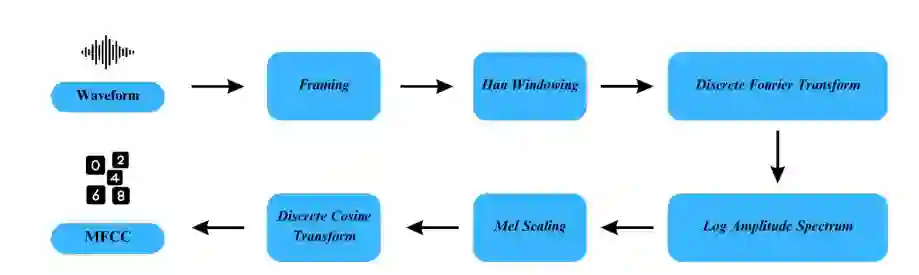

无人机的快速普及引发了严重的安全关切,因为这些设备可被用于监视、走私或敌对攻击。因此,开发有效且可负担的检测系统成为一项关键需求。本文综述了近期基于声学的无人机检测研究,强调其作为雷达和光学系统的一种低成本、便携式、被动式替代方案的潜力。本综述综合了文献中的各种方法,包括通过麦克风阵列进行数据采集、梅尔频率倒谱系数(MFCCs)及相关频谱特征等特征提取技术,以及从传统支持向量机到先进神经网络等分类方法。比较分析表明,支持向量机在小数据集和低计算需求下可实现较高准确率,而卷积神经网络在处理大规模、有噪声的数据集方面表现优异,但需要更多计算资源。主要发现还显示,与单麦克风系统相比,结合波束成形技术的麦克风阵列配置能显著提升检测距离和噪声抑制能力。综述得出结论,尽管声学技术展现出巨大前景,但在可扩展性、数据集的泛化能力及计算效率方面仍面临挑战。解决这些局限性对于推动声学无人机检测技术发展成为可靠的实际安全应用至关重要。

根据欧盟委员会的定义,无人机是指可远程控制或自主编程的无人驾驶飞行器[1]。其所占用的空域被称为"U-space",该空域与已注册的无人机交互关键飞行信息,包括时间、目的地和飞行指令。然而,非法无人机活动日益成为令人担忧的问题,其可能通过恶意攻击、未经授权的监视和侦察危及民用和军事活动。全球范围内,许多犯罪分子正利用无人机进行敌对行为、毒品贩运和网络渗透[2]。众多全球案例证实了这一问题。英国监狱总督察已敦促立即采取措施,应对定期向关押着该国一些最危险人物(包括恐怖分子和有组织犯罪头目)的设施运送毒品和武器的无人机[3]。自2015年以来,沙特阿拉伯王国已遭遇851起恐怖主义无人机袭击,导致50多名平民死亡[4]。无人机的危险性因其广泛使用和成本降低而增加:美国注册无人机数量已超过170万架[5]。此外,由于其体积小、无热信号特征及无人驾驶的特性,其技术的快速发展使其变得隐蔽且难以探测。

这强调了军方和执法机构开发高精度无人机检测系统的必要性。然而,本研究论文的主要目标是探索具有成本效益的无人机检测方法,同时追求高准确率,并就此类方法的现状、未来应用及建议提供清晰相关的理解,以及对作者方法与其他论文(从方法论到结果)进行批判性评估。无人机检测方法众多,其用例可取决于成本、优势和劣势。表I列举了各类无人机检测方法及其优缺点和成本。

因此,声学无人机检测显然符合作为一种低成本、便携且准确方法的标准。尽管其他方法在更高制造等级下开发时可能更准确,但由于成本极高,普通民众更难获取此类检测方法,这也解释了为何声学无人机检测是本文的主要关注点。

本综述论文将对以往关于声学无人机检测的研究(从方法论到结果)进行批判性评估和比较。此外,本文还将考虑用于预处理和分类数据以及训练模型以将检测到的声音标记为"无人机"或"非无人机"的各种机器学习算法。最后,无人机防御反制措施是无人机检测之后的另一个主要步骤,因此将视为超出本文讨论范围,因为无人机检测是本文的主要焦点。

目的:通过将俄罗斯-乌克兰战争作为实证案例进行研究,以概念化混合战争的作战特征。方法:比较分析与综合归纳。研究发现:实证分析表明,混合战争是在多领域战略中对非军事与军事手段的系统性整合。俄罗斯结合了网络行动、信息战、情报活动、经济施压、心理作战及常规力量,以塑造作战环境。非军事不对称手段构成了初期的长期阶段,旨在破坏基础设施、公众信任和国际舆论;然而,乌克兰的网络弹性避免了系统性崩溃。虚假信息与心理作战以政治和军事领导层为目标制造不确定性,但其效果因快速的事实核查和战略沟通而受限。混合战争亦利用制度性漏洞,但反腐败措施和改革有助于遏制这些风险。宣传和机器人网络被用于削弱社会凝聚力;然而,反虚假信息机制有助于维护公众信任。进一步的升级则涉及通过空中、海上及代理人工具施加更公开的压力。在入侵前进行了情报活动和部队集结,但早期动员与国际合作削弱了其突然性。最终,混合战争演变为一场涉及导弹打击、电子战和无人系统的多领域战役,乌克兰通过分层防空、拦截技术和增强基础设施韧性予以应对。由此可见,混合战争代表着一种影响力整合手段的连续体,其效力可被强大的制度能力、网络韧性和国际支持所限制。理论意义:研究结果深化了安全研究领域对混合战争的概念性理解。实践意义:研究成果对政策制定者和防务机构应对混合威胁具有参考价值。

导读

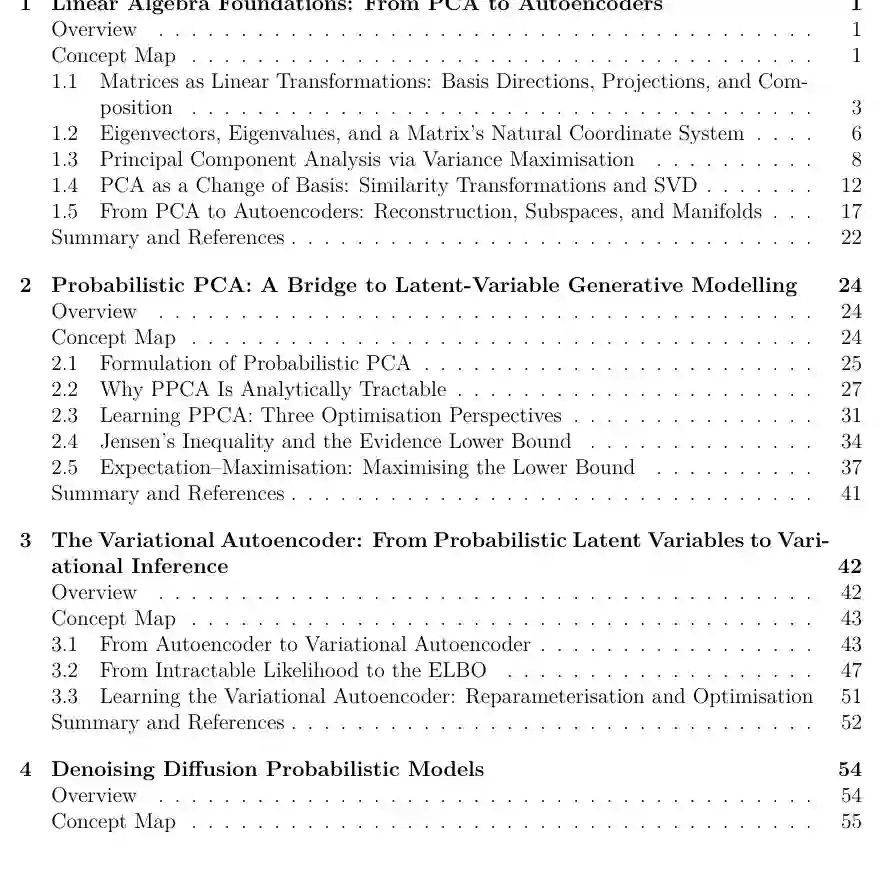

这篇 arXiv 预印本不是一篇常规实验论文,而是一部 178 页的小册子型数学导论,题为《The Little Book of Generative AI Foundations: An Intuitive Mathematical Primer》。用户要求只处理绪论部分,因此本文严格围绕原文的 Preface 及其下的组织说明、版本说明、复用说明和致谢展开,不进入后续章节的具体数学推导。 绪论传达的核心信息很明确:生成式人工智能表面上发展很快,模型、系统与应用不断更替,但其背后有一组更稳定的数学骨架,包括潜变量、似然、变分下界、可逆变换、随机加噪过程、分数场、对抗比较以及能量景观。作者希望通过一条紧凑但严谨的路线,把这些基础概念串成一个可学习、可推导、可相互连接的体系。

Paper Information / 论文信息

英文标题 The Little Book of Generative AI Foundations: An Intuitive Mathematical Primer 作者 Tianhua Chen 机构 University of Huddersfield arXiv ID 2605.29713 类别 cs.LG, cs.AI 版本信息 Preprint version, 178 pages. Comments and corrections are welcome 发布时间 2026-05-28 原文链接 http://arxiv.org/abs/2605.29713v1

Abstract / 摘要

原文摘要说明,这本小册子提供了一条面向现代生成式人工智能数学基础的紧凑路线。它不是对所有近期架构、实现细节或最新技巧做大而全的综述,而是围绕主要生成模型家族之间的数学联系展开,从 PCA、概率 PCA、变分自编码器、扩散模型,到标准化流、自回归分解、GAN、Wasserstein GAN 与能量模型。 这一定义也解释了绪论部分的写作姿态:作者更关心“这些模型为什么可以被统一理解”,而不是“当前哪种模型最强”。因此,绪论不是技术细节清单,而是先给读者设定阅读预期:这是一部为数学上好奇的研究者、工程实践者和学生准备的基础构建型读物,目标是在不抽空数学实质的前提下,提高生成建模基础的可进入性。

Preface / 前言

写作动机

前言首先指出,生成式人工智能近年来发展极快,新模型、新系统和新应用以很高速度出现。但在这种快速变化的表层之下,许多核心思想其实依赖一组更少、更稳定的数学原则。作者列出的关键词包括潜变量、似然、变分界、可逆变换、随机加噪过程、分数场、对抗比较和能量景观。这些词基本覆盖了现代生成建模从概率模型到深度生成模型的主要支柱。 这也是该书的切入点:它不追逐模型榜单或工程配方,而是把生成式 AI 看成一组数学对象和推导路径。对读者来说,这种定位很重要。若只从框架和代码入手,容易知道“模型怎么跑”,却不清楚“目标函数为什么这样写”“潜变量为什么出现”“扩散为什么能反向采样”“流模型为什么能精确计算密度”。绪论试图把阅读目标从工具使用转向基础理解。

范围选择

作者特别解释了标题中的“小”。这里的 little 不是指内容浅,而是指范围有意收敛。书稿不试图覆盖所有现代架构、实现细节和前沿改进,而是有选择地处理能支撑主要生成模型家族的基础概念。换句话说,它是一部 foundations primer,而不是 survey encyclopedia。 这种范围选择也意味着,读者不应期待它讨论每一个热门模型或最新系统,而应把它当作一条数学路径:先理解线性表示、投影、重构和潜在结构,再理解概率潜变量、变分推断、扩散过程、密度变换、对抗学习与能量函数。绪论强调,选择性并不等于浅尝辄止;在选定范围内,作者希望推导足够细,以便读者看见模型背后的结构。

读者定位

从前言描述看,该书面向三类读者。第一类是希望建立生成建模数学直觉的学生,他们可能已经接触深度学习,但还没有系统理解概率建模和变分推导。第二类是工程实践者,他们熟悉模型调用或训练流程,却希望补上数学基础。第三类是研究者,尤其是希望把不同生成模型家族放在同一知识框架下理解的人。 绪论也提醒,已经处于研究前沿的读者可能会觉得许多主题熟悉,但该书的价值在于把这些熟悉主题之间的数学逻辑讲清楚。也就是说,它更像一本“把基础重新串起来”的读物,而不是一篇宣称提出新模型的论文。

Approach and Organisation / 方法与组织

组织原则

在 Approach and Organisation 部分,作者说明全书的中心目标是用一个连贯的数学叙事连接主要生成模型家族。章节顺序不严格按照历史发展,而是按照数学概念自然展开的方式安排:后面的模型建立在前面的概念之上,使读者看到 latent variables、variational objectives、diffusion processes、score fields、exact density models、adversarial learning 和 energy-based modelling 之间的联系。 这是一种非常适合基础读物的组织方式。若按历史讲,生成模型会被拆成很多并行路线;若按工程应用讲,读者容易只记住工具名称。作者选择按数学依赖关系讲:先有线性变换和重构,再有概率潜变量;先有变分目标,再有 VAE;先有离散扩散,再引出连续时间与分数视角;再进一步讨论可精确密度模型、对抗式学习和能量模型。

数学工具嵌入叙事

绪论中特别强调,数学工具不会被单独堆成一大章预备知识,而是在理解模型时按需引入。这包括线性代数、概率、微积分、高斯代数和密度变换等工具。这样的写法降低了读者进入门槛:读者不是先面对一长串抽象数学定义,而是在模型问题推动下学习所需工具。 同时,书中会包含比高层概览更多的推导。作者认为,生成建模中的许多思想只有在目标函数被拆开、下界被推导、变换公式被写明之后才真正清楚。因此,这本小册子的“直观”不是去掉公式,而是让公式服务于建模直觉。

全书路线

绪论给出的路线可以概括为五段。第一段从 PCA 与自编码器开始,用它们引出线性变换、投影、重构和潜在结构。概率 PCA 进一步把这些思想转化为书中的第一个潜变量生成模型。 第二段进入变分生成建模,通过概率潜变量引出证据下界、期望最大化和变分推断,再扩展到变分自编码器。第三段转向扩散模型,先把 DDPM 作为离散时间的序列潜变量模型,再引入连续时间生成建模所需的微积分,并进入分数模型视角。 第四段研究可精确计算密度的模型,包括标准化流和自回归分解。它们展示了如何通过可逆变换或概率链式法则保持 likelihood tractable。第五段走向显式似然之外,讨论 GAN、Wasserstein GAN 和能量模型,说明生成学习也可以通过比较、几何差异或能量景观来进行。

Origin and Version / 来源与版本

写作来源

Origin and Version 部分说明,该书是作者独立完成的学术项目,动机来自长期希望让现代生成式 AI 的数学基础更透明、更易理解。它不是资助研究项目的一部分,也不是某个正式课程或模块的官方材料。这一点有助于读者理解文本风格:它更像作者围绕一个长期主题积累、整理和扩展出的系统讲义型书稿。 作者还说明,该书来自一个更大的独立项目,主题是现代生成建模的概率与数学基础。部分早期短版本曾以 SSRN 预印本和 arXiv 预印本形式出现,而当前版本将那条思路扩展为更完整的数学 primer,系统覆盖从经典潜变量模型到现代生成式 AI 的基础路径。

当前版本状态

绪论明确指出,这是一个完整的 working preprint manuscript,但未来仍可能继续修订、纠错、澄清和加入材料,并可能提交正式图书出版。对公众号读者来说,这意味着它现在已经适合作为学习和引用资源,但也应理解为预印本状态,而不是最终定稿书籍。

Reuse and Acknowledgements / 复用与致谢

复用说明

Reuse 部分指出,手稿以预印本形式开放给学术阅读、引用、研究参考和学习使用。读者可以在适当署名的前提下引用或将其作为研究、学习和教学支持资源。但如果要大规模复制、改编、再分发,或者转换成派生教学、培训、课程资源,则需要作者许可,除非适用版权例外或未来版本附带单独许可。 这一段对于希望将该书用于课程或训练材料的人很重要:它并不是完全开放授权的教材资源。合理引用和阅读是允许的,但系统性改编和再发布需要谨慎处理版权与许可边界。

致谢与写作姿态

Acknowledgements 部分延续了前言的学术姿态。作者说明,该书来自持续理解和解释现代生成式 AI 数学基础的努力,许多解释是在反复尝试连接线性代数、概率、变分推断、随机建模和现代深度生成模型时逐渐清晰的。作者感谢更广泛学术社区的论文、书籍、讲座和讨论,同时也承担文本中可能存在的错误、遗漏和不清晰之处。

结语

只看绪论,这本小册子的价值已经比较清楚:它不是追逐最新生成模型的“技术快报”,而是试图为现代生成式 AI 搭一条数学地基路线。它把生成模型理解为一组相互连接的概率、几何和优化思想,而不是彼此割裂的模型名称。 对于希望系统补基础的读者,绪论给出的阅读建议可以概括为三点:先关注模型家族之间的数学联系,而不是模型排行榜;把推导当作理解目标函数和建模假设的工具,而不是形式负担;用目录中的路线把 PCA、VAE、扩散、流、自回归、GAN 和能量模型放在同一张概念地图中理解。

图3:逻辑推理任务上的验证准确率变化。BES 在 Knights-and-Knaves 后训练中持续提升,而 GRPO 和 MaxRL 提升有限。来源:原论文。

图3:逻辑推理任务上的验证准确率变化。BES 在 Knights-and-Knaves 后训练中持续提升,而 GRPO 和 MaxRL 提升有限。来源:原论文。