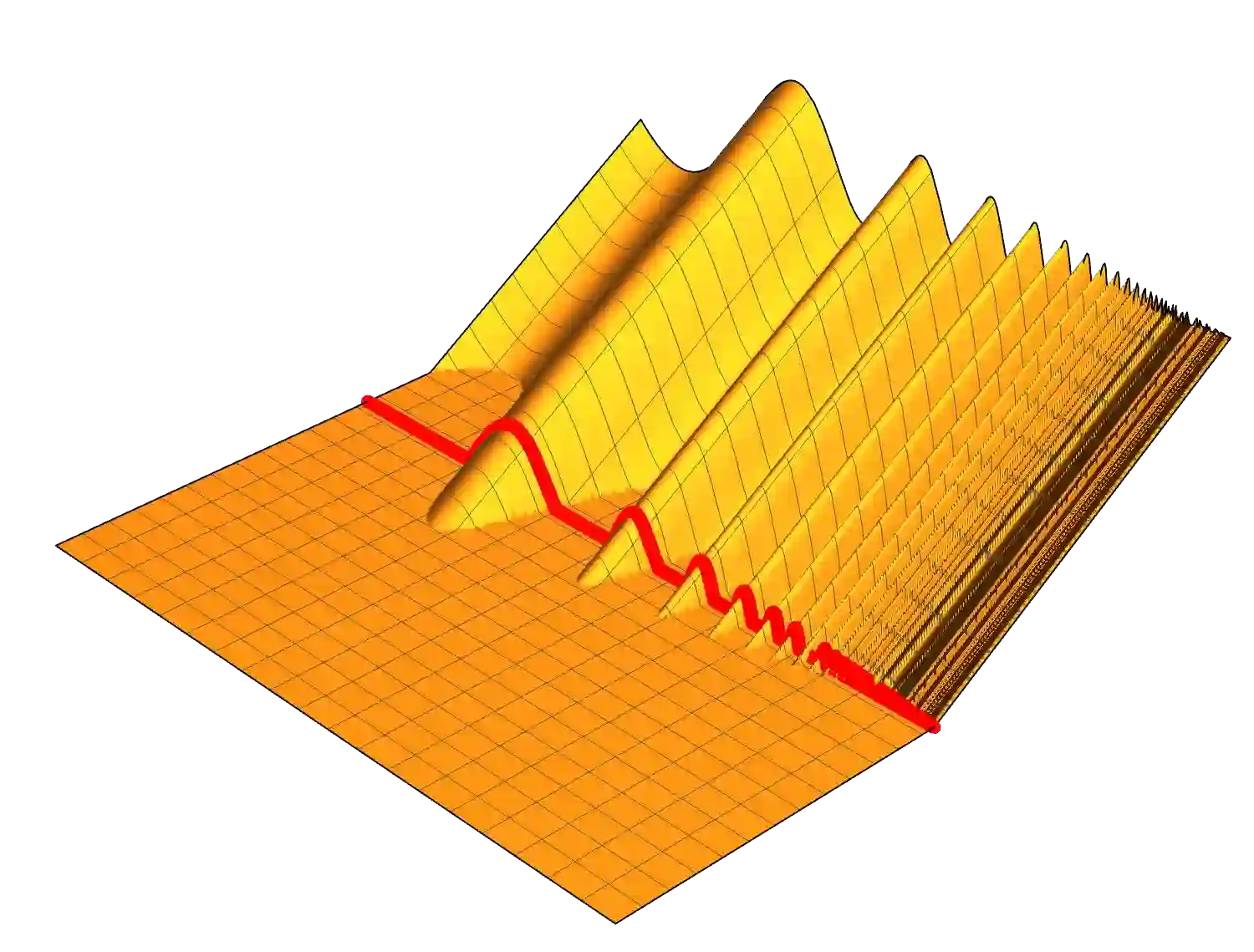

We provide counterexamples showing that uniform laws of large numbers do not hold for subdifferentials under natural assumptions. Our constructions are univariate random Lipschitz functions and bivariate random convex functions with two smooth pieces. Consequently, they resolve the questions posed by Shapiro and Xu [J. Math. Anal. Appl., 325 (2007), 1390-1399] in the negative. They also demonstrate the failure of certain graphical and pointwise laws for subdifferentials, revealing fundamental barriers to the consistency of sample-average approximation and subdifferential approximation.

翻译:我们构造反例证明,在自然假设下次梯度的一致大数定律不成立。我们的构造包括单变量随机Lipschitz函数和具有两个光滑片段的双变量随机凸函数。因此,这些反例从否定角度解决了Shapiro和Xu在《数学分析与应用杂志》[325卷(2007年), 1390-1399页]中提出的问题。它们同时证明了次梯度的某些图收敛律与点态收敛律的失效,揭示了样本平均逼近与次梯度逼近一致性存在的根本障碍。