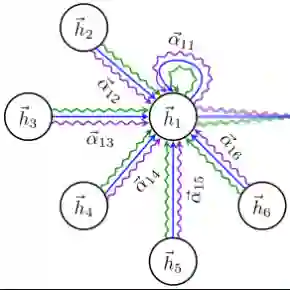

Graph neural networks have shown remarkable performance in forecasting stock movements, which arises from learning complex inter-dependencies between stocks and intra-dynamics of stocks. Existing approaches based on graph neural networks typically rely on static or manually defined factors to model changing inter-dependencies between stocks. Furthermore, these works often struggle to preserve hierarchical features within stocks. To bridge these gaps, this work presents the Energy-based Parallel Graph Attention Neural Network, a novel approach for predicting future movements for multiple stocks. First, it generates a dynamic stock graph with the energy difference between stocks and Boltzmann distribution, capturing evolving inter-dependencies between stocks. Then, a parallel graph attention mechanism is proposed to preserve the hierarchical intra-stock dynamics. Extensive experiments on five real-world datasets are conducted to validate the proposed approach, spanning from the US stock markets (NASDAQ, NYSE, SP) and UK stock markets (FTSE, LSE). The experimental results demonstrate that EP-GAT consistently outperforms competitive five baselines on test periods across various metrics. The ablation studies and hyperparameter sensitivity analysis further validate the effectiveness of each module in the proposed method. The raw dataset and code are available at https://github.com/theflash987/EP-GAT.

翻译:图神经网络在学习股票间复杂相互依赖关系与股票内部动态方面表现出色,从而在预测股票走势方面取得了显著成效。现有基于图神经网络的方法通常依赖静态或人工定义的因素来建模股票间不断变化的相互依赖关系。此外,这些方法往往难以有效保留股票内部的层次化特征。为弥补这些不足,本文提出了一种基于能量的并行图注意力神经网络,这是一种用于预测多只股票未来走势的新方法。首先,该方法利用股票间的能量差与玻尔兹曼分布生成动态股票图,以捕捉股票间不断演化的相互依赖关系。随后,提出一种并行图注意力机制,以保留股票内部的层次化动态特征。为验证所提方法,我们在五个真实世界数据集上进行了广泛实验,涵盖美国股票市场(NASDAQ、NYSE、SP)和英国股票市场(FTSE、LSE)。实验结果表明,在不同测试周期和多种评估指标下,EP-GAT 始终优于五个竞争性基线模型。消融研究和超参数敏感性分析进一步验证了所提方法中各个模块的有效性。原始数据集和代码可在 https://github.com/theflash987/EP-GAT 获取。