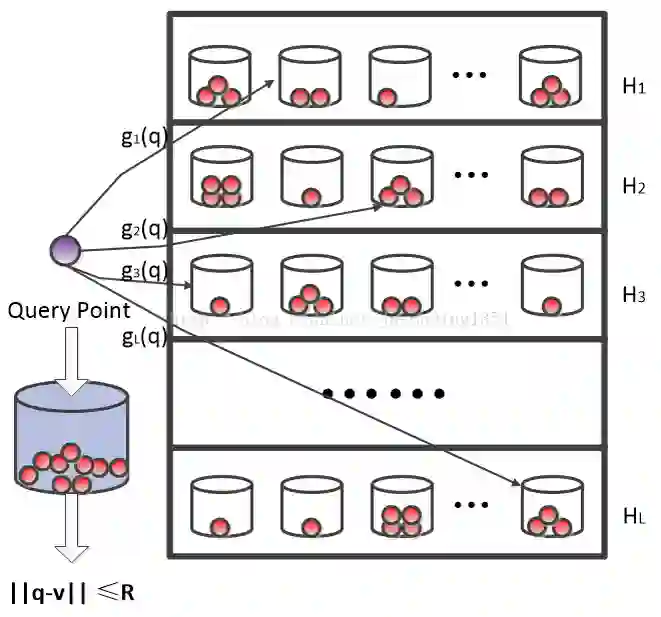

Hash-based sampling and estimation are common themes in computing. Using hashing for sampling gives us the coordination needed to compare samples from different sets. Hashing is also used when we want to count distinct elements. The quality of the estimator for, say, the Jaccard similarity between two sets, depends on the concentration of the number of sampled elements from their intersection. Often we want to compare one query set against many stored sets to find one of the most similar sets, so we need strong concentration and low error-probability. In this paper, we provide strong explicit concentration bounds for Tornado Tabulation hashing [Bercea, Beretta, Klausen, Houen, and Thorup, FOCS'23] which is a realistic constant time hashing scheme. Previous concentration bounds for fast hashing were off by orders of magnitude, in the sample size needed to guarantee the same concentration. The true power of our result appears when applied in the local uniformity framework by [Dahlgaard, Knudsen, Rotenberg, and Thorup, STOC'15].

翻译:哈希采样与估计是计算领域的常见主题。利用哈希进行采样为我们提供了比较不同集合样本所需的协调机制。哈希同样被应用于统计不同元素数量的场景。例如,评估两个集合间Jaccard相似度的估计器质量,取决于其交集采样元素数量的集中程度。在实际应用中,我们常需将查询集与多个存储集进行比较以寻找最相似集合,因此需要强集中性和低错误概率。本文针对Tornado Tabulation哈希算法[Bercea, Beretta, Klausen, Houen, and Thorup, FOCS'23]——一种实用的常数时间哈希方案——提出了严格的显式集中界。相较于先前快速哈希算法的集中界研究,在保证相同集中度所需样本量方面,我们的研究将精度提升了数个数量级。当结合[Dahlgaard, Knudsen, Rotenberg, and Thorup, STOC'15]提出的局部均匀性框架时,本研究成果将展现出更强的实际应用价值。