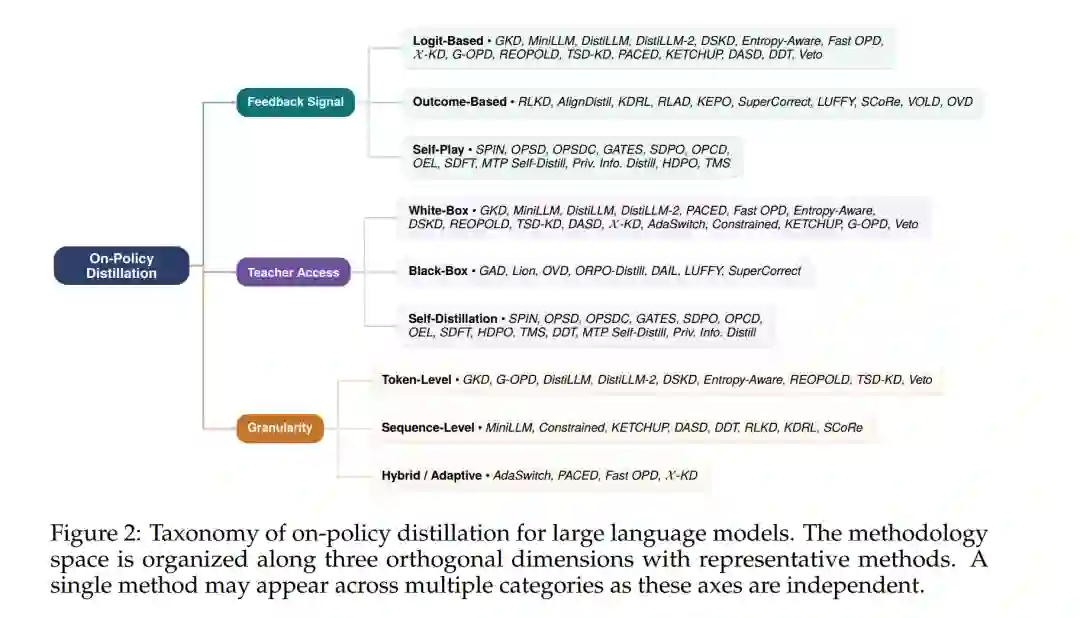

知识蒸馏已成为将前沿大语言模型(LLMs)的推理能力与领域专业知识迁移至小型可部署学生模型的主要机制。然而,目前的主流范式仍为离外策略(Off-policy):学生模型在教师生成的静态数据上进行训练,在学习过程中从未接触过自身生成的错误。这种训练与测试阶段的不匹配——即曝光偏差(Exposure Bias)的一个实例——导致推理时的预测错误随自回归过程不断累积。 同策略蒸馏(On-Policy Distillation, OPD)通过允许学生模型生成自身的轨迹(Trajectories),并针对这些自生成输出获取教师反馈,从而解决了这一问题。该方法将蒸馏过程植根于交互式模仿学习(Interactive Imitation Learning)理论。尽管在散度最小化、奖励引导学习及自我博弈(Self-play)等方向取得了快速增长,但 OPD 相关文献目前仍显零散,缺乏统一的论述。 本综述首次对面向 LLMs 的 OPD 技术进行了全面概述。我们引入了一个基于同策略样本的统一 $f$-散度框架,并从三个正交维度梳理了该领域的研究版图: 1. 反馈信号(基于 Logit、基于结果或基于自我博弈); 1. 教师访问权限(白盒、黑盒或无教师模式); 1. 损失粒度(词元级、序列级或混合级)。

此外,我们系统地分析了具有代表性的方法,考察了工业界部署情况,并指出了包括蒸馏缩放法则(Scaling Laws)、不确定性感知反馈以及智能体级蒸馏在内的开放性问题。

1 引言

大语言模型(LLMs)从根本上重构了自然语言处理领域,并日益深刻地影响着整个人工智能行业。从数亿参数扩展至数千亿参数,诸如 GPT-4、PaLM 和 Llama 等模型在推理、代码生成、多语言理解及指令遵循方面展现了卓越的能力。然而,训练和提供这些前沿模型服务的巨额计算成本,对于大多数部署场景而言依然高不可攀。对一个 5400 亿参数模型进行单次推理调用所消耗的能量和延迟,可能比经过良好训练的 70 亿参数备选模型高出数个数量级。这使得将能力从大型教师模型迁移至紧凑型学生模型不仅具有吸引力,更成为经济上的必然要求。知识蒸馏(Knowledge Distillation, KD)最初由 Hinton 等人(2015)正式提出,其定义为训练学生网络以匹配教师模型软化的输出分布。此后,KD 已从一种小众的压缩技术演变为现代 LLM 开发流程中的核心支柱。DeepSeek-R1(DeepSeek-AI 等,2025)的发布进一步证明了这一点:该模型成功地将复杂的思维链(Chain-of-Thought)推理能力从 6710 亿参数的混合专家(MoE)教师模型迁移到了 15 亿至 70 亿参数不等的稠密学生模型中。这表明,蒸馏现在已成为一种通用的能力迁移引擎,而非仅仅是减小体积的工具。 随着蒸馏作用的扩展,人们也逐渐意识到其主流范式中的一个根本性瓶颈。传统的 LLM 蒸馏本质上是离外策略(Off-policy)的。学生模型在固定语料库上进行训练——这些语料库通常采样自数据分布 $p_{\text{data}}$ 或由教师预先生成——并学习在这些预收集的序列上复制教师模型的词元级概率。然而,在推理时,学生模型必须以自回归方式进行生成,将每个新词元建立在自身之前(且可能错误)的输出之上。这种训练分布与学生自身生成分布之间的差异造成了训练-测试不匹配,并随序列长度增加而复合。Gudibande 等人(2023)对这一失败模式进行了系统的实证演示,表明离外策略蒸馏出的学生模型在需要持续多步生成的任务上性能会急剧下降。从形式上看,这一现象是模仿学习文献中深入研究的曝光偏差(Exposure Bias)的一个实例(Ross 等,2011):仅在专家状态演示上训练的策略在测试时会漂移到陌生的状态,且缺乏恢复所需的监督信号。对于自回归 LLM 而言,该问题尤为严重,因为早期位置的错误会传播至剩余的整个序列,而学生模型无法获得关于如何在这些自诱导的离群(Off-distribution)状态下表现的梯度信息。

同策略蒸馏(On-Policy Distillation, OPD)提供了一个原则性的解决方案。OPD 不在静态数据集上训练,而是让学生模型从其不断演化的策略 $p_{\theta}$ 中采样序列,然后针对这些自生成的轨迹征求教师的反馈。这种反馈形式多样,涵盖了白盒设置下的完整词元级概率分布(Agarwal 等,2024;Gu 等,2024),到仅有黑盒教师访问权限时的标量奖励、对抗性反馈或成对偏好(Ye 等,2025;Jiang 等,2023),甚至是无教师框架下的自生成对比信号(Chen 等,2024)。其理论动机直接源于交互式模仿学习。DAgger 算法(Ross 等,2011)证实,在学习者自身访问的状态上查询专家,可以将复合误差从纯行为克隆下的 $O(T^2)$ 降低到 $O(T)$(其中 $T$ 为时界长度)。OPD 在自回归语言生成中实例化了这一原理,将蒸馏从单次分布匹配转变为迭代、自纠错的优化循环。近年来,这一范式催生了一波方法论创新:广义知识蒸馏(GKD)(Agarwal 等,2024)引入了在学生和教师序列之间具有可配置混合比例的同策略采样;MiniLLM(Gu 等,2024)通过最小化逆向 KL 散度(Reverse KL)重构了目标函数,以避免前向 KL 的模式覆盖(Mode-covering)病态问题;DistiLLM(Ko 等,2024)提出了偏斜 KL 目标,通过混合学生和教师分布来稳定优化;RLKD(Xu 等,2025b)引入了具有结构感知奖励模型的强化学习(RL),以捕捉分布匹配无法迁移的推理模式;自我博弈微调(SPIN)(Chen 等,2024)则证明了学生模型无需任何教师模型,仅通过区分自身生成内容与人类参考资料即可实现自我提升。 尽管发展迅速,但 OPD 文献仍显零散。源自知识蒸馏社区、人类反馈强化学习(RLHF)社区和模仿学习社区的方法,往往使用不同的形式化方法、评估协议和术语来解决相同的潜在问题。现有的 LLM 蒸馏综述(Xu 等,2024)主要围绕经典的压缩框架组织,将离外策略和同策略方法视为可互换的变体,而非具有不同理论保证和失败模式的根本不同的范式。迄今为止,尚无综述对连接这些看似迥异的研究线路的同策略动力学进行统一的数学处理,也未系统比较 LLM 同策略学习中白盒、黑盒及无教师实例化的权衡。 本综述填补了这一空白。我们首次对大语言模型的同策略蒸馏进行了专门且全面的论述,并围绕一个具有理论依据的分类法展开。我们的贡献如下:

统一理论框架:我们从序列决策和学生采样轨迹上的 $f$-散度最小化视角,公式化了从离外策略到同策略蒸馏的转变。该框架揭示了 GKD、MiniLLM 和 DistiLLM 如何在不同的散度选择、参数排序、目标分布和采样混合系数下实例化相同的潜在目标,为比较此前孤立研究的方法提供了通用的分析语言。

三维分类法:我们沿三个正交轴组织 OPD 方法,即反馈信号(基于 Logit 的分布匹配、基于结果的标量或偏好信号、或自我博弈)、教师访问权限(白盒 Logit 访问、黑盒仅生成访问、或完全无教师的自蒸馏)以及损失粒度(词元级、序列级或混合/自适应级)。该分类法阐明了设计空间,并揭示了代表未来研究方向的、尚未被充分探索的组合。

桥接白盒与黑盒机制:我们系统比较了需要完整教师内部信息的同策略方法与仅依靠采样输出运行的方法,并通过 GAD(Ye 等,2025)和 Lion(Jiang 等,2023)等代表性方法,分析了从完整概率分布学习与从 Top-$k$ 生成内容学习之间的理论信息差。

识别被忽视的挑战:我们强调了几个尚未得到充分重视的问题,包括在线生成中的计算量与质量权衡、在低置信度学生状态下查询教师时的“回音室”效应(Echo chamber effect)、跨训练阶段动态调整散度的必要性,以及将蒸馏重新构想为结构化能力迁移而非参数级压缩的趋势。

未来研究路线图:我们规划了开放性问题,包括蒸馏缩放法则、不确定性感知 OPD、课程驱动采样策略,以及模型必须从与外部环境的多轮、状态相关交互中学习的智能体级蒸馏。

本综述余下部分的结构如下:第 2 节确立数学基础,将自回归生成形式化为序列决策问题,并推导出促合同策略方法的曝光偏差。第 3 节详细介绍我们的三维分类法。第 4 节深入分析白盒 OPD 方法,第 5 节涵盖黑盒及自蒸馏方法。第 6 节探讨针对推理的特定蒸馏流程。第 7 节讨论工业部署考量与实践指南,第 8 节总结开放问题与未来方向。