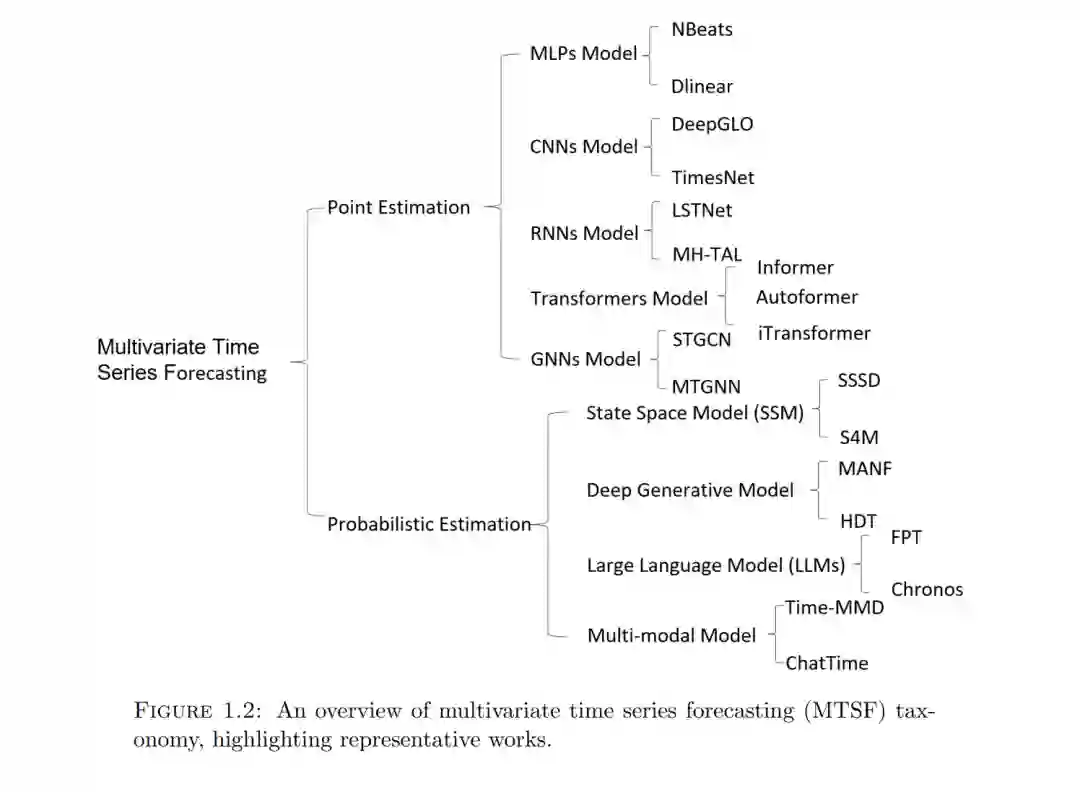

时间序列是随时间收集的序贯观测值,广泛存在于金融、能源、交通及天气预报等众多现实应用场景中。与图像或文本不同,时间序列的语义主要由时间动态以及历史观测值中演化的依赖关系所决定。传统的预测方法,如自回归综合移动平均模型 (ARIMA)、指数平滑法和谱分析,虽能捕捉简单的趋势和季节性,但往往依赖于线性和平稳性假设,这限制了它们在处理非线性、高维且不规则的现实世界时间序列时的有效性。 本论文提出了一种基于深度生成建模的多变量时间序列分析方法,旨在学习能够同时捕捉各变量内部时间依赖关系以及变量间相互作用的预测分布,从而实现精确的分布建模。在本文中,我提出了“基于深度生成模型的多变量时间序列分析”,通过深度生成模型的分布建模方式,捕捉变量间(inter-variates)与变量内(intra-variates)复杂的非线性依赖关系,以实现更准确的时间序列预测。深度生成模型为分布建模提供了灵活的框架,支持高维数据生成,并能更好地适应漂移模式(shifting patterns),使其适用于长程场景下准确且稳健的预测。总体而言,本论文通过三个互补的方向解决多变量预测问题:用于提升准确性的精确分布建模、用于提升可扩展性的潜在空间生成,以及用于增强预测稳健性的分层离散建模。

为了解决准确概率预测的首要挑战,我们提出了“多尺度注意力非自回归流”(Multi-scale Attention Non-autoregressive Flow),这是一种用于多变量时间序列预测的生成式框架。该模型结合了捕捉单变量时间依赖序列组件和捕捉变量间依赖的分布建模组件,实现了非自回归生成。多尺度注意力设计进一步助力模型表征不同分辨率下的时间模式。在多个基准数据集上的实验表明,该方法相比强基准模型提升了概率预测和点预测性能,在概率准确度和确定性准确度上分别实现了 21.9% 和 14.5% 的平均提升。

在非自回归生成式构建的基础上,我们进一步研究了高维多变量设置下的高效生成问题。我们提出了“潜在扩散 Transformer”(Latent Diffusion Transformer),这是一个两阶段框架:首先学习紧凑的潜在表示,然后在潜在空间中进行条件分布生成。编码器旨在保留潜在变量中的关键时间模式,而条件生成器则在无需自回归解码的情况下对预测分布进行建模。在现实世界基准测试上的实验显示,该方法在提升概率和点预测准确性的同时,降低了多步推理成本。

为了提高高维设置下的长程预测能力,我们提出了“分层离散 Transformer”(Hierarchical Discrete Transformer),这是一种具有离散表示的分层生成框架。该方法学习的多尺度表示为未来预测提供了强有力的条件信号,并通过由粗到精(coarse-to-fine)的生成策略对长程预测分布进行建模。这种分层设计旨在扩展预测视野并保持准确性。针对 11 个强生成式基准模型和 5 个流行数据集的广泛实验表明,HDT 提升了长程概率预测和点预测的性能。

综上所述,本论文通过三种生成式预测框架,解决了多变量时间序列预测中的三个核心挑战:提高预测准确性、降低推理成本以及扩展预测视野。第一种方法提升了涵盖金融、电力、交通等多个现实基准数据集的概率和点预测性能。第二种方法采用两阶段生成策略,提高了高维设置下的可扩展性,并在保持高预测准确性的同时实现了更高效的多步推理。第三种方法引入了分层离散生成方法,强化了长程预测性能。总体结果证实了深度生成建模在稳健、可扩展的多变量预测中的有效性,尤其是在高维和长程预测场景下。