自主空中加油需要精确的相对姿态估计以实现精准对接。现有的单目视觉方法,例如基于双目标检测的相对导航,依赖于单一视角,限制了可扩展性和测量冗余度。本文提出“回文(PALINDROME)”框架,一种双向、多目标检测框架,它集成来自接收机和加油机载摄像头的姿态测量,以提高精度与鲁棒性。

回文框架采用模块化的基于YOLO的检测流程,其中针对每个目标训练独立的模型,而非使用单一网络处理所有检测。训练过程利用“上下文外”与“上下文中”合成图像,以提升特征识别能力并减少误报。为进一步增强可扩展性,采用Artec Ray II扫描仪获取的高保真3D飞机扫描数据,可实现不依赖基于动作捕捉标签限制的合成数据集生成,使该方法能适配如湾流GIII等大型飞机平台。一种引导式迁移学习方法提供了从仿真到实物的适应策略,即先利用合成数据对网络进行预训练,再在真实图像上进行微调。该方法有助于弥合仿真与真实飞行条件之间的域差距。

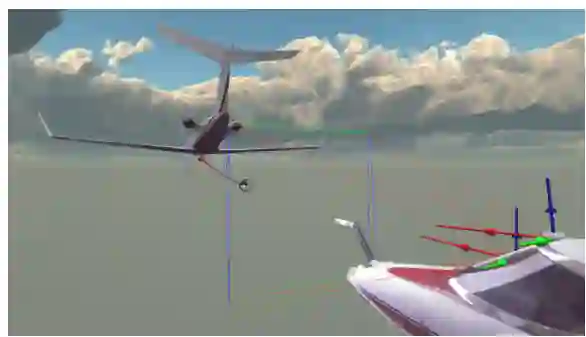

为支持该框架的开发与评估,本研究引入了“回文实验场”——一个用于测试基于视觉的相对导航的确定性虚拟仿真环境。该仿真器支持与真实值进行比较,可测量不同视角和不同目标的姿态估计误差,同时评估系统在合成图像和真实图像中的行为。额外的分析探究了加油机与接收机对探头-锥套相对向量的姿态估计之间的一致性。通过解决现有方法的关键局限性,并提供从3D扫描到YOLO模型训练与验证的结构化流程,本工作推动了用于自主空中加油及相关对接应用的人工智能驱动视觉系统的发展。

成为VIP会员查看完整内容