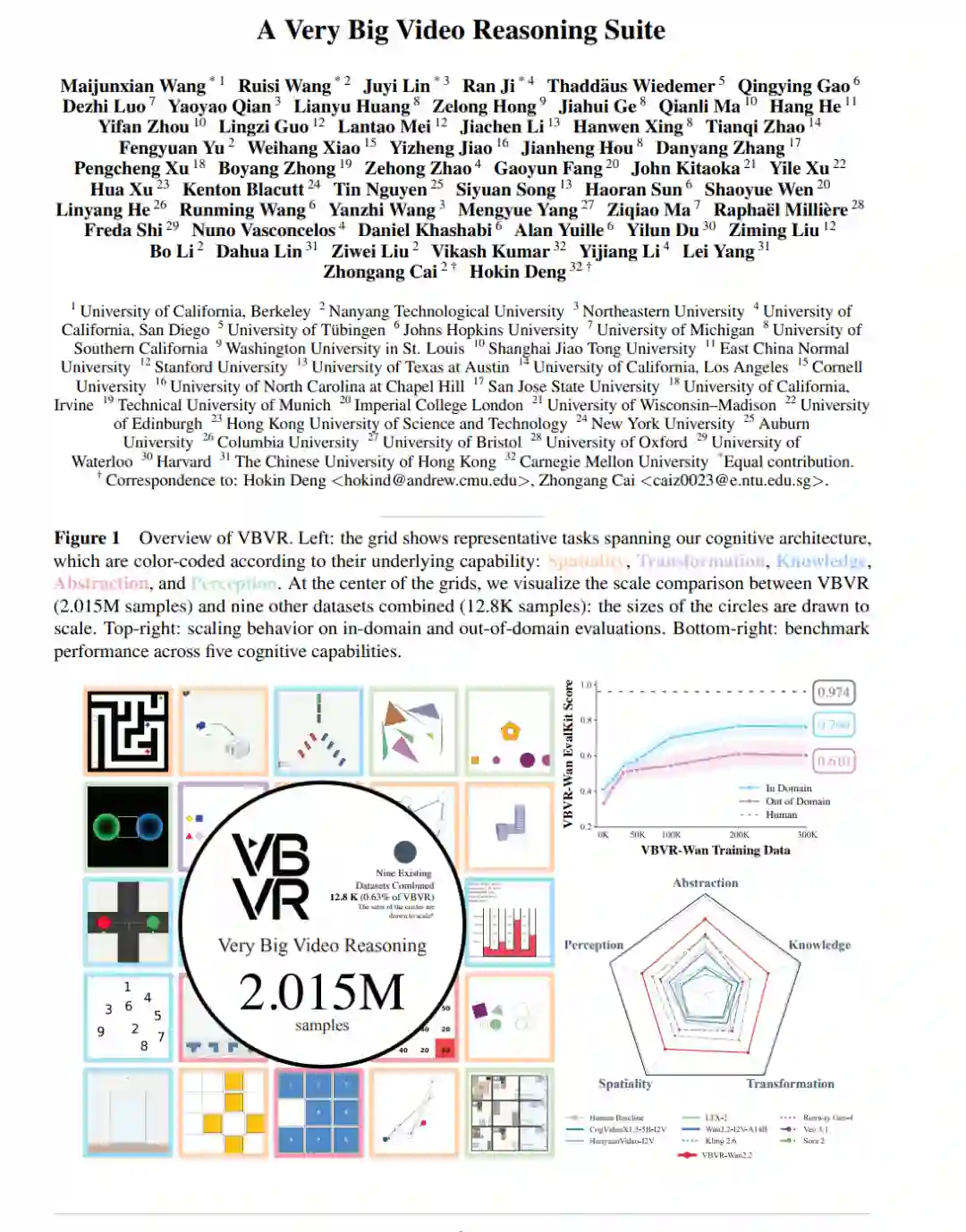

视频模型的飞速发展主要聚焦于视觉质量的提升,而其推理能力(Reasoning Capabilities)尚未得到充分挖掘。视频推理将智能植根于时空一致(Spatiotemporally Consistent)的视觉环境中,能够捕捉文本难以自然表述的信息,从而实现对连续性、交互性及因果关系等时空结构的直觉式推理。然而,由于缺乏大规模的视频推理训练数据,系统性研究视频推理及其缩放行为(Scaling Behavior)受到严重制约。 为填补这一空白,本文推出了超大规模视频推理数据集(VBVR Dataset)。这是一个规模空前的资源库,包含遵循规范化分类体系的 200 项精选推理任务,以及逾一百万个视频片段——其规模较现有数据集提升了约三个数量级。此外,我们提出了 VBVR-Bench,这是一个可验证的评估框架;该框架通过引入基于规则且符合人类直觉的评分机制(Rule-based, Human-aligned Scorers),超越了传统的“以模型评判模型(Model-based Judging)”范式,实现了对视频推理能力具可复现性且具可解释性的诊断。 依托 VBVR 套件,我们开展了首批关于视频推理的大规模缩放研究,并观察到了模型对未知推理任务产生**涌现式泛化(Emergent Generalization)**的早期迹象。综上所述,VBVR 为下一阶段可泛化视频推理的研究奠定了坚实基础。相关数据、评测工具包及模型已在 video-reason.com 公开。

1. 引言

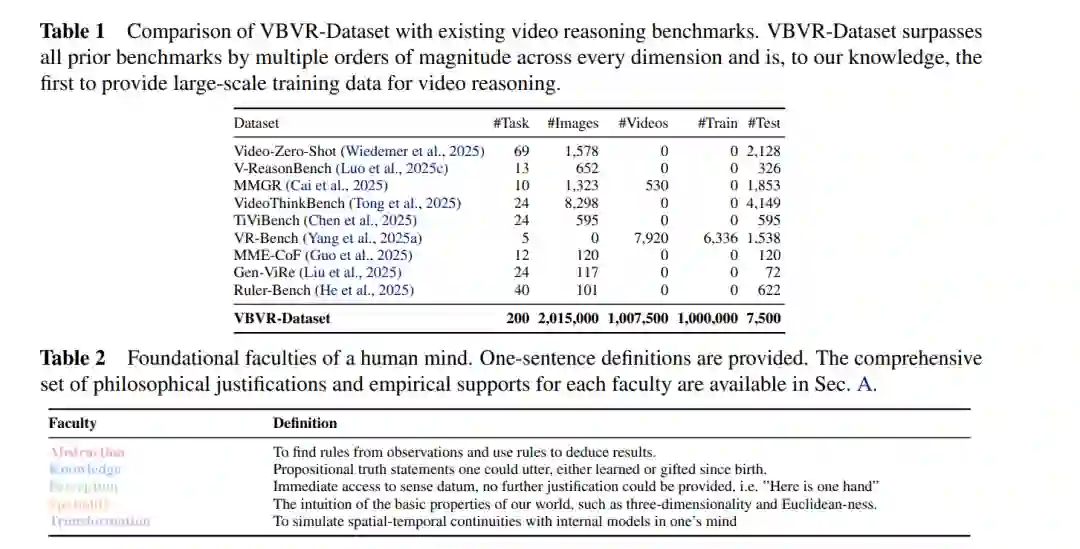

大语言模型(LLMs)已取得突破性进展,其推理能力已泛化至编程、数学及科学发现等极具挑战性的任务中 (Mitchell, 2025; Rapaport, 2026)。然而,此类能力目前很大程度上仍局限于文本场景。与此同时,视频生成模型的近期进展主要集中在视觉真实感(Visual Realism)上,对其推理能力的关注相对有限。然而,视频模型有望支撑一种全新的推理范式 (Wiedemer et al., 2025),即植根于时空一致(Spatiotemporally Consistent)的视觉环境中,其中空间结构、物理动力学及远距离因果关系被自然地编码。这使得视频帧成为研究植根于物理世界的推理能力的理想基质。尽管前景广阔且研究兴趣日益增长,但社区仍缺乏实现系统性进展的关键组件:(1) 用于深入研究缩放效应(Scaling)与泛化性的大规模多样化数据集;(2) 基于可验证且可复现原则构建的评估工具链;(3) 考察视频推理模型中涌现能力(Emergent Capabilities)的初步缩放研究。本文通过推出 Very Big Video Reasoning (VBVR) 套件,一次性解决了上述三大挑战。 首先,我们介绍了 VBVR-Dataset,这是一个旨在促进视频推理系统研究的大规模多样化训练源。我们采用规范化方法,将任务分类体系(Taxonomy)锚定在公认的人类认知架构理论之上 (Newell & Simon, 1972; Anderson, 2007)。具体而言,我们将核心视觉推理能力组织为五大支柱:抽象 (Abstraction)、知识 (Knowledge)、空间性 (Spatiality)、知觉 (Perception) 与变换 (Transformation)。该数据集是全球超过 50 位来自不同领域的科研人员与工程师通力合作的成果,确保了目前已涵盖的 200 项任务具有广泛的覆盖面和深厚的领域专业性。贡献者被赋予充分的自由来设计核心任务语义和推理流程,以实现最大限度的多样化;同时,我们应用统一的全局任务模板作为输入输出规范的标准化包装器。这种分离机制在不限制任务创造力的前提下,确保了自动化缩放的一致性。所有任务在进入基于云端的自动化分布式生成流水线之前,均经过专家人工检查以确保质量与准确性。总计,VBVR-Dataset 包含 2,015,000 张图像和 1,007,500 个视频剪辑,规模约为现有同类数据集的 1,000 倍。重要的是,该流水线可立即兼容新加入的任务,并支持每项任务样本量的可扩展生成,从而实现数据集广度与规模的持续扩张。 其次,VBVR-Bench 为视频推理模型提供了一个系统、可复现且具解释性的评估框架。尽管“视听语言模型评判(VLM-as-a-judge)”范式在评估视频生成模型中被广泛采用 (Peng et al., 2025),但我们明确强制使用可验证的、基于规则的评分器,以确保评估结果定义清晰且完全可复现。为了验证这些特定任务评分器能忠实反映模型能力,我们进行了人类偏好对齐实验,观察到自动评分与人工判断之间存在极强的一致性(斯皮尔曼相关系数 $\rho > 0.9$)。利用 VBVR-Bench,我们对领先的商业模型——Veo 3.1 (Google DeepMind, 2026)、Sora 2 (OpenAI, 2025)、Kling 2.6 (快手, 2025) 和 Runway Gen-4 (Runway Research, 2025)——以及包括 Wan-2.2 (万像团队, 2025)、CogVideoX1.5 (Yang et al., 2024)、HunyuanVideo (腾讯混元, 2024) 和 LTX-2 (HaCohen et al., 2026) 在内的代表性开源模型进行了基准测试。结果显示,不同系统之间的视频推理能力存在巨大差距;即便最强的模型距离人类水平仍有显著差距。此外,我们利用 VBVR 分析了不同认知能力在模型中是如何协同演进的,揭示了推理技能之间非平凡(Non-trivial)的依赖关系与权衡。 最后,在拥有大规模数据集和可靠评估基准的基础上,我们深入探讨了视频生成模型中的缩放效应(Scaling Effects)。以 Wan-2.2 为基座模型,我们观察到随着训练规模的扩大,域内(ID)和域外(OOD)任务的性能均同步提升,这表明泛化能力正在逐渐涌现。除性能提升外,我们的分析还得出几项关键洞察:第一,随着数据规模的增加,ID 和 OOD 任务的性能最终都会进入平台期,模型与人类表现之间仍存在无法单纯通过数据缩放来弥合的持久差距。这表明目前的视频生成架构在应用于视频推理时存在根本性局限。第二,尽管 OOD 性能随规模显著提升,但 ID 与 OOD 设置之间仍存在一致的差距;缩小这一差距对于实现鲁棒的、真实场景(In-the-wild)下的视频推理与生成至关重要。最后,定性分析揭示了随着模型规模增加,在指令遵循、受控编辑和语义理解方面出现的涌现行为,同时也暴露了驱动未来研究的重要局限性。 总之,我们推出了以规模空前且持续增长的视频推理数据集 VBVR-Dataset 为核心的 VBVR 套件,并辅以可验证、符合人类直觉的评估工具包 VBVR-Bench。依托该套件,我们完成了首批关于视频推理模型的系统性缩放研究,并发现了涌现泛化性的早期积极证据。我们认为,VBVR 为迈向通用视频推理的未来研究提供了基础性的基础设施。